Adaptive Collaboration of Arena-Based Argumentative LLMs for Explainable and Contestable Legal Reasoning

作者: Hoang-Loc Cao, Phuc Ho, Truong Thanh Hung Nguyen, Phuc Truong Loc Nguyen, Dinh Thien Loc Nguyen, Hung Cao

分类: cs.MA, cs.AI, cs.SC

发布日期: 2026-02-21

🔗 代码/项目: GITHUB

💡 一句话要点

提出ACAL框架,结合论辩LLM与人机交互,提升法律推理的可解释性和可辩论性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 法律推理 大语言模型 论辩框架 人机交互 可解释性 可辩论性 多智能体系统 神经符号计算

📋 核心要点

- 现有LLM法律推理方法缺乏形式化的验证机制和用户干预手段,导致解释不透明且难以辩论。

- ACAL框架结合多智能体协作和论辩框架,动态构建论证、解决冲突,并支持人机在环的可辩论性工作流程。

- 实验结果表明,ACAL在LegalBench基准上优于现有方法,实现了预测性能、透明性和可辩论性的有效平衡。

📝 摘要(中文)

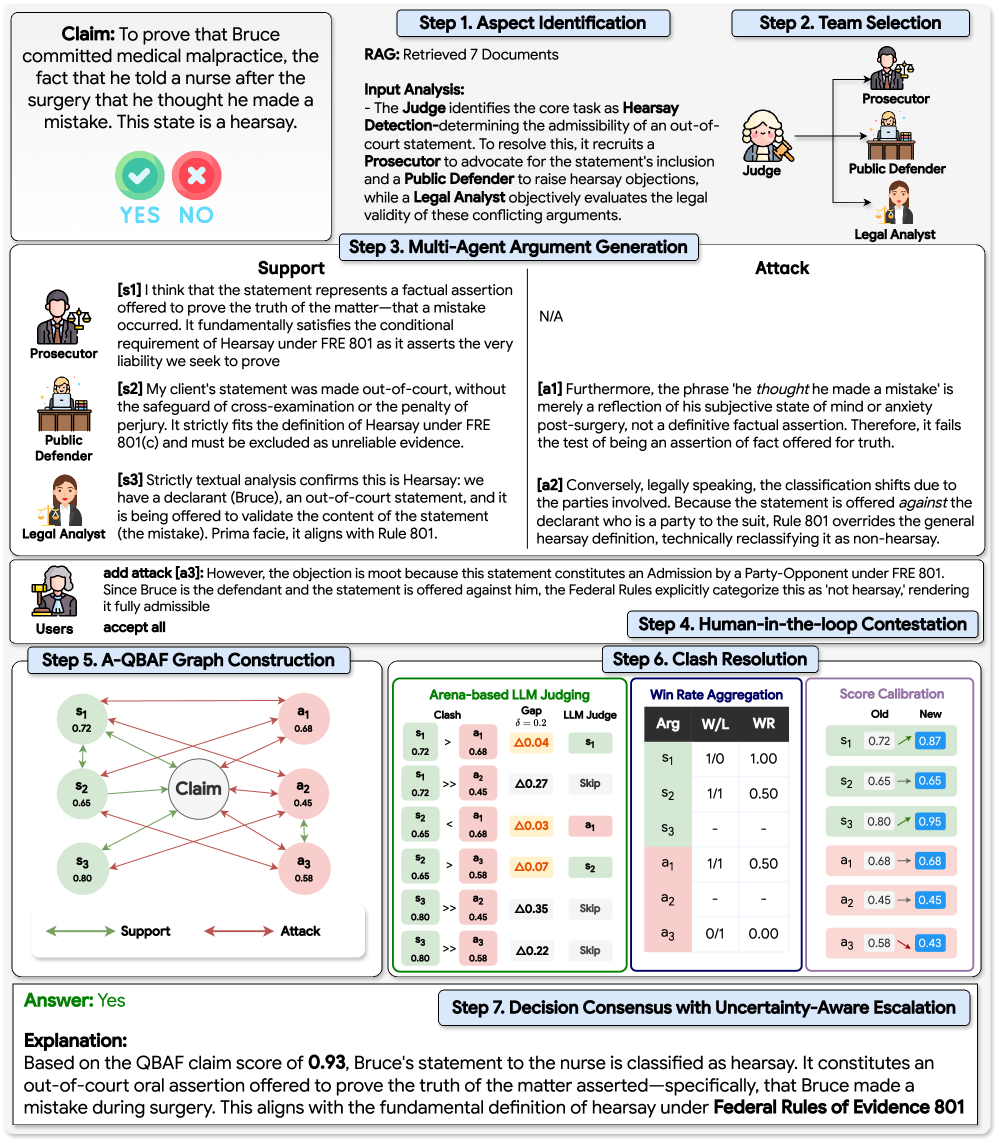

法律推理不仅需要高准确率,还需要通过可验证和可辩论的论证来证明决策的合理性。然而,现有的大语言模型(LLM)方法,如思维链(CoT)和检索增强生成(RAG),通常产生缺乏形式化验证机制或用户干预的非结构化解释。为了解决这一局限性,我们提出了自适应论辩LLM协作(ACAL),这是一个神经符号框架,它将自适应多智能体协作与基于Arena的定量双极论证框架(A-QBAF)相结合。ACAL动态部署专家智能体团队来构建论证,采用冲突解决机制来裁决相互冲突的主张,并利用不确定性感知升级来处理边缘案例。至关重要的是,我们的框架支持人机在环(HITL)的可辩论性工作流程,使用户能够直接审计和修改底层推理图,从而影响最终判断。在LegalBench基准上的实证评估表明,ACAL在Gemini-2.5-Flash-Lite和Gemini-2.5-Flash架构上优于强大的基线,有效地平衡了高效的预测性能与结构化的透明性和可辩论性。

🔬 方法详解

问题定义:现有基于LLM的法律推理方法,如CoT和RAG,生成的解释通常是非结构化的,缺乏形式化的验证机制,也难以进行用户干预。这导致推理过程不透明,难以辩论和质疑,限制了其在法律领域的实际应用。

核心思路:ACAL的核心思路是将LLM的推理能力与形式化的论辩框架相结合,构建一个神经符号系统。通过多智能体协作生成论证,并利用论辩框架进行冲突解决和不确定性处理,从而提高推理过程的透明性和可辩论性。同时,引入人机在环机制,允许用户审计和修改推理过程,进一步增强可信度。

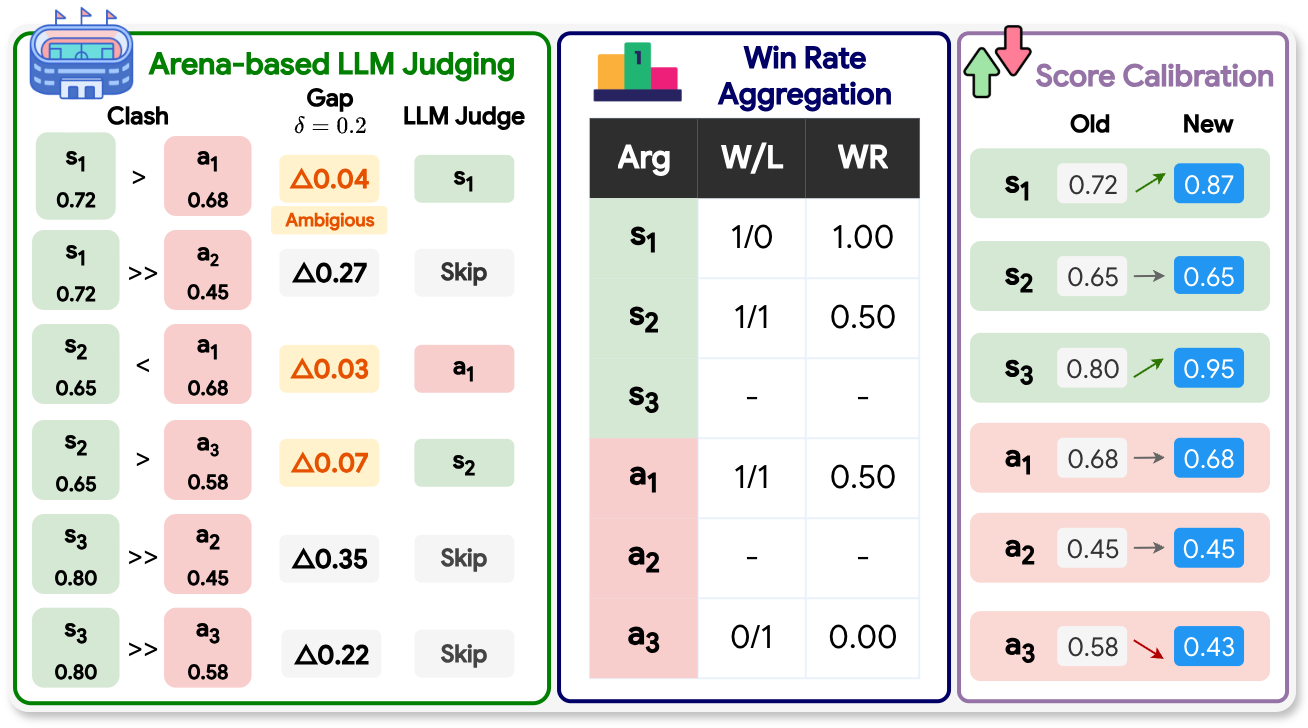

技术框架:ACAL框架主要包含以下几个模块:1) 专家智能体团队:动态部署多个LLM智能体,每个智能体负责构建特定方面的论证。2) 基于Arena的定量双极论证框架(A-QBAF):用于形式化地表示和评估论证,处理冲突和不确定性。3) 冲突解决机制:裁决相互冲突的主张,选择最合理的论证。4) 不确定性感知升级:处理边缘案例,提高推理的鲁棒性。5) 人机在环(HITL)接口:允许用户审计和修改推理图,影响最终判断。

关键创新:ACAL的关键创新在于将LLM的生成能力与形式化的论辩框架相结合,构建了一个可解释、可辩论的法律推理系统。与传统的CoT和RAG方法相比,ACAL提供了一种结构化的推理过程,允许用户进行审计和干预,从而提高了推理的可信度。此外,ACAL还引入了多智能体协作和冲突解决机制,进一步增强了推理的鲁棒性和准确性。

关键设计:ACAL的关键设计包括:1) 智能体选择策略:根据具体任务动态选择合适的LLM智能体。2) 论证构建策略:指导智能体如何构建有效的论证。3) 冲突解决策略:定义如何裁决相互冲突的主张。4) 不确定性度量方法:用于评估边缘案例的不确定性。5) 人机交互界面设计:提供友好的用户界面,方便用户审计和修改推理图。具体的参数设置、损失函数和网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

ACAL在LegalBench基准测试中,使用Gemini-2.5-Flash-Lite和Gemini-2.5-Flash架构,性能优于现有基线方法。实验结果表明,ACAL在保持高效预测性能的同时,显著提升了法律推理的透明性和可辩论性。具体的性能提升幅度在论文中未给出明确的数值,属于未知信息。

🎯 应用场景

ACAL框架可应用于法律咨询、案件分析、法律文书生成等领域。通过提供可解释和可辩论的推理过程,ACAL可以帮助律师和法律专业人士更好地理解和评估案件,提高工作效率和决策质量。此外,ACAL还可以用于法律教育和培训,帮助学生更好地理解法律推理的原理和方法。未来,ACAL有望成为法律领域的重要辅助工具。

📄 摘要(原文)

Legal reasoning requires not only high accuracy but also the ability to justify decisions through verifiable and contestable arguments. However, existing Large Language Model (LLM) approaches, such as Chain-of-Thought (CoT) and Retrieval-Augmented Generation (RAG), often produce unstructured explanations that lack a formal mechanism for verification or user intervention. To address this limitation, we propose Adaptive Collaboration of Argumentative LLMs (ACAL), a neuro-symbolic framework that integrates adaptive multi-agent collaboration with an Arena-based Quantitative Bipolar Argumentation Framework (A-QBAF). ACAL dynamically deploys expert agent teams to construct arguments, employs a clash resolution mechanism to adjudicate conflicting claims, and utilizes uncertainty-aware escalation for borderline cases. Crucially, our framework supports a Human-in-the-Loop (HITL) contestability workflow, enabling users to directly audit and modify the underlying reasoning graph to influence the final judgment. Empirical evaluations on the LegalBench benchmark demonstrate that ACAL outperforms strong baselines across Gemini-2.5-Flash-Lite and Gemini-2.5-Flash architectures, effectively balancing efficient predictive performance with structured transparency and contestability. Our implementation is available at: https://github.com/loc110504/ACAL.