Carbon-aware decentralized dynamic task offloading in MIMO-MEC networks via multi-agent reinforcement learning

作者: Mubshra Zulfiqar, Muhammad Ayzed Mirza, Basit Qureshi

分类: cs.DC, cs.AI, cs.LG

发布日期: 2026-02-21

💡 一句话要点

提出CADDTO-PPO框架,解决MIMO-MEC网络中碳感知去中心化动态任务卸载问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱八:物理动画 (Physics-based Animation)

关键词: 移动边缘计算 多智能体强化学习 碳感知 任务卸载 MIMO网络

📋 核心要点

- 现有集中式优化和离线强化学习方法在密集MIMO-MEC网络中面临可扩展性和信令开销的挑战,难以应对任务到达和绿色能源供应的时空不匹配。

- CADDTO-PPO框架基于多智能体PPO,采用去中心化执行和参数共享,使物联网设备仅根据本地观测自主进行功率控制和任务卸载。

- 实验结果表明,CADDTO-PPO在碳强度和数据包溢出率方面优于DDPG和基于Lyapunov的基线方法,并具有O(1)的推理复杂度。

📝 摘要(中文)

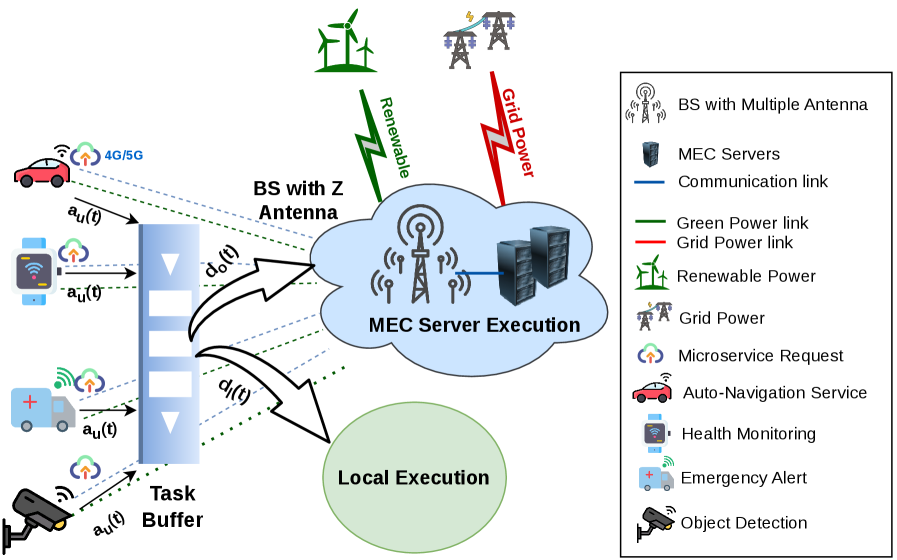

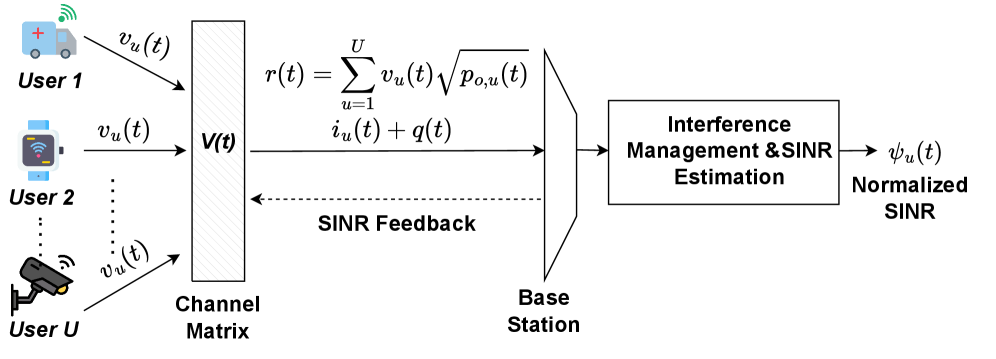

大规模物联网微服务需要将可再生能源整合到移动边缘计算(MEC)中,以实现可持续的eScience基础设施。随机任务到达和间歇性绿色能源在时空上的不匹配,以及多天线(MIMO)上行链路中复杂的用户间干扰,使得实时资源管理变得复杂。传统的集中式优化和离线强化学习在密集网络中面临可扩展性和信令开销的挑战。本文提出了CADDTO-PPO,一个基于多智能体近端策略优化(PPO)的碳感知去中心化动态任务卸载框架。该框架将多用户MIMO-MEC系统建模为去中心化部分可观测马尔可夫决策过程(DEC-POMDP),以联合最小化碳排放、缓冲延迟和能量浪费。一种可扩展的架构利用了具有参数共享的去中心化执行(DEPS),使自主物联网代理能够仅基于本地观测做出细粒度的功率控制和卸载决策。此外,一种碳优先奖励结构自适应地优先考虑绿色时隙进行数据传输,从而将系统吞吐量与依赖于电网的碳足迹分离。实验结果表明,CADDTO-PPO优于深度确定性策略梯度(DDPG)和基于Lyapunov的基线方法。该框架实现了最低的碳强度,并在极端流量负载下保持接近零的数据包溢出率。架构分析验证了该框架具有恒定的O(1)推理复杂度,以及未来可持续物联网部署的理论轻量级可行性。

🔬 方法详解

问题定义:论文旨在解决多用户MIMO-MEC网络中,如何在任务到达和可再生能源供应具有时空不确定性的情况下,实现碳感知的动态任务卸载问题。现有集中式方法面临可扩展性问题,而传统的强化学习方法难以处理部分可观测环境和高维状态空间,导致次优的资源分配和较高的碳排放。

核心思路:论文的核心思路是采用多智能体强化学习,将每个物联网设备视为一个智能体,通过去中心化的方式进行决策,从而提高系统的可扩展性和鲁棒性。同时,设计碳优先的奖励函数,引导智能体优先利用绿色能源进行任务卸载,降低碳排放。

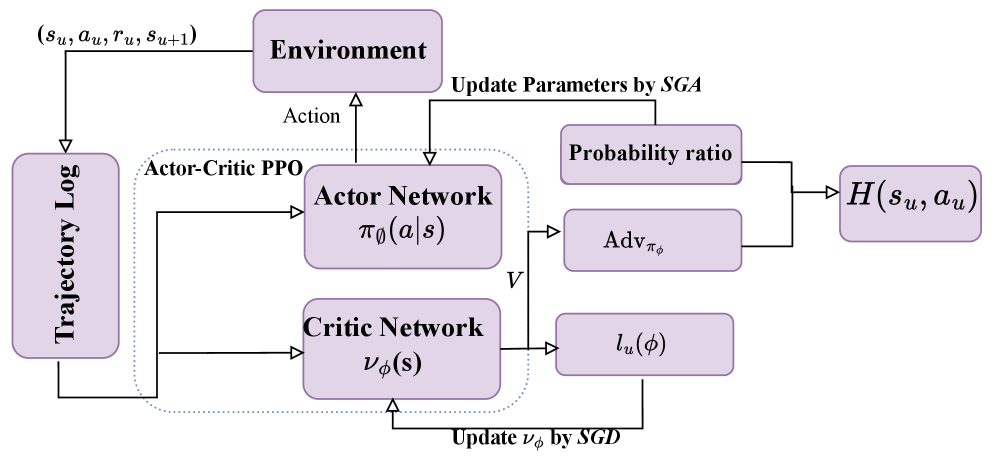

技术框架:CADDTO-PPO框架将多用户MIMO-MEC系统建模为DEC-POMDP。整体流程包括:1) 每个智能体根据本地观测(如任务队列长度、信道状态、可用绿色能源等)选择动作(功率控制和任务卸载决策);2) 系统执行动作并产生奖励(基于碳排放、延迟和能量消耗);3) 智能体利用PPO算法更新策略,目标是最大化累积奖励。框架采用DEPS架构,所有智能体共享策略参数,从而降低训练复杂度。

关键创新:论文的关键创新在于:1) 提出了碳感知的奖励函数,将碳排放纳入优化目标,引导智能体优先使用绿色能源;2) 采用DEPS架构,实现了去中心化的决策,提高了系统的可扩展性和鲁棒性;3) 将多用户MIMO-MEC系统建模为DEC-POMDP,更准确地描述了系统的动态特性。

关键设计:碳感知奖励函数的设计是关键,它综合考虑了碳排放、任务延迟和能量消耗,并对绿色时隙进行奖励加权。PPO算法采用裁剪策略来限制策略更新的幅度,防止训练不稳定。网络结构方面,每个智能体使用一个小的多层感知机(MLP)来估计策略和价值函数。具体参数设置(如学习率、裁剪参数、折扣因子等)通过实验进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CADDTO-PPO在碳强度方面显著优于DDPG和基于Lyapunov的基线方法,实现了最低的碳排放。在极端流量负载下,CADDTO-PPO仍能保持接近零的数据包溢出率,验证了其在复杂环境下的鲁棒性。架构分析表明,CADDTO-PPO具有O(1)的推理复杂度,使其适用于资源受限的物联网设备。

🎯 应用场景

该研究成果可应用于智慧城市、智能工厂等大规模物联网场景,通过优化任务卸载策略,降低能源消耗和碳排放,提高资源利用率,实现可持续的绿色计算。该方法还可扩展到其他资源受限的边缘计算环境,例如车载边缘计算和无人机边缘计算。

📄 摘要(原文)

Massive internet of things microservices require integrating renewable energy harvesting into mobile edge computing (MEC) for sustainable eScience infrastructures. Spatiotemporal mismatches between stochastic task arrivals and intermittent green energy along with complex inter-user interference in multi-antenna (MIMO) uplinks complicate real-time resource management. Traditional centralized optimization and off-policy reinforcement learning struggle with scalability and signaling overhead in dense networks. This paper proposes CADDTO-PPO, a carbon-aware decentralized dynamic task offloading framework based on multi-agent proximal policy optimization. The multi-user MIMO-MEC system is modeled as a Decentralized Partially Observable Markov Decision Process (DEC-POMDP) to jointly minimize carbon emissions and buffer latency and energy wastage. A scalable architecture utilizes decentralized execution with parameter sharing (DEPS), which enables autonomous IoT agents to make fine-grained power control and offloading decisions based solely on local observations. Additionally, a carbon-first reward structure adaptively prioritizes green time slots for data transmission to decouple system throughput from grid-dependent carbon footprints. Finally, experimental results demonstrate CADDTO-PPO outperforms deep deterministic policy gradient (DDPG) and lyapunov-based baselines. The framework achieves the lowest carbon intensity and maintains near-zero packet overflow rates under extreme traffic loads. Architectural profiling validates the framework to demonstrate a constant $O(1)$ inference complexity and theoretical lightweight feasibility for future generation sustainable IoT deployments.