Can AI Lower the Barrier to Cybersecurity? A Human-Centered Mixed-Methods Study of Novice CTF Learning

作者: Cathrin Schachner, Jasmin Wachter

分类: cs.CR, cs.AI

发布日期: 2026-02-20

备注: A Preprint

💡 一句话要点

利用AI降低网络安全门槛:以人为本的新手CTF学习混合方法研究

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 网络安全教育 夺旗竞赛(CTF) 人工智能辅助学习 渗透测试 以人为本 混合方法研究

📋 核心要点

- CTF竞赛对新手存在工具链复杂、流程不透明等障碍,限制了其参与网络安全。

- 论文探索了智能AI框架(CAI)如何通过自动化渗透测试任务来降低新手参与CTF的门槛。

- 研究表明CAI能降低认知负荷,促进策略探索,但也带来信任、依赖等新挑战。

📝 摘要(中文)

夺旗竞赛(CTF)是进入攻击性网络安全的途径,但由于复杂的工具链和不透明的工作流程,新手往往面临巨大的障碍。最近,用于网络安全的智能AI框架承诺通过自动化和协调渗透测试任务来降低这些障碍。然而,它们在塑造新手学习中的作用仍未被充分探索。本文提出了一项以人为本的混合方法案例研究,探讨了智能AI框架(此处为Cybersecurity AI (CAI))如何促进新手进入基于CTF的渗透测试。一位没有先前黑客经验的本科生尝试使用CAI来达到国家网络安全挑战赛的性能基准。定量性能指标辅以对学习进展和AI交互模式的结构化反思分析。主题分析表明,智能AI通过提供概述、结构和指导来降低初始进入门槛,从而降低早期参与期间的认知工作量。定量地,观察到的对策略的广泛探索和低策略执行时间可能促进了元策略层面的网络安全培训。同时,AI辅助的网络安全教育也带来了与信任、依赖和负责任使用相关的新挑战。我们讨论了以人为本的AI支持的网络安全教育的意义,并概述了未来研究的开放性问题。

🔬 方法详解

问题定义:论文旨在解决新手参与网络安全夺旗竞赛(CTF)时面临的门槛过高的问题。现有的CTF学习方式通常需要掌握复杂的工具链和理解不透明的工作流程,这使得缺乏经验的学习者难以入门,导致学习曲线陡峭。

核心思路:论文的核心思路是利用智能AI框架(Cybersecurity AI,CAI)来自动化和协调渗透测试任务,从而降低新手参与CTF的认知负担和技术门槛。通过AI的辅助,新手可以更容易地理解CTF的流程、探索不同的攻击策略,并更快地获得实践经验。

技术框架:该研究采用以人为本的混合方法,包括定量性能指标和定性反思分析。具体流程如下:1) 选择一位没有黑客经验的本科生作为研究对象;2) 使用CAI框架参与国家网络安全挑战赛;3) 收集定量数据,如完成任务的时间、尝试的策略数量等;4) 进行结构化的反思分析,记录学习过程中的观察、感受和遇到的问题;5) 对收集到的数据进行主题分析,识别CAI在新手学习中的作用和影响。

关键创新:该研究的关键创新在于探索了智能AI框架在网络安全教育中的应用,并从以人为本的角度评估了AI对新手学习的影响。与以往的研究不同,该研究不仅关注AI的性能,更关注AI如何影响学习者的认知过程、学习体验和学习效果。

关键设计:研究中使用的CAI框架的具体技术细节未知,论文侧重于从教育学角度分析AI辅助学习的效果。研究设计包括选择合适的CTF挑战赛、设计结构化的反思分析框架、以及采用混合方法进行数据收集和分析。没有提供关于CAI框架内部参数设置、损失函数或网络结构的具体信息。

🖼️ 关键图片

📊 实验亮点

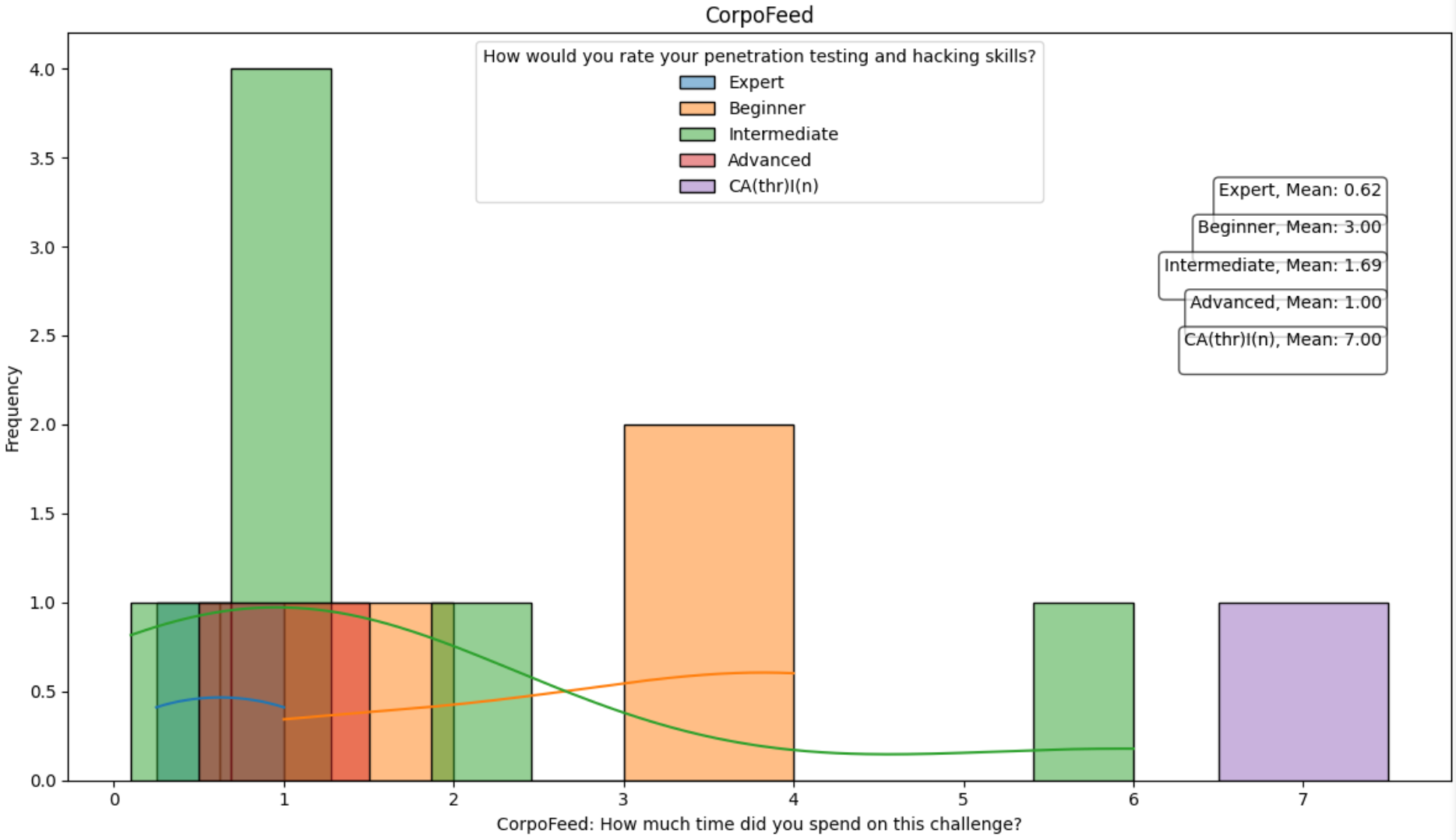

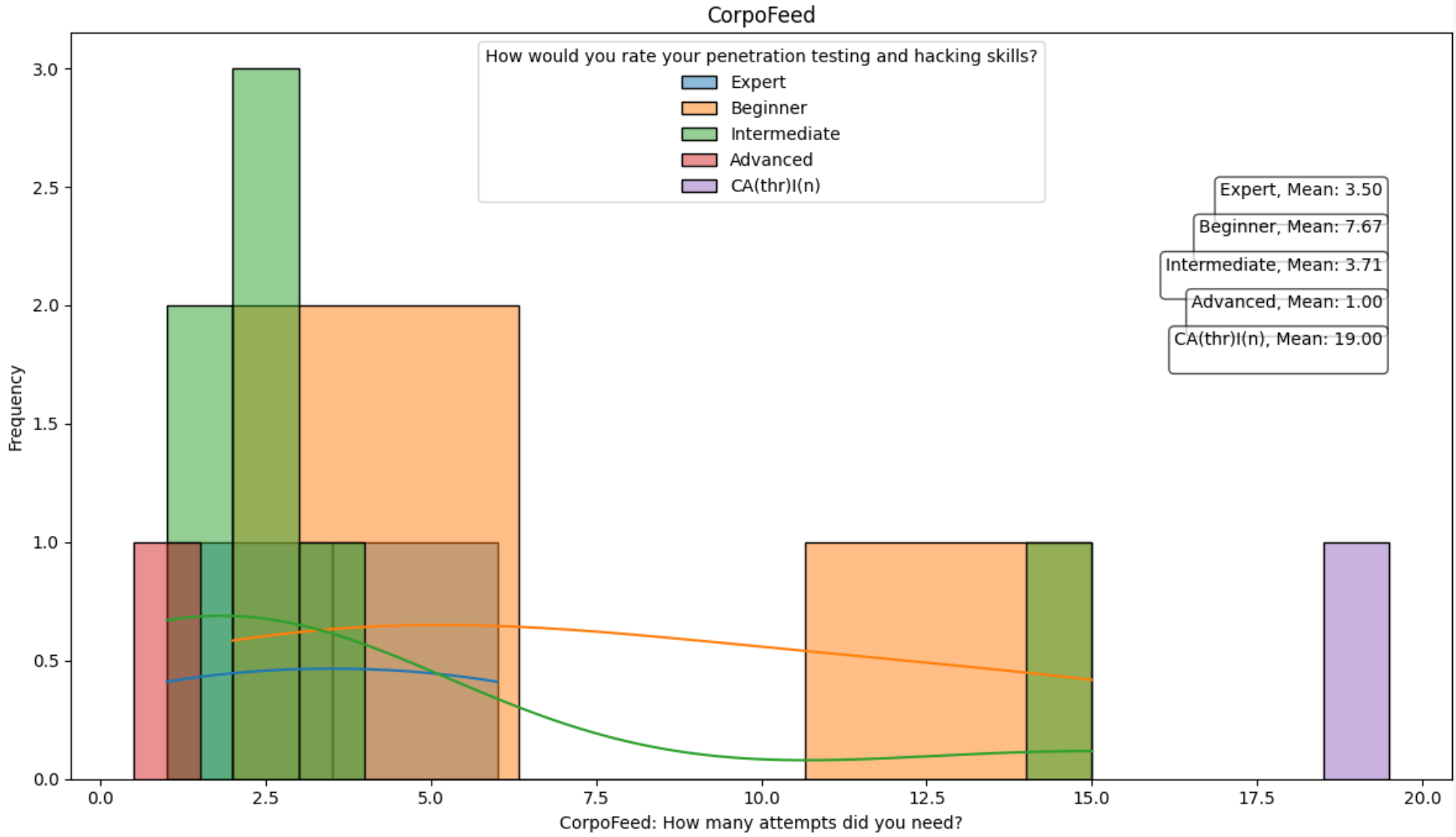

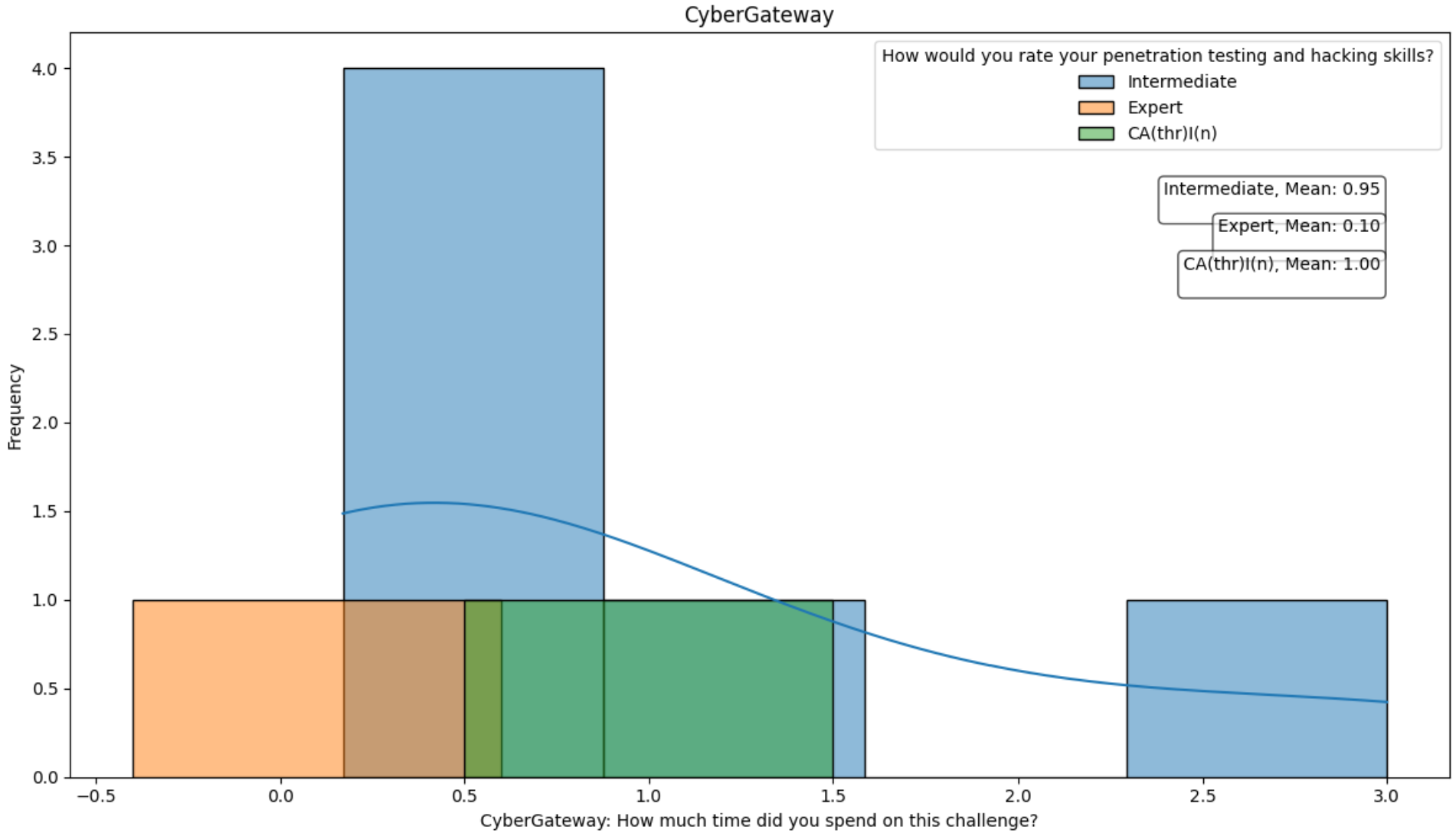

研究表明,使用CAI框架可以显著降低新手参与CTF的初始门槛,并促进其对不同攻击策略的探索。定量数据表明,新手在使用CAI后,能够更快地尝试不同的策略,从而在战略层面进行更有效的学习。此外,定性分析也揭示了AI在提供概述、结构和指导方面的积极作用。

🎯 应用场景

该研究成果可应用于网络安全教育和培训领域,通过AI辅助工具降低学习门槛,提高学习效率。此外,该研究也为开发更智能、更人性化的网络安全工具提供了参考,有助于提升整体网络安全水平。未来,可以将该方法推广到其他网络安全技能的学习中,例如漏洞分析、恶意代码分析等。

📄 摘要(原文)

Capture-the-Flag (CTF) competitions serve as gateways into offensive cybersecurity, yet they often present steep barriers for novices due to complex toolchains and opaque workflows. Recently, agentic AI frameworks for cybersecurity promise to lower these barriers by automating and coordinating penetration testing tasks. However, their role in shaping novice learning remains underexplored. We present a human-centered, mixed-methods case study examining how agentic AI frameworks -- here Cybersecurity AI (CAI) -- mediates novice entry into CTF-based penetration testing. An undergraduate student without prior hacking experience attempted to approach performance benchmarks from a national cybersecurity challenge using CAI. Quantitative performance metrics were complemented by structured reflective analysis of learning progression and AI interaction patterns. Our thematic analysis suggest that agentic AI reduces initial entry barriers by providing overview, structure and guidance, thereby lowering the cognitive workload during early engagement. Quantitatively, the observed extensive exploration of strategies and low per-strategy execution time potetially facilitatates cybersecurity training on meta, i.e. strategic levels. At the same time, AI-assisted cybersecurity education introduces new challenges related to trust, dependency, and responsible use. We discuss implications for human-centered AI-supported cybersecurity education and outline open questions for future research.