Cross-Embodiment Offline Reinforcement Learning for Heterogeneous Robot Datasets

作者: Haruki Abe, Takayuki Osa, Yusuke Mukuta, Tatsuya Harada

分类: cs.AI, cs.RO

发布日期: 2026-02-20

备注: ICLR 2026

💡 一句话要点

提出基于离线强化学习的跨具身机器人数据集预训练方法,解决异构机器人数据利用问题。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture) 支柱七:动作重定向 (Motion Retargeting)

关键词: 离线强化学习 跨具身学习 机器人预训练 异构数据 具身智能

📋 核心要点

- 现有机器人策略预训练方法依赖于为每个平台收集高质量数据,成本高昂,限制了其可扩展性。

- 该论文提出结合离线强化学习和跨具身学习,利用异构机器人数据和次优轨迹进行通用控制先验的预训练。

- 实验表明,该方法在包含大量次优轨迹的数据集上优于行为克隆,并提出基于具身的分组策略缓解冲突梯度问题。

📝 摘要(中文)

可扩展的机器人策略预训练一直受到为每个平台收集高质量演示数据的高成本的阻碍。本研究通过将离线强化学习(offline RL)与跨具身学习相结合来解决这个问题。离线强化学习利用专家数据和大量次优数据,而跨具身学习聚合来自不同形态的异构机器人轨迹,以获得通用的控制先验。我们对这种离线强化学习和跨具身范式进行了系统分析,对其优势和局限性提供了有原则的理解。为了评估这种范式,我们构建了一个包含16个不同机器人平台的运动数据集。实验证实,这种组合方法擅长使用富含次优轨迹的数据集进行预训练,优于纯行为克隆。然而,随着次优数据比例和机器人类型数量的增加,我们观察到不同形态之间的冲突梯度开始阻碍学习。为了缓解这个问题,我们引入了一种基于具身的分组策略,其中机器人按形态相似性进行聚类,并且模型使用组梯度进行更新。这种简单的静态分组显着减少了机器人间的冲突,并且优于现有的冲突解决办法。

🔬 方法详解

问题定义:现有机器人策略预训练方法需要为每个机器人平台单独收集高质量的专家数据,成本高昂且难以扩展。直接使用异构机器人数据进行训练会导致不同机器人之间的策略冲突,影响学习效果。因此,如何有效利用异构机器人数据,特别是包含大量次优轨迹的数据,进行通用策略预训练是一个关键问题。

核心思路:该论文的核心思路是将离线强化学习与跨具身学习相结合。离线强化学习能够利用包含次优轨迹的数据进行学习,而跨具身学习则可以将不同形态的机器人数据进行聚合,从而学习通用的控制先验。通过这种方式,可以克服数据收集成本高昂的问题,并提高策略的泛化能力。

技术框架:整体框架包含数据收集、离线强化学习和跨具身学习三个主要部分。首先,收集来自不同机器人平台的运动轨迹数据,包括专家数据和次优数据。然后,使用离线强化学习算法(具体算法未明确说明,但暗示可以使用常见的离线RL算法)对这些数据进行训练,学习通用的控制策略。在训练过程中,利用跨具身学习的思想,将不同机器人的数据进行混合,从而提高策略的泛化能力。为了解决不同机器人之间策略冲突的问题,提出了基于具身的分组策略。

关键创新:该论文的关键创新在于提出了基于具身的分组策略,用于缓解不同机器人之间策略冲突的问题。该策略将形态相似的机器人进行分组,然后使用组梯度进行模型更新。这种方法可以有效地减少机器人间的冲突,并提高学习效果。此外,将离线强化学习与跨具身学习相结合也是一个创新点,可以有效地利用异构机器人数据进行通用策略预训练。

关键设计:基于具身的分组策略是关键设计。具体来说,首先根据机器人的形态相似性进行聚类,然后将每个簇内的机器人视为一个组。在模型更新时,计算每个组的梯度,然后使用这些组梯度来更新模型参数。这种方法可以有效地减少不同机器人之间的策略冲突。论文中没有明确说明具体的聚类算法和梯度计算方法,但暗示可以使用常见的聚类算法和梯度下降算法。

🖼️ 关键图片

📊 实验亮点

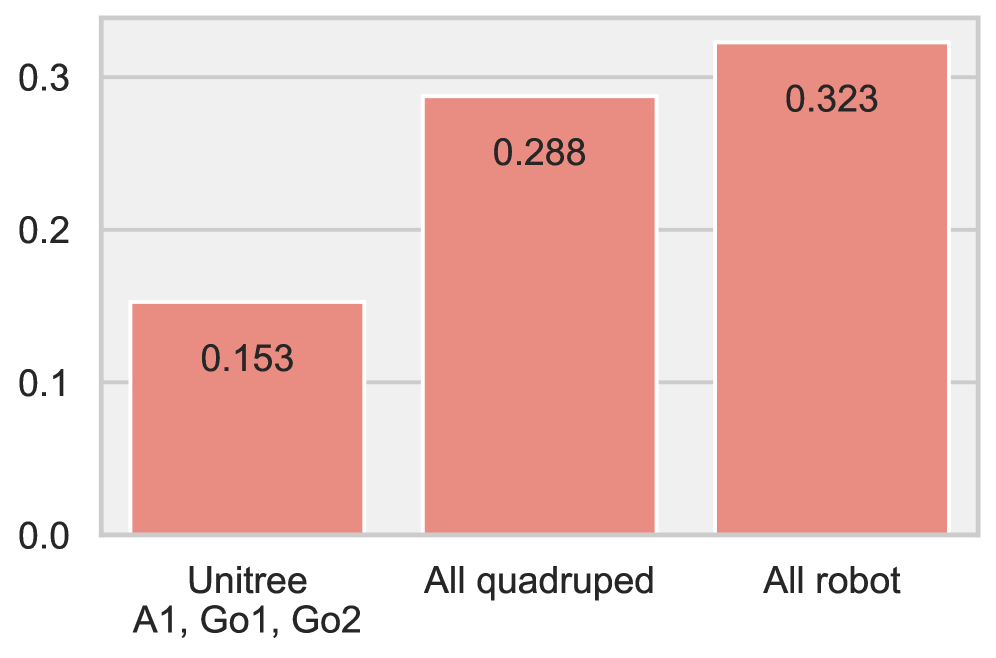

实验结果表明,该方法在包含大量次优轨迹的数据集上优于纯行为克隆。此外,基于具身的分组策略可以有效地减少机器人间的冲突,并提高学习效果。具体性能数据和对比基线未在摘要中明确给出,但强调了优于现有冲突解决办法。

🎯 应用场景

该研究成果可应用于机器人通用控制策略的预训练,降低新机器人平台的开发成本,加速机器人智能化进程。例如,在工业机器人、服务机器人、移动机器人等领域,可以利用该方法预训练通用的运动控制策略,然后针对特定任务进行微调,从而快速部署新的机器人应用。

📄 摘要(原文)

Scalable robot policy pre-training has been hindered by the high cost of collecting high-quality demonstrations for each platform. In this study, we address this issue by uniting offline reinforcement learning (offline RL) with cross-embodiment learning. Offline RL leverages both expert and abundant suboptimal data, and cross-embodiment learning aggregates heterogeneous robot trajectories across diverse morphologies to acquire universal control priors. We perform a systematic analysis of this offline RL and cross-embodiment paradigm, providing a principled understanding of its strengths and limitations. To evaluate this offline RL and cross-embodiment paradigm, we construct a suite of locomotion datasets spanning 16 distinct robot platforms. Our experiments confirm that this combined approach excels at pre-training with datasets rich in suboptimal trajectories, outperforming pure behavior cloning. However, as the proportion of suboptimal data and the number of robot types increase, we observe that conflicting gradients across morphologies begin to impede learning. To mitigate this, we introduce an embodiment-based grouping strategy in which robots are clustered by morphological similarity and the model is updated with a group gradient. This simple, static grouping substantially reduces inter-robot conflicts and outperforms existing conflict-resolution methods.