Systematic Evaluation of Single-Cell Foundation Model Interpretability Reveals Attention Captures Co-Expression Rather Than Unique Regulatory Signal

作者: Ihor Kendiukhov

分类: q-bio.GN, cs.AI

发布日期: 2026-02-19

💡 一句话要点

系统性评估单细胞Foundation模型可解释性,揭示Attention机制捕获共表达而非独特调控信号

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 单细胞基因组学 Foundation模型 可解释性 Attention机制 基因调控网络

📋 核心要点

- 单细胞Foundation模型的可解释性不足,难以理解其内部机制,阻碍了其在生物学研究中的应用。

- 提出一个系统性的评估框架,通过多种分析和统计测试,深入评估scGPT和Geneformer等模型的Attention机制。

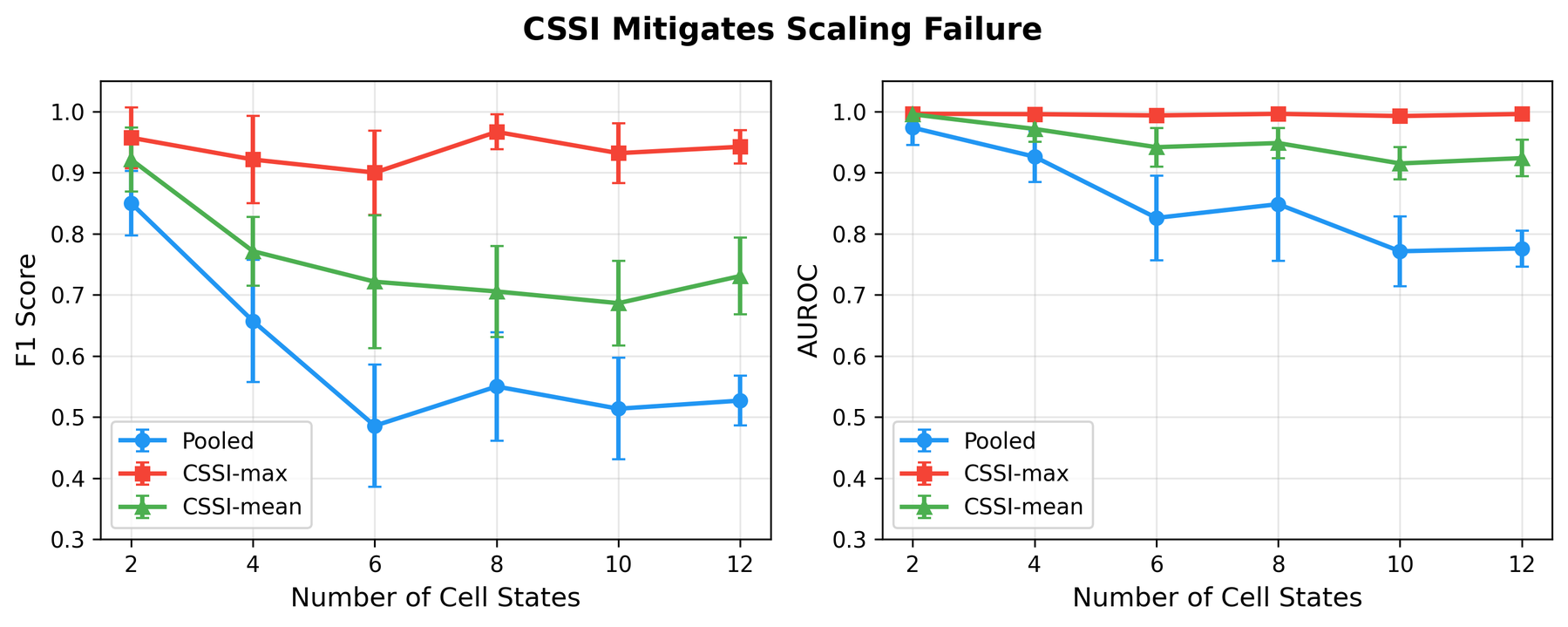

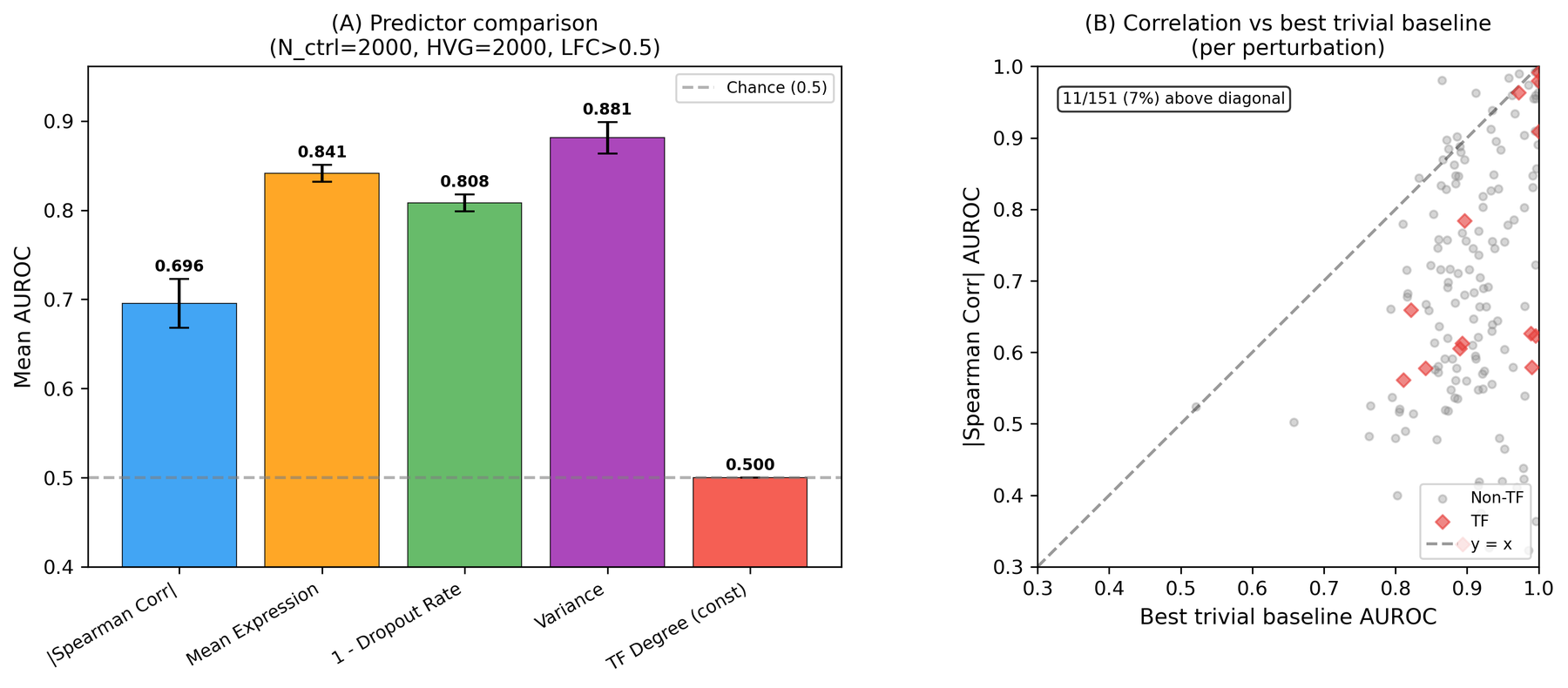

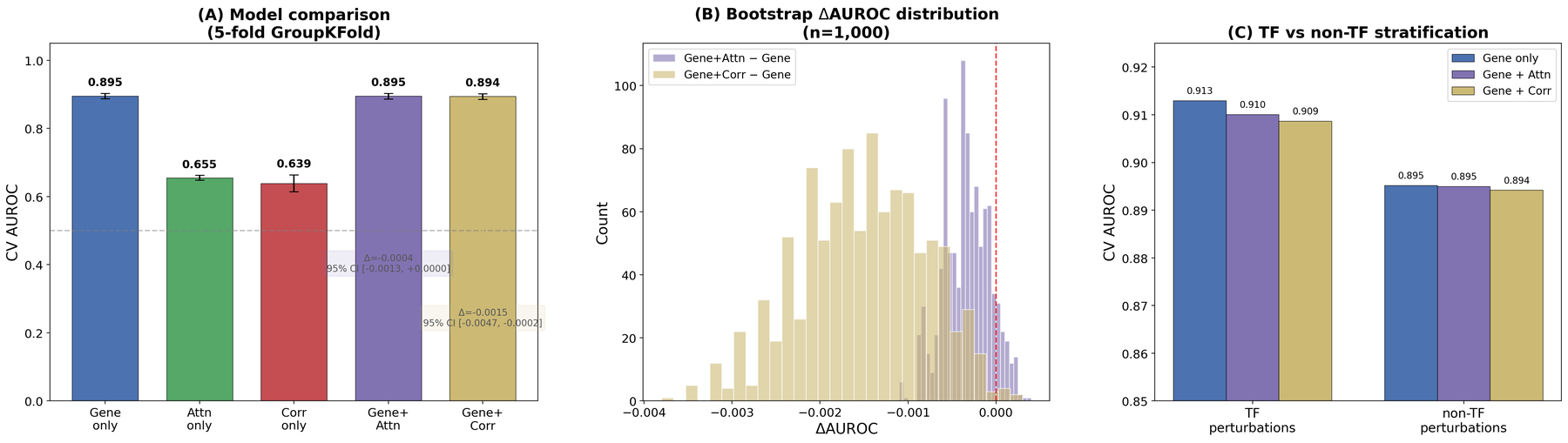

- 实验表明,Attention模式主要捕获基因共表达信息,而非独特的调控信号,并提出了CSSI来改善GRN恢复。

📝 摘要(中文)

本文提出一个系统性的评估框架,包含37项分析、153个统计测试、四种细胞类型和两种扰动模式,用于评估单细胞Foundation模型中的机制可解释性。将此框架应用于scGPT和Geneformer,发现Attention模式编码了具有层特异性组织的结构化生物学信息——早期层中的蛋白质-蛋白质相互作用,后期层中的转录调控。然而,这种结构并没有为扰动预测提供增量价值:简单的基因水平基线优于Attention和相关性边(AUROC 0.81-0.88 vs 0.70),成对边得分没有增加预测贡献,并且对调控头的因果消融没有产生性能下降。这些发现从K562推广到RPE1细胞;Attention-相关性关系是上下文相关的,但基因水平的优势是普遍的。细胞状态分层可解释性(CSSI)解决了Attention机制特定的缩放失败问题,将GRN恢复率提高了1.85倍。该框架为该领域建立了可重用的质量控制标准。

🔬 方法详解

问题定义:现有单细胞Foundation模型,如scGPT和Geneformer,虽然在单细胞数据分析任务中表现出色,但其内部机制缺乏深入理解。特别是,Attention机制被认为是模型学习生物学知识的关键,但其具体捕获了哪些生物学信号,以及这些信号对下游任务的贡献尚不明确。现有方法难以区分Attention机制捕获的共表达关系和真正的基因调控关系,阻碍了模型在生物学研究中的应用。

核心思路:本文的核心思路是通过构建一个系统性的评估框架,对单细胞Foundation模型中的Attention机制进行多方面的分析和测试。该框架旨在量化Attention模式捕获的生物学信息,并评估这些信息对扰动预测等下游任务的贡献。通过比较Attention机制与简单基线的性能,以及对Attention头的因果消融实验,揭示Attention机制的真实作用。

技术框架:该评估框架包含以下主要组成部分: 1. 数据集:使用多种细胞类型(如K562和RPE1)和扰动模式的数据集。 2. 分析方法:包括37项分析和153个统计测试,涵盖Attention模式的结构、与生物学信息的关联、以及对下游任务的贡献。 3. 模型:评估scGPT和Geneformer等单细胞Foundation模型。 4. 基线:使用简单的基因水平基线作为对比,评估Attention机制的增量价值。 5. 评估指标:使用AUROC等指标评估扰动预测性能,使用GRN恢复率评估基因调控网络重建性能。

关键创新:该研究的关键创新在于: 1. 系统性的评估框架:提供了一个全面的评估单细胞Foundation模型可解释性的方法,可以作为该领域的质量控制标准。 2. 揭示Attention机制的局限性:发现Attention机制主要捕获基因共表达信息,而非独特的调控信号。 3. 提出CSSI:通过细胞状态分层,解决了Attention机制特定的缩放失败问题,提高了GRN恢复率。

关键设计: 1. Attention-相关性比较:比较Attention权重和基因共表达相关性,评估Attention机制捕获的生物学信息。 2. 因果消融实验:通过移除特定的Attention头,评估其对扰动预测性能的影响。 3. 细胞状态分层:根据细胞状态对Attention权重进行分层,解决Attention机制的缩放失败问题。 4. 基因水平基线:使用简单的基因水平基线作为对比,评估Attention机制的增量价值。

🖼️ 关键图片

📊 实验亮点

实验结果表明,简单的基因水平基线在扰动预测任务中优于Attention和相关性边(AUROC 0.81-0.88 vs 0.70)。对调控头的因果消融实验没有产生性能下降。细胞状态分层可解释性(CSSI)解决了Attention机制特定的缩放失败问题,将GRN恢复率提高了1.85倍。这些结果表明,Attention机制主要捕获基因共表达信息,而非独特的调控信号。

🎯 应用场景

该研究成果可应用于单细胞基因组学领域,帮助研究人员更好地理解单细胞Foundation模型的内部机制,并指导模型的改进和应用。通过该研究提出的评估框架,可以系统性地评估不同模型的可解释性,并为模型的设计提供指导。此外,该研究揭示的Attention机制的局限性,可以帮助研究人员开发更有效的模型,以捕获更准确的基因调控信息,从而促进药物发现和疾病诊断等应用。

📄 摘要(原文)

We present a systematic evaluation framework - thirty-seven analyses, 153 statistical tests, four cell types, two perturbation modalities - for assessing mechanistic interpretability in single-cell foundation models. Applying this framework to scGPT and Geneformer, we find that attention patterns encode structured biological information with layer-specific organisation - protein-protein interactions in early layers, transcriptional regulation in late layers - but this structure provides no incremental value for perturbation prediction: trivial gene-level baselines outperform both attention and correlation edges (AUROC 0.81-0.88 versus 0.70), pairwise edge scores add zero predictive contribution, and causal ablation of regulatory heads produces no degradation. These findings generalise from K562 to RPE1 cells; the attention-correlation relationship is context-dependent, but gene-level dominance is universal. Cell-State Stratified Interpretability (CSSI) addresses an attention-specific scaling failure, improving GRN recovery up to 1.85x. The framework establishes reusable quality-control standards for the field.