A Privacy by Design Framework for Large Language Model-Based Applications for Children

作者: Diana Addae, Diana Rogachova, Nafiseh Kahani, Masoud Barati, Michael Christensen, Chen Zhou

分类: cs.AI

发布日期: 2026-02-19

💡 一句话要点

提出面向儿童的LLM应用隐私保护框架,遵循PbD原则与多项法规

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐私设计 大型语言模型 儿童隐私保护 AI伦理 数据安全

📋 核心要点

- 现有AI应用,尤其是面向儿童的应用,面临日益增长的隐私风险,但实践中隐私保护措施的实施充满挑战。

- 论文提出基于“隐私设计”(PbD)的框架,指导开发者在LLM应用的各个阶段主动规避隐私风险,并符合相关法规。

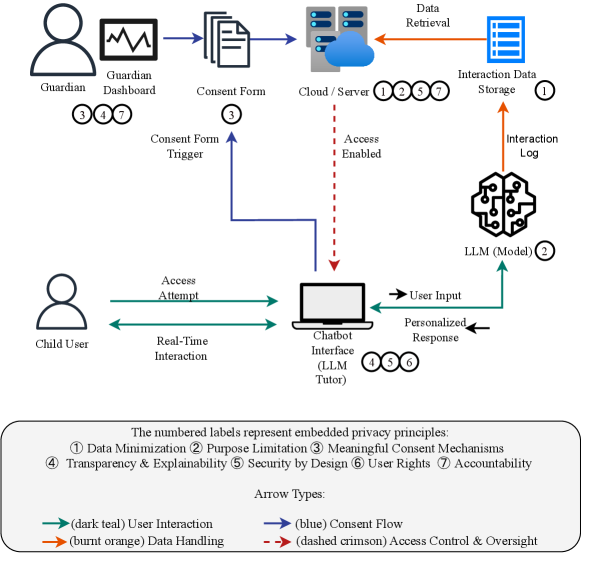

- 通过案例研究,展示了该框架在LLM教育辅导应用中的有效性,证明了其在隐私保护和合规方面的潜力。

📝 摘要(中文)

儿童越来越多地使用人工智能(AI)技术。然而,人们越来越关注隐私风险,特别是对儿童而言。尽管现有的隐私法规要求公司和组织实施保护措施,但在实践中可能具有挑战性。为了应对这一挑战,本文提出了一个基于“隐私设计”(PbD)的框架,该框架指导设计者和开发者采取积极主动和规避风险的技术设计方法。我们的框架包括来自多项隐私法规的原则,例如欧盟的《通用数据保护条例》(GDPR)、加拿大的《个人信息保护和电子文件法》(PIPEDA)以及美国的《儿童在线隐私保护法》(COPPA)。我们将这些原则映射到使用大型语言模型(LLM)的应用程序的各个阶段,包括数据收集、模型训练、运营监控和持续验证。对于每个阶段,我们讨论了近期学术文献中发现的运营控制,以帮助AI服务提供商和开发人员在满足法律标准的同时降低隐私风险。此外,该框架还包括针对儿童的设计指南,借鉴了《联合国儿童权利公约》(UNCRC)、英国的《年龄适当设计规范》(AADC)和近期的学术研究。为了演示如何在实践中应用该框架,我们提出了一个针对13岁以下儿童的基于LLM的教育辅导案例研究。通过我们的分析和案例研究,我们表明,通过在LLM生命周期中使用技术和组织控制等数据保护策略,并在整个过程中做出适合年龄的设计决策,我们可以支持开发为儿童提供隐私保护并符合法律要求的AI应用程序。

🔬 方法详解

问题定义:当前面向儿童的AI应用,特别是基于大型语言模型(LLM)的应用,在数据收集、模型训练、运营监控等环节存在严重的隐私泄露风险。现有的隐私法规(如GDPR、COPPA等)虽然提出了保护要求,但在实际应用中,开发者往往缺乏明确的指导和可操作的方案,难以有效实施隐私保护措施。

核心思路:论文的核心思路是采用“隐私设计”(Privacy by Design, PbD)原则,将隐私保护融入到LLM应用开发的整个生命周期中。通过前瞻性的风险评估和主动的隐私保护措施,从源头上减少隐私泄露的可能性。这种方法强调预防而非补救,旨在构建默认保护隐私的AI系统。

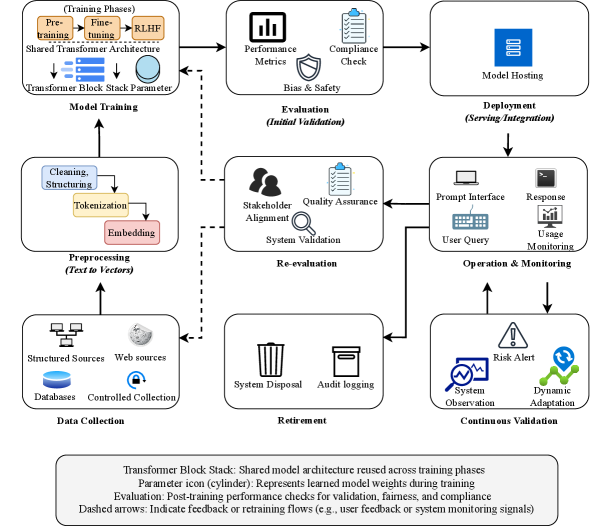

技术框架:该框架包含以下主要阶段:1) 数据收集:明确数据收集的目的和范围,最小化收集的数据量,并获得必要的同意。2) 模型训练:采用差分隐私、联邦学习等技术,保护训练数据的隐私。3) 运营监控:持续监控系统的隐私风险,及时发现和处理潜在的隐私泄露事件。4) 持续验证:定期评估系统的隐私保护效果,并根据新的法规和技术发展进行调整。每个阶段都映射了来自GDPR、COPPA等法规的原则,并提供了相应的技术和组织控制措施。

关键创新:该框架的关键创新在于将PbD原则与具体的LLM应用开发流程相结合,提供了一套可操作的隐私保护指导方案。它不仅关注技术层面的隐私保护措施(如差分隐私),还强调组织层面的管理和控制(如数据访问权限管理)。此外,该框架还考虑了儿童的特殊需求,借鉴了UNCRC、AADC等儿童权益保护相关的规范。

关键设计:框架的关键设计包括:1) 数据最小化原则:只收集必要的数据,并尽快删除不再需要的数据。2) 差分隐私训练:在模型训练过程中添加噪声,防止模型泄露训练数据的敏感信息。3) 透明度设计:向用户(特别是儿童)清晰地解释数据的使用方式和隐私保护措施。4) 年龄适当性设计:根据儿童的年龄和认知能力,设计易于理解和使用的隐私设置。

🖼️ 关键图片

📊 实验亮点

论文通过一个基于LLM的儿童教育辅导案例研究,验证了该框架的有效性。该案例研究表明,通过应用该框架中的数据保护策略和年龄适当的设计决策,可以显著降低隐私风险,并满足GDPR、COPPA等法规的要求。虽然论文没有提供具体的性能数据,但案例研究的结果表明,该框架具有很强的实用性和可操作性。

🎯 应用场景

该研究成果可广泛应用于面向儿童的AI教育、娱乐、健康等领域。例如,智能玩具、在线学习平台、儿童健康监测应用等。通过应用该框架,可以有效降低这些应用中的隐私风险,保护儿童的个人信息安全,促进AI技术在儿童领域的健康发展。该框架还有助于企业遵守相关的隐私法规,提升用户信任度。

📄 摘要(原文)

Children are increasingly using technologies powered by Artificial Intelligence (AI). However, there are growing concerns about privacy risks, particularly for children. Although existing privacy regulations require companies and organizations to implement protections, doing so can be challenging in practice. To address this challenge, this article proposes a framework based on Privacy-by-Design (PbD), which guides designers and developers to take on a proactive and risk-averse approach to technology design. Our framework includes principles from several privacy regulations, such as the General Data Protection Regulation (GDPR) from the European Union, the Personal Information Protection and Electronic Documents Act (PIPEDA) from Canada, and the Children's Online Privacy Protection Act (COPPA) from the United States. We map these principles to various stages of applications that use Large Language Models (LLMs), including data collection, model training, operational monitoring, and ongoing validation. For each stage, we discuss the operational controls found in the recent academic literature to help AI service providers and developers reduce privacy risks while meeting legal standards. In addition, the framework includes design guidelines for children, drawing from the United Nations Convention on the Rights of the Child (UNCRC), the UK's Age-Appropriate Design Code (AADC), and recent academic research. To demonstrate how this framework can be applied in practice, we present a case study of an LLM-based educational tutor for children under 13. Through our analysis and the case study, we show that by using data protection strategies such as technical and organizational controls and making age-appropriate design decisions throughout the LLM life cycle, we can support the development of AI applications for children that provide privacy protections and comply with legal requirements.