Decoding the Human Factor: High Fidelity Behavioral Prediction for Strategic Foresight

作者: Ben Yellin, Ehud Ezra, Mark Foreman, Shula Grinapol

分类: cs.AI

发布日期: 2026-02-19

💡 一句话要点

提出LBM,通过行为嵌入实现高保真个体行为预测,应用于战略预判。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 行为预测 大型语言模型 心理特征 行为嵌入 战略决策 个体建模 情境感知

📋 核心要点

- 现有LLM在预测个体特定行为时存在局限,尤其是在复杂心理因素影响下,提示方法易失效。

- LBM通过将心理特征嵌入模型,而非依赖瞬时提示,从而实现对个体战略选择的高保真预测。

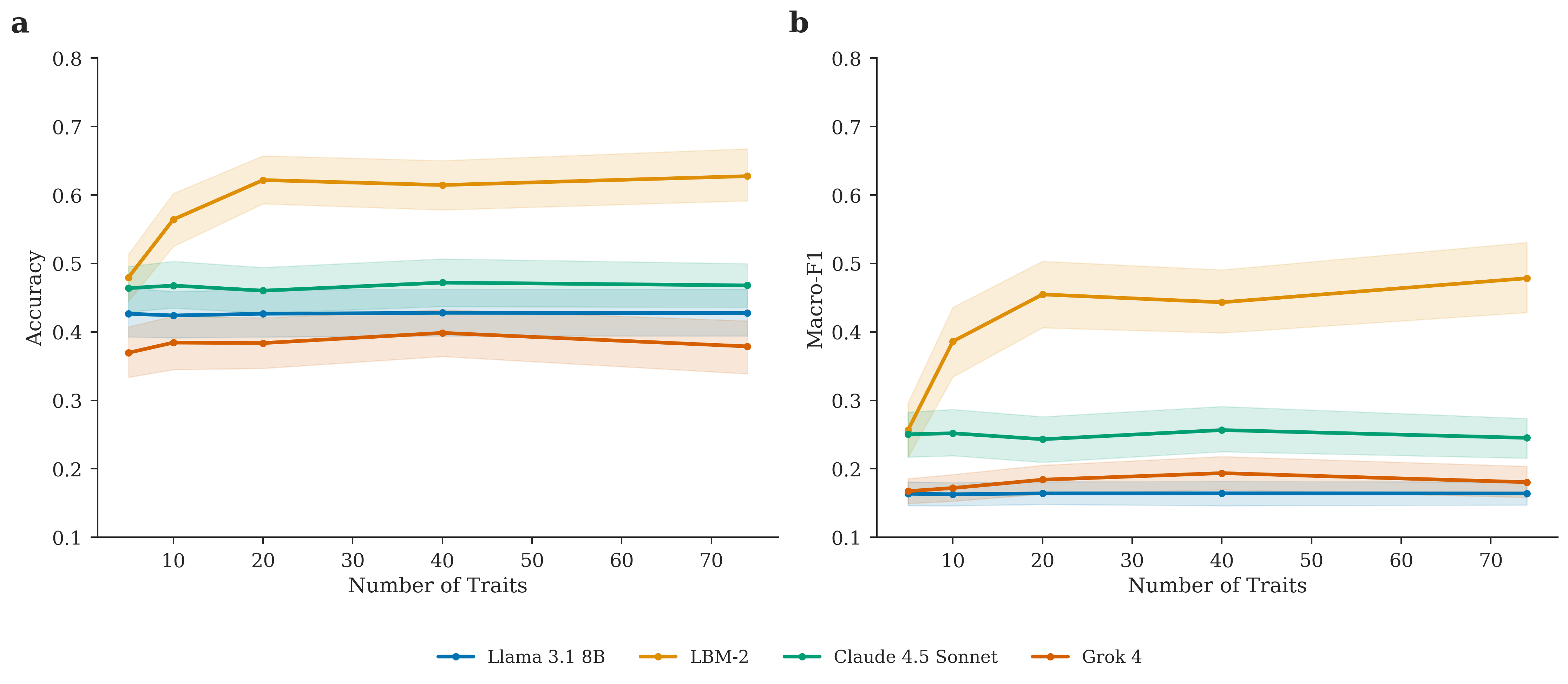

- 实验表明,LBM优于未适配的LLM,且能持续受益于更丰富的特征信息,提升预测精度。

📝 摘要(中文)

预测高风险环境中人类决策是人工智能的核心挑战。大型语言模型(LLM)虽然展现出强大的通用推理能力,但在生成一致的、个体特定的行为方面表现不佳,尤其是在准确预测依赖于心理特征和情境约束之间的复杂交互时。基于提示的方法在这种情况下显得脆弱,表现出身份漂移和利用日益详细的角色描述的能力有限。为了解决这些局限性,我们引入了大型行为模型(LBM),这是一个经过微调的行为基础模型,旨在高保真地预测个体战略选择。LBM通过调节从综合心理测量电池中提取的结构化、高维特征剖面,从瞬态角色提示转向行为嵌入。LBM在连接稳定性格、动机状态和情境约束与观察到的选择的专有数据集上进行训练,学会将丰富的心理剖面映射到不同战略困境中的离散行为。在留出的情景评估中,相对于未适配的Llama-3.1-8B-Instruct骨干模型,LBM微调改进了行为预测,并且在以大五人格为条件时,性能与前沿基线相当。此外,我们发现,虽然基于提示的基线表现出复杂性上限,但LBM继续受益于日益密集的特征剖面,随着提供额外的特征维度,性能得到提高。总之,这些结果将LBM确立为一种可扩展的高保真行为模拟方法,从而能够在战略预判、谈判分析、认知安全和决策支持等领域中应用。

🔬 方法详解

问题定义:论文旨在解决人工智能在高风险环境中预测个体决策的难题。现有方法,特别是基于大型语言模型(LLM)和提示工程的方法,在捕捉个体差异和复杂心理因素的影响方面存在不足,容易出现“身份漂移”现象,无法有效利用详细的个体特征描述。

核心思路:论文的核心思路是将个体的心理特征(例如性格、动机等)通过高维向量嵌入的方式融入到模型中,从而使模型能够更好地理解和模拟个体的行为模式。这种方法避免了传统提示工程的脆弱性,并允许模型利用更丰富的个体信息。

技术框架:LBM的整体框架包括以下几个主要步骤:1) 使用综合心理测量工具获取个体的高维特征剖面;2) 将这些特征剖面嵌入到模型中,形成个体的行为嵌入;3) 使用包含个体特征、情境约束和实际选择的数据集对模型进行微调;4) 在新的情境下,利用微调后的模型预测个体的战略选择。

关键创新:LBM的关键创新在于将传统的基于提示的方法转变为基于行为嵌入的方法。通过将个体的心理特征嵌入到模型中,LBM能够更好地捕捉个体差异,并利用更丰富的个体信息进行预测。此外,LBM还能够持续受益于更密集的特征剖面,从而提高预测精度。

关键设计:LBM的关键设计包括:1) 使用Llama-3.1-8B-Instruct作为基础模型;2) 设计了一种有效的特征嵌入方法,将高维心理特征映射到低维向量空间;3) 使用专有数据集对模型进行微调,该数据集包含个体特征、情境约束和实际选择等信息;4) 设计了一种评估指标,用于衡量模型预测的准确性和一致性。

🖼️ 关键图片

📊 实验亮点

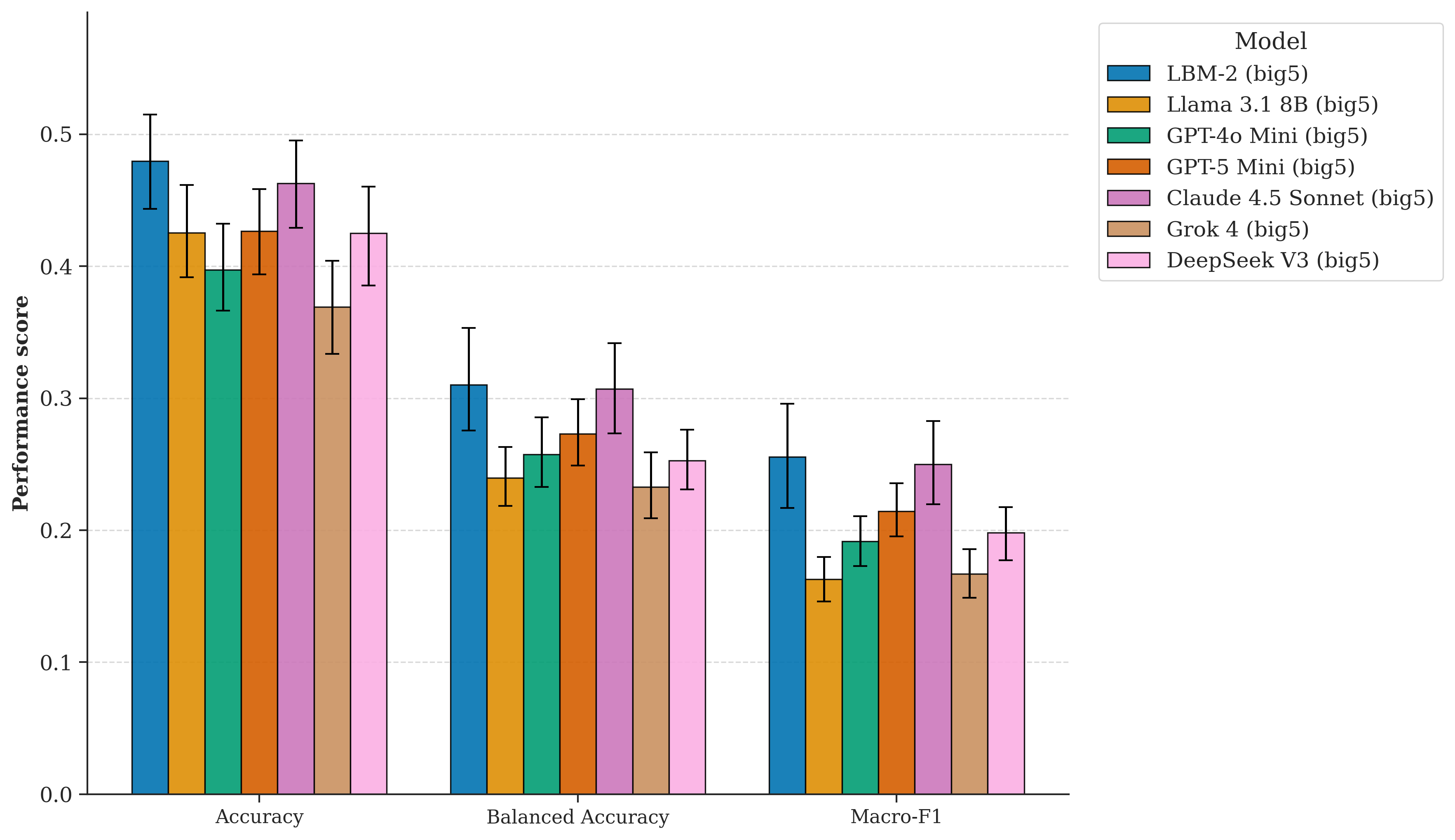

实验结果表明,LBM在行为预测方面优于未适配的Llama-3.1-8B-Instruct模型,并且在以大五人格为条件时,性能与前沿基线相当。更重要的是,LBM能够持续受益于更密集的特征剖面,随着提供额外的特征维度,性能得到提高。这表明LBM具有很强的可扩展性和潜力。

🎯 应用场景

LBM具有广泛的应用前景,包括战略预判、谈判分析、认知安全和决策支持等领域。它可以帮助决策者更好地理解和预测对手或合作者的行为,从而制定更有效的策略。此外,LBM还可以用于评估个体在特定情境下的风险承受能力,以及为个体提供个性化的决策建议。

📄 摘要(原文)

Predicting human decision-making in high-stakes environments remains a central challenge for artificial intelligence. While large language models (LLMs) demonstrate strong general reasoning, they often struggle to generate consistent, individual-specific behavior, particularly when accurate prediction depends on complex interactions between psychological traits and situational constraints. Prompting-based approaches can be brittle in this setting, exhibiting identity drift and limited ability to leverage increasingly detailed persona descriptions. To address these limitations, we introduce the Large Behavioral Model (LBM), a behavioral foundation model fine-tuned to predict individual strategic choices with high fidelity. LBM shifts from transient persona prompting to behavioral embedding by conditioning on a structured, high-dimensional trait profile derived from a comprehensive psychometric battery. Trained on a proprietary dataset linking stable dispositions, motivational states, and situational constraints to observed choices, LBM learns to map rich psychological profiles to discrete actions across diverse strategic dilemmas. In a held-out scenario evaluation, LBM fine-tuning improves behavioral prediction relative to the unadapted Llama-3.1-8B-Instruct backbone and performs comparably to frontier baselines when conditioned on Big Five traits. Moreover, we find that while prompting-based baselines exhibit a complexity ceiling, LBM continues to benefit from increasingly dense trait profiles, with performance improving as additional trait dimensions are provided. Together, these results establish LBM as a scalable approach for high-fidelity behavioral simulation, enabling applications in strategic foresight, negotiation analysis, cognitive security, and decision support.