The Bots of Persuasion: Examining How Conversational Agents' Linguistic Expressions of Personality Affect User Perceptions and Decisions

作者: Uğur Genç, Heng Gu, Chadha Degachi, Evangelos Niforatos, Senthil Chandrasegaran, Himanshu Verma

分类: cs.HC, cs.AI

发布日期: 2026-02-19

备注: Accepted to be presented at CHI'26 in Barcelona

💡 一句话要点

研究对话Agent人格化语言表达对用户感知和决策的影响

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话Agent 人格化 语言表达 用户感知 决策影响

📋 核心要点

- 大型语言模型驱动的对话Agent能够通过语言表达复杂的人格,但这些表达如何影响用户尚不清楚。

- 本文通过操纵对话Agent的语言特征(态度、权威和推理方式)来研究其人格表达对用户感知和决策的影响。

- 实验表明,对话Agent的人格表达会影响用户的感知和情绪反应,进而影响捐赠意愿,揭示了潜在的操纵风险。

📝 摘要(中文)

本文研究了大型语言模型驱动的对话Agent(CA)通过语言表达复杂人格对用户的影响。在一个众包研究中,360名参与者与八个CA中的一个互动,每个CA都表现出由三种语言特征组成的人格:态度(乐观/悲观)、权威(权威型/顺从型)和推理(情感型/理性型)。研究发现,CA的综合人格并未影响参与者的决策,但影响了他们的感知和情绪反应。特别是,与悲观CA互动的参与者情绪状态较低,对慈善事业的亲和力较低,认为CA的信任度和能力较低,但往往会捐赠更多。信任、能力和情境同理心的感知显著预测了捐赠决策。研究结果强调了CA作为操纵工具的风险,它们会微妙地影响用户的感知和决策。

🔬 方法详解

问题定义:现有研究缺乏对对话Agent人格化语言表达如何影响用户感知和决策的深入理解。虽然大型语言模型能够生成具有不同人格特征的文本,但这些人格特征对用户行为的影响机制尚不明确。尤其是在慈善捐赠等场景下,理解这种影响对于避免潜在的操纵风险至关重要。

核心思路:本文的核心思路是通过系统性地操纵对话Agent的语言特征,构建不同人格类型的对话Agent,并观察用户与这些Agent互动后的感知、情绪反应以及捐赠行为。通过这种方式,可以量化不同人格特征对用户的影响,并揭示其内在机制。

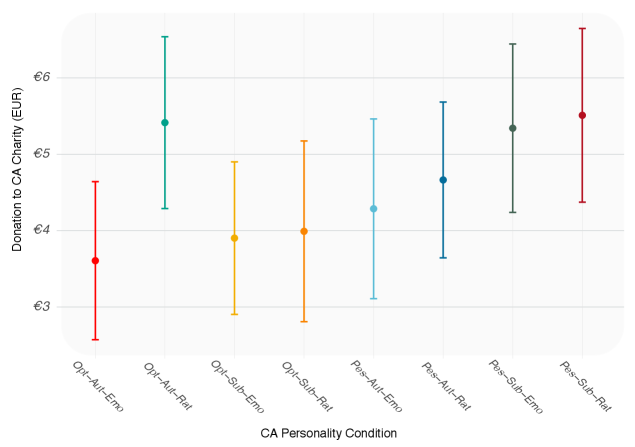

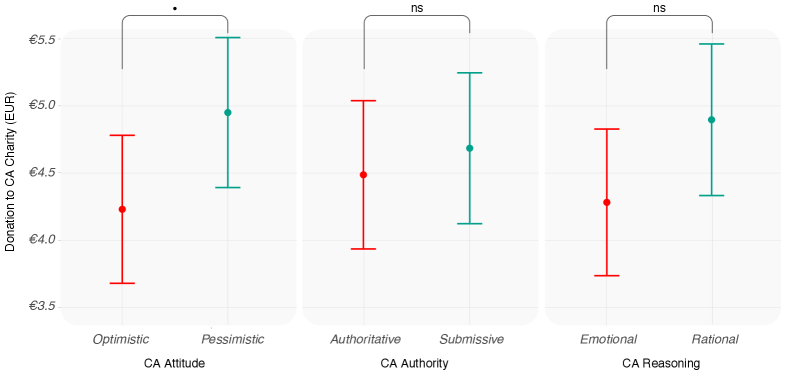

技术框架:研究采用众包实验的方式,招募参与者与预先设计好的对话Agent进行互动。对话Agent的人格由三个维度控制:态度(乐观/悲观)、权威(权威型/顺从型)和推理(情感型/理性型)。每个维度都有两种不同的语言表达方式,通过组合这些维度,可以创建八种不同人格的对话Agent。参与者在与Agent互动后,需要填写问卷,评估他们对Agent的感知(信任度、能力等)、情绪状态以及对慈善事业的亲和力。最后,参与者可以选择是否进行捐赠。

关键创新:本文的创新之处在于系统性地研究了对话Agent人格化语言表达对用户感知和决策的影响。以往的研究主要关注对话Agent的功能性,而忽略了其人格特征对用户行为的潜在影响。本文通过操纵多个语言维度,构建了不同人格类型的对话Agent,并量化了这些人格特征对用户感知和捐赠行为的影响。

关键设计:在语言表达方面,研究人员精心设计了不同维度下的语言模板,例如,乐观的表达方式会使用积极的词汇和语气,而悲观的表达方式则会使用消极的词汇和语气。在数据分析方面,研究人员使用了回归分析等统计方法,分析了人格特征、用户感知、情绪状态和捐赠行为之间的关系。此外,研究人员还使用了中介分析,探讨了用户感知在人格特征和捐赠行为之间的中介作用。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对话Agent的悲观态度会降低用户的信任度和能力感知,但反而会促使用户捐赠更多。信任、能力和情境同理心的感知显著预测了捐赠决策。这些发现揭示了对话Agent人格化语言表达对用户行为的复杂影响,强调了在设计对话系统时需要考虑伦理因素。

🎯 应用场景

该研究成果可应用于多个领域,例如:智能客服、在线教育、心理咨询等。通过理解不同人格特征的对话Agent对用户的影响,可以设计更有效、更具同理心的对话系统。此外,该研究也提醒人们警惕对话Agent可能存在的操纵风险,为相关伦理规范的制定提供参考。

📄 摘要(原文)

Large Language Model-powered conversational agents (CAs) are increasingly capable of projecting sophisticated personalities through language, but how these projections affect users is unclear. We thus examine how CA personalities expressed linguistically affect user decisions and perceptions in the context of charitable giving. In a crowdsourced study, 360 participants interacted with one of eight CAs, each projecting a personality composed of three linguistic aspects: attitude (optimistic/pessimistic), authority (authoritative/submissive), and reasoning (emotional/rational). While the CA's composite personality did not affect participants' decisions, it did affect their perceptions and emotional responses. Particularly, participants interacting with pessimistic CAs felt lower emotional state and lower affinity towards the cause, perceived the CA as less trustworthy and less competent, and yet tended to donate more toward the charity. Perceptions of trust, competence, and situational empathy significantly predicted donation decisions. Our findings emphasize the risks CAs pose as instruments of manipulation, subtly influencing user perceptions and decisions.