How AI Coding Agents Communicate: A Study of Pull Request Description Characteristics and Human Review Responses

作者: Kan Watanabe, Rikuto Tsuchida, Takahiro Monno, Bin Huang, Kazuma Yamasaki, Youmei Fan, Kazumasa Shimari, Kenichi Matsumoto

分类: cs.AI, cs.SE

发布日期: 2026-02-19

💡 一句话要点

研究AI代码生成代理的PR描述特征及人类评审反馈,揭示人机协作软件开发中的交互模式。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI代码生成 Pull Request 人机协作 软件开发 代码评审

📋 核心要点

- 现有研究对AI代码生成代理的PR描述特征及其对人类评审的影响关注不足,阻碍了人机协作软件开发的优化。

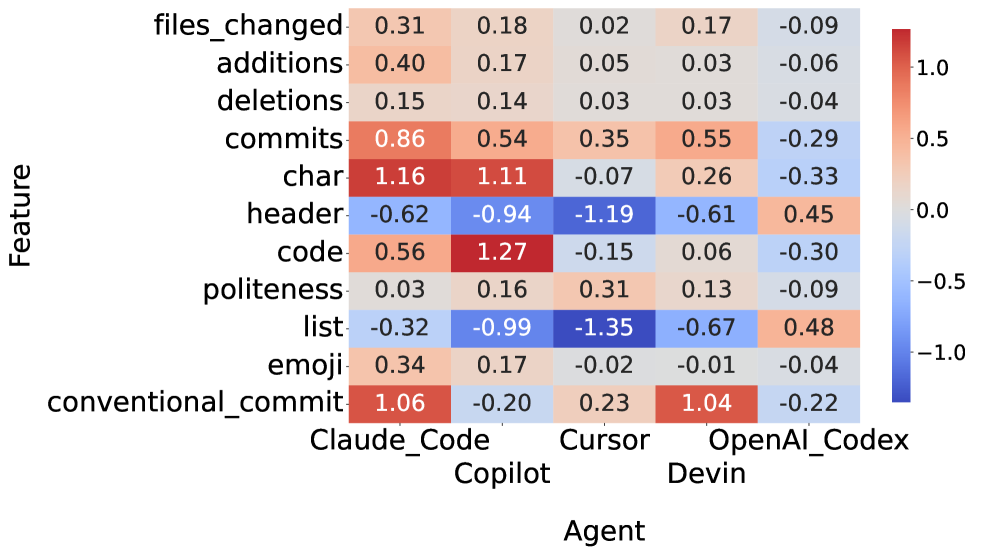

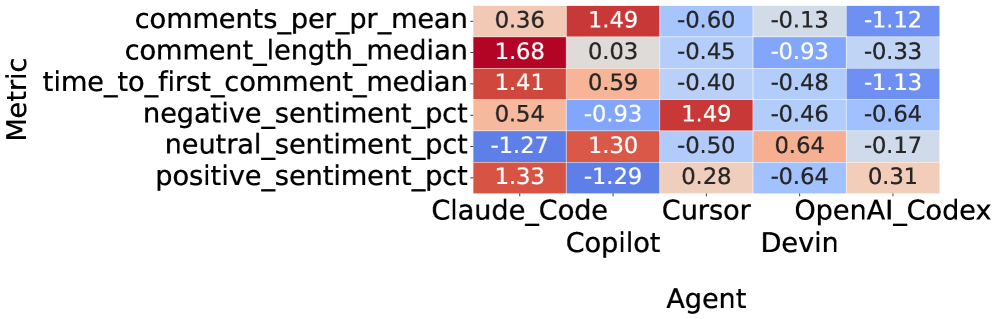

- 本研究分析了五个AI代码生成代理的PR描述特征,并考察了人类评审者的反馈,揭示了不同代理的PR风格差异。

- 实验结果表明,AI代理的PR描述风格与评审者参与度、响应时间和合并结果相关,不同代理的交互指标和合并率存在显著差异。

📝 摘要(中文)

大型语言模型的快速发展催生了能够自主在GitHub上创建pull requests (PR) 的AI代码生成代理。本研究旨在探索这些代理在PR描述特征上的差异,以及人类评审者对它们的反馈。我们使用AIDev数据集,对五个AI代码生成代理创建的PR进行了实证分析,包括结构特征等PR描述特征的差异,以及人类评审者的评审活动、响应时间、情感和合并结果等反馈。研究发现,AI代码生成代理表现出不同的PR描述风格,这与评审者的参与度、响应时间和合并结果的差异相关。我们观察到不同代理在评审者交互指标和合并率方面存在显著差异。这些发现突出了PR呈现方式和评审者交互动态在人机协作软件开发中的作用。

🔬 方法详解

问题定义:本研究旨在解决AI代码生成代理在软件开发中的应用问题,特别是它们生成的Pull Request (PR) 的质量和对人类评审者的影响。现有方法缺乏对不同AI代理PR描述特征的系统性分析,以及对人类评审者反馈的深入理解,导致无法有效评估和优化AI在软件开发中的协作能力。

核心思路:本研究的核心思路是通过实证分析不同AI代码生成代理生成的PR,量化其描述特征,并关联人类评审者的反馈(如评审活动、响应时间、情感和合并结果),从而揭示PR描述风格与人机协作效率之间的关系。通过识别影响评审者行为的关键PR特征,为改进AI代理的PR生成策略提供依据。

技术框架:本研究的技术框架主要包括以下几个阶段:1) 数据收集:使用AIDev数据集,收集由五个AI代码生成代理创建的PR数据。2) 特征提取:提取PR的结构特征(如标题长度、描述长度、代码修改行数等)和内容特征(如关键词、情感倾向等)。3) 人类反馈分析:分析人类评审者的评审活动(如评论数量、评审时间)、响应时间、情感(使用情感分析工具)和合并结果。4) 关联分析:使用统计方法(如回归分析、方差分析)分析PR描述特征与人类反馈之间的关联性,识别显著影响评审者行为的PR特征。

关键创新:本研究的关键创新在于:1) 系统性地分析了不同AI代码生成代理的PR描述特征,揭示了它们在PR风格上的差异。2) 将PR描述特征与人类评审者的反馈联系起来,量化了PR风格对人机协作效率的影响。3) 提出了可用于评估和优化AI代码生成代理PR生成策略的指标体系。

关键设计:本研究的关键设计包括:1) 使用AIDev数据集,保证了数据的可靠性和可比性。2) 提取了全面的PR描述特征,包括结构特征和内容特征,从而能够更全面地评估PR风格。3) 使用多种统计方法进行关联分析,从而能够更准确地识别影响评审者行为的关键PR特征。4) 情感分析工具的选择和参数设置,确保情感分析结果的准确性。

🖼️ 关键图片

📊 实验亮点

研究发现,不同AI代码生成代理的PR描述风格存在显著差异,这些差异与评审者的参与度、响应时间和合并结果密切相关。例如,某些代理生成的PR更容易获得评审者的积极反馈,而另一些代理生成的PR则更容易被拒绝。具体数据(如评审时间缩短百分比、合并率提升百分比)未知,但整体趋势表明,PR描述风格对人机协作效率具有重要影响。

🎯 应用场景

该研究成果可应用于改进AI代码生成代理的PR生成策略,提高人机协作软件开发的效率和质量。通过优化PR描述风格,可以提升评审者的参与度,缩短评审时间,并提高PR的合并率。此外,该研究还可以为开发更智能的AI协作工具提供理论指导,促进人机协同在软件开发领域的广泛应用。

📄 摘要(原文)

The rapid adoption of large language models has led to the emergence of AI coding agents that autonomously create pull requests on GitHub. However, how these agents differ in their pull request description characteristics, and how human reviewers respond to them, remains underexplored. In this study, we conduct an empirical analysis of pull requests created by five AI coding agents using the AIDev dataset. We analyze agent differences in pull request description characteristics, including structural features, and examine human reviewer response in terms of review activity, response timing, sentiment, and merge outcomes. We find that AI coding agents exhibit distinct PR description styles, which are associated with differences in reviewer engagement, response time, and merge outcomes. We observe notable variation across agents in both reviewer interaction metrics and merge rates. These findings highlight the role of pull request presentation and reviewer interaction dynamics in human-AI collaborative software development.