Wink: Recovering from Misbehaviors in Coding Agents

作者: Rahul Nanda, Chandra Maddila, Smriti Jha, Euna Mehnaz Khan, Matteo Paltenghi, Satish Chandra

分类: cs.SE, cs.AI, cs.HC, cs.PL

发布日期: 2026-02-19

💡 一句话要点

Wink:用于自动修复自主编码Agent行为异常的轻量级自干预系统

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自主编码Agent 行为异常修复 自干预系统 大规模部署 LLM 软件工程自动化

📋 核心要点

- 自主编码Agent在软件行业应用日益广泛,但易出现偏离指令、循环卡死、工具调用失败等行为异常。

- Wink通过观察Agent轨迹,异步提供针对性指导,纠正Agent行为,使其重回正轨。

- 在真实Agent轨迹上的评估和A/B测试表明,Wink能有效解决行为异常,减少人工干预和资源消耗。

📝 摘要(中文)

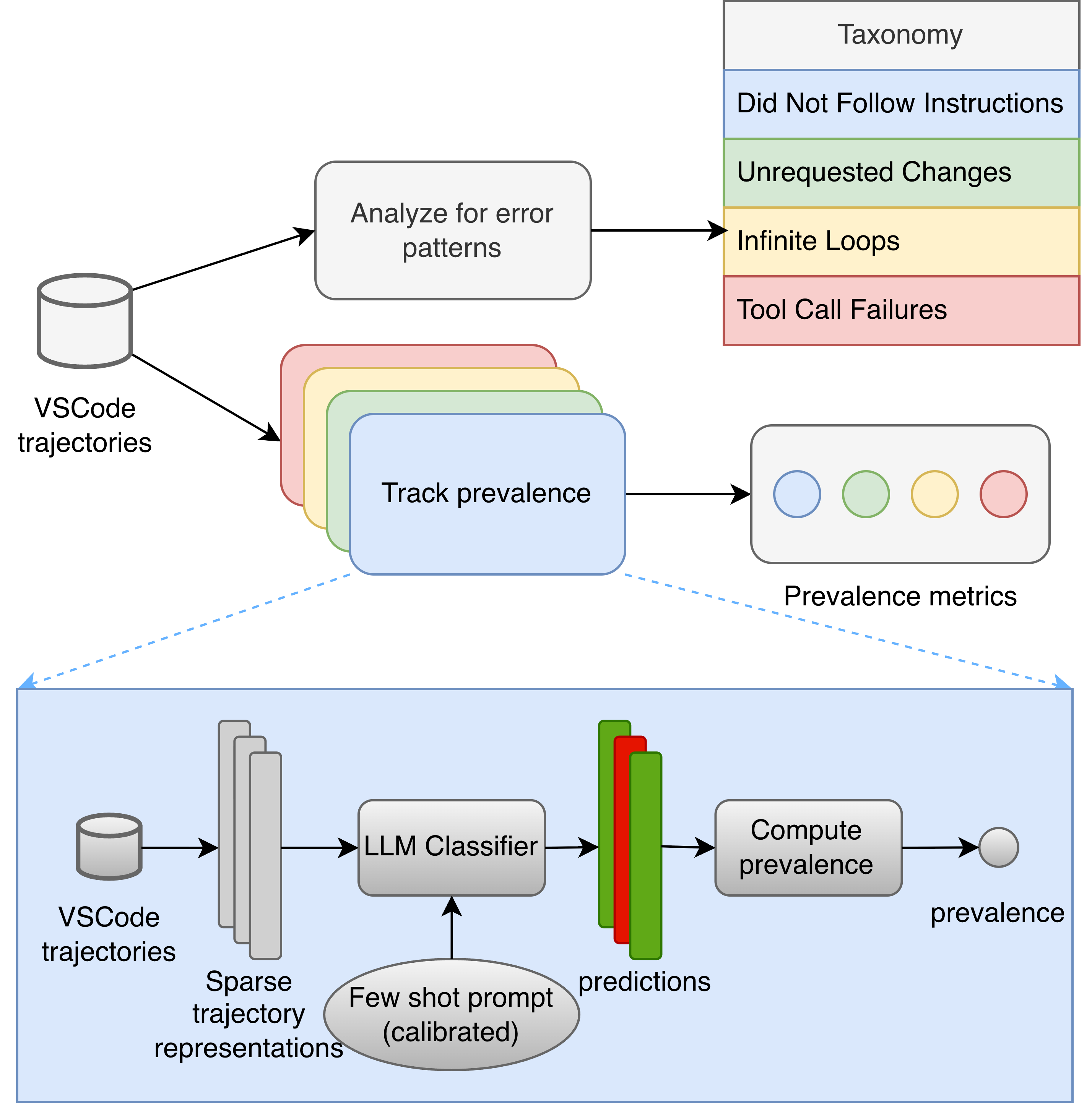

本文提出了一种用于自动修复大规模自主编码Agent行为异常的系统。基于对生产环境数据的分析,作者首先构建了一个行为异常分类体系,识别出三种主要类别:规范漂移、推理问题和工具调用失败,这些问题在约30%的Agent轨迹中出现。为了解决这些问题,作者开发了一个名为Wink的轻量级异步自干预系统。Wink观察Agent轨迹,并提供有针对性的指导,以引导Agent回到正确的轨道。在超过10,000个真实Agent轨迹上的评估表明,Wink成功解决了90%的需要单次干预的行为异常。此外,在生产环境中的A/B测试表明,该系统显著减少了工具调用失败、每次会话的Token数量以及每次会话的工程师干预次数。本文还分享了设计和部署该系统的经验,并提供了构建大规模弹性Agent系统的挑战的见解。

🔬 方法详解

问题定义:自主编码Agent在执行复杂工程任务时,容易出现各种行为异常,例如偏离用户指令(规范漂移)、推理过程出错(推理问题)以及无法正确使用工具(工具调用失败)。这些问题导致开发流程中断,需要耗费大量资源进行人工干预。现有方法缺乏有效的自动修复机制,难以应对大规模Agent部署带来的挑战。

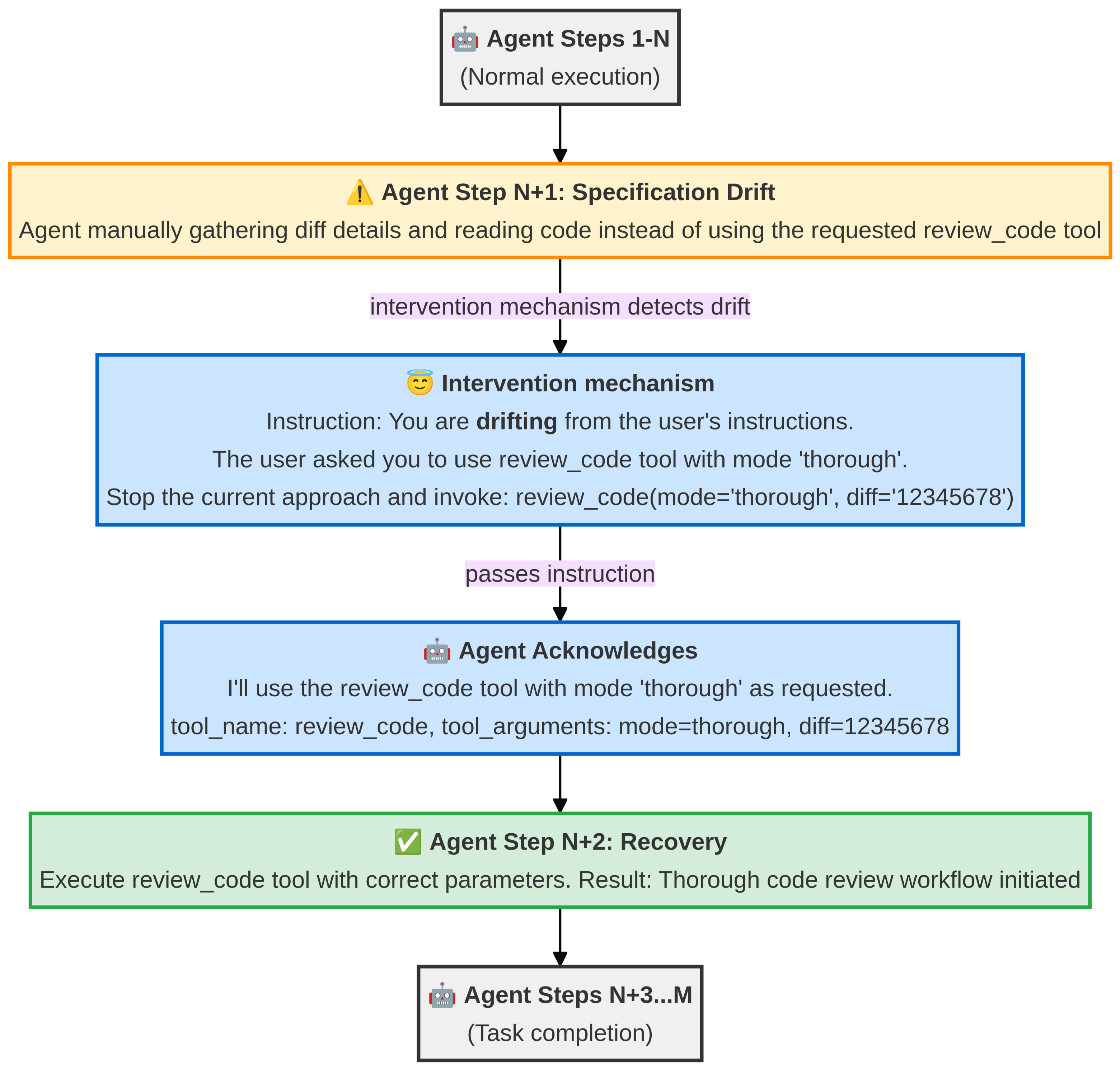

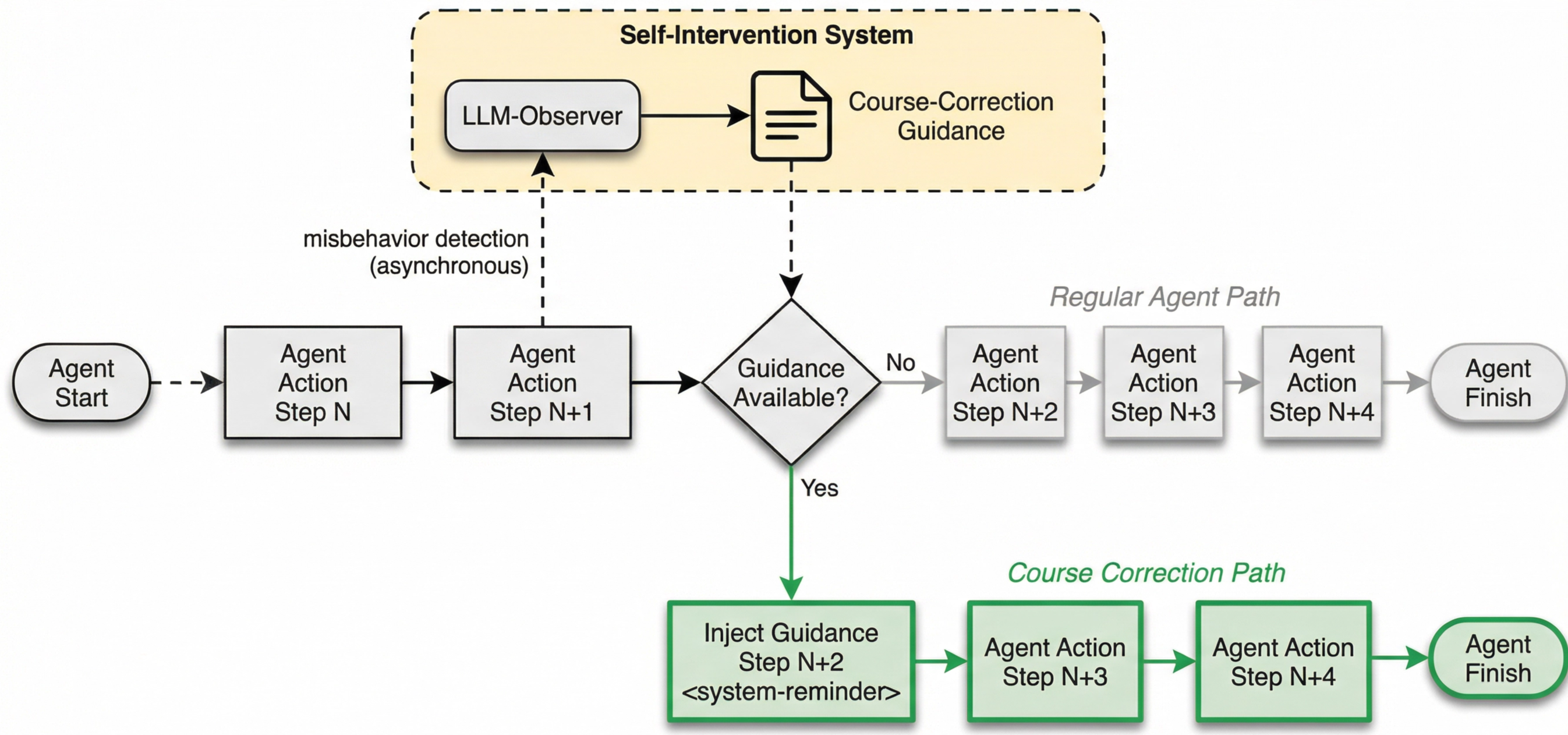

核心思路:Wink的核心思路是构建一个轻量级的异步自干预系统,通过观察Agent的执行轨迹,及时发现并纠正其行为异常。该系统不直接干预Agent的决策过程,而是提供有针对性的指导,引导Agent自主地回到正确的执行路径。这种方法避免了对Agent内部机制的过度干预,保持了Agent的自主性和灵活性。

技术框架:Wink系统主要包含以下几个模块:1) 行为监控模块:负责实时监控Agent的执行轨迹,并检测是否存在行为异常。2) 异常诊断模块:根据预定义的行为异常分类体系,对检测到的异常进行诊断,确定异常的类型和原因。3) 干预策略生成模块:根据异常的类型和原因,生成相应的干预策略,例如提供更清晰的指令、提供相关的工具文档或建议使用其他工具。4) 干预执行模块:将生成的干预策略以异步的方式发送给Agent,由Agent自主地执行这些策略。

关键创新:Wink的关键创新在于其轻量级和异步的自干预机制。与传统的需要人工干预或复杂的强化学习方法不同,Wink通过简单的观察和指导,实现了对Agent行为异常的自动修复。这种方法降低了系统的复杂性和资源消耗,使其能够在大规模Agent部署中有效运行。此外,Wink的行为异常分类体系为Agent行为的监控和诊断提供了理论基础。

关键设计:Wink在设计上考虑了以下几个关键因素:1) 异步性:干预策略的执行不阻塞Agent的正常执行流程,避免了对Agent性能的影响。2) 轻量级:干预策略的设计尽可能简单明了,避免对Agent的决策过程产生过大的干扰。3) 可扩展性:系统架构设计易于扩展,可以支持更多的Agent和更复杂的行为异常类型。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

Wink在超过10,000个真实Agent轨迹上的评估表明,它成功解决了90%的需要单次干预的行为异常。在生产环境中的A/B测试表明,Wink显著减少了工具调用失败、每次会话的Token数量以及每次会话的工程师干预次数。这些结果表明,Wink是一种有效的自动修复Agent行为异常的系统,能够显著提高Agent的可靠性和效率。

🎯 应用场景

Wink系统可应用于各种基于LLM的自主编码Agent,提高其在软件开发、自动化测试、代码生成等领域的可靠性和效率。通过减少人工干预和资源消耗,Wink能够降低开发成本,加速软件交付,并提升开发人员的生产力。未来,Wink的自干预机制可以扩展到其他类型的Agent系统,例如机器人、对话系统等,从而构建更加智能和可靠的自动化系统。

📄 摘要(原文)

Autonomous coding agents, powered by large language models (LLMs), are increasingly being adopted in the software industry to automate complex engineering tasks. However, these agents are prone to a wide range of misbehaviors, such as deviating from the user's instructions, getting stuck in repetitive loops, or failing to use tools correctly. These failures disrupt the development workflow and often require resource-intensive manual intervention. In this paper, we present a system for automatically recovering from agentic misbehaviors at scale. We first introduce a taxonomy of misbehaviors grounded in an analysis of production traffic, identifying three primary categories: Specification Drift, Reasoning Problems, and Tool Call Failures, which we find occur in about 30% of all agent trajectories. To address these issues, we developed a lightweight, asynchronous self-intervention system named Wink. Wink observes agent trajectories and provides targeted course-correction guidance to nudge the agent back to a productive path. We evaluated our system on over 10,000 real world agent trajectories and found that it successfully resolves 90% of the misbehaviors that require a single intervention. Furthermore, a live A/B test in our production environment demonstrated that our system leads to a statistically significant reduction in Tool Call Failures, Tokens per Session and Engineer Interventions per Session. We present our experience designing and deploying this system, offering insights into the challenges of building resilient agentic systems at scale.