Color-based Emotion Representation for Speech Emotion Recognition

作者: Ryotaro Nagase, Ryoichi Takashima, Yoichi Yamashita

分类: eess.AS, cs.AI, cs.SD

发布日期: 2026-02-18

备注: Submitted to EUSIPCO2026

💡 一句话要点

提出基于色彩属性的情感表征方法,用于提升语音情感识别的性能与可解释性。

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱八:物理动画 (Physics-based Animation)

关键词: 语音情感识别 情感表征 色彩属性 回归模型 多任务学习

📋 核心要点

- 传统语音情感识别方法依赖类别或维度标签,难以充分表达情感的多样性和提供直观的解释。

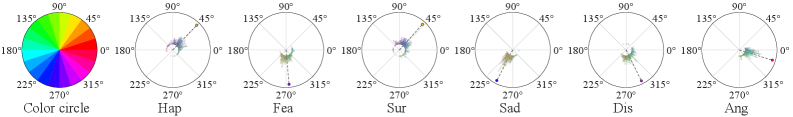

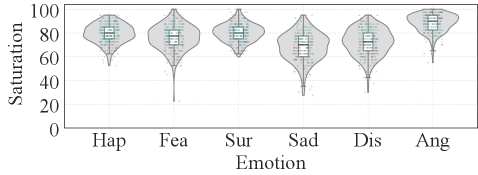

- 该论文提出使用色调、饱和度、明度等色彩属性来连续地表示情感,增强情感表达的丰富性和可解释性。

- 通过众包标注情感语音语料库,构建色彩属性回归模型,并验证了多任务学习对情感识别的性能提升。

📝 摘要(中文)

语音情感识别(SER)传统上依赖于类别或维度标签,但这种方法在表示情感的多样性和可解释性方面存在局限性。为了克服这一限制,本文关注色彩属性,如色调、饱和度和明度,将情感表示为连续且可解释的分数。通过众包方式,本文使用色彩属性标注了一个情感语音语料库,并对其进行了分析。此外,本文使用机器学习和深度学习构建了SER中色彩属性的回归模型,并探索了色彩属性回归和情感分类的多任务学习。结果表明,语音中的色彩属性与情感之间存在关系,并成功开发了用于SER的色彩属性回归模型。同时,多任务学习提高了每个任务的性能。

🔬 方法详解

问题定义:现有的语音情感识别方法主要依赖于离散的情感类别或连续的情感维度(如valence和arousal)。这些方法的痛点在于,情感类别划分过于粗糙,难以捕捉情感的细微差别;而情感维度虽然可以表示情感的连续性,但缺乏直观的可解释性,难以理解情感的具体内涵。因此,如何更准确、更可解释地表示情感是语音情感识别领域面临的一个重要问题。

核心思路:本文的核心思路是将情感与色彩属性联系起来,利用色彩的色调、饱和度和明度等属性来表示情感。色彩具有连续性和可解释性,能够更细致地表达情感的变化,并提供直观的理解。通过建立语音特征与色彩属性之间的映射关系,可以实现情感的连续表示和可解释性分析。

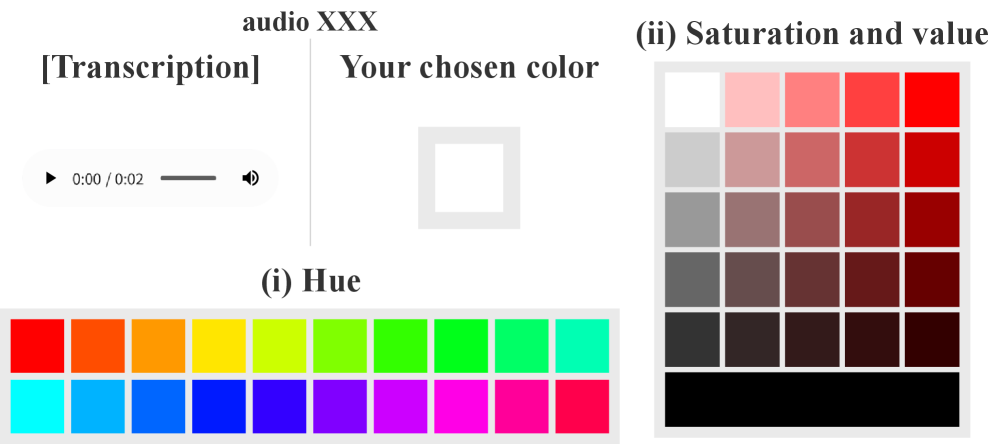

技术框架:该论文的技术框架主要包括以下几个阶段:1)情感语音语料库的色彩属性标注:通过众包方式,邀请标注人员为情感语音片段标注色调、饱和度和明度等色彩属性。2)色彩属性回归模型的构建:利用机器学习和深度学习方法,建立语音特征(如MFCC、梅尔频谱等)与色彩属性之间的回归模型。3)多任务学习:将色彩属性回归和情感分类作为两个相关任务,进行多任务学习,以提高模型的泛化能力和性能。

关键创新:该论文最重要的技术创新点在于提出了基于色彩属性的情感表征方法。与传统的基于类别或维度的情感表征方法相比,该方法具有以下优势:1)情感表示更加连续和细致;2)情感表示具有更强的可解释性;3)可以利用色彩的心理学意义来分析情感的内涵。

关键设计:在色彩属性回归模型的构建中,论文采用了多种机器学习和深度学习方法,包括支持向量回归(SVR)、随机森林(RF)和深度神经网络(DNN)。在多任务学习中,论文采用了共享底层特征表示的网络结构,并设计了合适的损失函数来平衡色彩属性回归和情感分类两个任务的学习。具体的网络结构和损失函数细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于色彩属性的回归模型能够有效地预测语音中的情感色彩属性。多任务学习能够提高色彩属性回归和情感分类的性能。具体性能数据和提升幅度在摘要中未给出,属于未知信息。但结论表明,色彩属性与情感之间存在显著关系,且多任务学习策略有效。

🎯 应用场景

该研究成果可应用于情感智能交互、心理健康评估、人机情感交流等领域。例如,在智能客服中,可以利用色彩属性来更准确地理解用户的情感状态,从而提供更个性化的服务。在心理健康评估中,可以通过分析语音中的色彩属性来辅助诊断情感障碍。未来,该研究有望促进人机情感交流的自然性和流畅性。

📄 摘要(原文)

Speech emotion recognition (SER) has traditionally relied on categorical or dimensional labels. However, this technique is limited in representing both the diversity and interpretability of emotions. To overcome this limitation, we focus on color attributes, such as hue, saturation, and value, to represent emotions as continuous and interpretable scores. We annotated an emotional speech corpus with color attributes via crowdsourcing and analyzed them. Moreover, we built regression models for color attributes in SER using machine learning and deep learning, and explored the multitask learning of color attribute regression and emotion classification. As a result, we demonstrated the relationship between color attributes and emotions in speech, and successfully developed color attribute regression models for SER. We also showed that multitask learning improved the performance of each task.