This human study did not involve human subjects: Validating LLM simulations as behavioral evidence

作者: Jessica Hullman, David Broska, Huaman Sun, Aaron Shaw

分类: cs.AI

发布日期: 2026-02-17

💡 一句话要点

验证LLM模拟作为行为证据:探索LLM在社会科学实验中的有效性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 行为模拟 社会科学实验 统计校准 启发式方法

📋 核心要点

- 现有方法缺乏对LLM模拟人类行为有效性的充分指导,阻碍了其在社会科学实验中的广泛应用。

- 论文提出两种策略:启发式方法和统计校准,以评估和提高LLM模拟的有效性,用于推断人类行为。

- 统计校准方法在特定假设下,能以更低成本提供更精确的因果效应估计,优于完全依赖人类参与者的实验。

📝 摘要(中文)

越来越多的研究使用大型语言模型(LLM)作为合成参与者,在社会科学实验中生成经济高效且近乎即时的响应。然而,关于何时此类模拟能够支持对人类行为的有效推断,指导有限。本文对比了两种获得因果效应有效估计的策略,并阐明了每种策略适用于探索性研究与验证性研究的假设前提。启发式方法试图通过提示工程、模型微调和其他旨在减少LLM引入的不准确性的修复策略,来建立模拟行为与观察到的人类行为之间的可互换性。虽然启发式方法对许多探索性任务有用,但它缺乏验证性研究通常需要的正式统计保证。相比之下,统计校准将辅助人类数据与统计调整相结合,以解释观察到的响应与模拟响应之间的差异。在明确的假设下,统计校准可以保持有效性,并以低于仅依赖人类参与者的实验的成本提供更精确的因果效应估计。然而,这两种方法的潜力都取决于LLM对相关人群的近似程度。本文还考虑了当研究人员目光短浅地专注于用LLM代替研究中的人类参与者时,会忽略哪些机会。

🔬 方法详解

问题定义:论文旨在解决如何有效利用大型语言模型(LLM)模拟人类行为,并在社会科学实验中进行有效推断的问题。现有方法,即直接将LLM作为人类受试者的替代品,缺乏足够的验证和校准,可能导致对人类行为的错误结论。痛点在于,LLM的固有偏差和不准确性会影响实验结果的可靠性。

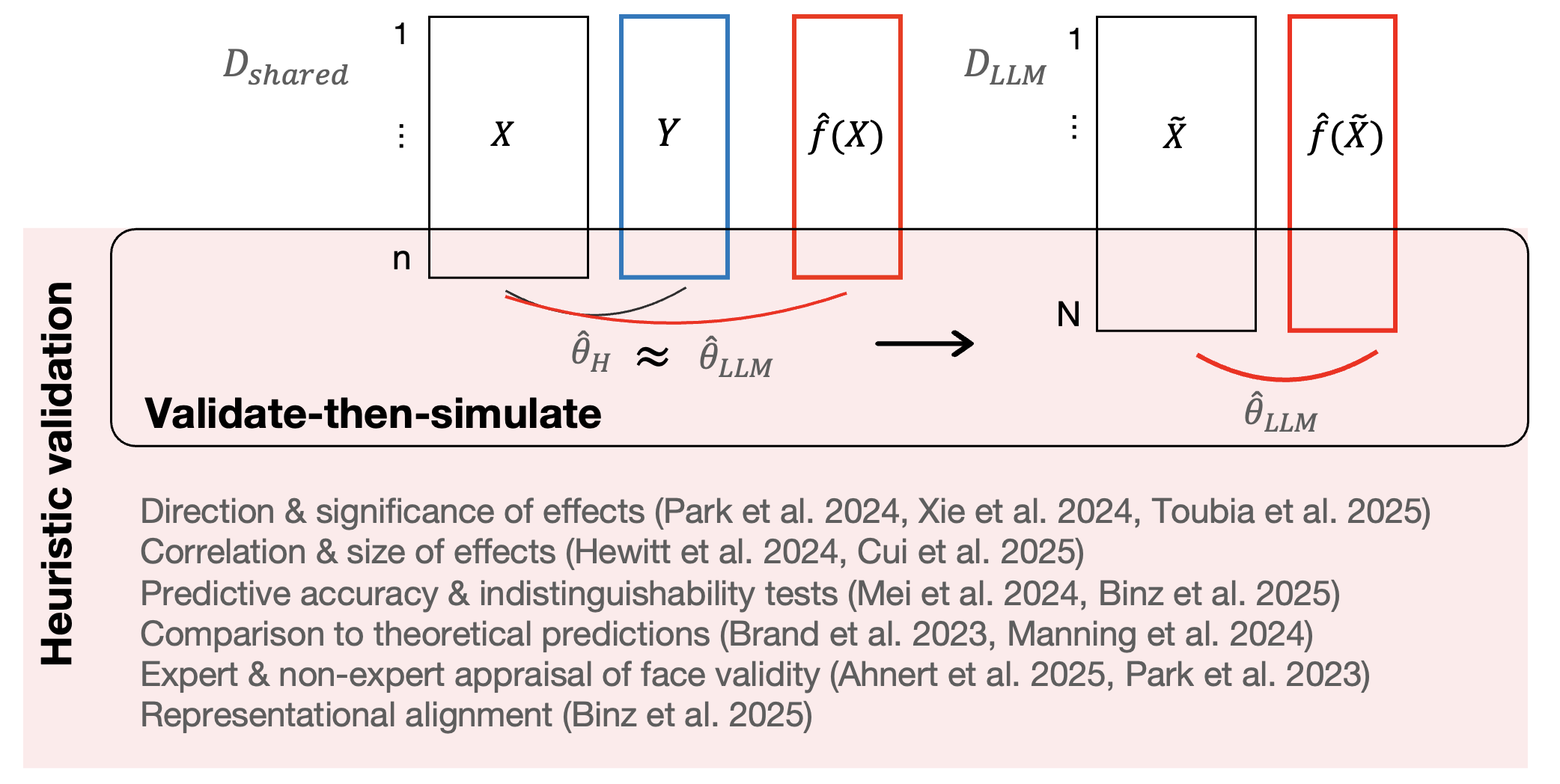

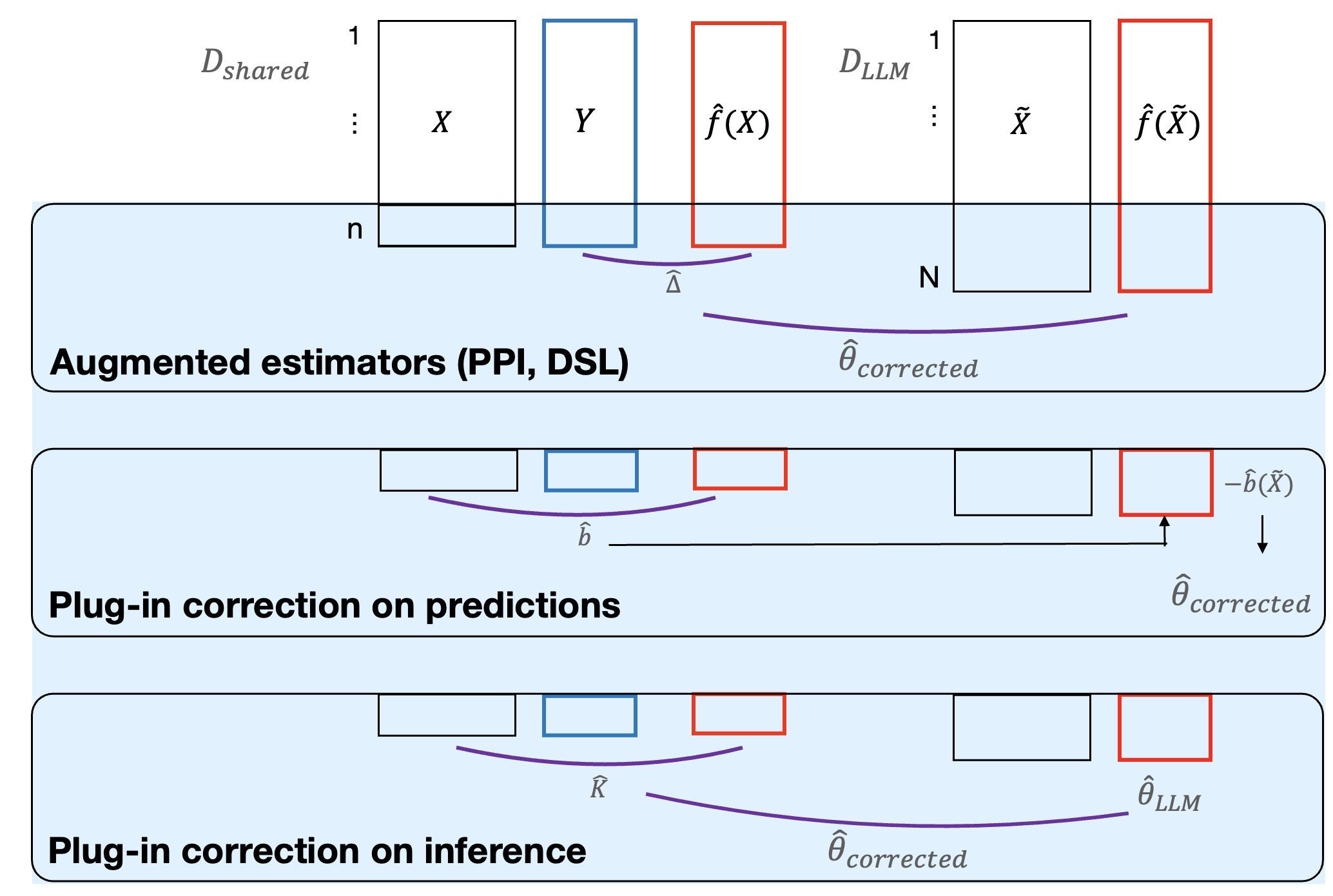

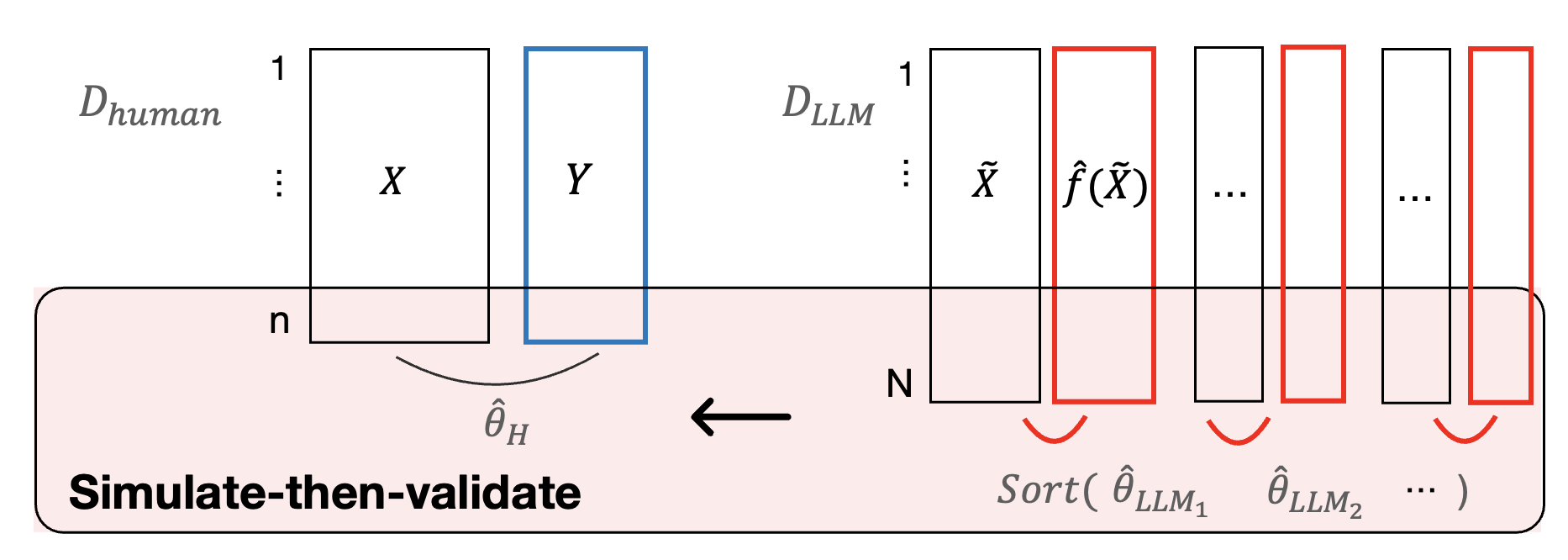

核心思路:论文的核心思路是对比和评估两种策略,以提高LLM模拟的有效性。第一种是启发式方法,通过提示工程和模型微调等手段,使LLM的行为更接近人类。第二种是统计校准,利用辅助人类数据对LLM的输出进行统计调整,以消除偏差。这样设计的目的是为了在探索性研究和验证性研究中,都能更可靠地使用LLM模拟。

技术框架:论文没有提出一个具体的系统架构,而是提供了一个评估和使用LLM进行行为模拟的框架。该框架包含以下阶段:1) 确定研究问题和目标;2) 选择合适的LLM和提示策略;3) 收集辅助人类数据(用于统计校准);4) 应用启发式方法或统计校准方法;5) 评估模拟结果的有效性。框架强调了在不同研究阶段需要考虑的关键因素和假设。

关键创新:论文的关键创新在于明确区分了启发式方法和统计校准方法,并阐述了它们各自适用的场景和假设。启发式方法适用于探索性研究,而统计校准方法在满足特定假设的前提下,可以用于验证性研究。此外,论文还强调了在利用LLM进行行为模拟时,需要关注LLM对目标人群的近似程度,避免过度依赖LLM替代人类受试者。

关键设计:论文没有涉及具体的参数设置或网络结构。统计校准方法依赖于辅助人类数据和统计调整技术,例如回归分析或倾向得分匹配。具体的校准方法需要根据研究问题和数据的特点进行选择。启发式方法则依赖于提示工程,例如使用特定的提示模板或指令,以及模型微调,例如使用人类数据对LLM进行微调。

🖼️ 关键图片

📊 实验亮点

论文对比了启发式方法和统计校准方法在LLM行为模拟中的应用,强调了统计校准在特定假设下能够提供更精确的因果效应估计,并降低实验成本。虽然没有提供具体的性能数据,但论文明确了两种方法的适用场景和局限性,为研究人员选择合适的LLM模拟策略提供了指导。

🎯 应用场景

该研究成果可应用于社会科学、心理学、行为经济学等领域,用于快速、低成本地进行实验模拟和行为预测。例如,可以利用LLM模拟不同人群对政策的反应,评估政策的潜在影响。此外,该研究也为LLM在其他领域的应用提供了借鉴,例如在教育、医疗等领域,利用LLM进行个性化推荐和辅助决策。

📄 摘要(原文)

A growing literature uses large language models (LLMs) as synthetic participants to generate cost-effective and nearly instantaneous responses in social science experiments. However, there is limited guidance on when such simulations support valid inference about human behavior. We contrast two strategies for obtaining valid estimates of causal effects and clarify the assumptions under which each is suitable for exploratory versus confirmatory research. Heuristic approaches seek to establish that simulated and observed human behavior are interchangeable through prompt engineering, model fine-tuning, and other repair strategies designed to reduce LLM-induced inaccuracies. While useful for many exploratory tasks, heuristic approaches lack the formal statistical guarantees typically required for confirmatory research. In contrast, statistical calibration combines auxiliary human data with statistical adjustments to account for discrepancies between observed and simulated responses. Under explicit assumptions, statistical calibration preserves validity and provides more precise estimates of causal effects at lower cost than experiments that rely solely on human participants. Yet the potential of both approaches depends on how well LLMs approximate the relevant populations. We consider what opportunities are overlooked when researchers focus myopically on substituting LLMs for human participants in a study.