PERSONA: Dynamic and Compositional Inference-Time Personality Control via Activation Vector Algebra

作者: Xiachong Feng, Liang Zhao, Weihong Zhong, Yichong Huang, Yuxuan Gu, Lingpeng Kong, Xiaocheng Feng, Bing Qin

分类: cs.AI

发布日期: 2026-02-17

备注: ICLR 2026

💡 一句话要点

PERSONA:通过激活向量代数实现大语言模型中动态和可组合的推理时人格控制

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 人格控制 激活向量 向量代数 动态调整

📋 核心要点

- 现有方法在控制大语言模型人格时,依赖静态提示或微调,难以捕捉人格的动态性和组合性。

- PERSONA框架通过在激活空间中操纵人格向量,实现无需训练的人格控制,达到微调水平的性能。

- 实验表明,该方法在静态和动态人格控制基准上均表现出色,验证了LLM人格在数学上的可处理性。

📝 摘要(中文)

现有大语言模型中的人格控制方法依赖于静态提示或昂贵的微调,无法捕捉人类特质的动态和可组合性。我们提出了PERSONA,一个无需训练的框架,通过直接操纵激活空间中的人格向量,实现了与微调相当的性能。我们的关键洞察是,人格特质表现为模型表征空间中可提取的、近似正交的方向,并支持代数运算。该框架通过三个阶段运行:Persona-Base通过对比激活分析提取正交特质向量;Persona-Algebra通过向量算术(标量乘法控制强度,加法控制组合,减法控制抑制)实现精确控制;Persona-Flow通过在推理过程中动态组合这些向量来实现上下文感知的适应。在PersonalityBench上,我们的方法实现了9.60的平均分,几乎与9.61的监督微调上限相匹配,而无需任何梯度更新。在我们提出的Persona-Evolve基准测试中,针对动态人格适应,我们在不同的模型系列中实现了高达91%的胜率。这些结果证明了LLM人格的某些方面在数学上是可处理的,为可解释和高效的行为控制开辟了新的方向。

🔬 方法详解

问题定义:现有大语言模型人格控制方法主要依赖于静态提示工程或全参数微调。静态提示缺乏动态调整能力,难以适应复杂情境;而微调成本高昂,且泛化性受限,难以应对多样化的人格需求。因此,如何实现高效、动态、可组合的人格控制是一个关键问题。

核心思路:PERSONA的核心思路是,将人格特质视为大语言模型内部激活空间中的向量,这些向量具有可提取性和近似正交性,并且可以通过代数运算进行组合和调整。通过直接操纵这些向量,可以在推理时动态地控制模型的人格,而无需进行耗时的训练或微调。

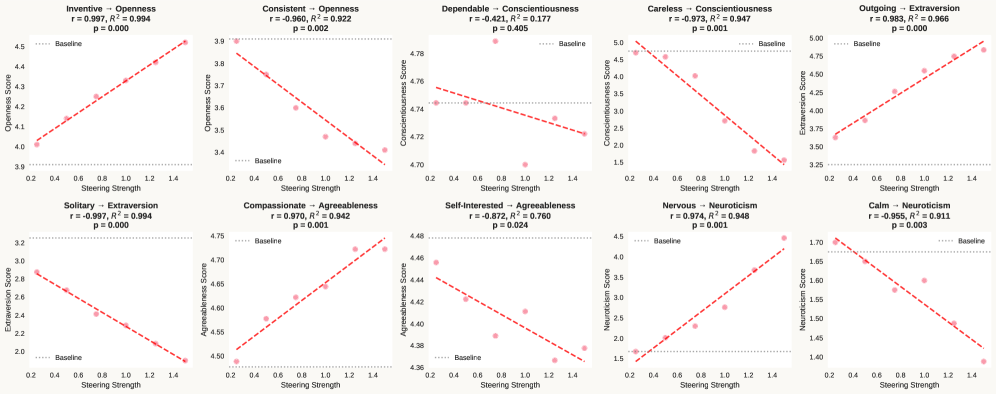

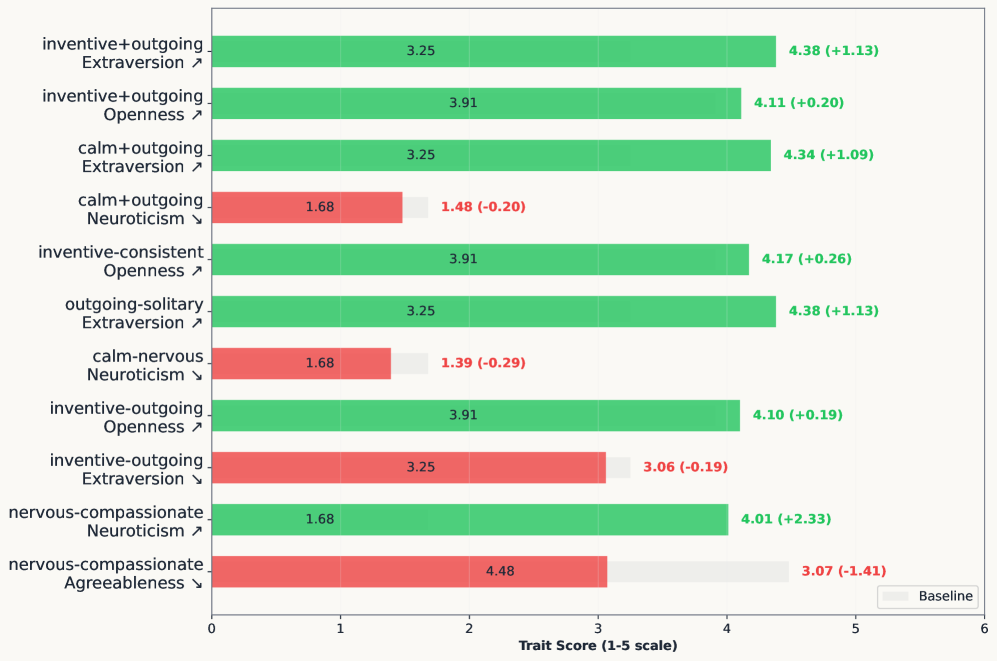

技术框架:PERSONA框架包含三个主要阶段:Persona-Base、Persona-Algebra和Persona-Flow。Persona-Base阶段通过对比激活分析,从模型中提取代表不同人格特质的正交向量。Persona-Algebra阶段利用向量算术运算(如标量乘法、加法和减法)来调整人格特质的强度、组合和抑制。Persona-Flow阶段则根据上下文动态地组合这些向量,实现上下文感知的人格适应。

关键创新:PERSONA的关键创新在于,它将人格控制问题转化为激活空间中的向量操作问题,从而实现了无需训练的动态人格控制。与传统的静态提示或微调方法相比,PERSONA具有更高的效率、灵活性和可解释性。此外,该方法还揭示了LLM人格的某些方面在数学上是可处理的,为进一步研究LLM的行为控制提供了新的思路。

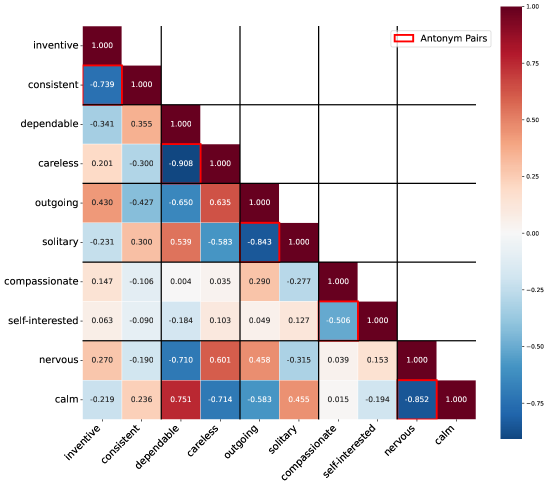

关键设计:Persona-Base阶段使用对比激活分析来提取正交特质向量。具体来说,对于每种人格特质,收集正例和负例样本,然后计算它们在模型各层激活向量的平均差异,得到该特质的代表性向量。为了保证向量的正交性,可以使用Gram-Schmidt正交化方法。Persona-Algebra阶段的关键在于选择合适的标量乘法因子,以控制人格特质的强度。Persona-Flow阶段则需要设计合适的上下文感知机制,以动态地组合人格向量。具体实现细节(如损失函数、网络结构等)未在论文中详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

PERSONA在PersonalityBench上取得了9.60的平均分,几乎与监督微调的上限9.61相匹配,且无需任何梯度更新。在Persona-Evolve基准测试中,针对动态人格适应,该方法在不同的模型系列中实现了高达91%的胜率。这些结果表明,PERSONA在静态和动态人格控制方面均表现出色,验证了其有效性和泛化性。

🎯 应用场景

PERSONA框架可应用于各种需要人格化交互的场景,如虚拟助手、游戏角色、社交机器人等。通过动态调整模型的人格,可以使其更好地适应用户的需求和偏好,从而提高用户体验。此外,该方法还可以用于研究LLM的行为控制和可解释性,为开发更安全、更可靠的AI系统提供支持。

📄 摘要(原文)

Current methods for personality control in Large Language Models rely on static prompting or expensive fine-tuning, failing to capture the dynamic and compositional nature of human traits. We introduce PERSONA, a training-free framework that achieves fine-tuning level performance through direct manipulation of personality vectors in activation space. Our key insight is that personality traits appear as extractable, approximately orthogonal directions in the model's representation space that support algebraic operations. The framework operates through three stages: Persona-Base extracts orthogonal trait vectors via contrastive activation analysis; Persona-Algebra enables precise control through vector arithmetic (scalar multiplication for intensity, addition for composition, subtraction for suppression); and Persona-Flow achieves context-aware adaptation by dynamically composing these vectors during inference. On PersonalityBench, our approach achieves a mean score of 9.60, nearly matching the supervised fine-tuning upper bound of 9.61 without any gradient updates. On our proposed Persona-Evolve benchmark for dynamic personality adaptation, we achieve up to 91% win rates across diverse model families. These results provide evidence that aspects of LLM personality are mathematically tractable, opening new directions for interpretable and efficient behavioral control.