EAA: Automating materials characterization with vision language model agents

作者: Ming Du, Yanqi Luo, Srutarshi Banerjee, Michael Wojcik, Jelena Popovic, Mathew J. Cherukara

分类: cs.AI

发布日期: 2026-02-17

💡 一句话要点

EAA:利用视觉语言模型智能体自动化材料表征实验流程

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 实验自动化 视觉语言模型 材料表征 智能体 光束线

📋 核心要点

- 现有实验显微镜工作流程复杂,操作繁琐,对用户专业知识要求高,自动化程度低。

- EAA系统利用视觉语言模型驱动的智能体,结合多模态推理和工具增强动作,实现实验流程的自动化。

- 实验结果表明,EAA能够提高光束线效率,减轻操作负担,并降低用户使用门槛。

📝 摘要(中文)

本文提出了一种名为实验自动化智能体(EAA)的系统,该系统由视觉语言模型驱动,旨在自动化复杂的实验显微镜工作流程。EAA集成了多模态推理、工具增强动作和可选的长期记忆,以支持自主程序和交互式用户引导测量。该系统构建在灵活的任务管理器架构之上,支持从完全由智能体驱动的自动化到嵌入局部LLM查询的逻辑定义例程等多种工作流程。EAA还提供了一个现代化的工具生态系统,具有Model Context Protocol (MCP)的双向兼容性,允许仪器控制工具跨应用程序使用或提供服务。我们在Advanced Photon Source的成像光束线上演示了EAA,包括自动区域板聚焦、自然语言描述的特征搜索和交互式数据采集。这些结果表明,具有视觉能力的智能体可以提高光束线的效率,减轻操作负担,并降低用户的专业知识门槛。

🔬 方法详解

问题定义:现有材料表征实验,特别是使用显微镜的光束线实验,通常需要人工干预,流程复杂,耗时且需要专业知识。现有方法难以实现完全自动化,用户需要手动调整参数、定位目标特征和控制实验设备,效率低下且容易出错。

核心思路:EAA的核心思路是利用视觉语言模型(VLM)作为智能体的大脑,赋予其理解图像、自然语言指令和控制实验设备的能力。通过将VLM与工具增强动作和长期记忆相结合,EAA能够自主执行复杂的实验流程,并与用户进行交互。

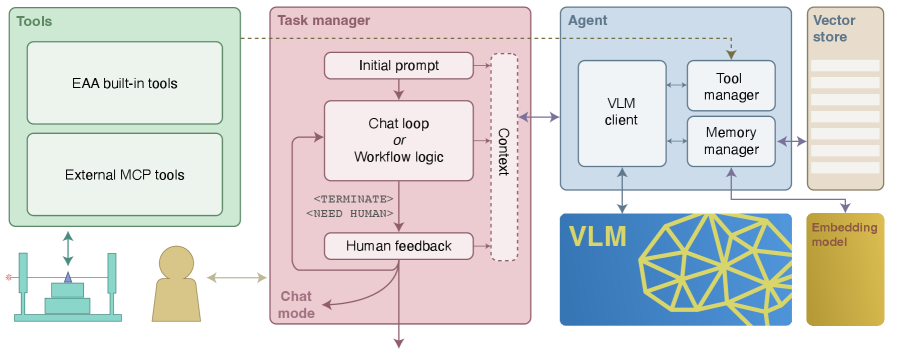

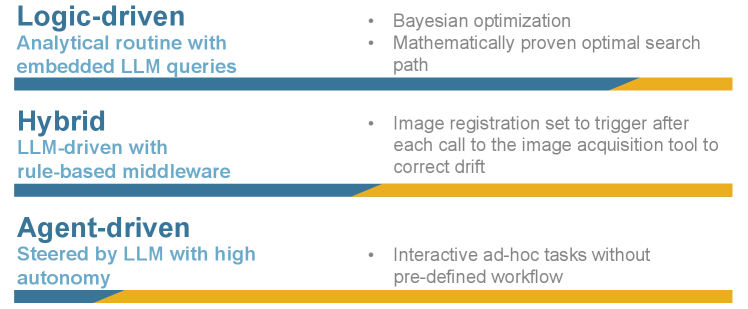

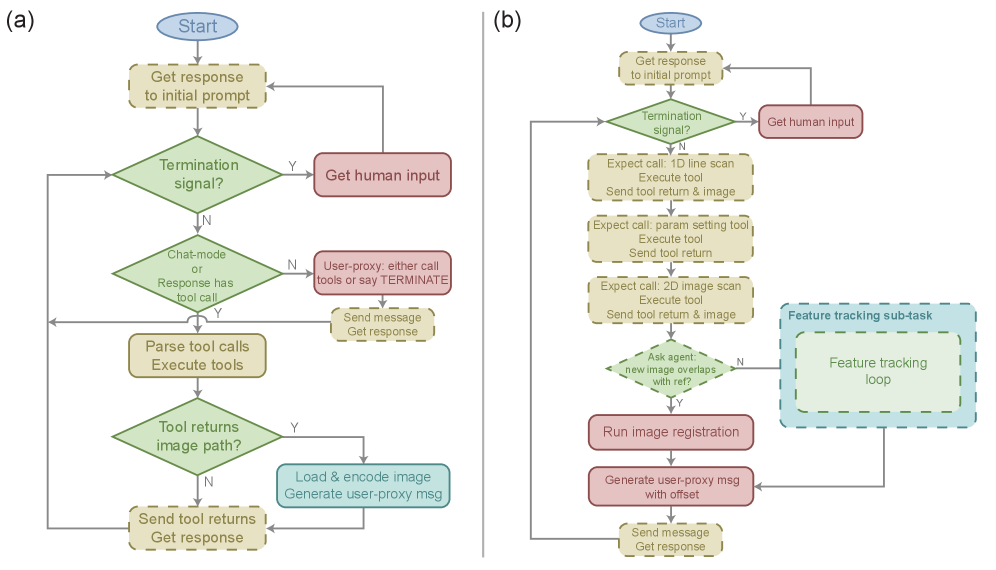

技术框架:EAA系统包含以下主要模块:1) 任务管理器:负责协调整个实验流程,根据用户指令或预定义逻辑调度各个模块。2) 视觉语言模型:作为智能体的核心,负责理解图像和自然语言指令,并生成相应的动作指令。3) 工具接口:提供与实验设备(如显微镜、光束线)的接口,允许智能体控制设备。4) 长期记忆(可选):用于存储实验过程中的信息,以便智能体进行推理和决策。EAA还支持Model Context Protocol (MCP),实现工具的跨应用兼容。

关键创新:EAA的关键创新在于将视觉语言模型应用于实验自动化领域,并构建了一个灵活的任务管理器架构,支持多种工作流程。此外,EAA还提供了现代化的工具生态系统,具有Model Context Protocol (MCP)的双向兼容性,使得仪器控制工具可以跨应用使用。

关键设计:EAA使用预训练的视觉语言模型,并通过微调使其适应特定的实验任务。任务管理器采用模块化设计,允许用户自定义实验流程。工具接口采用标准化的API,方便集成不同的实验设备。长期记忆模块使用向量数据库存储实验信息,并使用相似度搜索进行信息检索。

🖼️ 关键图片

📊 实验亮点

EAA在Advanced Photon Source的成像光束线上进行了验证,实现了自动区域板聚焦、自然语言描述的特征搜索和交互式数据采集。实验结果表明,EAA能够显著提高光束线的效率,减轻操作负担,并降低用户的专业知识门槛。例如,EAA能够根据自然语言描述自动定位目标特征,并将聚焦过程自动化,大大缩短了实验时间。

🎯 应用场景

EAA可应用于各种材料表征实验,例如显微镜成像、光谱分析等。该系统能够提高实验效率,降低操作难度,并减少人为误差。EAA还有望加速新材料的发现和开发,促进科学研究的进展。未来,EAA可以扩展到其他类型的实验,例如化学合成、生物实验等,实现更广泛的实验自动化。

📄 摘要(原文)

We present Experiment Automation Agents (EAA), a vision-language-model-driven agentic system designed to automate complex experimental microscopy workflows. EAA integrates multimodal reasoning, tool-augmented action, and optional long-term memory to support both autonomous procedures and interactive user-guided measurements. Built on a flexible task-manager architecture, the system enables workflows ranging from fully agent-driven automation to logic-defined routines that embed localized LLM queries. EAA further provides a modern tool ecosystem with two-way compatibility for Model Context Protocol (MCP), allowing instrument-control tools to be consumed or served across applications. We demonstrate EAA at an imaging beamline at the Advanced Photon Source, including automated zone plate focusing, natural language-described feature search, and interactive data acquisition. These results illustrate how vision-capable agents can enhance beamline efficiency, reduce operational burden, and lower the expertise barrier for users.