GRAIL: Goal Recognition Alignment through Imitation Learning

作者: Osher Elhadad, Felipe Meneguzzi, Reuth Mirsky

分类: cs.AI, cs.LG, cs.RO

发布日期: 2026-02-15

备注: Accepted for publication at AAMAS 2026

💡 一句话要点

GRAIL:通过模仿学习实现目标识别对齐,解决次优行为下的目标推断问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 目标识别 模仿学习 逆强化学习 次优行为 人机协作

📋 核心要点

- 现有目标识别方法依赖于最优策略,无法准确识别智能体真实目标,尤其是在智能体行为并非最优时。

- GRAIL利用模仿学习和逆强化学习,从次优轨迹中学习目标导向策略,从而更好地捕捉智能体的真实意图。

- 实验表明,GRAIL在次优、有偏差和噪声环境下显著提升了目标识别的准确率,同时保持了在最优环境下的竞争力。

📝 摘要(中文)

本文提出了一种名为“通过模仿学习实现目标识别对齐”(GRAIL)的方法,旨在解决现有目标识别方法依赖于最优策略表示,从而难以准确识别智能体真实目标的问题。GRAIL利用模仿学习和逆强化学习,直接从(可能次优的)演示轨迹中为每个候选目标学习一个目标导向策略。通过单次前向传播,使用每个学习到的目标导向策略对观察到的部分轨迹进行评分,GRAIL保留了经典目标识别的单次推理能力,同时利用学习到的策略来捕捉次优和系统性偏差的行为。在评估的领域中,GRAIL在系统性偏差的最优行为下,F1分数提高了0.5以上,在次优行为下,获得了约0.1-0.3的增益,在噪声最优轨迹下,获得了高达0.4的改进,同时在完全最优设置中保持了竞争力。这项工作有助于构建可扩展且鲁棒的模型,用于在不确定环境中解释智能体的目标。

🔬 方法详解

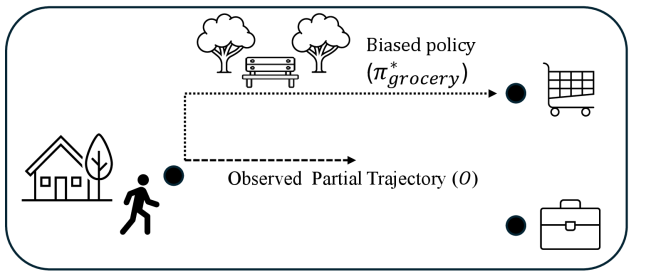

问题定义:现有目标识别方法通常假设智能体遵循最优策略,即智能体的行为是实现其目标的最佳方式。然而,在现实世界中,智能体的行为往往是次优的,或者存在系统性偏差。这些次优行为会导致现有方法无法准确识别智能体的真实目标。因此,需要一种能够处理次优行为的目标识别方法。

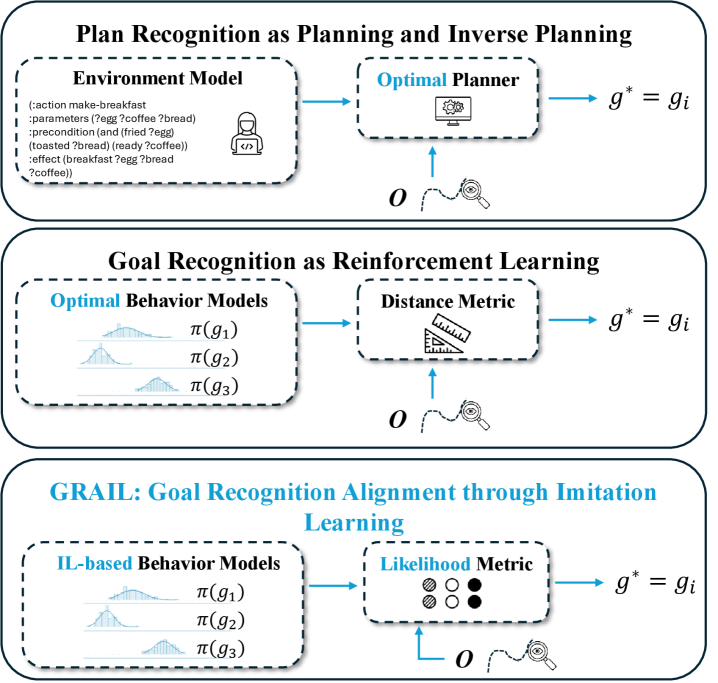

核心思路:GRAIL的核心思路是利用模仿学习和逆强化学习,直接从智能体的演示轨迹中学习目标导向策略。通过模仿学习,GRAIL可以学习到智能体的行为模式,即使这些行为不是最优的。逆强化学习则用于推断智能体的潜在奖励函数,从而更好地理解其目标。通过为每个候选目标学习一个策略,GRAIL可以评估观察到的轨迹与每个目标的匹配程度,从而识别智能体的真实目标。

技术框架:GRAIL的整体框架包括以下几个主要步骤:1) 数据收集:收集智能体的演示轨迹,这些轨迹可能包含次优行为。2) 策略学习:使用模仿学习和逆强化学习,为每个候选目标学习一个目标导向策略。3) 目标识别:对于观察到的部分轨迹,使用每个学习到的策略进行评分。选择得分最高的策略对应的目标作为智能体的真实目标。

关键创新:GRAIL的关键创新在于它能够处理次优行为。与现有方法不同,GRAIL不假设智能体遵循最优策略,而是直接从演示轨迹中学习行为模式。这使得GRAIL能够更准确地识别智能体的真实目标,即使智能体的行为不是最优的。此外,GRAIL通过单次前向传播进行目标识别,保持了高效的推理速度。

关键设计:GRAIL使用了一种基于神经网络的策略表示,该网络将状态作为输入,并输出一个动作。模仿学习部分可以使用各种算法,例如Behavioral Cloning或Generative Adversarial Imitation Learning (GAIL)。逆强化学习部分可以使用例如Maximum Entropy Inverse Reinforcement Learning。损失函数的设计需要考虑模仿学习和逆强化学习的目标,例如最小化策略与演示轨迹之间的差异,以及最大化策略的熵。

🖼️ 关键图片

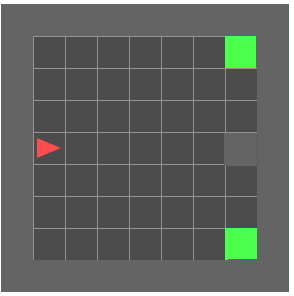

📊 实验亮点

实验结果表明,GRAIL在多个领域都取得了显著的性能提升。在系统性偏差的最优行为下,GRAIL的F1分数提高了0.5以上。在次优行为下,GRAIL获得了约0.1-0.3的增益。在噪声最优轨迹下,GRAIL获得了高达0.4的改进。此外,GRAIL在完全最优设置中保持了竞争力,证明了其在各种环境下的鲁棒性。

🎯 应用场景

GRAIL可应用于人机协作、自动驾驶、机器人导航等领域。例如,在人机协作中,GRAIL可以帮助机器人理解人类的意图,从而更好地与人类合作。在自动驾驶中,GRAIL可以帮助自动驾驶系统预测其他车辆的行驶意图,从而做出更安全的决策。在机器人导航中,GRAIL可以帮助机器人理解人类的导航指令,从而更有效地完成任务。该研究有助于提升AI系统的智能化水平和人机交互的自然性。

📄 摘要(原文)

Understanding an agent's goals from its behavior is fundamental to aligning AI systems with human intentions. Existing goal recognition methods typically rely on an optimal goal-oriented policy representation, which may differ from the actor's true behavior and hinder the accurate recognition of their goal. To address this gap, this paper introduces Goal Recognition Alignment through Imitation Learning (GRAIL), which leverages imitation learning and inverse reinforcement learning to learn one goal-directed policy for each candidate goal directly from (potentially suboptimal) demonstration trajectories. By scoring an observed partial trajectory with each learned goal-directed policy in a single forward pass, GRAIL retains the one-shot inference capability of classical goal recognition while leveraging learned policies that can capture suboptimal and systematically biased behavior. Across the evaluated domains, GRAIL increases the F1-score by more than 0.5 under systematically biased optimal behavior, achieves gains of approximately 0.1-0.3 under suboptimal behavior, and yields improvements of up to 0.4 under noisy optimal trajectories, while remaining competitive in fully optimal settings. This work contributes toward scalable and robust models for interpreting agent goals in uncertain environments.