REDSearcher: A Scalable and Cost-Efficient Framework for Long-Horizon Search Agents

作者: Zheng Chu, Xiao Wang, Jack Hong, Huiming Fan, Yuqi Huang, Yue Yang, Guohai Xu, Chenxiao Zhao, Cheng Xiang, Shengchao Hu, Dongdong Kuang, Ming Liu, Bing Qin, Xing Yu

分类: cs.AI, cs.CL

发布日期: 2026-02-15

备注: https://redsearchagent.github.io/index/

💡 一句话要点

REDSearcher:一种可扩展且经济高效的长程搜索代理框架

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长程搜索代理 任务合成 中期训练 强化学习 工具增强查询 多模态搜索 可扩展框架

📋 核心要点

- 现有长程搜索代理面临高质量搜索轨迹稀疏和交互成本高昂的挑战,限制了其性能。

- REDSearcher 框架通过协同设计任务合成、中期训练和后期训练,优化搜索代理。

- REDSearcher 在文本和多模态搜索任务上取得了 SOTA 性能,并开源数据集和代码。

📝 摘要(中文)

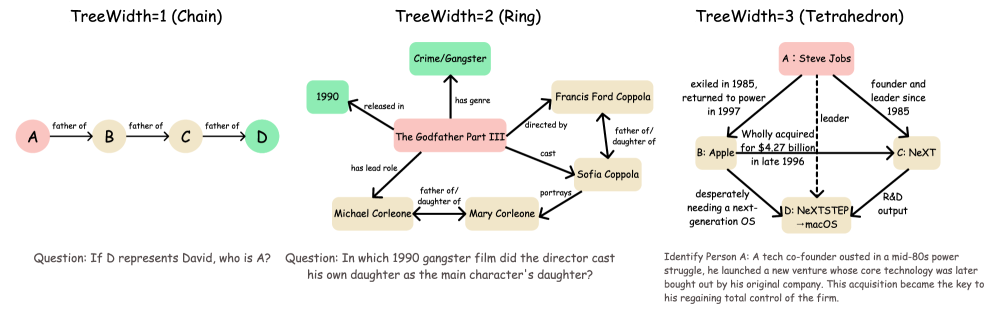

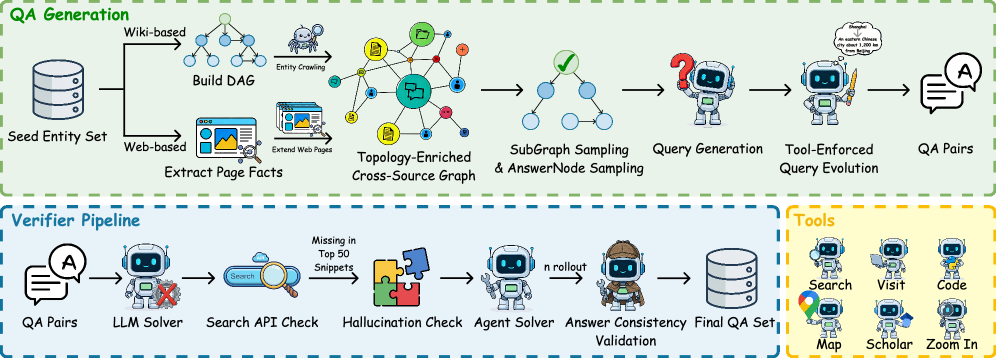

大型语言模型正从通用知识引擎转变为现实世界的问题解决者,但优化它们以执行深度搜索任务仍然具有挑战性。 主要瓶颈在于高质量搜索轨迹和奖励信号的极端稀疏性,这是由于可扩展的长程任务构建的难度以及涉及外部工具调用的交互密集型 rollouts 的高成本造成的。 为了应对这些挑战,我们提出了 REDSearcher,这是一个统一的框架,它协同设计了复杂的任务合成、中期训练和后期训练,以实现可扩展的搜索代理优化。 具体来说,REDSearcher 引入了以下改进:(1) 我们将任务合成构建为双重约束优化,其中任务难度由图拓扑和证据分散精确控制,从而可以可扩展地生成复杂的高质量任务。 (2) 我们引入了工具增强查询,以鼓励主动使用工具而不是被动回忆。 (3) 在中期训练期间,我们大大加强了核心原子能力——知识、规划和函数调用——从而降低了为下游训练收集高质量轨迹的成本。 (4) 我们构建了一个本地模拟环境,可以为强化学习实验实现快速、低成本的算法迭代。 在纯文本和多模态搜索代理基准测试中,我们的方法都实现了最先进的性能。 为了促进未来对长程搜索代理的研究,我们将发布 1 万条高质量的复杂文本搜索轨迹、5 千条多模态轨迹和 1 千条文本 RL 查询集,以及代码和模型检查点。

🔬 方法详解

问题定义:论文旨在解决长程搜索代理训练中,高质量搜索轨迹稀疏以及与外部工具交互成本高昂的问题。现有方法难以生成足够复杂且高质量的任务,并且训练过程效率低下,导致模型难以有效利用外部工具进行搜索和推理。

核心思路:REDSearcher 的核心思路是通过协同设计任务合成、中期训练和后期训练三个阶段,来提升搜索代理的性能和训练效率。任务合成阶段生成高质量的复杂任务,中期训练阶段增强模型的核心能力,后期训练阶段利用强化学习进行微调。

技术框架:REDSearcher 框架包含以下几个主要模块:1) 任务合成模块:通过双重约束优化生成复杂任务,控制任务难度。2) 中期训练模块:利用工具增强查询,提升模型知识、规划和函数调用能力。3) 强化学习模块:在本地模拟环境中进行快速迭代,优化搜索策略。整体流程是先合成任务,然后进行中期训练提升模型能力,最后通过强化学习进行策略优化。

关键创新:REDSearcher 的关键创新在于其协同设计的框架,以及在各个阶段引入的创新技术。任务合成阶段的双重约束优化能够生成高质量的复杂任务,中期训练阶段的工具增强查询能够有效提升模型利用外部工具的能力,本地模拟环境能够加速强化学习的迭代过程。

关键设计:在任务合成阶段,使用图拓扑和证据分散来控制任务难度。在中期训练阶段,设计了工具增强查询,鼓励模型主动使用工具。在强化学习阶段,构建了本地模拟环境,降低了实验成本。具体的参数设置、损失函数和网络结构等细节在论文中进行了详细描述(具体数值未知)。

🖼️ 关键图片

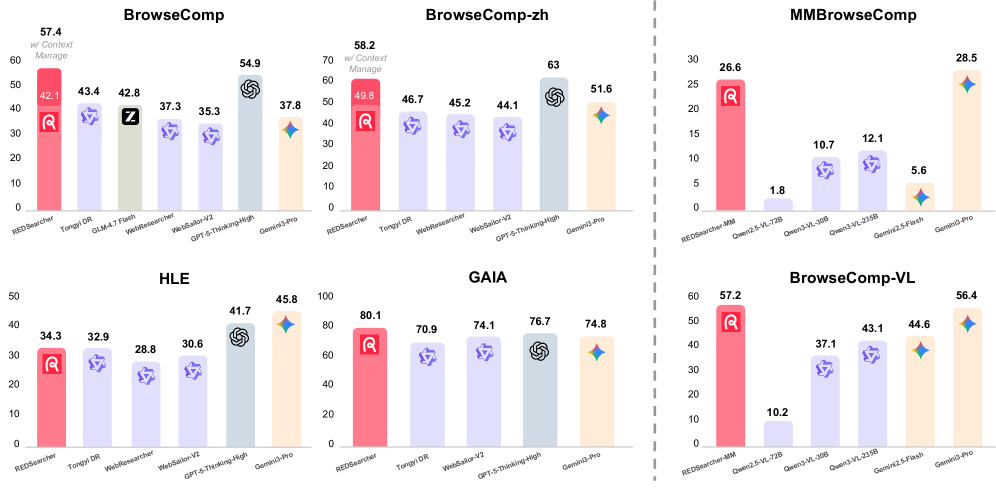

📊 实验亮点

REDSearcher 在文本和多模态搜索代理基准测试中均取得了 SOTA 性能。论文开源了包含 1 万条高质量复杂文本搜索轨迹、5 千条多模态轨迹和 1 千条文本 RL 查询集的数据集,以及代码和模型检查点,为后续研究提供了宝贵的资源。

🎯 应用场景

REDSearcher 框架可应用于各种需要长程搜索和推理的场景,例如智能客服、自动问答、科学研究、金融分析等。该研究能够提升智能体在复杂任务中的表现,降低人工干预成本,并加速相关领域的智能化进程。未来,该框架有望扩展到更多领域,例如机器人导航、自动驾驶等。

📄 摘要(原文)

Large language models are transitioning from generalpurpose knowledge engines to realworld problem solvers, yet optimizing them for deep search tasks remains challenging. The central bottleneck lies in the extreme sparsity of highquality search trajectories and reward signals, arising from the difficulty of scalable longhorizon task construction and the high cost of interactionheavy rollouts involving external tool calls. To address these challenges, we propose REDSearcher, a unified framework that codesigns complex task synthesis, midtraining, and posttraining for scalable searchagent optimization. Specifically, REDSearcher introduces the following improvements: (1) We frame task synthesis as a dualconstrained optimization, where task difficulty is precisely governed by graph topology and evidence dispersion, allowing scalable generation of complex, highquality tasks. (2) We introduce toolaugmented queries to encourage proactive tool use rather than passive recall.(3) During midtraining, we strengthen core atomic capabilities knowledge, planning, and function calling substantially reducing the cost of collecting highquality trajectories for downstream training. (4) We build a local simulated environment that enables rapid, lowcost algorithmic iteration for reinforcement learning experiments. Across both textonly and multimodal searchagent benchmarks, our approach achieves stateoftheart performance. To facilitate future research on longhorizon search agents, we will release 10K highquality complex text search trajectories, 5K multimodal trajectories and 1K text RL query set, and together with code and model checkpoints.