GUI-GENESIS: Automated Synthesis of Efficient Environments with Verifiable Rewards for GUI Agent Post-Training

作者: Yuan Cao, Dezhi Ran, Mengzhou Wu, Yuzhe Guo, Xin Chen, Ang Li, Gang Cao, Gong Zhi, Hao Yu, Linyi Li, Wei Yang, Tao Xie

分类: cs.AI, cs.LG

发布日期: 2026-02-15

💡 一句话要点

GUI-GENESIS:自动合成高效且具有可验证奖励的GUI Agent后训练环境

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI Agent 环境合成 强化学习 代码原生奖励 可执行断言

📋 核心要点

- 现有GUI Agent在真实应用中训练面临高延迟、低可复现性和依赖噪声视觉代理的不可验证奖励等问题。

- GUI-GENESIS通过多模态代码模型重建轻量级Web环境,并引入代码原生奖励,即基于可执行断言的确定性奖励信号。

- 实验表明,GUI-GENESIS显著降低训练成本和延迟,并使Agent在真实世界任务中超越基线模型,实现性能提升。

📝 摘要(中文)

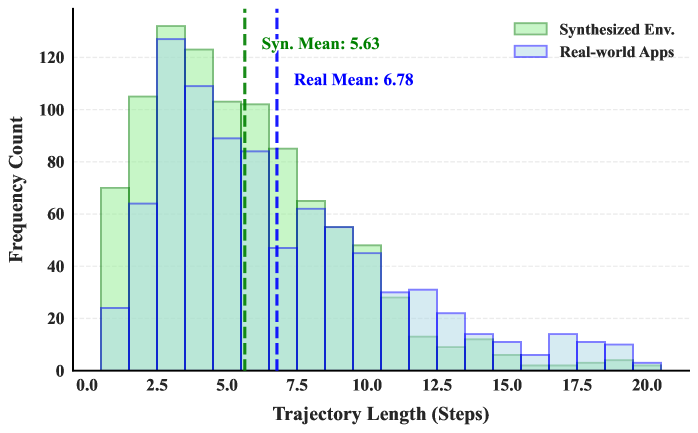

本文提出了GUI-GENESIS,一个自动合成高效GUI训练环境的框架,该环境具有可验证的奖励,旨在解决GUI Agent后训练中泛化和长程规划能力发展的问题。GUI-GENESIS利用多模态代码模型将真实世界的应用程序重构为轻量级的Web环境,并配备代码原生的奖励机制,即提供确定性奖励信号并消除视觉估计噪声的可执行断言。实验结果表明,与在真实应用程序上训练相比,GUI-GENESIS将环境延迟降低了10倍,每个epoch的成本降低了超过28,000美元。使用GUI-GENESIS训练的Agent在held-out的真实世界任务上,性能优于基线模型14.54%,甚至优于真实世界的RL基线3.27%。此外,模型能够合成它们尚未能解决的环境,这为Agent的自我改进提供了一条途径。

🔬 方法详解

问题定义:现有GUI Agent的训练,尤其是在真实世界的应用程序中进行后训练时,面临着诸多挑战。这些挑战包括:高延迟导致训练速度慢,难以复现实验结果,以及奖励信号依赖于视觉代理,这些视觉代理往往带有噪声,导致奖励信号不可靠。这些问题阻碍了Agent泛化能力和长程规划能力的提升。

核心思路:GUI-GENESIS的核心思路是自动合成高效且具有可验证奖励的GUI训练环境。通过将真实世界的应用程序重构为轻量级的Web环境,并使用代码原生的奖励机制,可以显著降低环境延迟,提高训练效率,并提供更可靠的奖励信号。这种方法旨在克服在真实应用程序上训练的局限性,从而提升GUI Agent的性能。

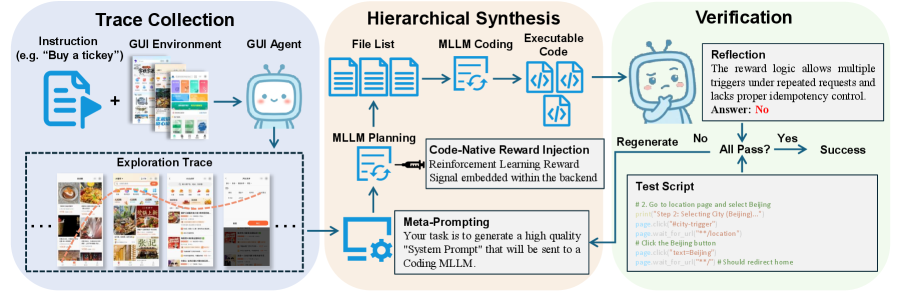

技术框架:GUI-GENESIS框架主要包含以下几个关键模块:1) 多模态代码模型:用于理解和解析真实世界应用程序的代码,并将其重构为轻量级的Web环境。2) 环境合成器:负责根据代码模型生成可交互的GUI环境。3) 代码原生奖励生成器:利用可执行断言生成确定性的奖励信号,消除视觉估计噪声。4) Agent训练模块:使用合成的环境训练GUI Agent。整体流程是从真实应用程序的代码开始,通过多模态代码模型和环境合成器生成轻量级Web环境,然后利用代码原生奖励生成器生成奖励信号,最后使用这些环境和奖励信号训练GUI Agent。

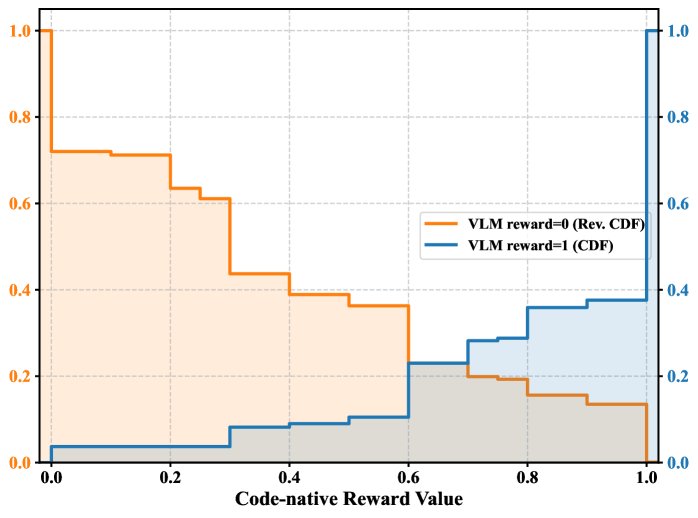

关键创新:GUI-GENESIS的关键创新在于自动合成GUI训练环境,并引入了代码原生的奖励机制。与传统的依赖视觉代理的奖励信号不同,GUI-GENESIS使用可执行断言生成确定性的奖励信号,从而消除了视觉估计噪声,提高了奖励信号的可靠性。此外,自动合成环境的能力使得可以快速生成大量的训练环境,从而加速Agent的训练过程。

关键设计:GUI-GENESIS的关键设计包括:1) 使用多模态代码模型来理解和解析真实世界应用程序的代码。2) 设计了一种轻量级的Web环境表示,以降低环境延迟。3) 使用可执行断言来生成代码原生的奖励信号。4) 采用强化学习算法来训练GUI Agent。具体的参数设置、损失函数和网络结构等技术细节取决于所使用的多模态代码模型和强化学习算法。

🖼️ 关键图片

📊 实验亮点

GUI-GENESIS在实验中表现出色,与在真实应用程序上训练相比,环境延迟降低了10倍,每个epoch的成本降低了超过28,000美元。使用GUI-GENESIS训练的Agent在held-out的真实世界任务上,性能优于基线模型14.54%,甚至优于真实世界的RL基线3.27%。这些结果表明GUI-GENESIS能够有效地提高GUI Agent的训练效率和性能。

🎯 应用场景

GUI-GENESIS具有广泛的应用前景,可用于开发更智能、更高效的GUI Agent,应用于自动化测试、软件机器人、辅助技术等领域。通过自动生成训练环境,可以降低Agent开发的成本和时间,并提高Agent的性能和可靠性。未来,该技术有望推动人机交互领域的发展,实现更自然、更智能的人机协作。

📄 摘要(原文)

Post-training GUI agents in interactive environments is critical for developing generalization and long-horizon planning capabilities. However, training on real-world applications is hindered by high latency, poor reproducibility, and unverifiable rewards relying on noisy visual proxies. To address the limitations, we present GUI-GENESIS, the first framework to automatically synthesize efficient GUI training environments with verifiable rewards. GUI-GENESIS reconstructs real-world applications into lightweight web environments using multimodal code models and equips them with code-native rewards, executable assertions that provide deterministic reward signals and eliminate visual estimation noise. Extensive experiments show that GUI-GENESIS reduces environment latency by 10 times and costs by over $28,000 per epoch compared to training on real applications. Notably, agents trained with GUI-GENESIS outperform the base model by 14.54% and even real-world RL baselines by 3.27% on held-out real-world tasks. Finally, we observe that models can synthesize environments they cannot yet solve, highlighting a pathway for self-improving agents.