Choosing How to Remember: Adaptive Memory Structures for LLM Agents

作者: Mingfei Lu, Mengjia Wu, Feng Liu, Jiawei Xu, Weikai Li, Haoyang Wang, Zhengdong Hu, Ying Ding, Yizhou Sun, Jie Lu, Yi Zhang

分类: cs.AI, cs.LG

发布日期: 2026-02-15

💡 一句话要点

提出FluxMem以解决LLM代理记忆结构选择问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 自适应记忆 记忆结构 长时间交互 机器学习

📋 核心要点

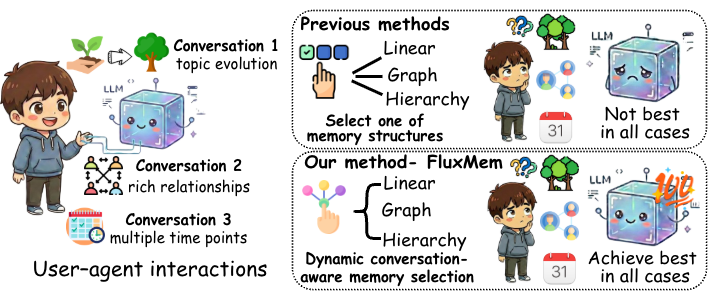

- 现有的LLM代理记忆系统依赖统一的记忆结构,未能适应不同的交互模式,导致性能不足。

- 本文提出FluxMem框架,允许LLM代理根据交互特征自适应选择多种记忆结构,从而优化记忆管理。

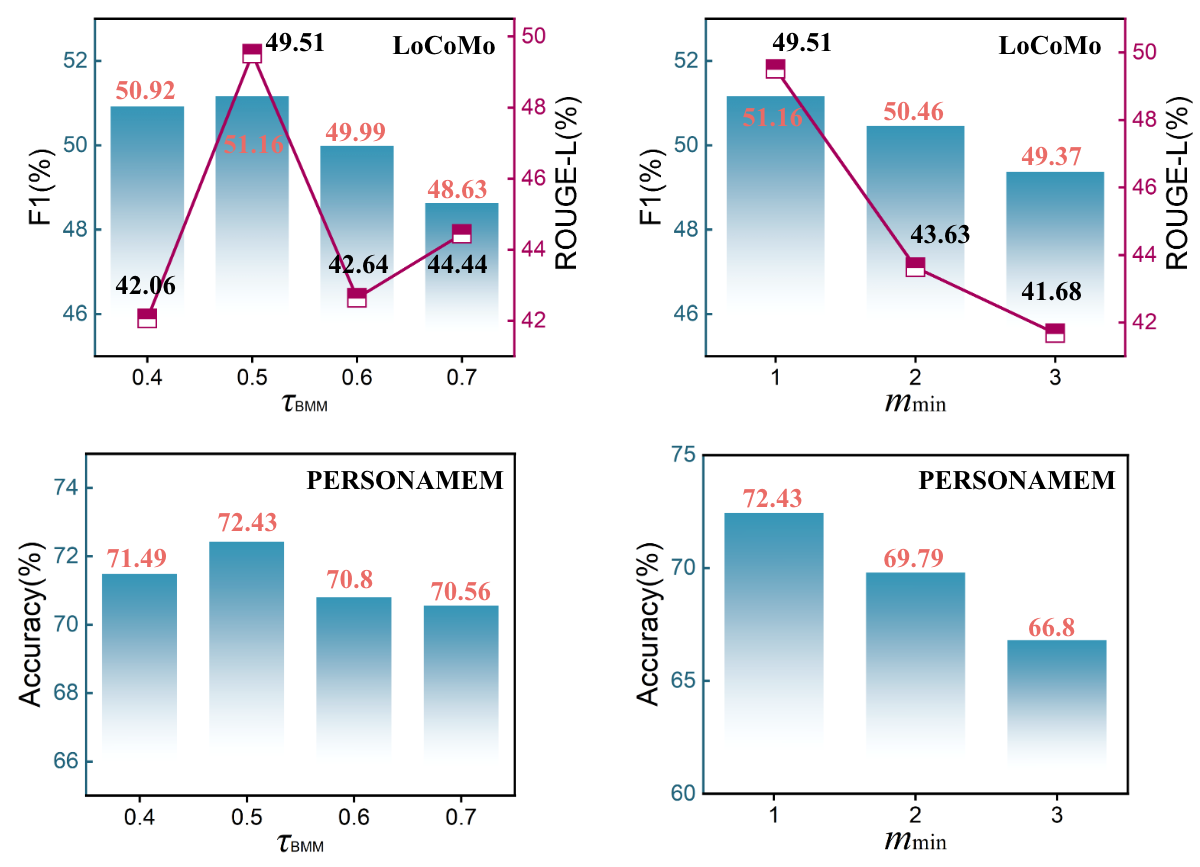

- 在PERSONAMEM和LoCoMo基准测试中,FluxMem方法分别实现了9.18%和6.14%的性能提升,验证了其有效性。

📝 摘要(中文)

记忆对于大型语言模型(LLM)代理在长时间交互中保持一致行为至关重要。然而,现有的代理记忆系统存在两个主要缺陷:依赖于统一的记忆结构,且未将记忆结构选择建模为上下文自适应决策,限制了其处理异构交互模式的能力,导致性能不佳。本文提出了一种统一框架FluxMem,使LLM代理能够自适应地组织记忆。该框架为代理配备了多种互补的记忆结构,并基于交互级特征显式学习在这些结构之间进行选择,使用从下游响应质量和记忆利用率中获得的离线监督。为了支持稳健的长时间记忆演变,我们进一步引入了三层记忆层次结构和基于Beta混合模型的概率门,用于分布感知的记忆融合,替代了脆弱的相似性阈值。在两个长时间基准PERSONAMEM和LoCoMo上的实验表明,我们的方法平均提升了9.18%和6.14%。

🔬 方法详解

问题定义:本文旨在解决现有LLM代理记忆系统的局限性,特别是其对统一记忆结构的依赖和缺乏上下文自适应选择能力,这导致了在异构交互模式下的性能不足。

核心思路:FluxMem框架的核心思想是通过引入多种互补的记忆结构,使代理能够根据具体交互特征自适应选择最合适的记忆方式,从而提升记忆的有效性和灵活性。

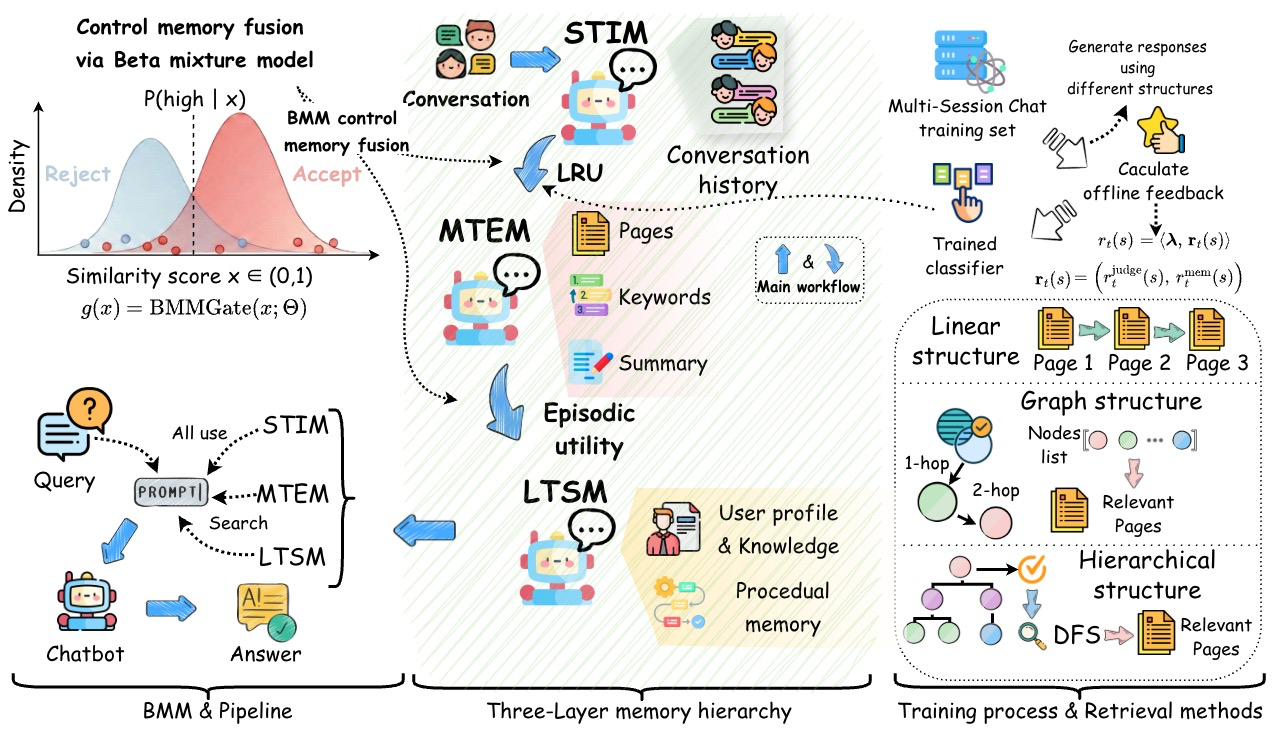

技术框架:FluxMem框架包括多个模块,首先是多种记忆结构的设计,其次是基于交互特征的选择机制,最后是三层记忆层次结构和Beta混合模型的概率门,用于实现记忆的动态融合。

关键创新:本文的主要创新在于提出了一种自适应的记忆结构选择机制,能够根据实时交互特征进行调整,与传统的固定记忆结构方法形成鲜明对比。

关键设计:在设计中,采用了三层记忆层次结构以支持复杂的记忆演变,同时使用Beta混合模型来实现记忆的分布感知融合,避免了传统方法中脆弱的相似性阈值设置。具体的损失函数和网络结构细节在实验部分进行了详细描述。

🖼️ 关键图片

📊 实验亮点

在两个长时间基准测试PERSONAMEM和LoCoMo中,FluxMem方法分别实现了9.18%和6.14%的性能提升,显著优于现有的记忆管理方法,验证了其在长时间交互中的有效性和适应性。

🎯 应用场景

该研究的潜在应用领域包括智能客服、虚拟助手和教育技术等场景,能够显著提升LLM代理在长时间交互中的表现和用户体验。未来,FluxMem框架可能会推动更复杂的记忆管理系统的发展,从而使人工智能代理在多样化任务中表现得更加智能和灵活。

📄 摘要(原文)

Memory is critical for enabling large language model (LLM) based agents to maintain coherent behavior over long-horizon interactions. However, existing agent memory systems suffer from two key gaps: they rely on a one-size-fits-all memory structure and do not model memory structure selection as a context-adaptive decision, limiting their ability to handle heterogeneous interaction patterns and resulting in suboptimal performance. We propose a unified framework, FluxMem, that enables adaptive memory organization for LLM agents. Our framework equips agents with multiple complementary memory structures. It explicitly learns to select among these structures based on interaction-level features, using offline supervision derived from downstream response quality and memory utilization. To support robust long-horizon memory evolution, we further introduce a three-level memory hierarchy and a Beta Mixture Model-based probabilistic gate for distribution-aware memory fusion, replacing brittle similarity thresholds. Experiments on two long-horizon benchmarks, PERSONAMEM and LoCoMo, demonstrate that our method achieves average improvements of 9.18% and 6.14%.