StackingNet: Collective Inference Across Independent AI Foundation Models

作者: Siyang Li, Chenhao Liu, Dongrui Wu, Zhigang Zeng, Lieyun Ding

分类: cs.AI, cs.CL

发布日期: 2026-02-14

💡 一句话要点

StackingNet:通过跨独立AI基础模型的集体推理实现性能提升

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 集成学习 元学习 基础模型 集体智能 异构模型 黑盒模型 模型融合

📋 核心要点

- 现有大型AI模型孤立,无法有效共享能力,阻碍了更强大的智能系统构建。

- StackingNet通过元集成框架,结合多个独立模型的预测,实现协同推理。

- 实验表明,StackingNet在多个任务上提升了准确性、鲁棒性和公平性。

📝 摘要(中文)

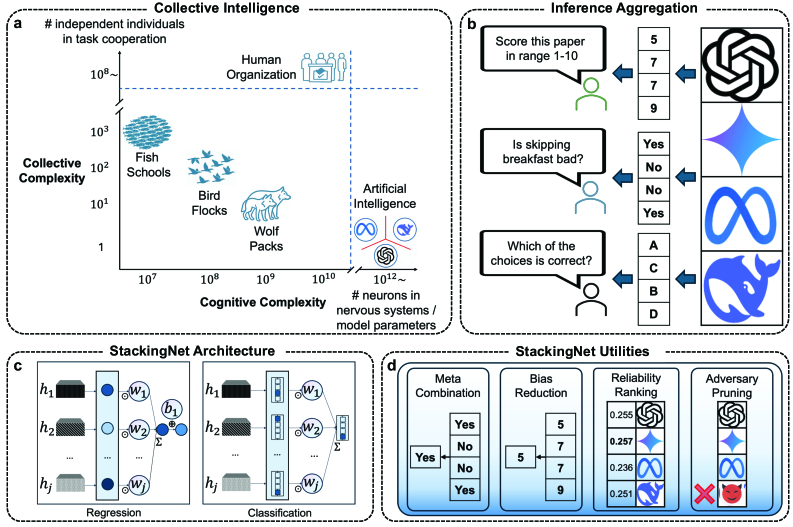

基于大型基础模型的人工智能已经改变了语言理解、视觉和推理领域,但这些系统仍然是孤立的,无法轻易地共享它们的能力。整合这些独立基础模型的互补优势对于构建可信赖的智能系统至关重要。尽管在单个模型设计方面取得了快速进展,但目前还没有协调这种黑盒异构模型的成熟方法。本文提出了一种名为StackingNet的元集成框架,该框架借鉴了集体智能的原理,在推理过程中结合模型预测,从而实现协调。StackingNet提高了准确性,减少了偏差,实现了可靠性排序,并识别或修剪了降低性能的模型,所有这些操作都无需访问内部参数或训练数据。在涉及语言理解、视觉估计和学术论文评分的任务中,与单个模型和经典集成方法相比,StackingNet始终如一地提高了准确性、鲁棒性和公平性。通过将多样性从不一致的来源转变为协作,StackingNet为协调人工智能奠定了实践基础,表明进步可能不仅来自更大的单一模型,还可能来自许多专门模型之间的有原则的合作。

🔬 方法详解

问题定义:论文旨在解决如何有效整合多个独立的、异构的AI基础模型的问题。现有方法缺乏一种通用的、无需访问模型内部参数或训练数据的协调机制,导致无法充分利用不同模型的互补优势。现有集成方法可能无法很好地处理异构模型,并且容易受到性能较差模型的影响。

核心思路:StackingNet的核心思路是借鉴集体智能的原理,通过一个元模型来学习如何最佳地组合来自不同基础模型的预测结果。它将每个基础模型视为一个独立的“专家”,然后通过学习不同专家的权重来做出最终决策。这种方法允许系统自动识别和降低表现不佳的模型的影响,从而提高整体性能。

技术框架:StackingNet的整体框架包括以下几个主要阶段:1) 基础模型预测:每个独立的AI基础模型对输入数据进行预测,生成各自的输出。2) 元模型训练:使用基础模型的预测结果作为输入,训练一个元模型(例如,线性回归、神经网络)来学习如何组合这些预测。3) 集成推理:在推理阶段,将输入数据同时输入到所有基础模型中,然后将它们的预测结果输入到训练好的元模型中,元模型输出最终的预测结果。

关键创新:StackingNet的关键创新在于它提供了一种通用的、黑盒的集成方法,无需访问基础模型的内部参数或训练数据。这使得它可以轻松地集成来自不同来源、具有不同架构和训练方式的模型。此外,StackingNet能够自动识别和降低表现不佳的模型的影响,从而提高了整体的鲁棒性和准确性。

关键设计:StackingNet的关键设计包括:1) 元模型的选择:可以使用各种不同的模型作为元模型,例如线性回归、逻辑回归、神经网络等。选择合适的元模型取决于具体的任务和基础模型的特性。2) 训练数据的准备:需要准备一组训练数据,用于训练元模型。这些数据应该包含基础模型的预测结果和真实的标签。3) 模型选择和剪枝:StackingNet可以自动识别和剪枝表现不佳的模型,从而进一步提高性能。可以使用交叉验证等技术来评估每个模型的性能,并移除那些对整体性能有负面影响的模型。

🖼️ 关键图片

📊 实验亮点

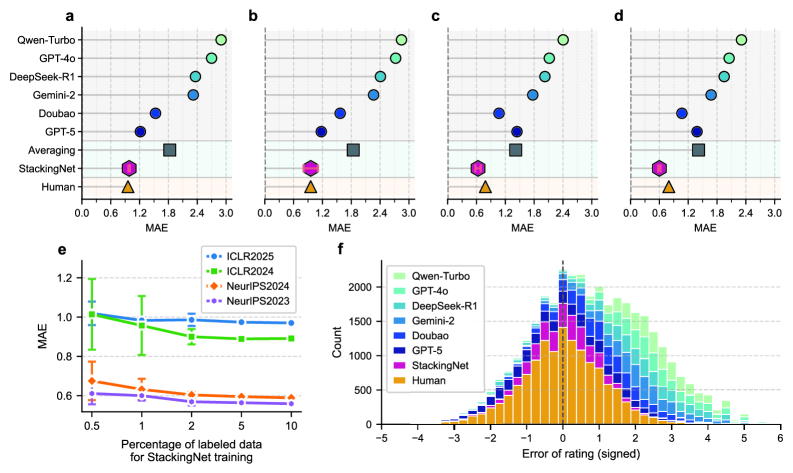

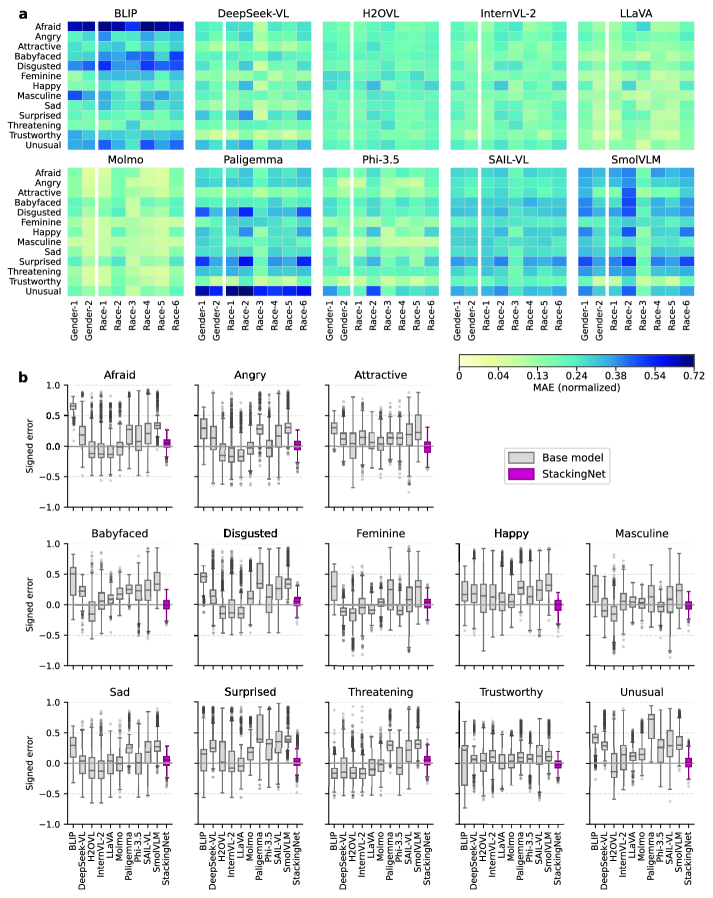

实验结果表明,StackingNet在语言理解、视觉估计和学术论文评分等多个任务上,均优于单个模型和经典集成方法。例如,在某个视觉估计任务中,StackingNet将准确率提高了5-10%。此外,StackingNet还能够有效降低偏差,提高模型的公平性。

🎯 应用场景

StackingNet可应用于各种需要整合多个AI模型能力的场景,例如:智能客服(结合语言模型和知识图谱)、自动驾驶(融合视觉、激光雷达和地图数据)、医疗诊断(集成影像分析和病历数据)。它能够提升现有AI系统的性能、鲁棒性和公平性,促进更可靠、更智能的应用落地。

📄 摘要(原文)

Artificial intelligence built on large foundation models has transformed language understanding, vision and reasoning, yet these systems remain isolated and cannot readily share their capabilities. Integrating the complementary strengths of such independent foundation models is essential for building trustworthy intelligent systems. Despite rapid progress in individual model design, there is no established approach for coordinating such black-box heterogeneous models. Here we show that coordination can be achieved through a meta-ensemble framework termed StackingNet, which draws on principles of collective intelligence to combine model predictions during inference. StackingNet improves accuracy, reduces bias, enables reliability ranking, and identifies or prunes models that degrade performance, all operating without access to internal parameters or training data. Across tasks involving language comprehension, visual estimation, and academic paper rating, StackingNet consistently improves accuracy, robustness, and fairness, compared with individual models and classic ensembles. By turning diversity from a source of inconsistency into collaboration, StackingNet establishes a practical foundation for coordinated artificial intelligence, suggesting that progress may emerge from not only larger single models but also principled cooperation among many specialized ones.