Never say never: Exploring the effects of available knowledge on agent persuasiveness in controlled physiotherapy motivation dialogues

作者: Stephan Vonschallen, Rahel Häusler, Theresa Schmiedel, Friederike Eyssel

分类: cs.HC, cs.AI

发布日期: 2026-02-13 (更新: 2026-02-20)

💡 一句话要点

通过知识配置提升生成式社交Agent在理疗激励对话中的说服力

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 生成式社交Agent 说服力 知识配置 人机对话 理疗激励

📋 核心要点

- 现有生成式社交Agent的说服能力存在潜在风险,如操纵和欺骗,源于对其输出控制的不足。

- 本研究通过控制ChatGPT对患者信息的访问,探索知识配置对Agent在理疗激励对话中说服力的影响。

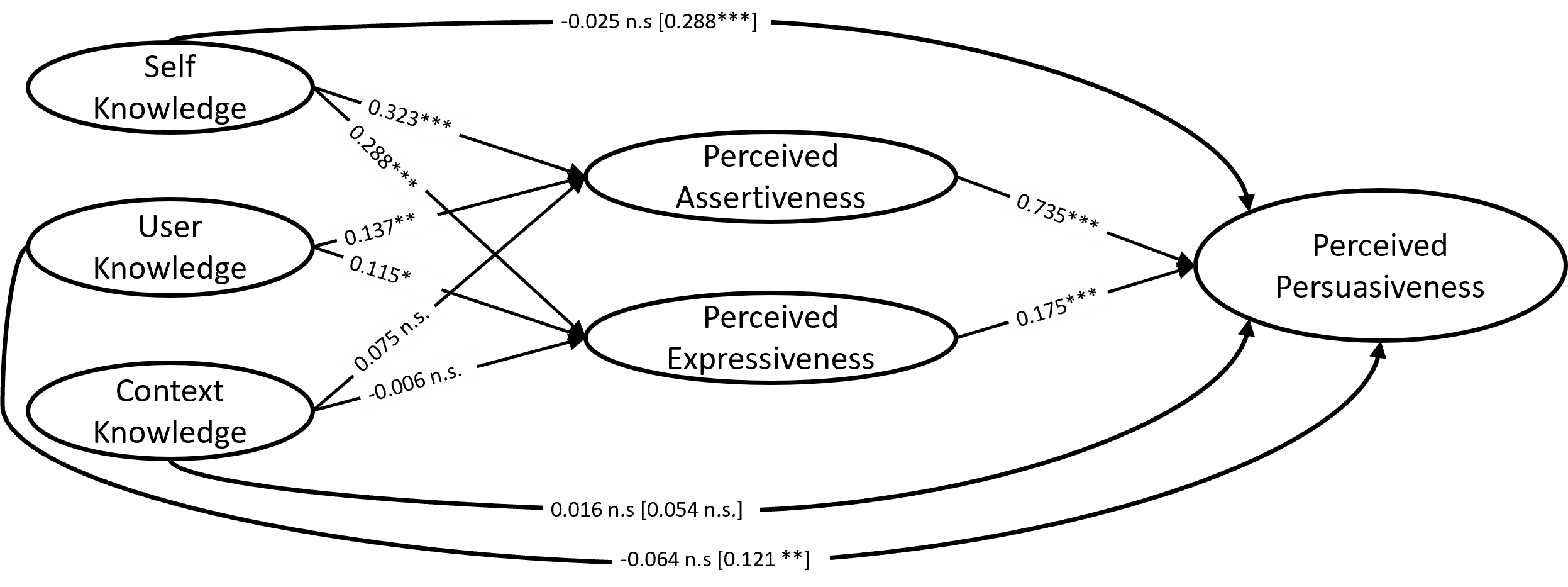

- 实验表明,提供患者年龄和职业信息能显著提升Agent的说服力,且自信心和表现力在其中起中介作用。

📝 摘要(中文)

生成式社交Agent (GSAs) 正通过其说服能力日益影响人类用户。一方面,它们可以激励用户追求个人目标,例如更健康的生活方式。另一方面,它们也与潜在的风险相关,如操纵和欺骗,这些风险是由对概率性Agent输出的有限控制所引起的。然而,由于GSAs基于可用的知识来表现其沟通模式,因此可以通过控制它们对这些知识的访问来调节其行为。基于此,我们探索了在人机理疗激励场景中,ChatGPT生成的具有说服力的消息。我们通过比较ChatGPT对假设理疗患者的预定义输入的响应来实现这一点。在研究1中,我们定性分析了13个ChatGPT生成的对话脚本,这些脚本在关于说服性消息特征的知识配置方面有所不同。在研究2中,第三方观察者(N = 27)根据Agent的表现力、自信心和说服力对这些对话的选择进行了评分。我们的研究结果表明,基于LLM的GSAs可以适应自信和富有表现力的人格特征,从而显著增强感知到的说服力。此外,关于患者年龄和过去职业的信息显著提高了说服力,这种提高由感知到的自信心和表现力所介导。关于理疗益处的背景知识并没有显著影响说服力,这可能是因为即使没有明确的提示,LLM也具有关于这些益处的内在知识。总的来说,这项研究强调了实证研究GSAs行为模式的重要性,特别是在生成式AI系统需要哪些信息才能进行一致和负责任的沟通方面。

🔬 方法详解

问题定义:论文旨在研究在人机理疗激励对话中,如何通过控制生成式社交Agent (GSA) 的知识获取,来提升其说服力。现有方法的问题在于,对GSA的说服行为缺乏有效的控制,可能导致操纵和欺骗等负面影响。

核心思路:论文的核心思路是,GSA的说服力与其所拥有的知识密切相关。通过控制GSA对患者信息的访问,可以调节其沟通模式,从而影响其说服力。具体而言,论文关注不同类型的知识(如患者年龄、职业、理疗益处)对GSA说服力的影响。

技术框架:研究分为两个阶段。第一阶段,研究人员使用ChatGPT生成13个对话脚本,这些脚本基于不同的知识配置。知识配置包括是否提供患者的年龄、职业以及理疗益处等信息。第二阶段,27名第三方观察者对这些对话脚本进行评估,评估指标包括Agent的表现力、自信心和说服力。研究人员分析了知识配置与Agent说服力之间的关系,以及表现力和自信心在其中的中介作用。

关键创新:该研究的关键创新在于,它实证地研究了知识配置对GSA说服力的影响。以往的研究主要关注GSA的生成模型和对话策略,而忽略了知识在说服过程中的作用。该研究表明,提供适当的知识可以显著提升GSA的说服力,并有助于控制其行为。

关键设计:研究的关键设计包括:1) 使用ChatGPT作为GSA的实现;2) 设计不同的知识配置,包括是否提供患者的年龄、职业以及理疗益处等信息;3) 使用第三方观察者进行主观评估,评估指标包括Agent的表现力、自信心和说服力;4) 使用统计分析方法,分析知识配置与Agent说服力之间的关系,以及表现力和自信心在其中的中介作用。

🖼️ 关键图片

📊 实验亮点

研究发现,提供患者的年龄和职业信息能够显著提升Agent的说服力。具体而言,与没有提供这些信息的Agent相比,提供了年龄和职业信息的Agent的说服力评分显著提高。此外,研究还发现,Agent的表现力和自信心在知识配置与说服力之间起中介作用,即提供更多信息使得Agent更自信和更具表现力,从而更具说服力。

🎯 应用场景

该研究成果可应用于开发更有效、更负责任的健康干预系统。通过控制Agent所拥有的知识,可以提升其在理疗、心理咨询等领域的说服力,从而帮助用户更好地实现健康目标。此外,该研究也为设计更安全、更可信赖的社交Agent提供了指导。

📄 摘要(原文)

Generative Social Agents (GSAs) are increasingly impacting human users through persuasive means. On the one hand, they might motivate users to pursue personal goals, such as healthier lifestyles. On the other hand, they are associated with potential risks like manipulation and deception, which are induced by limited control over probabilistic agent outputs. However, as GSAs manifest communicative patterns based on available knowledge, their behavior may be regulated through their access to such knowledge. Following this approach, we explored persuasive ChatGPT-generated messages in the context of human-robot physiotherapy motivation. We did so by comparing ChatGPT-generated responses to predefined inputs from a hypothetical physiotherapy patient. In Study 1, we qualitatively analyzed 13 ChatGPT-generated dialogue scripts with varying knowledge configurations regarding persuasive message characteristics. In Study 2, third-party observers (N = 27) rated a selection of these dialogues in terms of the agent's expressiveness, assertiveness, and persuasiveness. Our findings indicate that LLM-based GSAs can adapt assertive and expressive personality traits - significantly enhancing perceived persuasiveness. Moreover, persuasiveness significantly benefited from the availability of information about the patients' age and past profession, mediated by perceived assertiveness and expressiveness. Contextual knowledge about physiotherapy benefits did not significantly impact persuasiveness, possibly because the LLM had inherent knowledge about such benefits even without explicit prompting. Overall, the study highlights the importance of empirically studying behavioral patterns of GSAs, specifically in terms of what information generative AI systems require for consistent and responsible communication.