Knowledge-Based Design Requirements for Generative Social Robots in Higher Education

作者: Stephan Vonschallen, Dominique Oberle, Theresa Schmiedel, Friederike Eyssel

分类: cs.HC, cs.AI

发布日期: 2026-02-13 (更新: 2026-02-18)

💡 一句话要点

针对高等教育中生成式社交机器人,提出基于知识的设计需求框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 生成式社交机器人 知识库 高等教育 人机交互 教育技术

📋 核心要点

- 现有教育技术框架缺乏对生成式社交机器人知识前提的明确规定,导致其在教育应用中存在潜在风险。

- 论文提出基于知识的设计视角,通过访谈确定了GSRs在高等教育中所需的自我、用户和上下文三种知识类型。

- 该研究为辅导GSRs的设计和评估提供了结构化基础,旨在将生成式系统的能力与教学和伦理期望对齐。

📝 摘要(中文)

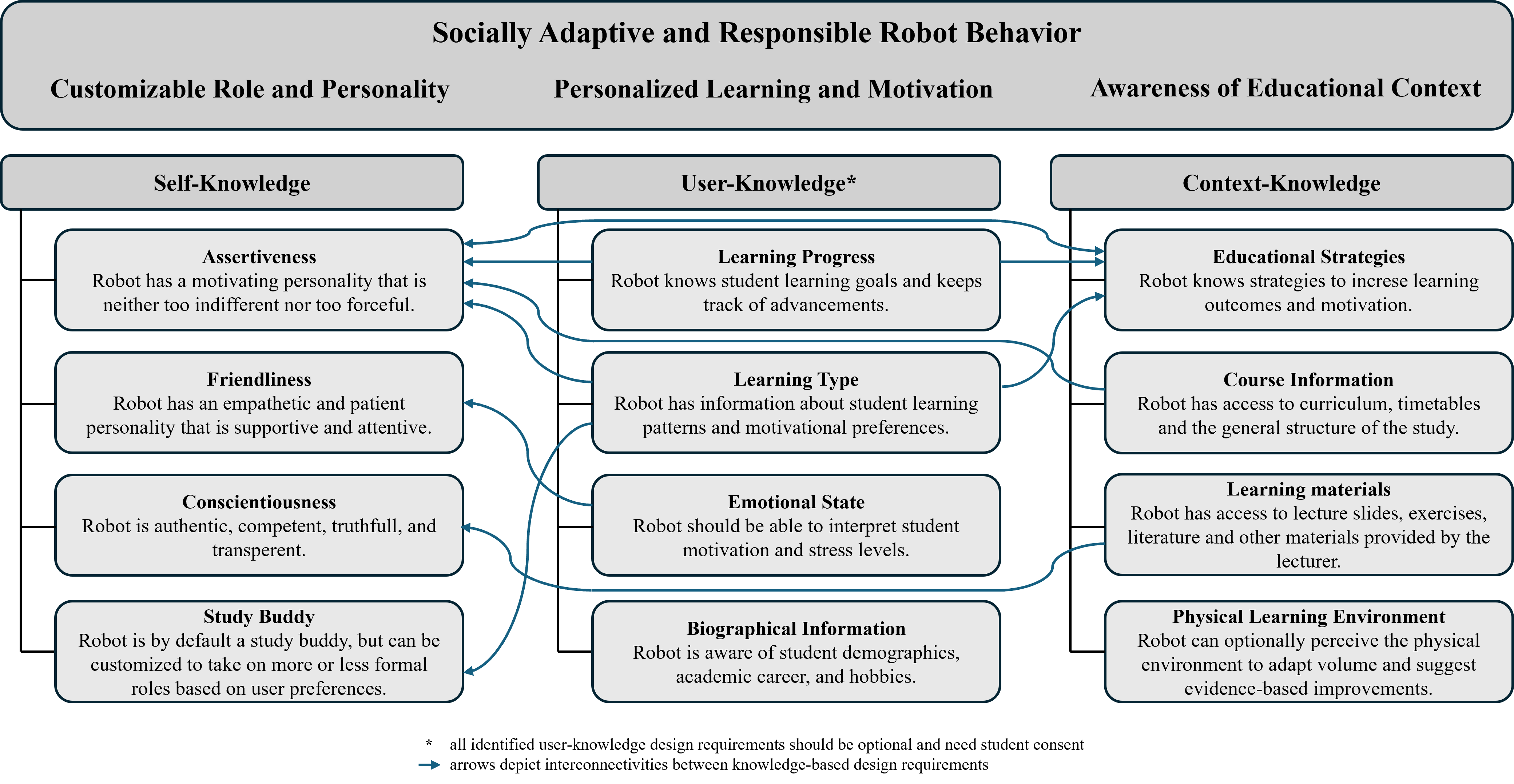

生成式社交机器人(GSRs)由大型语言模型驱动,能够实现自适应的对话式辅导,但也引入了幻觉、过度依赖和隐私侵犯等风险。现有的教育技术和负责任的AI框架主要定义了期望的行为,但很少明确生成式系统可靠地表达这些行为所需的知识前提。为了解决这一差距,我们采用基于知识的设计视角,研究面向辅导的GSRs在高等教育中负责任且有效地运作需要哪些信息。基于对大学学生和讲师的十二次半结构化访谈,我们确定了跨越三种知识类型的十二项设计需求:自我知识(具有可定制角色的自信、尽责和友好的个性),用户知识(关于学生学习目标、学习进度、动机类型、情绪状态和背景的个性化信息),以及上下文知识(学习材料、教育策略、课程相关信息和物理学习环境)。通过识别这些知识需求,这项工作为辅导GSRs的设计和未来评估提供了一个结构化的基础,使生成式系统的能力与教学和伦理期望相一致。

🔬 方法详解

问题定义:论文旨在解决高等教育中生成式社交机器人(GSRs)的设计问题,特别是如何确保这些机器人能够负责任且有效地进行辅导。现有方法主要关注GSRs的行为表现,而忽略了支撑这些行为的知识基础。这导致GSRs可能产生幻觉、过度依赖,甚至侵犯学生隐私,无法满足教育场景的伦理和教学需求。

核心思路:论文的核心思路是采用基于知识的设计视角,明确GSRs在高等教育环境中进行有效辅导所需的知识类型和内容。通过识别这些知识需求,可以为GSRs的设计提供更坚实的基础,从而提高其可靠性、安全性和有效性。这种方法强调了知识作为GSRs行为能力的基础,而非仅仅关注其行为表现。

技术框架:论文采用半结构化访谈方法,与大学学生和讲师进行了十二次访谈。访谈内容围绕GSRs在辅导过程中需要哪些知识展开。研究人员对访谈记录进行分析,识别出三种关键的知识类型:自我知识(关于机器人自身的角色、个性和能力),用户知识(关于学生的学习目标、进度、动机和背景),以及上下文知识(关于课程内容、教学策略和学习环境)。基于这些知识类型,论文进一步提出了十二项具体的设计需求。

关键创新:论文的关键创新在于将知识作为GSRs设计的重要组成部分,并明确了在高等教育环境中进行有效辅导所需的具体知识类型和内容。与以往主要关注GSRs行为表现的研究不同,该论文强调了知识对于GSRs可靠性和安全性的重要性。这种基于知识的设计方法为GSRs在教育领域的应用提供了新的视角。

关键设计:论文的关键设计在于对三种知识类型的划分和对十二项设计需求的具体描述。例如,自我知识包括GSRs需要具备自信、尽责和友好的个性,并且能够根据不同的角色进行定制。用户知识包括GSRs需要了解学生的学习目标、学习进度、动机类型、情绪状态和背景信息。上下文知识包括GSRs需要掌握学习材料、教育策略、课程相关信息和物理学习环境。这些设计需求为GSRs的知识库构建和知识推理提供了具体的指导。

🖼️ 关键图片

📊 实验亮点

论文通过访谈明确了高等教育场景下GSRs所需的12项设计需求,并将其归纳为自我知识、用户知识和上下文知识三大类。这些需求为GSRs的设计提供了具体指导,有助于提升其在教育领域的应用效果和伦理安全性。该研究为后续的GSRs设计和评估奠定了基础。

🎯 应用场景

该研究成果可应用于开发更智能、更负责任的教育机器人,提升个性化学习体验。通过构建包含自我、用户和上下文知识的知识库,GSRs能够提供更精准的辅导,并有效避免幻觉和不当行为。此外,该框架还可推广到其他需要人机交互的领域,如医疗、养老等。

📄 摘要(原文)

Generative social robots (GSRs) powered by large language models enable adaptive, conversational tutoring but also introduce risks such as hallucinations, overreliance, and privacy violations. Existing frameworks for educational technologies and responsible AI primarily define desired behaviors, yet they rarely specify the knowledge prerequisites that enable generative systems to express these behaviors reliably. To address this gap, we adopt a knowledge-based design perspective and investigate what information tutoring-oriented GSRs require to function responsibly and effectively in higher education. Based on twelve semi-structured interviews with university students and lecturers, we identify twelve design requirements across three knowledge types: self-knowledge (assertive, conscientious and friendly personality with customizable role), user-knowledge (personalized information about student learning goals, learning progress, motivation type, emotional state and background), and context-knowledge (learning materials, educational strategies, course-related information, and physical learning environment). By identifying these knowledge requirements, this work provides a structured foundation for the design of tutoring GSRs and future evaluations, aligning generative system capabilities with pedagogical and ethical expectations.