TensorCommitments: A Lightweight Verifiable Inference for Language Models

作者: Oguzhan Baser, Elahe Sadeghi, Eric Wang, David Ribeiro Alves, Sam Kazemian, Hong Kang, Sandeep P. Chinchali, Sriram Vishwanath

分类: cs.CR, cs.AI

发布日期: 2026-02-13

备注: 23 pages, 8 figures, under review

💡 一句话要点

TensorCommitments:一种轻量级的语言模型可验证推理方案

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可验证推理 语言模型 张量承诺 Terkle树 LLM安全

📋 核心要点

- 现有LLM推理依赖云服务,用户需信任服务提供商,缺乏对推理过程正确性的验证手段。

- TensorCommitments (TCs) 提出了一种张量原生的推理证明方案,通过承诺机制绑定推理过程,实现可验证性。

- 实验表明,TCs 在 LLaMA2 上开销极低,同时显著提升了对定制 LLM 攻击的鲁棒性。

📝 摘要(中文)

大型语言模型(LLM)通常在外部云端运行,用户发送提示并付费进行推理,但必须信任远程GPU能够正确执行LLM,而不会受到任何对抗性篡改。本文探讨了如何实现可验证的LLM推理,即证明者(服务提供商)必须说服验证者(客户端)推理已正确运行,而无需重新运行LLM。现有的密码学方法在LLM规模上速度太慢,而非密码学方法则需要强大的验证者GPU。本文提出了TensorCommitments(TCs),一种张量原生的推理证明方案。TC将LLM推理绑定到一个承诺(commitment),这是一种不可逆转的标签,在受到篡改时会失效,并以我们的多元Terkle树进行组织。对于LLaMA2,TC仅在推理过程中增加了0.97%的证明者时间和0.12%的验证者时间,同时相比于需要验证者GPU的最佳现有方法,将针对定制LLM攻击的鲁棒性提高了高达48%。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)推理过程的可验证性问题。现有方法要么依赖计算代价高昂的密码学方案,要么需要验证方具备强大的GPU算力,这限制了其在实际场景中的应用。用户需要一种轻量级的、高效的验证方法,以确保LLM推理结果的可靠性,防止恶意篡改。

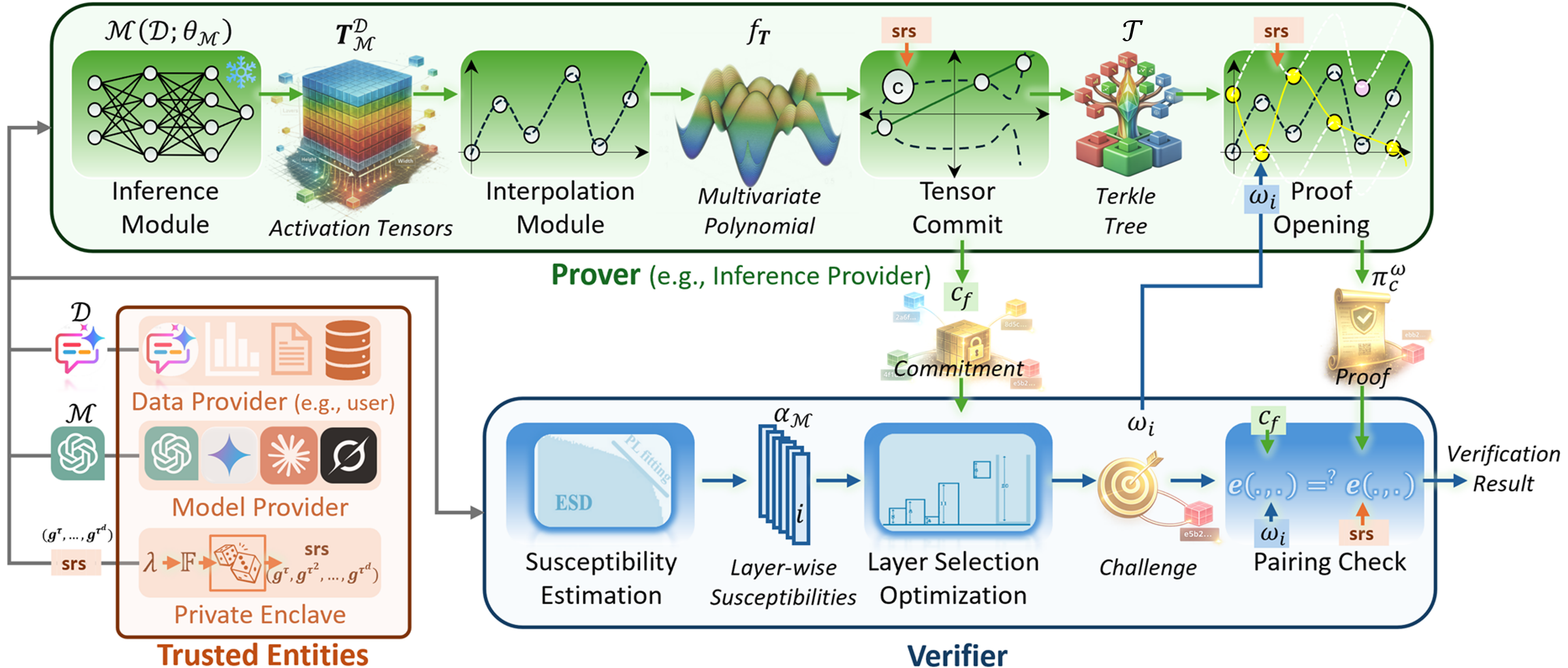

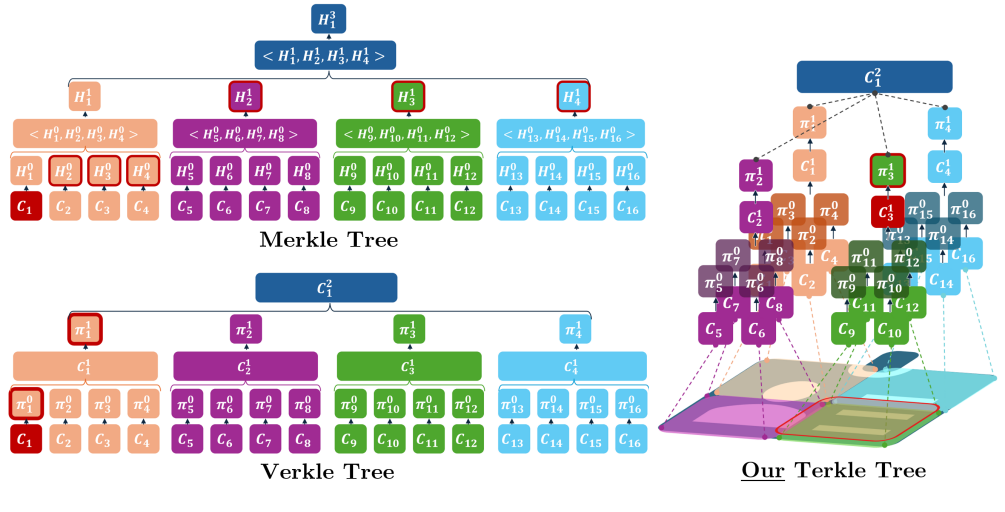

核心思路:论文的核心思路是利用张量承诺(Tensor Commitments, TCs)将LLM的推理过程绑定到一个不可篡改的承诺值上。通过构建多元Terkle树,将LLM的中间层张量数据进行哈希,生成一个根哈希值作为承诺。任何对中间层张量的篡改都会导致承诺值发生变化,从而被验证方检测到。这种方法避免了重新运行整个LLM进行验证,降低了计算开销。

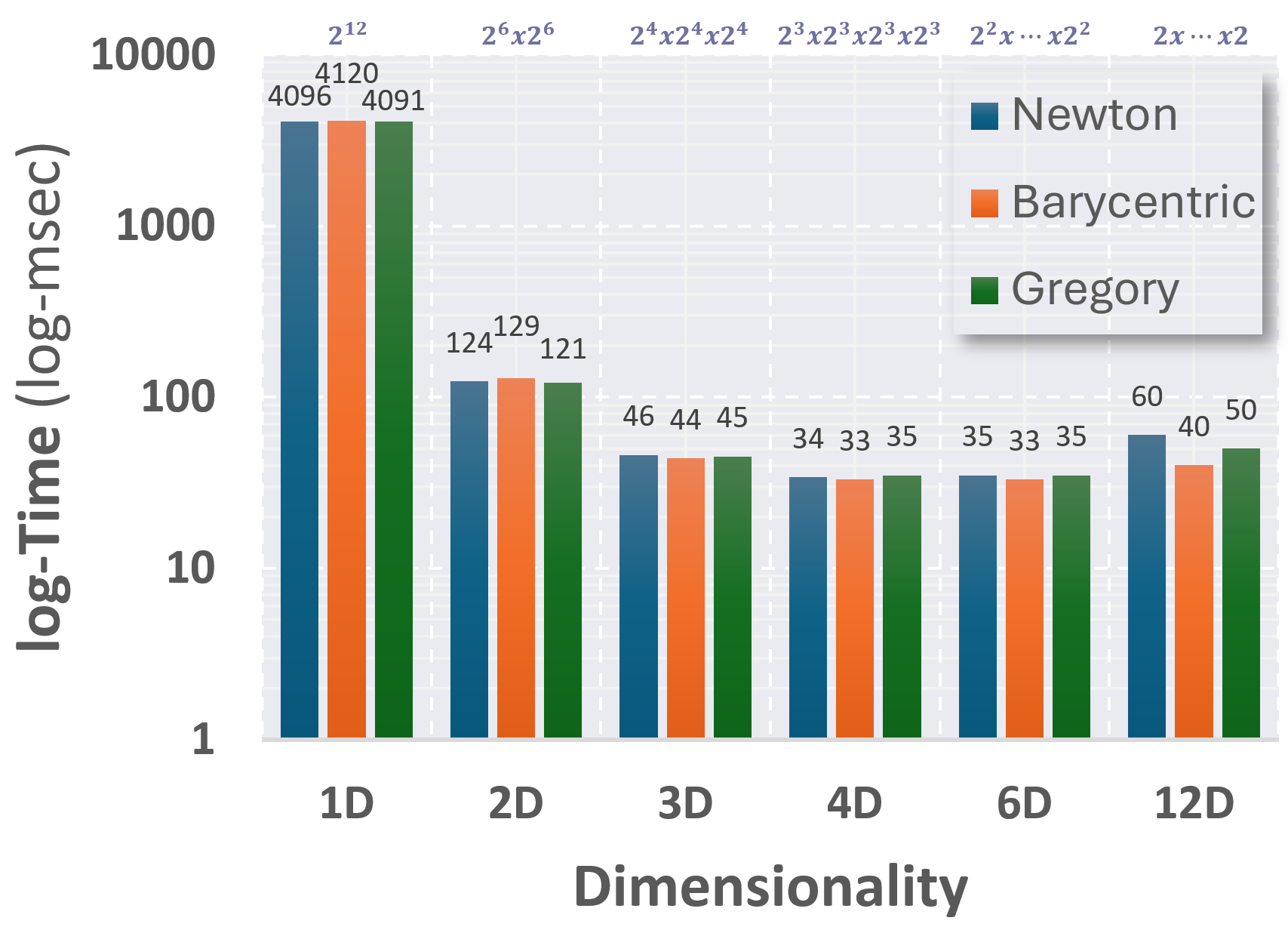

技术框架:TensorCommitments 的整体框架包含以下几个主要阶段: 1. LLM推理:服务提供商运行LLM,并记录中间层的张量数据。 2. 构建多元Terkle树:将中间层张量数据组织成多元Terkle树,每个节点存储其子节点的哈希值,最终生成根哈希值作为承诺。 3. 生成证明:服务提供商向验证方提供承诺值(根哈希)以及部分中间层张量数据和相应的哈希值,作为推理过程的证明。 4. 验证:验证方使用收到的数据重新计算部分Terkle树的哈希值,并与承诺值进行比较,以验证推理过程的正确性。

关键创新:TensorCommitments 的关键创新在于其张量原生的设计和多元Terkle树的构建。与传统的密码学方法相比,TCs 直接操作LLM的张量数据,避免了复杂的加密运算,从而显著降低了计算开销。多元Terkle树的设计使得验证方可以只验证部分中间层张量,进一步降低了验证成本。此外,TCs 能够有效检测针对LLM的定制攻击,提高了模型的安全性。

关键设计:多元Terkle树的设计是关键。树的深度和分支因子需要根据LLM的规模和验证需求进行调整。哈希函数的选择也很重要,需要选择抗碰撞性强的哈希函数,以确保承诺值的安全性。此外,证明过程中需要选择哪些中间层张量进行验证,需要在计算开销和安全性之间进行权衡。论文中可能还涉及一些优化策略,例如利用GPU加速哈希计算等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,对于LLaMA2模型,TensorCommitments仅增加了0.97%的证明者时间和0.12%的验证者时间。同时,相比于需要验证者GPU的最佳现有方法,TCs将针对定制LLM攻击的鲁棒性提高了高达48%。这些数据表明,TCs 是一种高效且实用的LLM可验证推理方案。

🎯 应用场景

TensorCommitments 可应用于各种需要可验证LLM推理的场景,例如金融风控、医疗诊断、法律咨询等。它可以确保LLM推理结果的可靠性,防止恶意篡改,提高用户对LLM服务的信任度。未来,该技术有望推广到更广泛的AI服务领域,促进AI技术的安全可靠应用。

📄 摘要(原文)

Most large language models (LLMs) run on external clouds: users send a prompt, pay for inference, and must trust that the remote GPU executes the LLM without any adversarial tampering. We critically ask how to achieve verifiable LLM inference, where a prover (the service) must convince a verifier (the client) that an inference was run correctly without rerunning the LLM. Existing cryptographic works are too slow at the LLM scale, while non-cryptographic ones require a strong verifier GPU. We propose TensorCommitments (TCs), a tensor-native proof-of-inference scheme. TC binds the LLM inference to a commitment, an irreversible tag that breaks under tampering, organized in our multivariate Terkle Trees. For LLaMA2, TC adds only 0.97% prover and 0.12% verifier time over inference while improving robustness to tailored LLM attacks by up to 48% over the best prior work requiring a verifier GPU.