RQ-GMM: Residual Quantized Gaussian Mixture Model for Multimodal Semantic Discretization in CTR Prediction

作者: Ziye Tong, Jiahao Liu, Weimin Zhang, Hongji Ruan, Derick Tang, Zhanpeng Zeng, Qinsong Zeng, Peng Zhang, Tun Lu, Ning Gu

分类: cs.IR, cs.AI

发布日期: 2026-02-13

备注: Under review

💡 一句话要点

提出RQ-GMM,用于CTR预测中多模态语义离散化,提升点击率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 点击率预测 多模态学习 语义离散化 高斯混合模型 残差量化 推荐系统 CTR预估

📋 核心要点

- 现有CTR模型直接使用连续嵌入向量效果欠佳,原因是优化目标不一致和收敛速度不同步,离散化嵌入向量是更优方案。

- RQ-GMM的核心思想是利用高斯混合模型对多模态嵌入空间进行概率建模,结合残差量化提升码本利用率和重构精度。

- 实验结果表明,RQ-GMM在公共数据集和在线A/B测试中均取得了显著提升,广告商价值提升了1.502%,并已大规模部署。

📝 摘要(中文)

多模态内容对于点击率(CTR)预测至关重要。然而,直接将预训练模型的连续嵌入向量融入CTR模型中,由于优化目标不一致以及联合训练期间收敛速度不同步,会导致次优结果。将嵌入向量离散化为语义ID再输入CTR模型是一种更有效的方法,但现有方法存在码本利用率、重构精度和语义区分性有限的问题。我们提出了残差量化高斯混合模型(RQ-GMM),它引入概率建模以更好地捕捉多模态嵌入空间的统计结构。通过高斯混合模型与残差量化相结合,RQ-GMM实现了卓越的码本利用率和重构精度。在公共数据集和大规模短视频平台上的在线A/B测试表明,RQ-GMM取得了显著的改进:与强大的基线相比,广告商价值提升了1.502%。该方法已全面部署,为数亿用户提供每日推荐服务。

🔬 方法详解

问题定义:论文旨在解决CTR预测中,如何有效利用多模态内容嵌入向量的问题。现有方法直接使用连续嵌入向量,存在优化目标不一致和收敛速度不同步的问题,导致CTR预测效果不佳。而现有的离散化方法,如聚类或量化,又存在码本利用率低、重构精度差以及语义区分性不足的痛点。

核心思路:论文的核心思路是利用概率模型,更准确地捕捉多模态嵌入空间的统计结构。具体而言,使用高斯混合模型(GMM)对嵌入空间进行建模,每个高斯分量代表一个潜在的语义类别。然后,通过残差量化(Residual Quantization)对每个嵌入向量进行编码,使其能够更好地利用码本,并提高重构精度。这样设计的目的是为了在离散化的同时,尽可能保留原始嵌入向量的语义信息,从而提升CTR预测的准确性。

技术框架:RQ-GMM的整体框架可以分为两个主要阶段:离线训练阶段和在线预测阶段。在离线训练阶段,首先使用预训练模型提取多模态内容的嵌入向量,然后使用GMM对嵌入空间进行建模,学习每个高斯分量的参数(均值、方差、权重)。接着,使用残差量化对每个嵌入向量进行编码,生成对应的语义ID。在线预测阶段,对于每个用户和物品,首先提取其多模态内容的嵌入向量,然后使用训练好的GMM和残差量化器将其编码为语义ID,最后将这些ID输入到CTR模型中进行预测。

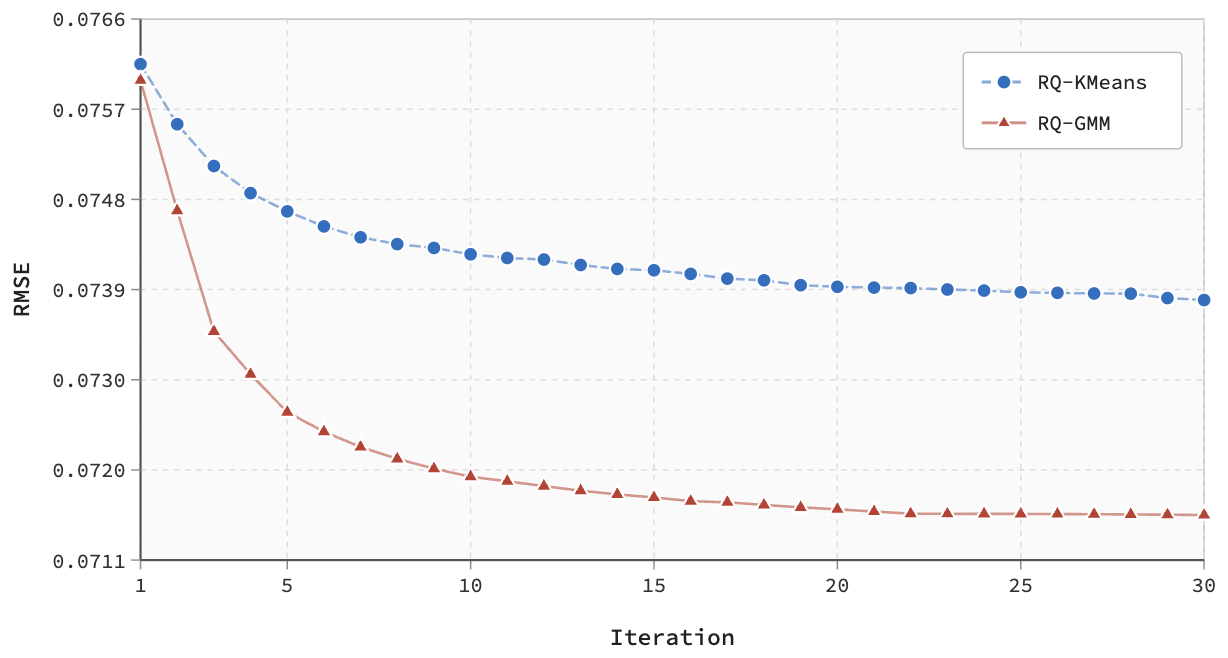

关键创新:RQ-GMM最重要的技术创新点在于将概率建模和残差量化相结合。与传统的聚类或量化方法相比,GMM能够更准确地捕捉嵌入空间的复杂结构,从而提高码本的利用率和语义区分性。而残差量化则能够进一步提高重构精度,减少信息损失。这种结合使得RQ-GMM能够在离散化的同时,尽可能保留原始嵌入向量的语义信息,从而提升CTR预测的准确性。

关键设计:RQ-GMM的关键设计包括:1) GMM的参数初始化方法,例如使用K-means进行初始化;2) GMM的训练方法,例如使用EM算法进行迭代优化;3) 残差量化的码本大小和量化层数;4) 损失函数的设计,例如可以使用重构误差作为损失函数,也可以结合CTR预测的损失函数进行联合优化;5) CTR模型的选择,例如可以使用DeepFM、xDeepFM等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RQ-GMM在公共数据集上取得了显著的性能提升,并且在大规模短视频平台的在线A/B测试中,广告商价值提升了1.502%。这一提升表明RQ-GMM能够有效地捕捉多模态内容的语义信息,并将其融入到CTR预测中,从而提高推荐系统的准确性和效果。与现有的基线方法相比,RQ-GMM在码本利用率和重构精度方面均有显著优势。

🎯 应用场景

RQ-GMM可广泛应用于各种需要利用多模态内容进行推荐或预测的场景,例如短视频推荐、电商推荐、新闻推荐等。通过将连续的嵌入向量离散化为语义ID,RQ-GMM可以更好地融入现有的CTR模型,提升推荐系统的性能和效果。该研究的实际价值在于能够提高推荐系统的点击率和转化率,从而为平台带来更多的商业收益。未来,RQ-GMM还可以与其他技术相结合,例如知识图谱、注意力机制等,进一步提升推荐系统的智能化水平。

📄 摘要(原文)

Multimodal content is crucial for click-through rate (CTR) prediction. However, directly incorporating continuous embeddings from pre-trained models into CTR models yields suboptimal results due to misaligned optimization objectives and convergence speed inconsistency during joint training. Discretizing embeddings into semantic IDs before feeding them into CTR models offers a more effective solution, yet existing methods suffer from limited codebook utilization, reconstruction accuracy, and semantic discriminability. We propose RQ-GMM (Residual Quantized Gaussian Mixture Model), which introduces probabilistic modeling to better capture the statistical structure of multimodal embedding spaces. Through Gaussian Mixture Models combined with residual quantization, RQ-GMM achieves superior codebook utilization and reconstruction accuracy. Experiments on public datasets and online A/B tests on a large-scale short-video platform serving hundreds of millions of users demonstrate substantial improvements: RQ-GMM yields a 1.502% gain in Advertiser Value over strong baselines. The method has been fully deployed, serving daily recommendations for hundreds of millions of users.