AIR: Improving Agent Safety through Incident Response

作者: Zibo Xiao, Jun Sun, Junjie Chen

分类: cs.AI

发布日期: 2026-02-12

💡 一句话要点

AIR:通过事件响应提升LLM Agent的安全性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 事件响应 安全机制 领域特定语言 自主系统

📋 核心要点

- 现有LLM Agent安全机制侧重于事前预防,缺乏对已发生事件的有效响应、遏制和恢复能力。

- AIR框架通过领域特定语言驱动Agent自主管理事件响应生命周期,实现事件检测、修复和预防。

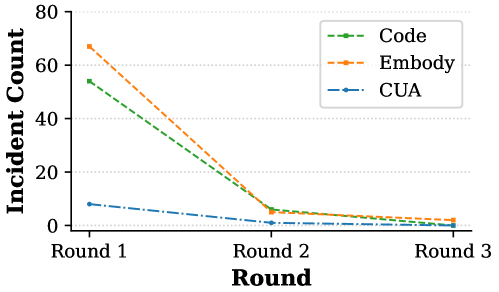

- 实验表明AIR在事件检测、修复和根除方面成功率超过90%,且LLM生成的规则有效性接近人工规则。

📝 摘要(中文)

大型语言模型(LLM)Agent正日益广泛地部署于各种自主应用中。然而,当前LLM Agent的安全机制几乎完全侧重于提前预防故障,对于事件发生后的响应、遏制或恢复能力有限。本文提出了AIR,这是首个针对LLM Agent系统的事件响应框架。AIR定义了一种领域特定语言,用于在LLM Agent系统中自主管理事件响应生命周期,并将其集成到Agent的执行循环中,以实现:(1)通过基于当前环境状态和最近上下文的语义检查来检测事件;(2)引导Agent通过其工具执行遏制和恢复操作;(3)在根除阶段合成防护规则,以阻止未来执行中发生类似事件。我们在三种具有代表性的Agent类型上评估了AIR。结果表明,AIR在检测、修复和根除方面的成功率均超过90%。大量的实验进一步证实了AIR关键设计组件的必要性,展示了AIR的及时性和适度开销,并证明了LLM生成的规则在各个领域可以接近开发者编写规则的有效性。这些结果表明,事件响应作为一种提升Agent安全性的首要机制,既可行又至关重要。

🔬 方法详解

问题定义:现有的大型语言模型Agent安全机制主要集中在预防潜在的故障,而忽略了当故障实际发生时如何进行有效的响应、遏制和恢复。这种策略的局限性在于,即使是最完善的预防措施也无法完全消除所有风险,因此需要一种机制来处理不可避免的事件。

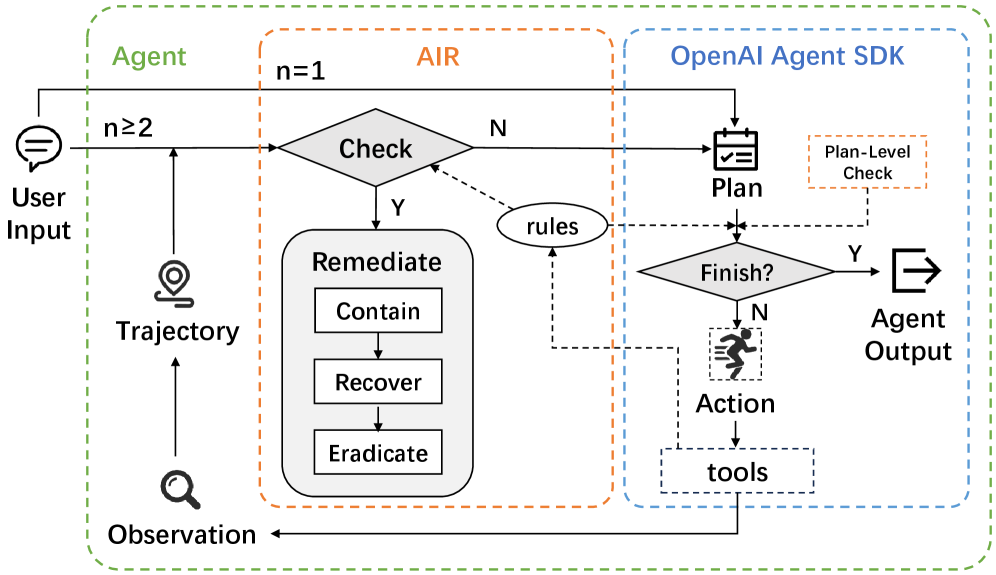

核心思路:AIR的核心思路是将事件响应过程集成到LLM Agent的执行循环中,使其能够自主地检测、响应和学习,从而提高整体安全性。通过定义一种领域特定语言(DSL),AIR允许Agent以结构化的方式管理事件响应生命周期,并利用其工具来执行必要的行动。

技术框架:AIR框架包含三个主要阶段:事件检测、事件遏制与恢复、事件根除。在事件检测阶段,AIR使用基于环境状态和上下文的语义检查来识别潜在的安全问题。一旦检测到事件,Agent会利用其工具执行遏制和恢复操作,以减轻事件的影响。最后,在事件根除阶段,AIR会合成防护规则,以防止未来发生类似的事件。整个过程由DSL驱动,Agent可以自主地执行这些步骤。

关键创新:AIR的关键创新在于它将事件响应视为LLM Agent安全性的一个基本组成部分,并提供了一个完整的框架来支持这一过程。与仅关注预防的传统方法不同,AIR能够动态地适应不断变化的环境,并从过去的事件中学习。此外,AIR使用LLM生成防护规则,这使得它能够自动地适应新的威胁。

关键设计:AIR的关键设计包括领域特定语言(DSL)的设计,用于描述事件响应过程;语义检查的实现,用于检测事件;以及LLM生成防护规则的机制。DSL需要足够表达力,以便Agent能够描述各种事件响应操作。语义检查需要足够敏感,以便能够准确地检测到事件,同时避免误报。LLM生成防护规则的机制需要能够生成有效且安全的规则。

🖼️ 关键图片

📊 实验亮点

实验结果表明,AIR在检测、修复和根除方面的成功率均超过90%。此外,实验还证实了AIR关键设计组件的必要性,展示了AIR的及时性和适度开销。更重要的是,实验证明了LLM生成的规则在各个领域可以接近开发者编写规则的有效性,这为自动化安全防护提供了新的途径。

🎯 应用场景

AIR框架可应用于各种自主Agent系统,例如自动化客服、智能家居控制、自动驾驶等。通过提升Agent的安全性,AIR可以降低潜在风险,提高用户信任度,并促进LLM Agent在更广泛领域的应用。未来,该研究可以扩展到更复杂的Agent系统和更广泛的安全威胁。

📄 摘要(原文)

Large Language Model (LLM) agents are increasingly deployed in practice across a wide range of autonomous applications. Yet current safety mechanisms for LLM agents focus almost exclusively on preventing failures in advance, providing limited capabilities for responding to, containing, or recovering from incidents after they inevitably arise. In this work, we introduce AIR, the first incident response framework for LLM agent systems. AIR defines a domain-specific language for managing the incident response lifecycle autonomously in LLM agent systems, and integrates it into the agent's execution loop to (1) detect incidents via semantic checks grounded in the current environment state and recent context, (2) guide the agent to execute containment and recovery actions via its tools, and (3) synthesize guardrail rules during eradication to block similar incidents in future executions. We evaluate AIR on three representative agent types. Results show that AIR achieves detection, remediation, and eradication success rates all exceeding 90%. Extensive experiments further confirm the necessity of AIR's key design components, show the timeliness and moderate overhead of AIR, and demonstrate that LLM-generated rules can approach the effectiveness of developer-authored rules across domains. These results show that incident response is both feasible and essential as a first-class mechanism for improving agent safety.