Beyond Parameter Arithmetic: Sparse Complementary Fusion for Distribution-Aware Model Merging

作者: Weihong Lin, Lin Sun, Qilong Shi, Aomufei Yuan, Yuxuan Tian, Zhengyang Wang, Guangxiang Zhao, Xiangzheng Zhang, Tong Yang

分类: cs.AI

发布日期: 2026-02-12

💡 一句话要点

提出SCF-RKL,通过稀疏互补融合解决模型合并中的功能干扰问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 模型合并 稀疏融合 反向KL散度 功能干扰 分布感知 大型语言模型 参数空间 互补学习

📋 核心要点

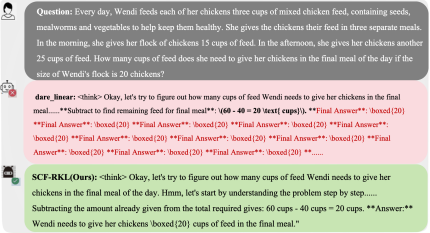

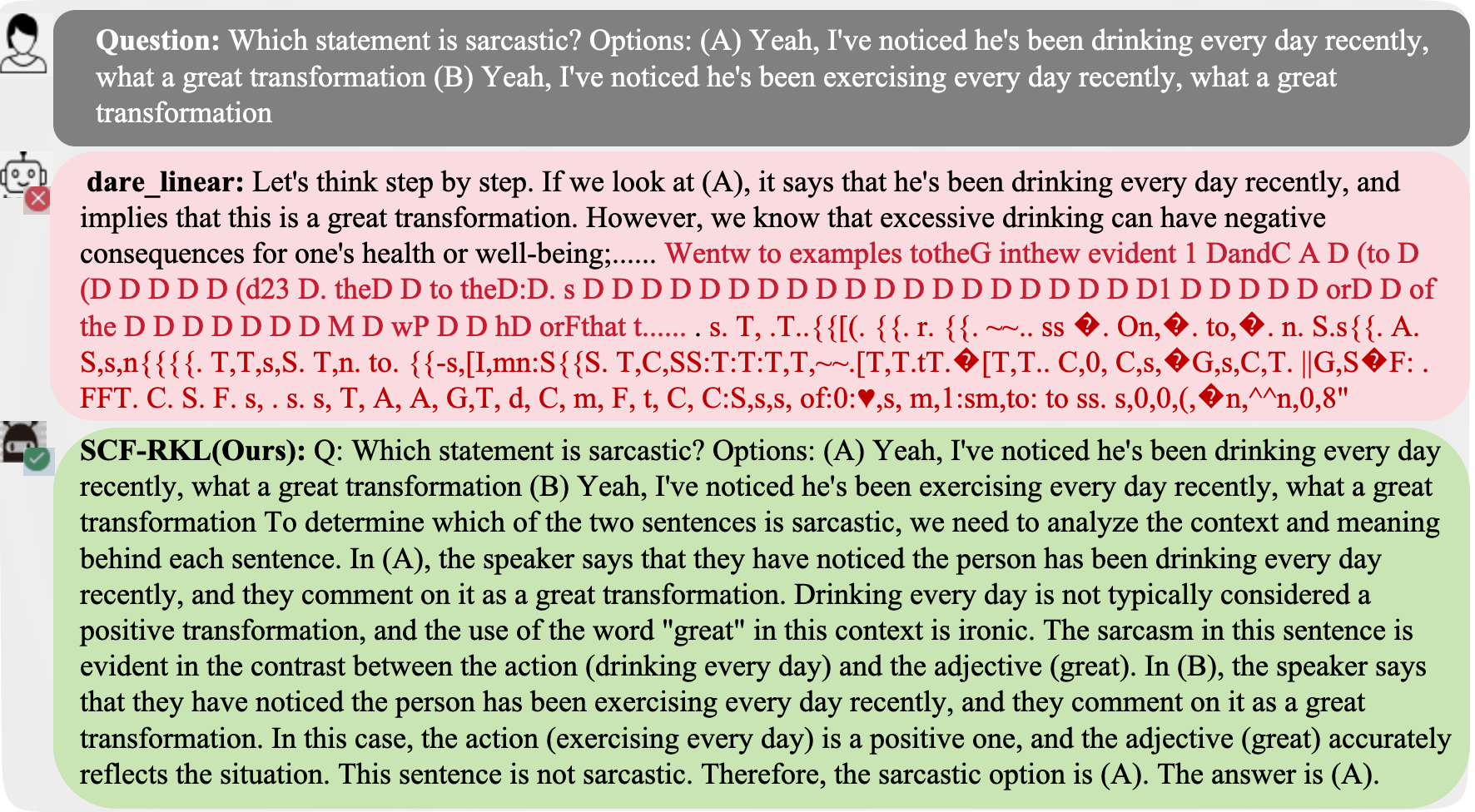

- 现有模型合并方法依赖参数空间启发式,易引入功能干扰,导致泛化能力下降和生成不稳定。

- SCF-RKL通过反向KL散度衡量模型功能差异,选择性融合互补参数,实现稀疏、分布感知的更新。

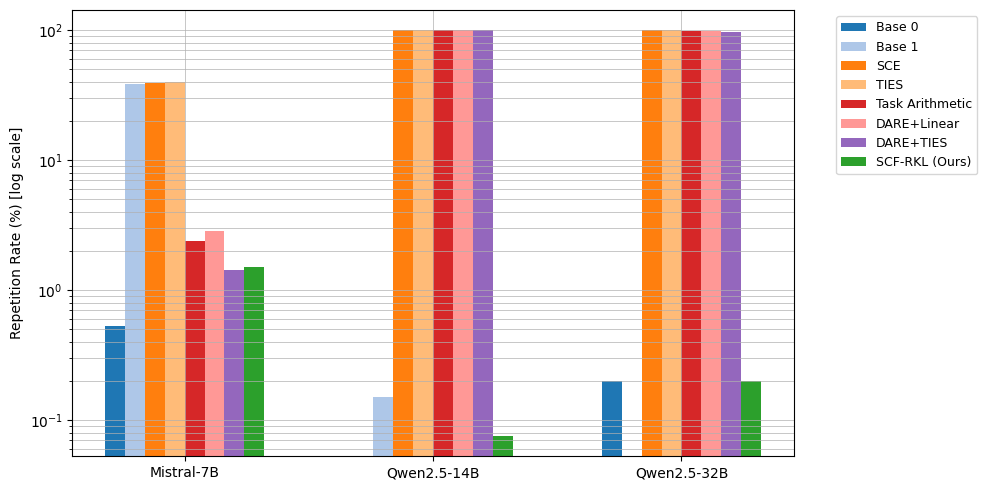

- 实验表明,SCF-RKL在多种模型和任务上优于现有方法,同时保持了泛化能力和生成稳定性。

📝 摘要(中文)

模型合并是一种有前景的方法,它通过直接在权重空间中操作来组合大型语言模型的能力,从而无需昂贵的再训练即可集成专用模型。然而,现有的合并方法主要依赖于参数空间启发式方法,这通常会引入严重的功能干扰,导致泛化能力下降和不稳定的生成行为,例如重复和不连贯的输出。本文提出了一种基于反向KL散度的稀疏互补融合(SCF-RKL)的新型模型合并框架,该框架通过稀疏的、分布感知的更新来显式地控制功能干扰。SCF-RKL 不假设参数空间中的线性可加性,而是使用反向 Kullback-Leibler 散度来衡量模型之间的功能差异,并选择性地合并互补参数。这种寻找模式、诱导稀疏性的设计有效地保留了稳定的表示,同时集成了新的能力。我们在各种模型规模和架构上评估了 SCF-RKL,涵盖了以推理为中心的模型和指令调整模型。在涵盖高级推理、一般推理和知识、指令遵循和安全性的 24 个基准测试中进行的大量实验表明,SCF-RKL 始终优于现有的模型合并方法,同时保持了强大的泛化能力和生成稳定性。

🔬 方法详解

问题定义:模型合并旨在组合多个模型的优势,但现有方法在参数空间直接操作,忽略了模型间的复杂功能关系,导致合并后的模型性能下降,出现泛化能力差、生成内容重复或不连贯等问题。核心痛点在于如何有效避免模型间的负面干扰,同时保留各自的优势。

核心思路:SCF-RKL的核心在于不再假设参数空间的线性可加性,而是从功能差异的角度出发,选择性地融合模型参数。通过反向KL散度来衡量模型输出分布的差异,从而判断哪些参数是互补的,哪些参数会引入干扰。这种方法旨在保留每个模型的优势,同时抑制负面干扰,实现更有效的模型合并。

技术框架:SCF-RKL框架主要包含以下几个阶段:1) 使用多个预训练模型作为输入;2) 使用反向KL散度计算模型之间的功能差异,得到一个稀疏的互补参数掩码;3) 根据掩码选择性地融合模型参数,生成合并后的模型。整个过程旨在最小化功能干扰,同时最大化模型能力的互补性。

关键创新:SCF-RKL最重要的创新在于其分布感知的稀疏融合策略。与传统的参数平均或加权平均方法不同,SCF-RKL通过反向KL散度来衡量模型之间的功能差异,并根据差异选择性地融合参数。这种方法能够更准确地识别和融合互补的知识,避免了不必要的干扰,从而提高了模型合并的效率和效果。

关键设计:SCF-RKL的关键设计包括:1) 使用反向KL散度作为功能差异的度量标准,因为它能够更好地捕捉模型输出分布的差异;2) 引入稀疏性约束,只融合互补的参数,避免引入不必要的干扰;3) 通过调整KL散度的权重来控制融合的强度,从而平衡模型之间的能力。

🖼️ 关键图片

📊 实验亮点

SCF-RKL在24个基准测试中进行了广泛评估,涵盖了高级推理、一般推理和知识、指令遵循和安全性等多个方面。实验结果表明,SCF-RKL始终优于现有的模型合并方法,并且在保持强大的泛化能力和生成稳定性的同时,取得了显著的性能提升。具体的性能数据和提升幅度在论文中有详细的展示。

🎯 应用场景

SCF-RKL可应用于各种需要模型合并的场景,例如:1) 将多个在不同领域或任务上训练的模型合并为一个更通用的模型;2) 将多个具有不同优势的模型合并为一个性能更强的模型;3) 在资源受限的环境中,通过合并多个小型模型来构建一个大型模型。该方法具有广泛的应用前景,可以提高模型合并的效率和效果,降低模型部署的成本。

📄 摘要(原文)

Model merging has emerged as a promising paradigm for composing the capabilities of large language models by directly operating in weight space, enabling the integration of specialized models without costly retraining. However, existing merging methods largely rely on parameter-space heuristics, which often introduce severe interference, leading to degraded generalization and unstable generation behaviors such as repetition and incoherent outputs. In this work, we propose Sparse Complementary Fusion with reverse KL (SCF-RKL), a novel model merging framework that explicitly controls functional interference through sparse, distribution-aware updates. Instead of assuming linear additivity in parameter space, SCF-RKL measures the functional divergence between models using reverse Kullback-Leibler divergence and selectively incorporates complementary parameters. This mode-seeking, sparsity-inducing design effectively preserves stable representations while integrating new capabilities. We evaluate SCF-RKL across a wide range of model scales and architectures, covering both reasoning-focused and instruction-tuned models. Extensive experiments on 24 benchmarks spanning advanced reasoning, general reasoning and knowledge, instruction following, and safety demonstrate, vision classification that SCF-RKL consistently outperforms existing model merging methods while maintaining strong generalization and generation stability.