LoRA-based Parameter-Efficient LLMs for Continuous Learning in Edge-based Malware Detection

作者: Christian Rondanini, Barbara Carminati, Elena Ferrari, Niccolò Lardo, Ashish Kundu

分类: cs.CR, cs.AI, cs.DC

发布日期: 2026-02-12

💡 一句话要点

提出基于LoRA的参数高效LLM持续学习框架,用于边缘恶意软件检测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 边缘计算 恶意软件检测 持续学习 联邦学习 参数高效学习 LoRA 物联网安全

📋 核心要点

- 现有边缘恶意软件检测模型难以适应不断演变的威胁和异构流量,且本地训练模型存在孤立和泛化能力不足的问题。

- 提出一种基于LoRA的参数高效持续学习框架,通过边缘设备本地微调和全局LoRA模块共享,实现跨设备知识迁移。

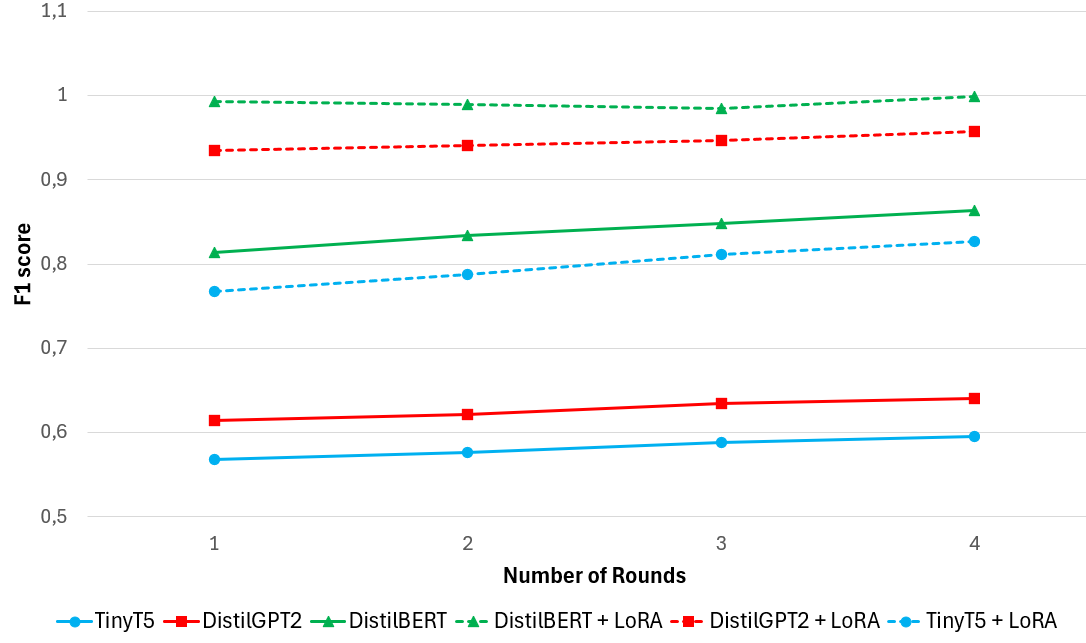

- 在Edge-IIoTset和TON-IoT数据集上的实验表明,该方法在面对新攻击时,准确率提升高达20-25%,且模型大小增加不到1%。

📝 摘要(中文)

随着边缘设备的激增,迫切需要能够在严格的计算和内存约束下实时检测恶意软件的安全解决方案。最近,大型语言模型(LLM)在识别复杂模式方面表现出了卓越的能力,但由于其资源需求,将它们部署在边缘设备上仍然不切实际。然而,在边缘恶意软件检测中,静态或集中式重新训练的模型在不断演变的威胁和异构流量下会退化;本地训练的模型变得孤立,并且无法跨域迁移。为了克服这些限制,在本文中,我们提出了一种基于边缘的恶意软件检测的持续学习架构,该架构将每个设备上的本地适应与通过参数高效的LoRA适配器进行的全局知识共享相结合。轻量级Transformer模型(DistilBERT、DistilGPT-2、TinyT5)在边缘节点上运行,并针对设备特定的流量进行增量微调;只有生成的LoRA模块由轻量级协调器聚合和重新分发,从而实现跨设备泛化,而无需交换原始数据。我们在两个公共物联网安全数据集Edge-IIoTset和TON-IoT上,在多轮学习下进行评估,以模拟不断演变的威胁。与孤立的微调相比,当模型遇到来自另一个域的先前未见过的攻击时,基于LoRA的交换可产生高达20-25%的准确率提升,同时保持跨轮次的稳定损失和F1。LoRA增加了不到1%的模型大小(约0.6-1.8 MB),使得更新对于受限的边缘硬件来说是可行的。

🔬 方法详解

问题定义:论文旨在解决边缘设备上恶意软件检测模型难以适应不断变化的威胁环境,以及模型在不同设备间泛化能力差的问题。现有方法,如静态模型或集中式重新训练,无法有效应对边缘设备的资源限制和数据异构性,而本地独立训练的模型则缺乏全局知识共享,导致泛化能力受限。

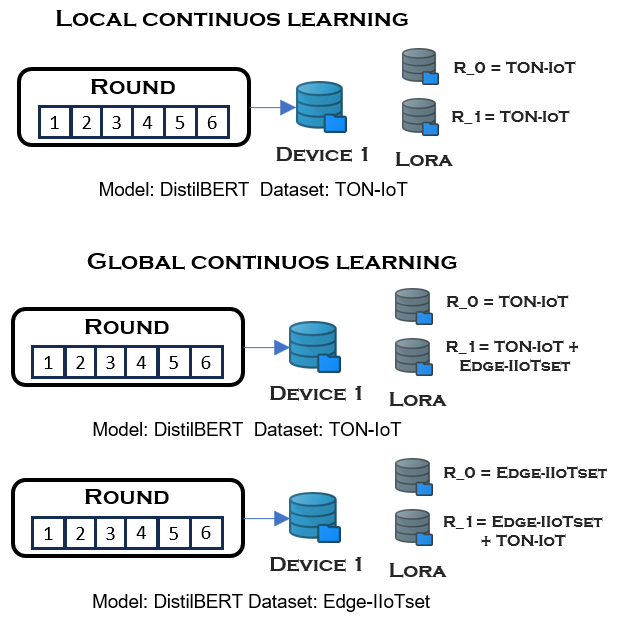

核心思路:论文的核心思路是利用参数高效的LoRA(Low-Rank Adaptation)方法,在边缘设备上对轻量级Transformer模型进行本地微调,并通过共享LoRA模块实现跨设备知识迁移。这样既能保证模型适应本地数据,又能利用全局信息提升泛化能力,同时避免了直接共享原始数据带来的隐私问题。

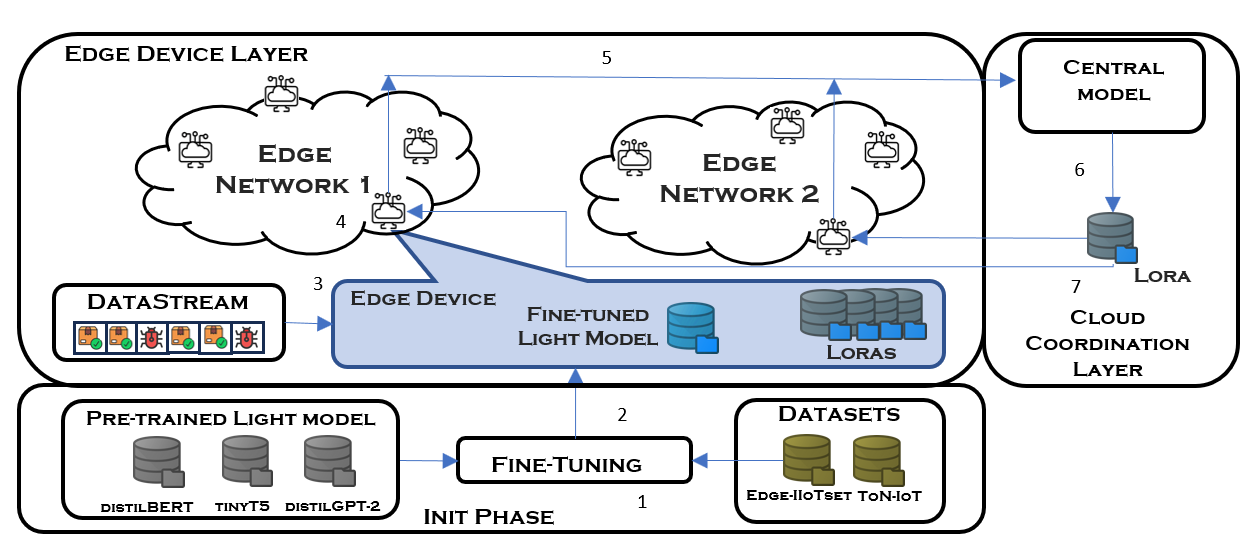

技术框架:该框架包含以下主要模块:1) 边缘节点:运行轻量级Transformer模型(如DistilBERT, DistilGPT-2, TinyT5),并使用LoRA进行本地微调。2) 轻量级协调器:负责收集来自各个边缘节点的LoRA模块,进行聚合处理(例如平均),并将更新后的LoRA模块分发回各个边缘节点。3) 数据集:使用Edge-IIoTset和TON-IoT等物联网安全数据集进行评估,模拟不断演变的威胁环境。

关键创新:最重要的技术创新点在于将LoRA应用于边缘设备的持续学习场景,实现了参数高效的跨设备知识共享。与传统的全参数微调相比,LoRA只微调少量参数,显著降低了计算和存储开销,使其适用于资源受限的边缘设备。同时,通过共享LoRA模块,实现了模型在不同设备间的泛化能力提升,解决了本地模型孤立的问题。

关键设计:论文使用了三种轻量级Transformer模型(DistilBERT, DistilGPT-2, TinyT5)作为基础模型。LoRA的秩(rank)是一个关键参数,决定了微调参数的数量。论文中LoRA模块的大小增加不到1%的模型大小(约0.6-1.8 MB),保证了边缘设备的可行性。损失函数和优化器等细节未在摘要中明确提及,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与孤立的微调相比,基于LoRA的知识共享方法在面对来自其他域的未知攻击时,准确率提升高达20-25%。同时,LoRA模块的模型大小增加不到1%(约0.6-1.8 MB),保证了在资源受限的边缘设备上的可行性。实验结果验证了该方法在提升模型泛化能力和降低资源开销方面的有效性。

🎯 应用场景

该研究成果可应用于各种边缘计算场景下的安全防护,例如智能家居、工业物联网、智能交通等。通过持续学习和知识共享,能够有效提升边缘设备抵御新型恶意软件攻击的能力,保障物联网系统的安全稳定运行。未来,该方法还可以扩展到其他类型的边缘设备和应用领域。

📄 摘要(原文)

The proliferation of edge devices has created an urgent need for security solutions capable of detecting malware in real time while operating under strict computational and memory constraints. Recently, Large Language Models (LLMs) have demonstrated remarkable capabilities in recognizing complex patterns, yet their deployment on edge devices remains impractical due to their resource demands. However, in edge malware detection, static or centrally retrained models degrade under evolving threats and heterogeneous traffic; locally trained models become siloed and fail to transfer across domains. To overcome these limitations, in this paper, we present a continuous learning architecture for edge-based malware detection that combines local adaptation on each device with global knowledge sharing through parameter-efficient LoRA adapters. Lightweight transformer models (DistilBERT, DistilGPT-2, TinyT5) run on edge nodes and are incrementally fine-tuned on device-specific traffic; only the resulting LoRA modules are aggregated by a lightweight coordinator and redistributed, enabling cross-device generalization without exchanging raw data. We evaluate on two public IoT security datasets, Edge-IIoTset and TON-IoT, under multi-round learning to simulate evolving threats. Compared to isolated fine-tuning, the LoRA-based exchange yields up to 20-25% accuracy gains when models encounter previously unseen attacks from another domain, while maintaining stable loss and F1 across rounds. LoRA adds less than 1% to model size (~0.6-1.8 MB), making updates practical for constrained edge hardware.