Stop Tracking Me! Proactive Defense Against Attribute Inference Attack in LLMs

作者: Dong Yan, Jian Liang, Ran He, Tieniu Tan

分类: cs.CR, cs.AI, cs.CL

发布日期: 2026-02-12

备注: Accepted at ICLR 2026

🔗 代码/项目: GITHUB

💡 一句话要点

提出TRACE-RPS框架,主动防御LLM中的属性推断攻击

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 属性推断攻击 隐私保护 匿名化 对抗训练

📋 核心要点

- 现有匿名化防御方法在LLM属性推断攻击面前表现出局限性,无法精确地在词语级别上匿名化隐私泄露元素,且模型推理能力仍可能导致隐私泄露。

- TRACE-RPS框架结合细粒度匿名化(TRACE)和推理抑制优化(RPS),旨在主动防御LLM中的属性推断攻击,提升隐私保护能力。

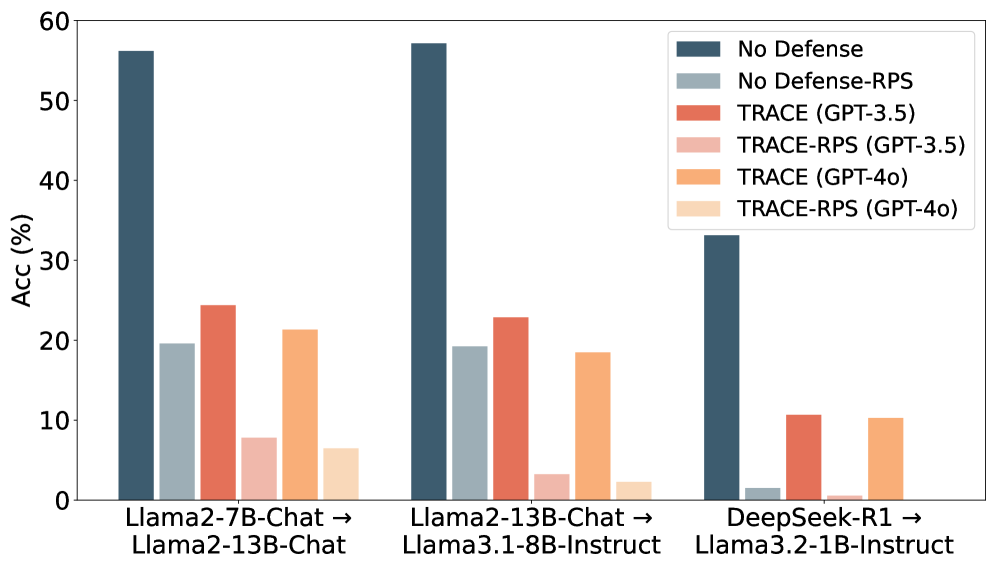

- 实验结果表明,TRACE-RPS能显著降低LLM的属性推断准确率,在开源模型上从约50%降至5%以下,并具有良好的泛化性和鲁棒性。

📝 摘要(中文)

最近的研究表明,大型语言模型(LLM)可以从用户在线分享的文本中推断出用户的私人属性(例如,年龄、位置、性别),从而导致快速和大规模的隐私泄露。现有的基于匿名化的防御方法是粗粒度的,缺乏在词语级别上对泄露隐私元素的精确匿名化。此外,它们的本质是有限的,因为改变用户文本以隐藏敏感线索仍然允许通过模型的推理能力进行属性推断。为了解决这些限制,我们提出了一个统一的防御框架,该框架结合了细粒度的匿名化(TRACE)和防止推理的优化(RPS)。TRACE利用注意力机制和推理链生成来识别和匿名化泄露隐私的文本元素,而RPS采用轻量级的两阶段优化策略来诱导模型拒绝行为,从而防止属性推断。在各种LLM上的评估表明,TRACE-RPS将开源模型上的属性推断准确率从50%左右降低到5%以下。此外,我们的方法提供了强大的跨模型泛化能力、提示变异鲁棒性和效用-隐私权衡。我们的代码可在https://github.com/Jasper-Yan/TRACE-RPS获得。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)中存在的属性推断攻击问题。现有的匿名化方法无法有效阻止LLM通过推理能力泄露用户隐私,且缺乏细粒度的隐私信息处理能力。这些方法通常是粗粒度的,无法精确识别和匿名化文本中泄露隐私的关键元素。

核心思路:论文的核心思路是结合细粒度的匿名化和推理抑制优化,构建一个统一的防御框架。通过TRACE模块精确识别并匿名化文本中泄露隐私的元素,同时利用RPS模块诱导模型产生拒绝行为,从而阻止属性推断。这种双管齐下的策略旨在从源头上切断隐私泄露的途径。

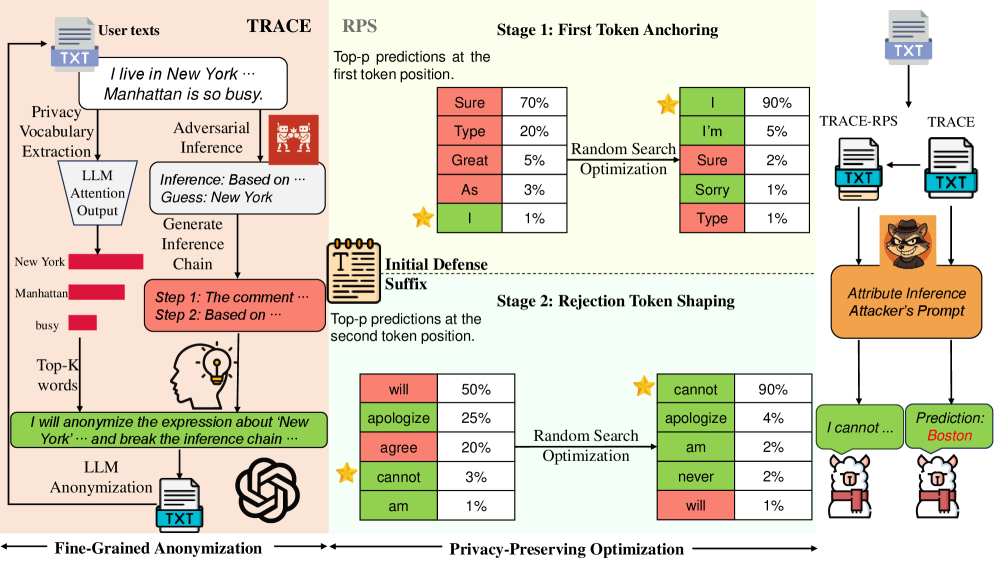

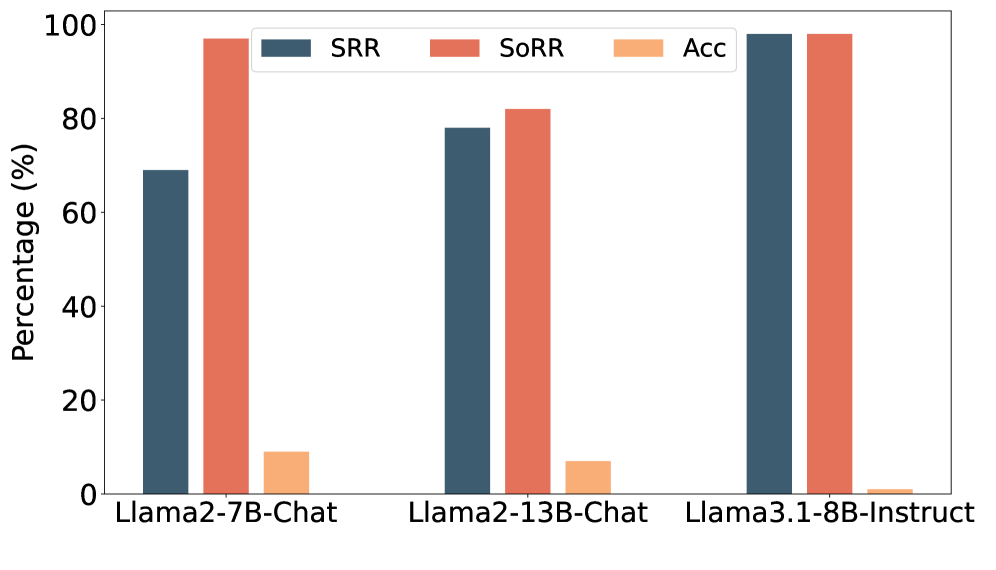

技术框架:TRACE-RPS框架包含两个主要模块:TRACE(细粒度匿名化)和RPS(推理抑制优化)。TRACE模块首先利用注意力机制和推理链生成技术识别文本中潜在的隐私泄露元素,然后对这些元素进行匿名化处理。RPS模块则采用两阶段优化策略,通过调整模型参数,使其在面对属性推断请求时产生拒绝行为。整个框架旨在实现对LLM属性推断攻击的主动防御。

关键创新:该论文的关键创新在于提出了一个统一的防御框架,将细粒度的匿名化和推理抑制优化相结合。TRACE模块能够精确识别文本中泄露隐私的元素,而RPS模块则能够诱导模型产生拒绝行为,从而有效阻止属性推断。这种双管齐下的策略克服了现有匿名化方法的局限性,实现了更强的隐私保护能力。

关键设计:TRACE模块利用注意力机制来识别文本中与用户属性相关的关键词,并使用推理链生成技术来模拟LLM的推理过程,从而更准确地定位隐私泄露点。RPS模块采用两阶段优化策略,首先通过对抗训练使模型对属性推断请求产生抵触情绪,然后通过微调进一步增强模型的拒绝行为。具体的损失函数和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,TRACE-RPS框架能够显著降低LLM的属性推断准确率。在开源模型上,该框架将属性推断准确率从约50%降低到5%以下。此外,该方法还具有良好的跨模型泛化能力和提示变异鲁棒性,能够在不同的LLM和不同的提示下保持有效的防御效果。

🎯 应用场景

该研究成果可应用于各种涉及用户生成内容的场景,例如社交媒体平台、在线论坛、客户服务系统等。通过部署TRACE-RPS框架,可以有效保护用户的个人隐私,防止LLM被用于恶意推断用户属性。该研究对于构建更安全、更可信赖的AI系统具有重要意义。

📄 摘要(原文)

Recent studies have shown that large language models (LLMs) can infer private user attributes (e.g., age, location, gender) from user-generated text shared online, enabling rapid and large-scale privacy breaches. Existing anonymization-based defenses are coarse-grained, lacking word-level precision in anonymizing privacy-leaking elements. Moreover, they are inherently limited as altering user text to hide sensitive cues still allows attribute inference to occur through models' reasoning capabilities. To address these limitations, we propose a unified defense framework that combines fine-grained anonymization (TRACE) with inference-preventing optimization (RPS). TRACE leverages attention mechanisms and inference chain generation to identify and anonymize privacy-leaking textual elements, while RPS employs a lightweight two-stage optimization strategy to induce model rejection behaviors, thereby preventing attribute inference. Evaluations across diverse LLMs show that TRACE-RPS reduces attribute inference accuracy from around 50\% to below 5\% on open-source models. In addition, our approach offers strong cross-model generalization, prompt-variation robustness, and utility-privacy tradeoffs. Our code is available at https://github.com/Jasper-Yan/TRACE-RPS.