Abstraction Generation for Generalized Planning with Pretrained Large Language Models

作者: Zhenhe Cui, Huaxiang Xia, Hangjun Shen, Kailun Luo, Yong He, Wei Liang

分类: cs.AI

发布日期: 2026-02-11

💡 一句话要点

利用预训练大语言模型为通用规划生成抽象表示

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 通用规划 大型语言模型 抽象生成 定性数值规划 自动调试

📋 核心要点

- 通用规划旨在寻找能够一次性解决多个问题的通用计划,而定性数值规划(QNP)是其重要的抽象模型。

- 该论文提出了一种提示协议,利用大型语言模型(LLM)生成抽象特征,并将规划问题转化为QNP问题。

- 设计了一种自动调试方法,用于检测和修复LLM生成的抽象错误,从而提升抽象质量。

📝 摘要(中文)

定性数值规划(QNP)是通用规划(GP)的重要抽象模型,旨在计算一次性解决多个实例的通用计划。最近的研究表明,大型语言模型(LLM)可以作为通用规划器。这项工作研究了LLM是否可以作为GP问题的QNP抽象生成器,以及如何通过自动调试来修复抽象。我们提出了一种提示协议:将GP领域和训练任务输入到LLM中,提示它们生成抽象特征,并将初始状态、动作集和目标进一步抽象为QNP问题。设计了一种自动调试方法来检测抽象错误,指导LLM修复抽象。实验表明,在自动调试的适当指导下,一些LLM可以生成有用的QNP抽象。

🔬 方法详解

问题定义:通用规划(GP)旨在寻找能够一次性解决多个问题的通用计划。现有的GP方法通常需要人工设计抽象表示,这既耗时又需要专业知识。论文关注的问题是:能否利用预训练的大型语言模型(LLM)自动生成高质量的抽象表示,从而简化GP问题的求解过程。现有方法的痛点在于抽象表示的生成依赖人工,缺乏自动化和通用性。

核心思路:论文的核心思路是利用LLM的强大语言理解和生成能力,通过合适的提示(Prompt)工程,引导LLM将具体的规划问题抽象成定性数值规划(QNP)问题。QNP问题更容易求解,从而实现通用规划。此外,论文还设计了自动调试机制,用于检测和修复LLM生成的抽象表示中的错误。

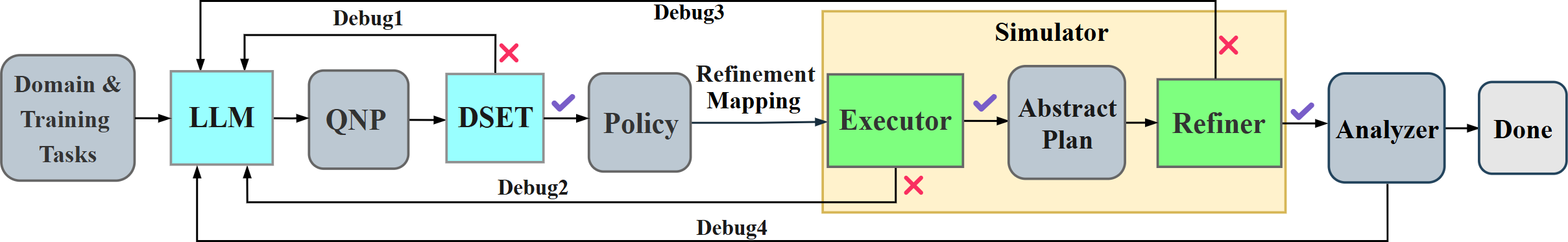

技术框架:整体框架包含以下几个主要阶段: 1. 提示工程:设计合适的提示,将GP领域和训练任务输入LLM。 2. 抽象生成:LLM根据提示生成抽象特征,并将初始状态、动作集和目标抽象为QNP问题。 3. 自动调试:检测抽象错误,并利用错误信息指导LLM修复抽象。 4. QNP求解:使用QNP求解器求解抽象后的问题,得到通用计划。

关键创新:最重要的技术创新点在于利用LLM自动生成QNP抽象表示,并结合自动调试机制提升抽象质量。与现有方法相比,该方法无需人工设计抽象表示,具有更高的自动化程度和通用性。此外,自动调试机制能够有效纠正LLM可能产生的错误,保证抽象表示的有效性。

关键设计:关键设计包括: 1. 提示设计:设计清晰明确的提示,引导LLM生成合适的抽象特征。 2. 错误检测:设计有效的错误检测机制,例如通过验证抽象表示是否满足QNP的约束条件来检测错误。 3. 修复策略:设计合适的修复策略,例如根据错误类型调整提示,引导LLM重新生成抽象表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在自动调试的指导下,一些LLM能够生成有用的QNP抽象。具体而言,经过自动调试后,LLM生成的抽象表示能够使QNP求解器成功找到通用计划的概率显著提高。该研究验证了LLM在通用规划抽象生成方面的潜力,并为未来的研究提供了新的方向。

🎯 应用场景

该研究成果可应用于机器人导航、任务规划、游戏AI等领域。通过自动生成抽象表示,可以简化复杂规划问题的求解过程,提高规划效率和通用性。未来,该方法有望应用于更广泛的通用人工智能领域,例如自动化程序设计、智能决策支持等。

📄 摘要(原文)

Qualitative Numerical Planning (QNP) serves as an important abstraction model for generalized planning (GP), which aims to compute general plans that solve multiple instances at once. Recent works show that large language models (LLMs) can function as generalized planners. This work investigates whether LLMs can serve as QNP abstraction generators for GP problems and how to fix abstractions via automated debugging. We propose a prompt protocol: input a GP domain and training tasks to LLMs, prompting them to generate abstract features and further abstract the initial state, action set, and goal into QNP problems. An automated debugging method is designed to detect abstraction errors, guiding LLMs to fix abstractions. Experiments demonstrate that under properly guided by automated debugging, some LLMs can generate useful QNP abstractions.