GHS-TDA: A Synergistic Reasoning Framework Integrating Global Hypothesis Space with Topological Data Analysis

作者: Jiaquan Zhang, Chaoning Zhang, Shuxu Chen, Xudong Wang, Zhenzhen Huang, Pengcheng Zheng, Shuai Yuan, Sheng Zheng, Qigan Sun, Jie Zou, Lik-Hang Lee, Yang Yang

分类: cs.AI

发布日期: 2026-02-10

备注: 23pages

💡 一句话要点

提出GHS-TDA框架,融合全局假设空间与拓扑数据分析,提升LLM推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 链式思考 全局假设空间 拓扑数据分析 持久同调 推理框架 知识推理 可解释性

📋 核心要点

- 现有CoT方法易受早期错误影响,缺乏全局协调机制,导致推理链扭曲。

- GHS-TDA构建全局假设图协调推理路径,并利用拓扑数据分析提取可靠推理骨架。

- 实验表明,GHS-TDA在多个推理基准上显著提升了LLM的准确性和鲁棒性。

📝 摘要(中文)

本文提出了一种名为GHS-TDA的协同推理框架,旨在解决大型语言模型(LLMs)在复杂任务中推理精度不足的问题。现有CoT方法由于自回归的逐步生成模式,容易受到早期决策错误的影响,且缺乏全局协调和修正机制。此外,缺乏结构化分析技术来过滤冗余推理和提取关键推理特征,导致推理过程不稳定且可解释性有限。GHS-TDA首先构建一个语义丰富的全局假设图,以聚合、对齐和协调多个候选推理路径,从而在局部推理失败时提供替代的全局校正路径。然后,应用基于持久同调的拓扑数据分析来捕获稳定的多尺度结构,消除冗余和不一致性,并提取更可靠的推理骨架。通过联合利用推理多样性和拓扑稳定性,GHS-TDA实现了自适应收敛,生成高置信度和可解释的推理路径,并在多个推理基准测试中始终优于强大的基线。

🔬 方法详解

问题定义:现有Chain-of-Thought (CoT)方法在复杂推理任务中,由于其自回归的生成方式,容易受到早期推理步骤中错误的影响,并且这些错误会在后续步骤中传播和放大。缺乏全局的协调和修正机制使得这些错误难以纠正。此外,现有的CoT方法缺乏结构化的分析技术来过滤冗余推理和提取关键的推理特征,导致推理过程不稳定,可解释性也受到限制。

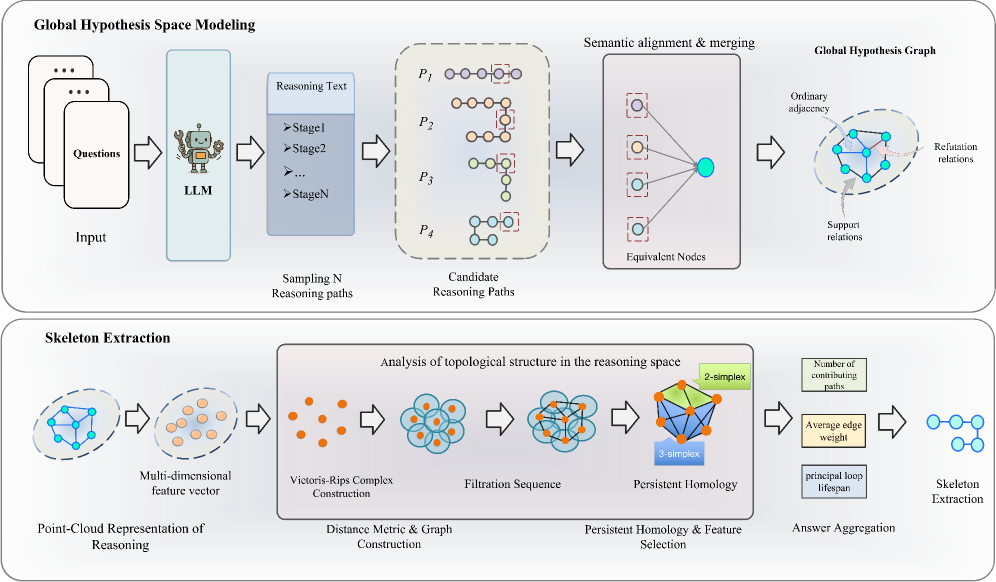

核心思路:GHS-TDA的核心思路是结合全局假设空间和拓扑数据分析,以提高推理的准确性和鲁棒性。通过构建全局假设图,整合多个候选推理路径,从而提供全局校正的可能。利用拓扑数据分析,提取稳定的多尺度结构,去除冗余和不一致性,从而得到更可靠的推理骨架。这样设计的目的是利用推理的多样性来弥补局部推理的不足,并利用拓扑稳定性来保证推理的可靠性。

技术框架:GHS-TDA框架主要包含两个阶段:全局假设空间构建和拓扑数据分析。首先,构建一个语义丰富的全局假设图,该图的节点代表不同的推理步骤或假设,边代表它们之间的关系。然后,应用基于持久同调的拓扑数据分析,分析全局假设图的拓扑结构,识别并提取稳定的多尺度结构,去除冗余和不一致性,最终得到一个精简且可靠的推理路径。

关键创新:GHS-TDA的关键创新在于将全局假设空间和拓扑数据分析结合起来,用于解决LLM的推理问题。与传统的CoT方法相比,GHS-TDA不再依赖于单一的推理路径,而是探索多个候选路径,并通过全局协调和修正来提高推理的准确性。此外,利用拓扑数据分析来提取稳定的推理结构,可以有效地去除冗余和噪声,提高推理的鲁棒性和可解释性。

关键设计:在全局假设空间构建阶段,需要设计合适的语义表示方法来表示推理步骤或假设,并定义它们之间的关系。在拓扑数据分析阶段,需要选择合适的距离度量和过滤参数,以捕获稳定的多尺度结构。具体的参数设置和损失函数等技术细节在论文中可能没有详细描述,属于未知信息。

🖼️ 关键图片

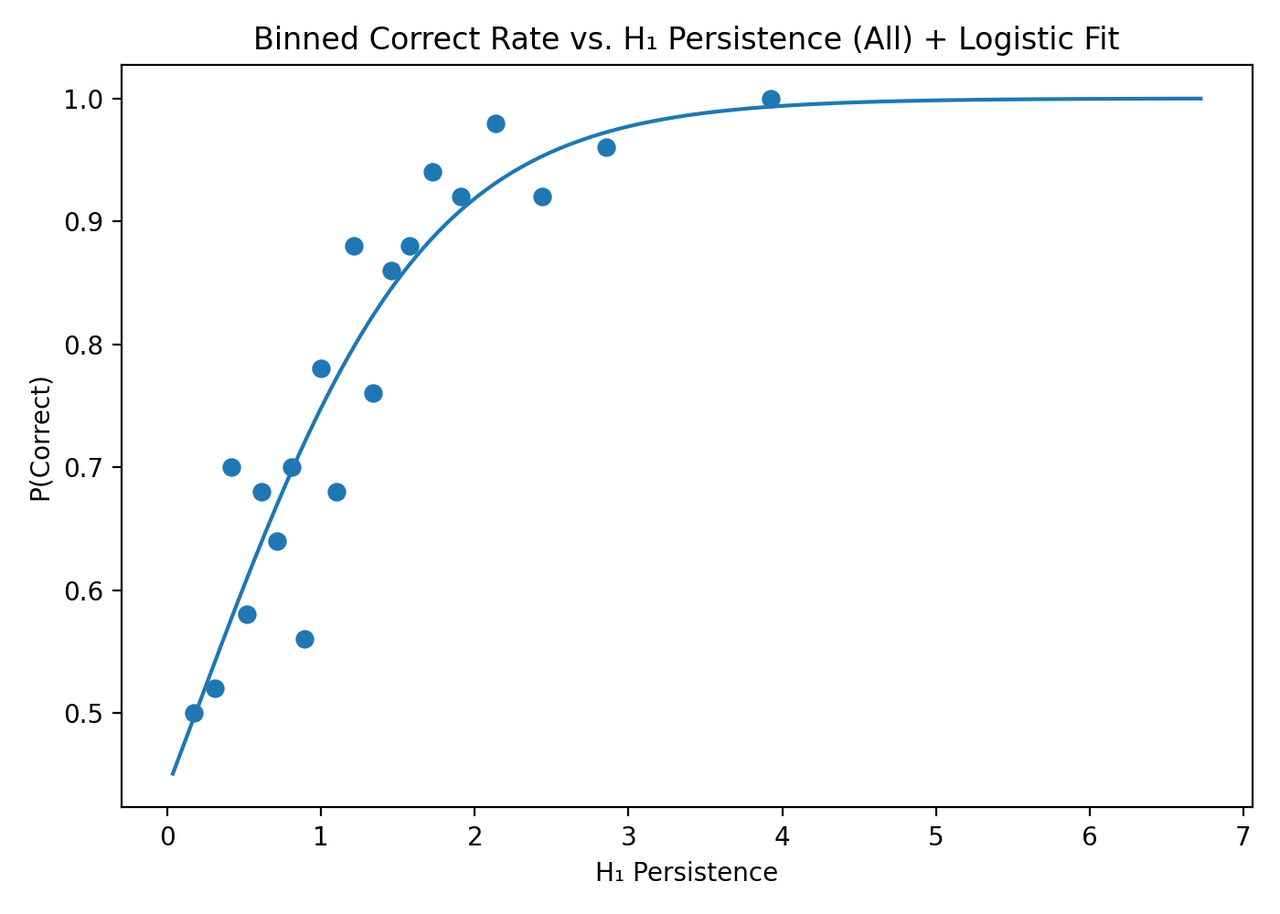

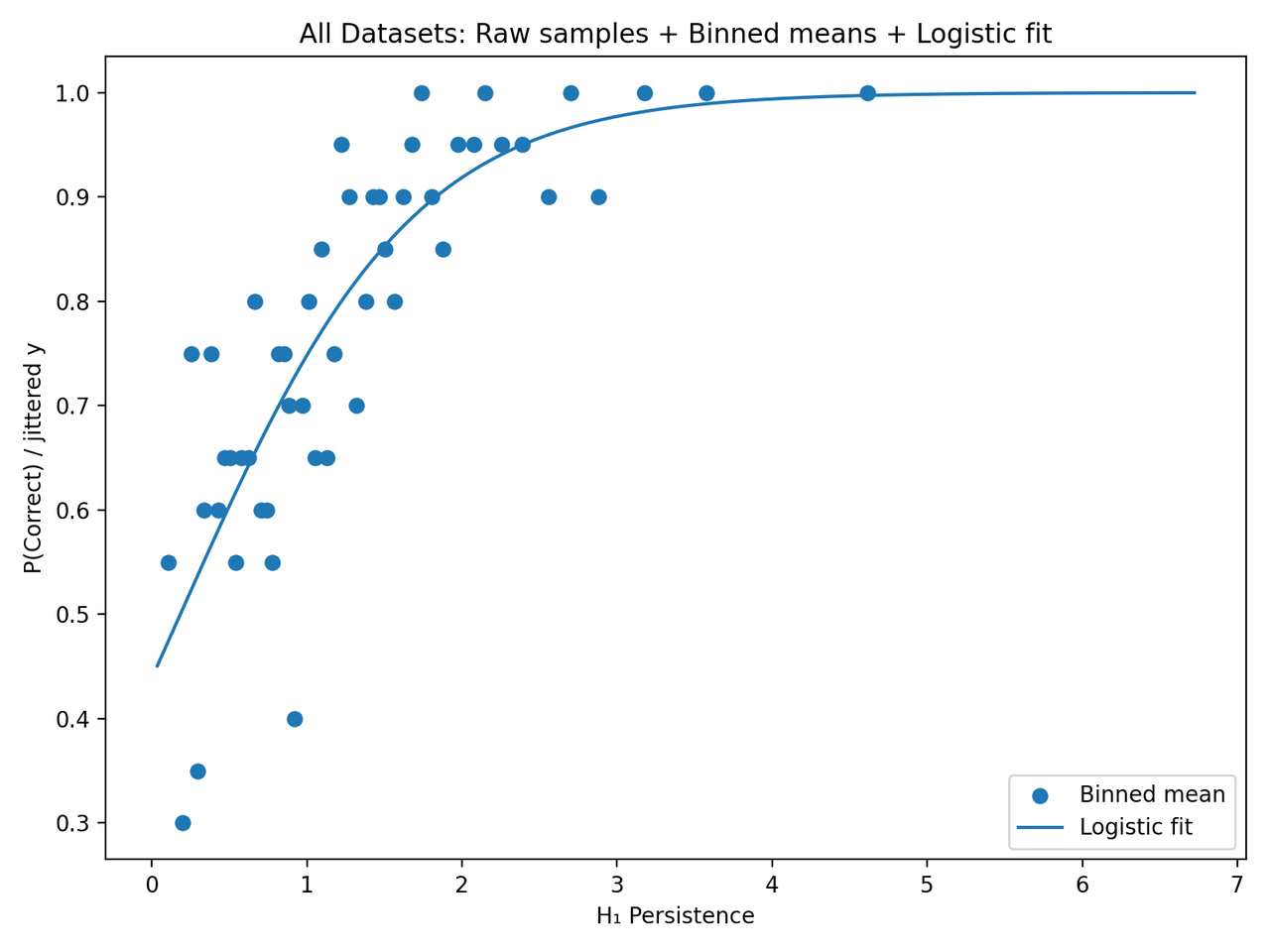

📊 实验亮点

GHS-TDA在多个推理基准测试中表现出色,显著优于现有的CoT方法。具体性能数据和提升幅度在论文中进行了详细的展示,表明GHS-TDA在提高LLM推理准确性和鲁棒性方面具有显著优势。实验结果验证了全局假设空间和拓扑数据分析相结合的有效性。

🎯 应用场景

GHS-TDA框架可应用于各种需要复杂推理的场景,例如数学问题求解、常识推理、代码生成和知识图谱推理等。该研究有助于提高人工智能系统的可靠性和可解释性,并有望在智能客服、自动驾驶、医疗诊断等领域发挥重要作用。未来,该方法可以进一步扩展到多模态推理和人机协同推理等更复杂的场景。

📄 摘要(原文)

Chain-of-Thought (CoT) has been shown to significantly improve the reasoning accuracy of large language models (LLMs) on complex tasks. However, due to the autoregressive, step-by-step generation paradigm, existing CoT methods suffer from two fundamental limitations. First, the reasoning process is highly sensitive to early decisions: once an initial error is introduced, it tends to propagate and amplify through subsequent steps, while the lack of a global coordination and revision mechanism makes such errors difficult to correct, ultimately leading to distorted reasoning chains. Second, current CoT approaches lack structured analysis techniques for filtering redundant reasoning and extracting key reasoning features, resulting in unstable reasoning processes and limited interpretability. To address these issues, we propose GHS-TDA. GHS-TDA first constructs a semantically enriched global hypothesis graph to aggregate, align, and coordinate multiple candidate reasoning paths, thereby providing alternative global correction routes when local reasoning fails. It then applies topological data analysis based on persistent homology to capture stable multi-scale structures, remove redundancy and inconsistencies, and extract a more reliable reasoning skeleton. By jointly leveraging reasoning diversity and topological stability, GHS-TDA achieves self-adaptive convergence, produces high-confidence and interpretable reasoning paths, and consistently outperforms strong baselines in terms of both accuracy and robustness across multiple reasoning benchmarks.