Gesturing Toward Abstraction: Multimodal Convention Formation in Collaborative Physical Tasks

作者: Kiyosu Maeda, William P. McCarthy, Ching-Yi Tsai, Jeffrey Mu, Haoliang Wang, Robert D. Hawkins, Judith E. Fan, Parastoo Abtahi

分类: cs.HC, cs.AI

发布日期: 2026-02-09

备注: Accepted at the 2026 CHI Conference on Human Factors in Computing Systems (CHI 2026). 15 pages

期刊: Proceedings of the 2026 CHI Conference on Human Factors in Computing Systems (CHI '26), ACM, 2026

💡 一句话要点

研究人机协作中多模态沟通策略的演化,并提出基于概率模型的抽象概念形成方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 多模态沟通 约定形成 增强现实 概率模型

📋 核心要点

- 现有方法缺乏对人机协作中多模态沟通策略演化的深入理解,尤其是在物理任务中。

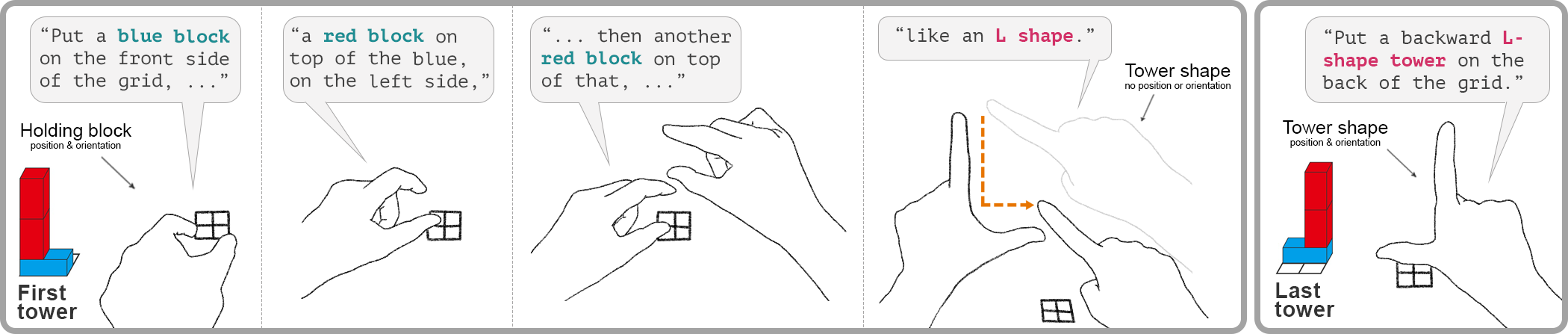

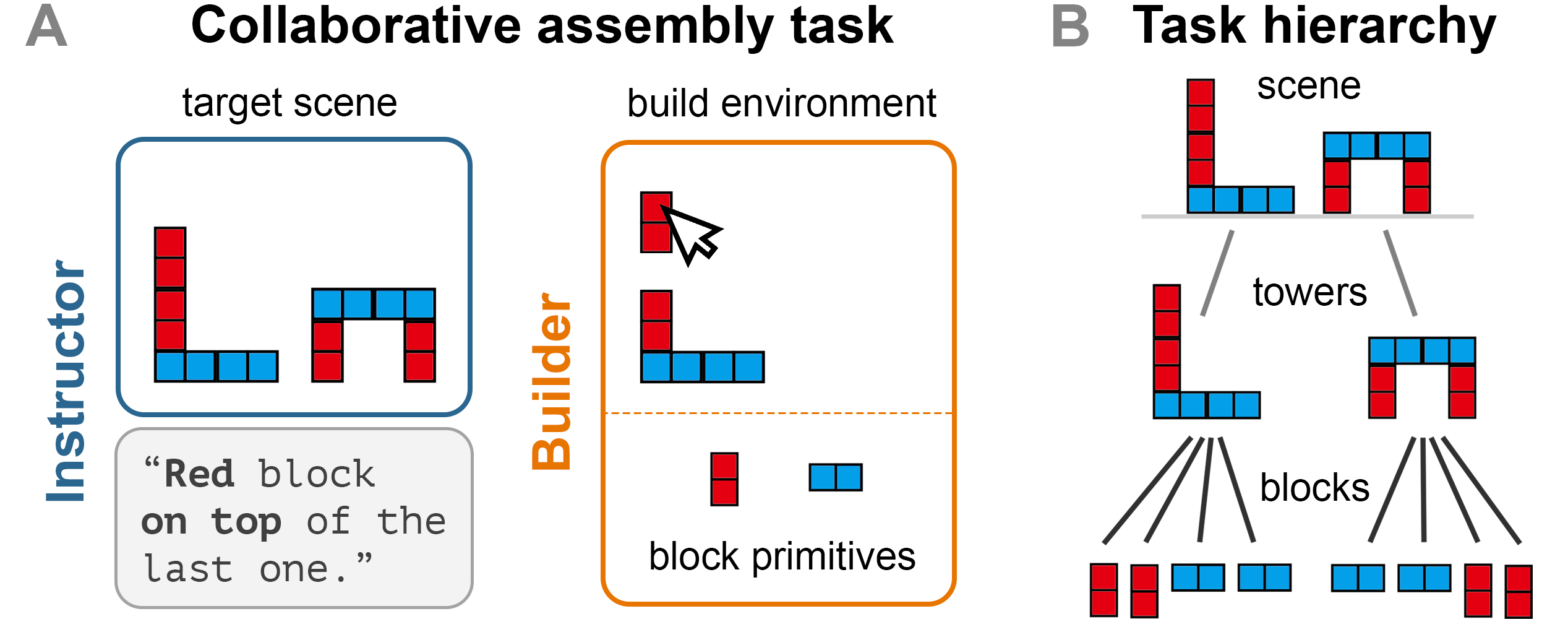

- 通过在线和实验室研究,论文探索了参与者在协作搭建积木塔时,如何形成语言和手势抽象。

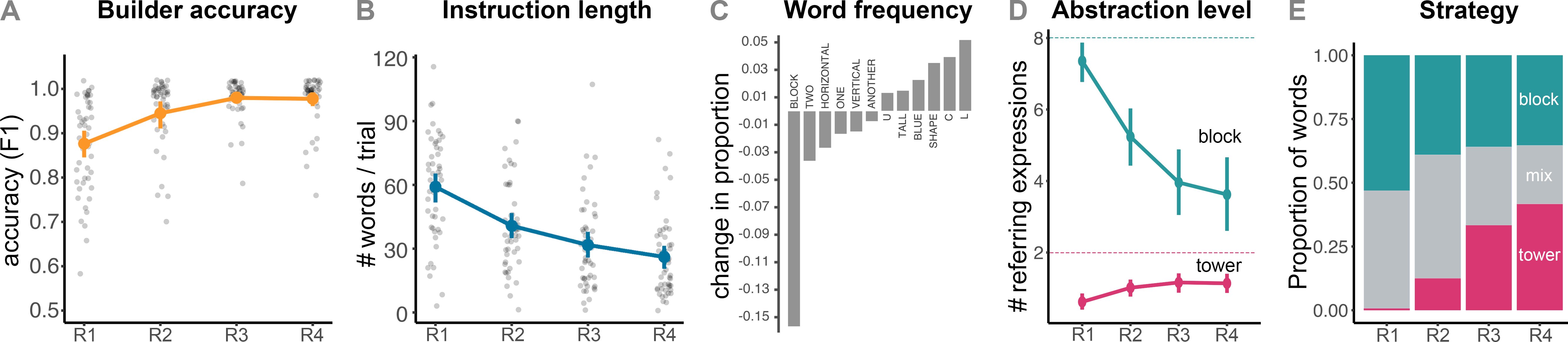

- 实验结果表明,参与者通过建立语言和手势抽象,并利用跨模态冗余来提高协作效率和准确性。

📝 摘要(中文)

人类智能的一个典型特征是能够随着时间的推移创建临时约定,从而高效地实现共同目标。本文研究了在人们协调共享程序抽象时,沟通策略如何通过重复协作而演变。为此,我们进行了一项在线单模态研究(n = 98),使用自然语言来探索抽象层次结构。在一个后续的实验室研究(n = 40)中,我们检查了在物理协作过程中多模态沟通(语音和手势)如何变化。参与者使用增强现实来隔离其伙伴的手和声音;一名参与者观看一个3D虚拟塔,并向另一名参与者发送指令,后者建造物理塔。参与者通过建立语言和手势抽象,并使用跨模态冗余来强调与先前交互的关键变化,从而变得更快和更准确。基于这些发现,我们将约定形成的概率模型扩展到多模态设置,捕捉模态偏好的变化。我们的发现和模型为设计位于物理世界中的、具有约定意识的智能体提供了构建块。

🔬 方法详解

问题定义:论文旨在解决人机协作中,如何通过多模态沟通(语音和手势)形成共享的抽象概念,从而提高协作效率和准确性的问题。现有方法通常关注单模态沟通或缺乏对沟通策略演化的动态建模。

核心思路:论文的核心思路是研究参与者在重复的物理协作任务中,如何自发地形成语言和手势上的约定,并利用这些约定来简化沟通,提高效率。通过观察和分析参与者的行为,提取出多模态沟通的模式和规律,并将其建模为概率模型。

技术框架:论文采用了混合研究方法,包括在线单模态研究和实验室多模态研究。在线研究侧重于自然语言的抽象层次结构,而实验室研究则关注语音和手势在物理协作中的演变。实验室研究使用增强现实技术隔离参与者的手和声音,模拟真实的协作环境。参与者被分为两组,一组观看3D虚拟塔并发送指令,另一组根据指令搭建物理塔。

关键创新:论文的关键创新在于将约定形成的概率模型扩展到多模态设置,能够捕捉模态偏好的变化。该模型能够学习参与者在不同阶段对语音和手势的偏好,并预测未来的沟通策略。此外,论文还强调了跨模态冗余在提高沟通效率和鲁棒性方面的作用。

关键设计:论文设计了精巧的实验任务,通过重复的积木塔搭建任务,诱导参与者形成约定。实验中记录了参与者的语音和手势数据,并对其进行分析。概率模型的具体形式未知,但推测可能涉及到隐马尔可夫模型或贝叶斯网络等技术,用于建模沟通策略的演化过程。

🖼️ 关键图片

📊 实验亮点

实验室研究表明,参与者通过建立语言和手势抽象,并使用跨模态冗余来强调与先前交互的关键变化,从而变得更快和更准确。具体性能数据未知,但研究强调了多模态沟通在提高协作效率方面的显著作用。概率模型能够捕捉模态偏好的变化,为理解人机协作中的沟通动态提供了新的视角。

🎯 应用场景

该研究成果可应用于人机协作机器人、远程协作系统、虚拟现实/增强现实环境等领域。通过理解和模拟人类的沟通策略,可以设计出更智能、更自然的协作机器人,提高人机协作的效率和用户体验。此外,该研究还可以为教育和培训领域提供新的思路,例如,设计基于多模态沟通的教学系统。

📄 摘要(原文)

A quintessential feature of human intelligence is the ability to create ad hoc conventions over time to achieve shared goals efficiently. We investigate how communication strategies evolve through repeated collaboration as people coordinate on shared procedural abstractions. To this end, we conducted an online unimodal study (n = 98) using natural language to probe abstraction hierarchies. In a follow-up lab study (n = 40), we examined how multimodal communication (speech and gestures) changed during physical collaboration. Pairs used augmented reality to isolate their partner's hand and voice; one participant viewed a 3D virtual tower and sent instructions to the other, who built the physical tower. Participants became faster and more accurate by establishing linguistic and gestural abstractions and using cross-modal redundancy to emphasize key changes from previous interactions. Based on these findings, we extend probabilistic models of convention formation to multimodal settings, capturing shifts in modality preferences. Our findings and model provide building blocks for designing convention-aware intelligent agents situated in the physical world.