Whose Name Comes Up? Benchmarking and Intervention-Based Auditing of LLM-Based Scholar Recommendation

作者: Lisette Espin-Noboa, Gonzalo Gabriel Mendez

分类: cs.IR, cs.AI, cs.CY, cs.SI, physics.soc-ph

发布日期: 2026-02-09

备注: 28 pages: 8 pages in main (5 figures, 1 table), 20 pages in appendix (18 figures, 2 tables). under-review

💡 一句话要点

LLMScholarBench:基于干预审计LLM学者推荐,揭示干预措施对模型性能的影响。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM审计 学者推荐 用户干预 基准测试 检索增强生成

📋 核心要点

- 现有LLM学者推荐审计忽略了用户干预的影响,无法区分模型本身和部署策略导致的问题。

- LLMScholarBench基准联合评估模型基础设施和用户干预,衡量技术质量和社会表征。

- 实验表明用户干预并非总能改进,而是在不同维度上重新分配误差,需要权衡。

📝 摘要(中文)

大型语言模型(LLM)越来越多地被用于学术专家推荐。现有的审计方法通常孤立地评估模型输出,很大程度上忽略了最终用户在推理时的干预。因此,诸如拒绝、幻觉和不均衡覆盖等问题是源于模型选择还是部署决策仍然不清楚。我们引入了LLMScholarBench,这是一个用于审计基于LLM的学者推荐的基准,它联合评估了模型基础设施和最终用户在多个任务中的干预。LLMScholarBench使用九个指标来衡量技术质量和社会表征。我们在物理专家推荐中实例化了该基准,并审计了22个LLM在温度变化、表征约束提示和通过网络搜索的检索增强生成(RAG)下的表现。结果表明,最终用户干预并没有产生一致的改进,而是重新分配了各个维度上的误差。较高的温度会降低有效性、一致性和事实性。表征约束提示提高了多样性,但牺牲了事实性,而RAG主要提高了技术质量,但降低了多样性和均等性。总的来说,最终用户干预重塑了权衡,而不是提供了一个通用的解决方案。我们发布了代码和数据,可以通过替换特定领域的ground truth和指标来适应其他学科。

🔬 方法详解

问题定义:论文旨在解决现有LLM学者推荐系统审计方法的不足,即忽略了最终用户在推理过程中的干预行为。现有审计方法通常孤立地评估模型输出,无法区分模型本身的问题(如幻觉、拒绝回答)和部署策略(如提示工程、检索增强)的影响。这导致无法有效诊断和改进LLM学者推荐系统。

核心思路:论文的核心思路是构建一个综合性的基准测试框架,该框架不仅评估LLM本身的技术质量,还考虑最终用户的干预行为,并分析这些干预对模型性能的影响。通过系统性地评估不同干预策略(如温度调整、表征约束提示、RAG)对模型在多个维度(如准确性、多样性、公平性)上的表现,揭示干预措施带来的权衡。

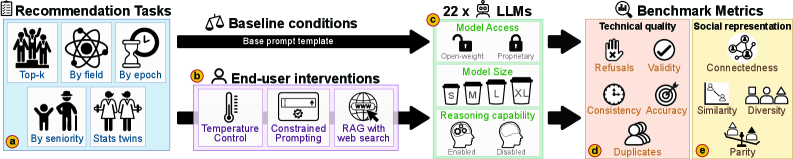

技术框架:LLMScholarBench基准测试框架包含以下几个主要组成部分: 1. 数据集:包含领域相关的学者信息和任务定义(例如,给定一个研究方向,推荐该方向的专家)。 2. 评估指标:包括技术质量指标(如准确性、一致性、事实性)和社会表征指标(如多样性、均等性)。 3. 干预策略:包括温度调整(控制生成文本的随机性)、表征约束提示(引导模型生成更具代表性的结果)、检索增强生成(RAG,利用外部知识库提升生成质量)。 4. 审计流程:系统性地评估不同LLM在不同干预策略下的表现,并分析其对各项指标的影响。

关键创新:论文的关键创新在于: 1. 提出了一个综合性的LLM学者推荐审计基准,考虑了用户干预的影响。 2. 设计了一系列评估指标,同时衡量技术质量和社会表征。 3. 系统性地评估了不同干预策略对模型性能的影响,揭示了干预措施带来的权衡。

关键设计: 1. 温度调整:通过调整LLM的温度参数,控制生成文本的随机性,探索模型在不同置信度下的表现。 2. 表征约束提示:设计特定的提示语,引导模型生成更具代表性的结果,例如,要求模型推荐来自不同机构或不同背景的学者。 3. 检索增强生成(RAG):利用外部知识库(如网络搜索)检索相关信息,并将其融入到LLM的生成过程中,以提高生成结果的准确性和事实性。 4. 评估指标:设计了九个评估指标,包括有效性、一致性、事实性、覆盖率、多样性、均等性等,全面评估模型在技术和社会维度上的表现。

🖼️ 关键图片

📊 实验亮点

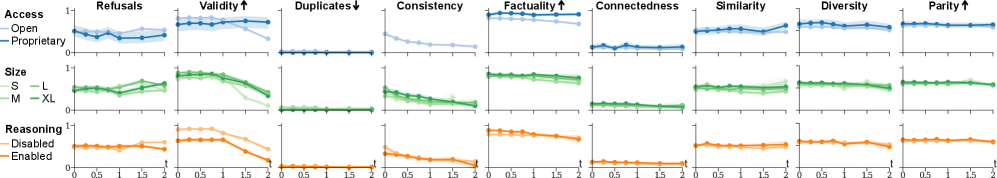

实验结果表明,提高温度会降低LLM的有效性、一致性和事实性;表征约束提示可以提高多样性,但会牺牲事实性;RAG可以提高技术质量,但会降低多样性和均等性。总体而言,用户干预并不能提供通用的解决方案,而是在不同维度上重新分配误差,需要仔细权衡。

🎯 应用场景

该研究成果可应用于改进学术专家推荐系统,帮助用户更准确、全面地找到合适的专家。通过理解不同干预策略对模型性能的影响,可以更好地设计和部署LLM,避免潜在的偏见和不公平现象。此外,该基准测试框架可以推广到其他领域,用于评估和改进其他基于LLM的推荐系统。

📄 摘要(原文)

Large language models (LLMs) are increasingly used for academic expert recommendation. Existing audits typically evaluate model outputs in isolation, largely ignoring end-user inference-time interventions. As a result, it remains unclear whether failures such as refusals, hallucinations, and uneven coverage stem from model choice or deployment decisions. We introduce LLMScholarBench, a benchmark for auditing LLM-based scholar recommendation that jointly evaluates model infrastructure and end-user interventions across multiple tasks. LLMScholarBench measures both technical quality and social representation using nine metrics. We instantiate the benchmark in physics expert recommendation and audit 22 LLMs under temperature variation, representation-constrained prompting, and retrieval-augmented generation (RAG) via web search. Our results show that end-user interventions do not yield uniform improvements but instead redistribute error across dimensions. Higher temperature degrades validity, consistency, and factuality. Representation-constrained prompting improves diversity at the expense of factuality, while RAG primarily improves technical quality while reducing diversity and parity. Overall, end-user interventions reshape trade-offs rather than providing a general fix. We release code and data that can be adapted to other disciplines by replacing domain-specific ground truth and metrics.