Root Cause Analysis Method Based on Large Language Models with Residual Connection Structures

作者: Liming Zhou, Ailing Liu, Hongwei Liu, Min He, Heng Zhang

分类: cs.AI

发布日期: 2026-02-09

💡 一句话要点

提出基于残差连接和大型语言模型的RC-LLM方法,用于微服务架构中的根因分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 根因分析 大型语言模型 微服务架构 残差连接 遥测数据

📋 核心要点

- 现有根因分析方法难以有效处理微服务架构中复杂的故障传播和高维遥测数据。

- RC-LLM利用残差连接结构融合多源遥测数据,并借助大型语言模型建模因果依赖关系。

- 实验表明,RC-LLM在微服务数据集上实现了高准确性和效率的根因分析。

📝 摘要(中文)

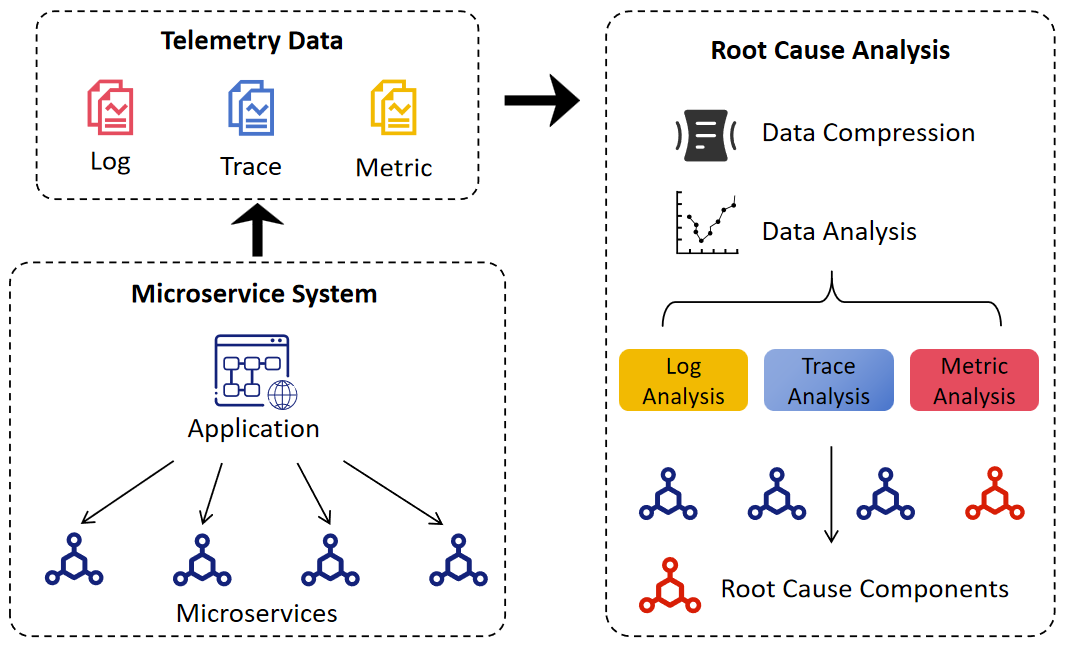

在复杂的大规模微服务架构中,根因定位仍然面临挑战。微服务之间复杂的故障传播以及遥测数据(包括指标、日志和追踪)的高维度限制了现有根因分析(RCA)方法的有效性。本文提出了一种基于残差连接并使用大型语言模型(LLM)的RCA方法,命名为RC-LLM。该方法设计了一种类似残差的层级融合结构来整合多源遥测数据,同时利用大型语言模型的上下文推理能力来建模时间和跨微服务的因果依赖关系。在CCF-AIOps微服务数据集上的实验结果表明,RC-LLM在根因分析中实现了强大的准确性和效率。

🔬 方法详解

问题定义:论文旨在解决复杂微服务架构下的根因分析问题。现有方法难以有效处理微服务之间复杂的故障传播,以及指标、日志、追踪等高维遥测数据带来的挑战,导致根因定位的准确性和效率不高。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的上下文推理能力,结合残差连接的思想,对多源遥测数据进行融合和分析,从而更准确地识别根因。通过LLM建模时间和跨微服务的因果依赖关系,提升根因分析的准确性。

技术框架:RC-LLM方法包含以下主要模块:1) 多源遥测数据收集与预处理;2) 基于残差连接的层级融合结构,将指标、日志和追踪数据进行融合;3) 利用大型语言模型对融合后的数据进行上下文推理,建模微服务之间的因果关系;4) 根因定位与分析,输出根因服务。

关键创新:RC-LLM的关键创新在于:1) 提出了基于残差连接的层级融合结构,有效整合了多源异构的遥测数据;2) 将大型语言模型引入根因分析领域,利用其强大的上下文推理能力建模复杂的因果关系。与传统方法相比,RC-LLM能够更好地处理高维数据和复杂的依赖关系。

关键设计:残差连接结构的具体设计未知,可能借鉴了ResNet等经典网络的思想,通过跳跃连接来缓解梯度消失问题,并促进信息的有效传递。大型语言模型的选择和微调策略未知,损失函数的设计也未明确说明,可能采用了交叉熵损失等常见的分类损失函数。具体参数设置未知。

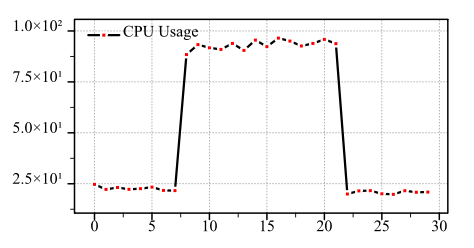

🖼️ 关键图片

📊 实验亮点

论文在CCF-AIOps微服务数据集上进行了实验,结果表明RC-LLM在根因分析的准确性和效率方面表现出色。具体的性能数据和对比基线未知,但摘要中强调了RC-LLM实现了“强大的准确性和效率”,表明该方法具有显著的优势。

🎯 应用场景

该研究成果可应用于大规模分布式系统的故障诊断和根因分析,帮助运维人员快速定位故障根源,缩短平均修复时间(MTTR),提高系统的可用性和稳定性。此外,该方法还可以扩展到其他领域的故障诊断,例如工业控制系统、智能交通系统等。

📄 摘要(原文)

Root cause localization remain challenging in complex and large-scale microservice architectures. The complex fault propagation among microservices and the high dimensionality of telemetry data, including metrics, logs, and traces, limit the effectiveness of existing root cause analysis (RCA) methods. In this paper, a residual-connection-based RCA method using large language model (LLM), named RC-LLM, is proposed. A residual-like hierarchical fusion structure is designed to integrate multi-source telemetry data, while the contextual reasoning capability of large language models is leveraged to model temporal and cross-microservice causal dependencies. Experimental results on CCF-AIOps microservice datasets demonstrate that RC-LLM achieves strong accuracy and efficiency in root cause analysis.