Dynamics Within Latent Chain-of-Thought: An Empirical Study of Causal Structure

作者: Zirui Li, Xuefeng Bai, Kehai Chen, Yizhi Li, Jian Yang, Chenghua Lin, Min Zhang

分类: cs.AI, cs.CL

发布日期: 2026-02-09

备注: 22 pages

💡 一句话要点

通过因果结构分析,揭示隐式思维链中的动态过程与决策机制

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐式思维链 因果推断 结构因果模型 可解释性 推理 深度学习 干预分析

📋 核心要点

- 现有隐式思维链方法缺乏对中间步骤的有效评估手段,难以理解其内部运作机制。

- 论文将隐式思维链建模为结构因果模型,通过干预中间步骤来分析其对最终结果的影响。

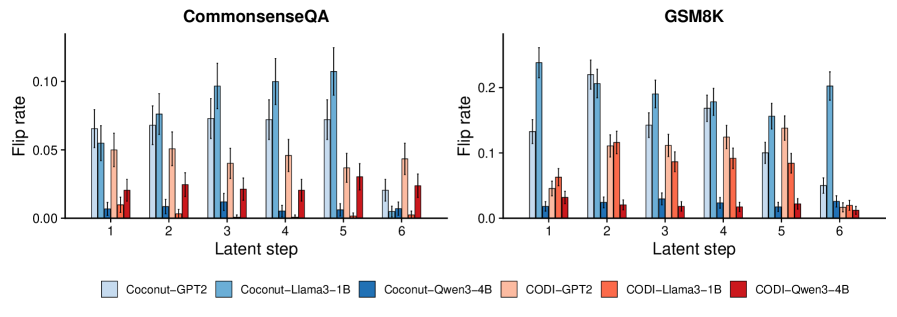

- 实验表明,隐式步骤具有分阶段功能和非局部路由特性,并揭示了早期输出偏差与后期表征承诺之间的差距。

📝 摘要(中文)

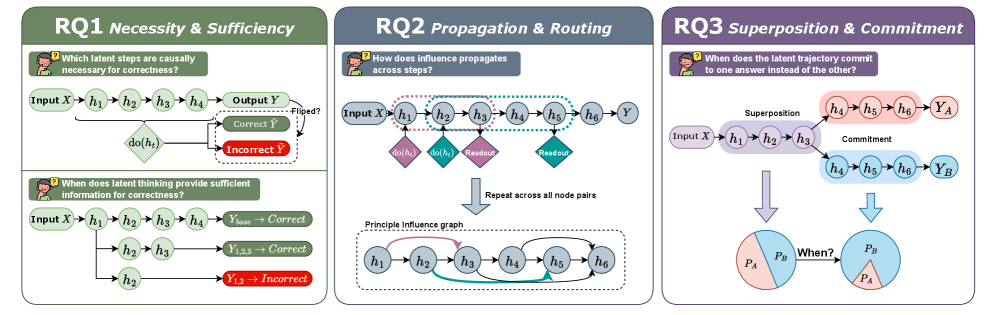

本文将隐式或连续思维链方法中难以评估的中间计算步骤,视为表征空间中可操纵的因果过程。通过将隐式步骤建模为结构因果模型(SCM)中的变量,并进行逐步的do-干预,分析其影响。研究了Coconut和CODI两种代表性范式在数学和通用推理任务上的表现,探讨了三个关键问题:(1)哪些步骤对正确性是因果必需的,以及答案何时可以提前确定;(2)影响如何在步骤间传播,这种结构与显式CoT相比如何;(3)中间轨迹是否保留了竞争性的答案模式,以及输出层面的承诺与表征承诺在不同步骤中如何不同。研究发现,隐式步骤预算的行为不像同质的额外深度,而更像是具有非局部路由的分阶段功能。同时,识别出早期输出偏差和后期表征承诺之间存在持续差距。这些结果促使人们采用模式条件和稳定性感知分析,以及相应的训练/解码目标,作为解释和改进隐式推理系统更可靠的工具。

🔬 方法详解

问题定义:现有隐式思维链方法,如Coconut和CODI,虽然在推理任务上表现出色,但其内部的中间计算步骤缺乏可解释性。难以理解哪些步骤对最终结果至关重要,以及信息如何在这些步骤之间传递。现有方法主要依赖于基于相关的探测方法,无法揭示步骤之间的因果关系,也无法有效评估中间步骤的质量。

核心思路:论文的核心思路是将隐式思维链中的中间步骤视为一个可操纵的因果过程。通过构建结构因果模型(SCM),将每个隐式步骤表示为一个变量,并使用do-干预来分析每个步骤对后续步骤和最终结果的影响。这种方法允许研究者探究步骤之间的因果关系,并识别对正确答案至关重要的步骤。

技术框架:整体框架包括以下几个主要步骤:1) 使用隐式思维链模型(如Coconut或CODI)处理推理任务。2) 将模型的中间隐层表示提取出来,作为结构因果模型中的变量。3) 构建结构因果模型,定义变量之间的关系。4) 对中间步骤进行do-干预,即强制将某个步骤的输出设置为特定值,然后观察对后续步骤和最终结果的影响。5) 分析干预结果,评估每个步骤的因果效应,并识别关键步骤。

关键创新:论文的关键创新在于将因果推断方法引入到隐式思维链的分析中。通过使用结构因果模型和do-干预,能够更深入地理解隐式思维链的内部运作机制,揭示步骤之间的因果关系,并识别对最终结果至关重要的步骤。这与传统的基于相关的分析方法有本质区别,后者只能揭示变量之间的相关性,而无法揭示因果关系。

关键设计:在实验中,论文使用了Coconut和CODI两种隐式思维链模型,并在数学和通用推理任务上进行了评估。关键的设计包括:1) 选择合适的干预策略,例如将中间步骤的输出设置为特定值或随机值。2) 使用合适的指标来评估干预效果,例如最终答案的准确率。3) 分析不同步骤的因果效应,识别对最终结果影响最大的步骤。此外,论文还分析了早期输出偏差和后期表征承诺之间的关系,并提出了模式条件和稳定性感知分析方法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,隐式步骤的行为更像是具有分阶段功能和非局部路由的模块,而非简单的增加深度。研究还发现,早期输出偏差和后期表征承诺之间存在显著差距,表明模型在早期阶段可能过早地倾向于某个答案,而后期阶段的表征仍然存在不确定性。这些发现为改进隐式推理系统提供了新的思路。

🎯 应用场景

该研究成果可应用于提升隐式思维链模型的可解释性和可靠性。通过识别关键步骤和优化信息传递路径,可以设计更高效、更鲁棒的推理系统。此外,该方法还可以用于诊断模型的推理缺陷,并指导模型的训练和改进。在实际应用中,可用于开发更智能的对话系统、问题解答系统和决策支持系统。

📄 摘要(原文)

Latent or continuous chain-of-thought methods replace explicit textual rationales with a number of internal latent steps, but these intermediate computations are difficult to evaluate beyond correlation-based probes. In this paper, we view latent chain-of-thought as a manipulable causal process in representation space by modeling latent steps as variables in a structural causal model (SCM) and analyzing their effects through step-wise $\mathrm{do}$-interventions. We study two representative paradigms (i.e., Coconut and CODI) on both mathematical and general reasoning tasks to investigate three key questions: (1) which steps are causally necessary for correctness and when answers become decidable early; (2) how does influence propagate across steps, and how does this structure compare to explicit CoT; and (3) do intermediate trajectories retain competing answer modes, and how does output-level commitment differ from representational commitment across steps. We find that latent-step budgets behave less like homogeneous extra depth and more like staged functionality with non-local routing, and we identify a persistent gap between early output bias and late representational commitment. These results motivate mode-conditional and stability-aware analyses -- and corresponding training/decoding objectives -- as more reliable tools for interpreting and improving latent reasoning systems.