OSCAR: Optimization-Steered Agentic Planning for Composed Image Retrieval

作者: Teng Wang, Rong Shan, Jianghao Lin, Junjie Wu, Tianyi Xu, Jianping Zhang, Wenteng Chen, Changwang Zhang, Zhaoxiang Wang, Weinan Zhang, Jun Wang

分类: cs.AI

发布日期: 2026-02-09

💡 一句话要点

提出OSCAR,通过优化引导的Agentic规划解决组合图像检索问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 组合图像检索 Agentic规划 轨迹优化 混合整数规划 视觉语言模型 离线-在线学习 多模态融合

📋 核心要点

- 现有组合图像检索方法或受限于单模型,或依赖次优的试错探索,难以有效处理复杂的视觉和文本约束。

- OSCAR将Agentic CIR重构为轨迹优化问题,通过离线计算最优轨迹并在线引导VLM规划器,实现更高效的检索。

- 实验表明,OSCAR在多个基准测试中超越现有方法,且仅需少量训练数据即可达到优异性能,泛化能力强。

📝 摘要(中文)

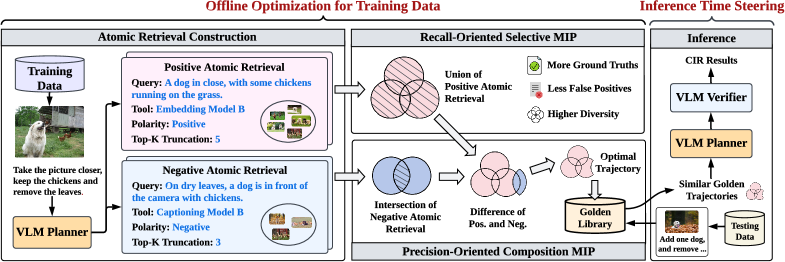

组合图像检索(CIR)需要在异构的视觉和文本约束下进行复杂的推理。现有方法主要分为两种范式:统一嵌入检索,受限于单模型局限性;启发式Agentic检索,受限于次优的试错编排。为此,我们提出了OSCAR,一个用于组合图像检索的优化引导的Agentic规划框架。我们首次将Agentic CIR从启发式搜索过程重新定义为一个有原则的轨迹优化问题。OSCAR没有依赖启发式试错探索,而是采用了一种新颖的离线-在线范式。在离线阶段,我们将CIR建模为原子检索选择和组合的两阶段混合整数规划问题,通过严格的布尔集合运算,从数学上推导出最大化训练样本真实覆盖率的最优轨迹。这些轨迹存储在一个黄金库中,作为在线推理时VLM规划器的上下文演示。在三个公共基准和一个私有工业基准上的大量实验表明,OSCAR始终优于SOTA基线。值得注意的是,它仅使用10%的训练数据就实现了卓越的性能,证明了规划逻辑的强大泛化能力,而不是数据集特定的记忆。

🔬 方法详解

问题定义:组合图像检索(CIR)旨在根据给定的文本查询,在图像库中检索出符合描述的图像。现有方法,如统一嵌入检索,难以有效融合异构的视觉和文本信息,且易受限于单模型的能力。而启发式Agentic检索则依赖于试错探索,效率低下,难以保证检索结果的最优性。因此,如何有效地利用视觉和文本信息,并避免盲目的搜索,是CIR面临的关键挑战。

核心思路:OSCAR的核心思路是将Agentic CIR过程建模为一个轨迹优化问题。通过离线计算最优的检索轨迹,并将其作为在线推理时的指导,从而避免了启发式搜索的盲目性,提高了检索效率和准确性。这种优化引导的策略能够更好地利用视觉和文本信息,实现更有效的组合图像检索。

技术框架:OSCAR框架主要分为离线和在线两个阶段。在离线阶段,首先将CIR问题建模为两阶段混合整数规划问题,包括原子检索选择和组合。然后,通过求解该优化问题,得到最大化训练样本真实覆盖率的最优轨迹,并将其存储在黄金库中。在线阶段,VLM规划器根据黄金库中的轨迹,进行上下文学习,从而引导检索过程。

关键创新:OSCAR最重要的创新在于将Agentic CIR从启发式搜索过程重新定义为一个有原则的轨迹优化问题。通过离线计算最优轨迹,并将其作为在线推理的指导,避免了启发式搜索的盲目性,提高了检索效率和准确性。此外,离线-在线范式也使得模型能够更好地泛化到新的数据集上。

关键设计:在离线阶段,OSCAR使用混合整数规划来建模CIR问题,其中布尔变量用于表示原子检索的选择,整数变量用于表示检索的顺序。目标函数是最大化训练样本的真实覆盖率。在线阶段,VLM规划器使用Transformer架构,以黄金库中的轨迹作为输入,预测下一步的检索动作。损失函数采用交叉熵损失,用于优化VLM规划器的参数。

🖼️ 关键图片

📊 实验亮点

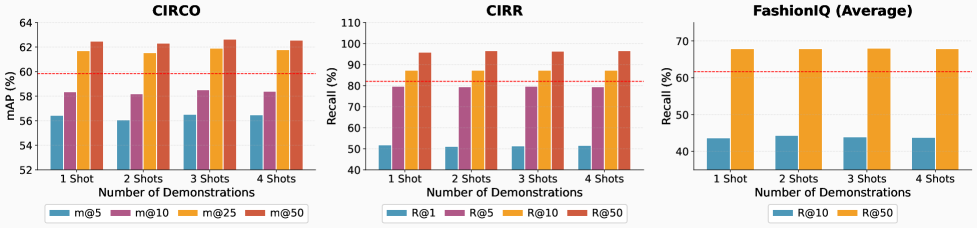

OSCAR在三个公共基准测试和一个私有工业基准测试中均取得了优于SOTA基线的性能。值得注意的是,OSCAR仅使用10%的训练数据就实现了卓越的性能,这表明OSCAR具有很强的泛化能力,能够有效地学习规划逻辑,而不是简单地记忆数据集。

🎯 应用场景

OSCAR在电商、搜索引擎、智能相册等领域具有广泛的应用前景。例如,用户可以通过组合文本描述来精确搜索商品或图片,提高搜索效率和用户体验。此外,该方法还可以应用于智能客服,根据用户的问题描述,检索出相关的知识库条目或解决方案。未来,OSCAR有望进一步扩展到视频检索、跨模态对话等领域。

📄 摘要(原文)

Composed image retrieval (CIR) requires complex reasoning over heterogeneous visual and textual constraints. Existing approaches largely fall into two paradigms: unified embedding retrieval, which suffers from single-model myopia, and heuristic agentic retrieval, which is limited by suboptimal, trial-and-error orchestration. To this end, we propose OSCAR, an optimization-steered agentic planning framework for composed image retrieval. We are the first to reformulate agentic CIR from a heuristic search process into a principled trajectory optimization problem. Instead of relying on heuristic trial-and-error exploration, OSCAR employs a novel offline-online paradigm. In the offline phase, we model CIR via atomic retrieval selection and composition as a two-stage mixed-integer programming problem, mathematically deriving optimal trajectories that maximize ground-truth coverage for training samples via rigorous boolean set operations. These trajectories are then stored in a golden library to serve as in-context demonstrations for online steering of VLM planner at online inference time. Extensive experiments on three public benchmarks and a private industrial benchmark show that OSCAR consistently outperforms SOTA baselines. Notably, it achieves superior performance using only 10% of training data, demonstrating strong generalization of planning logic rather than dataset-specific memorization.