Toward Formalizing LLM-Based Agent Designs through Structural Context Modeling and Semantic Dynamics Analysis

作者: Haoyu Jia, Kento Kawaharazuka, Kei Okada

分类: cs.AI

发布日期: 2026-02-09

💡 一句话要点

提出结构化上下文模型,形式化LLM Agent设计并提升动态任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 形式化模型 上下文建模 语义动态分析 Agent工程 机器人 自主决策

📋 核心要点

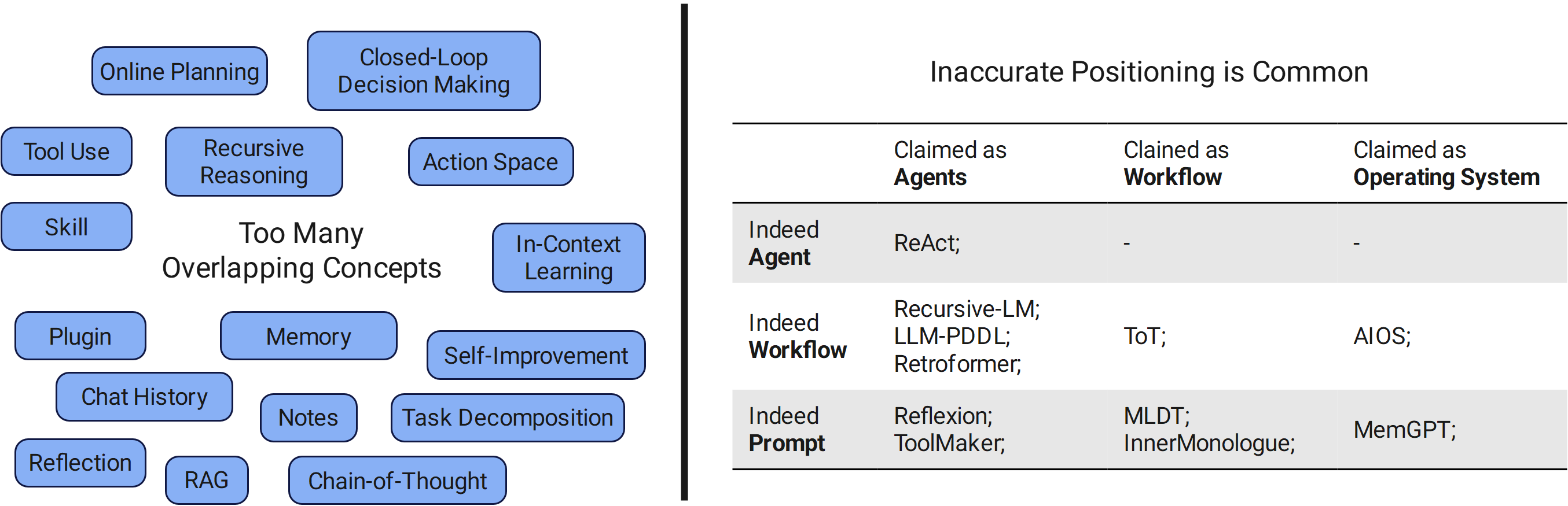

- 现有LLM Agent研究缺乏统一的形式化模型,导致概念混淆和实现细节纠缠。

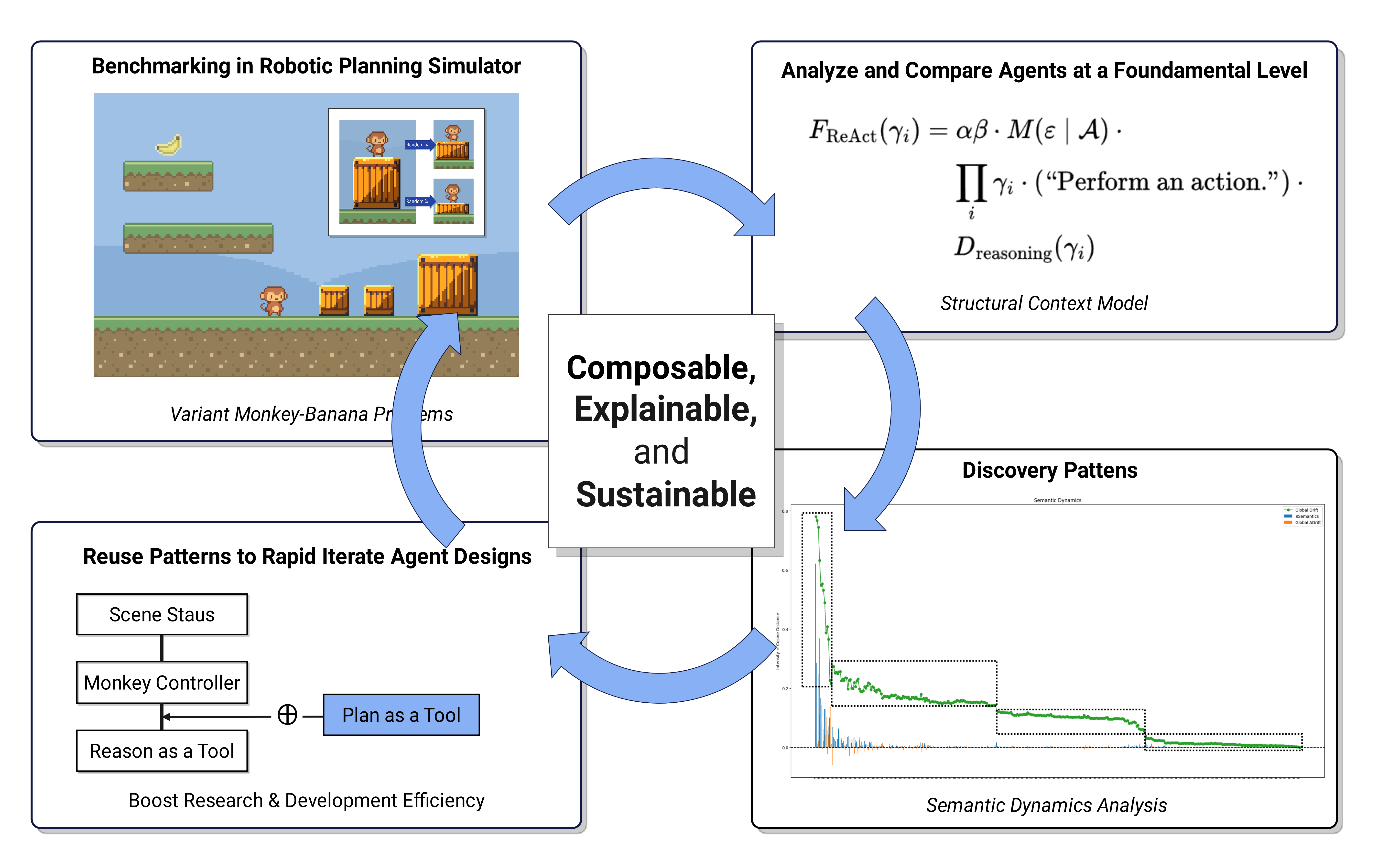

- 论文提出结构化上下文模型,并结合声明式框架和语义动态分析,实现Agent设计的形式化。

- 实验表明,该框架在动态猴子-香蕉问题中显著提升了Agent的成功率,最高提升32%。

📝 摘要(中文)

当前关于大型语言模型(LLM)Agent的研究是分散的:概念框架和方法论原则的讨论经常与低级实现细节交织在一起,导致读者和作者在表面上不同的概念的激增中迷失方向。我们认为,这种分散性主要源于缺乏一个可分析的、自洽的形式模型,该模型能够对LLM Agent进行独立于实现的表征和比较。为了解决这一差距,我们提出了 exttt{Structural Context Model},这是一个从上下文结构的角度分析和比较LLM Agent的形式模型。在此基础上,我们引入了两个互补的组件,它们共同涵盖了LLM Agent研究和开发的完整生命周期:(1)一个声明式的实现框架;(2)一个可持续的Agent工程工作流程, exttt{Semantic Dynamics Analysis}。所提出的工作流程提供了对Agent机制的原则性见解,并支持快速、系统的设计迭代。我们在猴子-香蕉问题的动态变体上展示了完整框架的有效性,使用我们的方法设计的Agent在最具挑战性的设置中,成功率提高了高达32个百分点。

🔬 方法详解

问题定义:现有LLM Agent研究缺乏一个统一、可分析的形式化模型,导致研究者难以在概念层面进行比较和分析,容易陷入实现细节。这阻碍了LLM Agent设计的系统化和高效迭代。现有方法往往将概念框架、方法论原则和具体实现细节混杂在一起,缺乏清晰的理论基础。

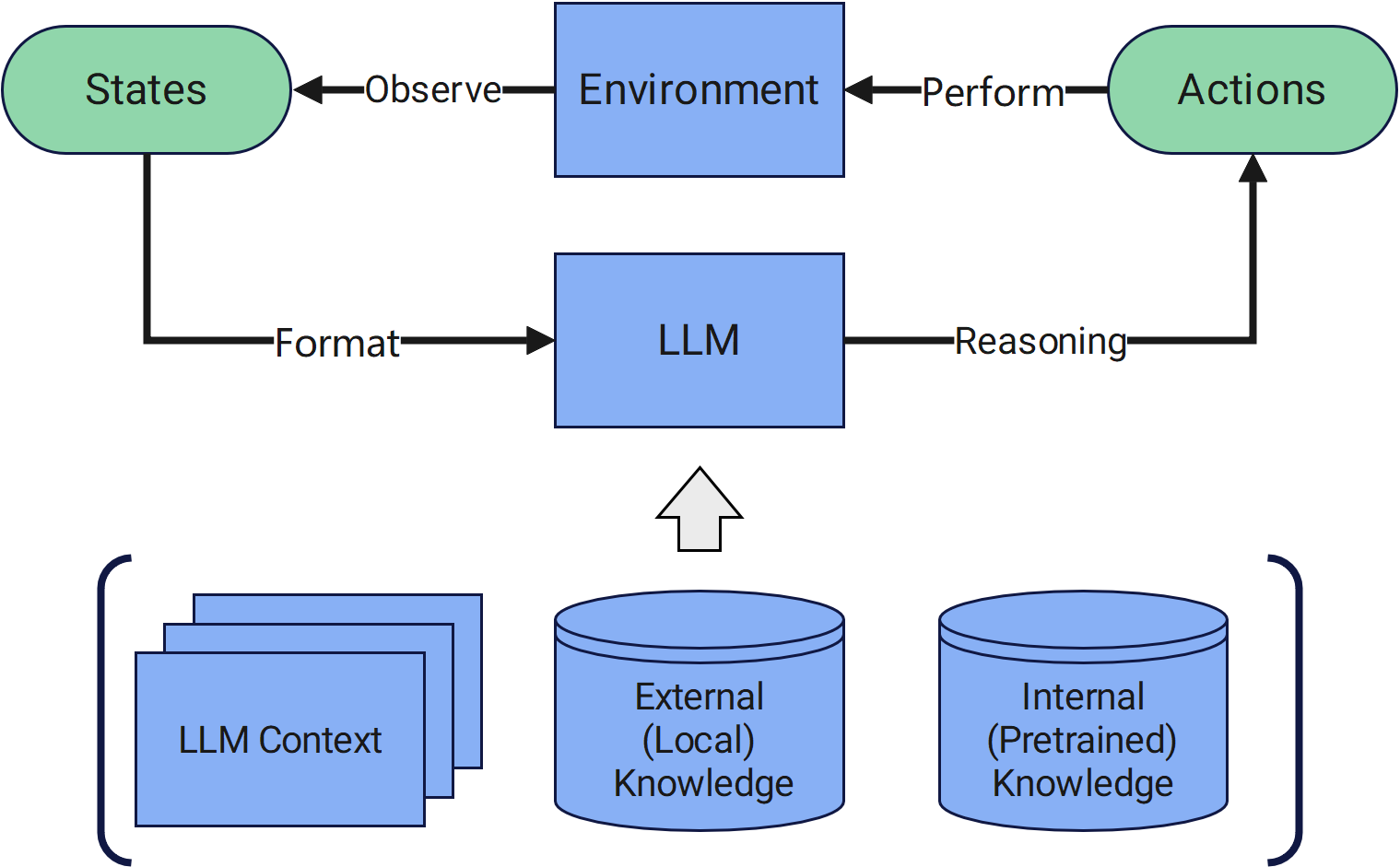

核心思路:论文的核心思路是建立一个形式化的上下文模型(Structural Context Model),用于描述和分析LLM Agent的行为。通过形式化Agent的上下文结构,可以实现独立于具体实现的Agent表征和比较。此外,论文还提出了一个声明式的实现框架和一个可持续的Agent工程工作流程(Semantic Dynamics Analysis),以支持Agent设计的快速迭代和优化。

技术框架:该框架包含三个主要组成部分:1) 结构化上下文模型(Structural Context Model):用于形式化描述LLM Agent的上下文信息;2) 声明式实现框架:提供一种声明式的方式来构建LLM Agent,降低实现复杂度;3) 语义动态分析(Semantic Dynamics Analysis):一个Agent工程工作流程,用于分析Agent的行为,并指导Agent设计的迭代。整个流程从定义任务开始,然后使用结构化上下文模型设计Agent,通过声明式框架实现Agent,最后使用语义动态分析评估和优化Agent。

关键创新:论文最重要的技术创新点在于提出了结构化上下文模型,该模型提供了一种形式化的方式来描述和分析LLM Agent的上下文信息。与现有方法相比,该模型更加抽象和通用,可以应用于不同的LLM Agent架构和任务。此外,语义动态分析提供了一种系统化的Agent工程方法,可以帮助研究者更好地理解Agent的行为,并进行有效的优化。

关键设计:结构化上下文模型的核心在于如何表示Agent的上下文信息。论文中可能定义了一系列数据结构和操作,用于表示和操作上下文信息。声明式实现框架可能包含一些预定义的组件和接口,用于简化Agent的构建过程。语义动态分析可能涉及一些指标和可视化工具,用于评估Agent的行为和性能。具体的参数设置、损失函数、网络结构等技术细节未知,需要查阅论文原文。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用该框架设计的Agent在动态猴子-香蕉问题中取得了显著的性能提升,成功率最高提升了32个百分点。这表明该框架能够有效地提高LLM Agent在复杂动态环境中的决策能力。

🎯 应用场景

该研究成果可应用于各种需要智能Agent自主决策的场景,例如机器人控制、智能客服、自动化流程管理等。通过形式化Agent设计,可以提高Agent的可靠性、可解释性和可维护性,加速Agent的开发和部署。

📄 摘要(原文)

Current research on large language model (LLM) agents is fragmented: discussions of conceptual frameworks and methodological principles are frequently intertwined with low-level implementation details, causing both readers and authors to lose track amid a proliferation of superficially distinct concepts. We argue that this fragmentation largely stems from the absence of an analyzable, self-consistent formal model that enables implementation-independent characterization and comparison of LLM agents. To address this gap, we propose the \texttt{Structural Context Model}, a formal model for analyzing and comparing LLM agents from the perspective of context structure. Building upon this foundation, we introduce two complementary components that together span the full lifecycle of LLM agent research and development: (1) a declarative implementation framework; and (2) a sustainable agent engineering workflow, \texttt{Semantic Dynamics Analysis}. The proposed workflow provides principled insights into agent mechanisms and supports rapid, systematic design iteration. We demonstrate the effectiveness of the complete framework on dynamic variants of the monkey-banana problem, where agents engineered using our approach achieve up to a 32 percentage points improvement in success rate on the most challenging setting.