Large Language Models in Peer-Run Community Behavioral Health Services: Understanding Peer Specialists and Service Users' Perspectives on Opportunities, Risks, and Mitigation Strategies

作者: Cindy Peng, Megan Chai, Gao Mo, Naveen Raman, Ningjing Tang, Shannon Pagdon, Margaret Swarbrick, Nev Jones, Fei Fang, Hong Shen

分类: cs.HC, cs.AI

发布日期: 2026-02-09

备注: 24 pages, 2 tables, 7 figures. Accepted and to appear in the Proceedings of CHI 2026

💡 一句话要点

探索大型语言模型在同伴互助社区心理健康服务中的应用与风险

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 同伴互助 心理健康服务 协同设计 生活经验 人机交互 信任构建

📋 核心要点

- 大型语言模型进入同伴互助领域,其规模和不透明性对信任和自主性构成挑战。

- 采用协同设计方法,探索LLM在同伴支持中的应用,关注机遇、风险和缓解策略。

- 研究表明LLM会重构室内动态,需以生活经验为中心,将信任视为共同构建。

📝 摘要(中文)

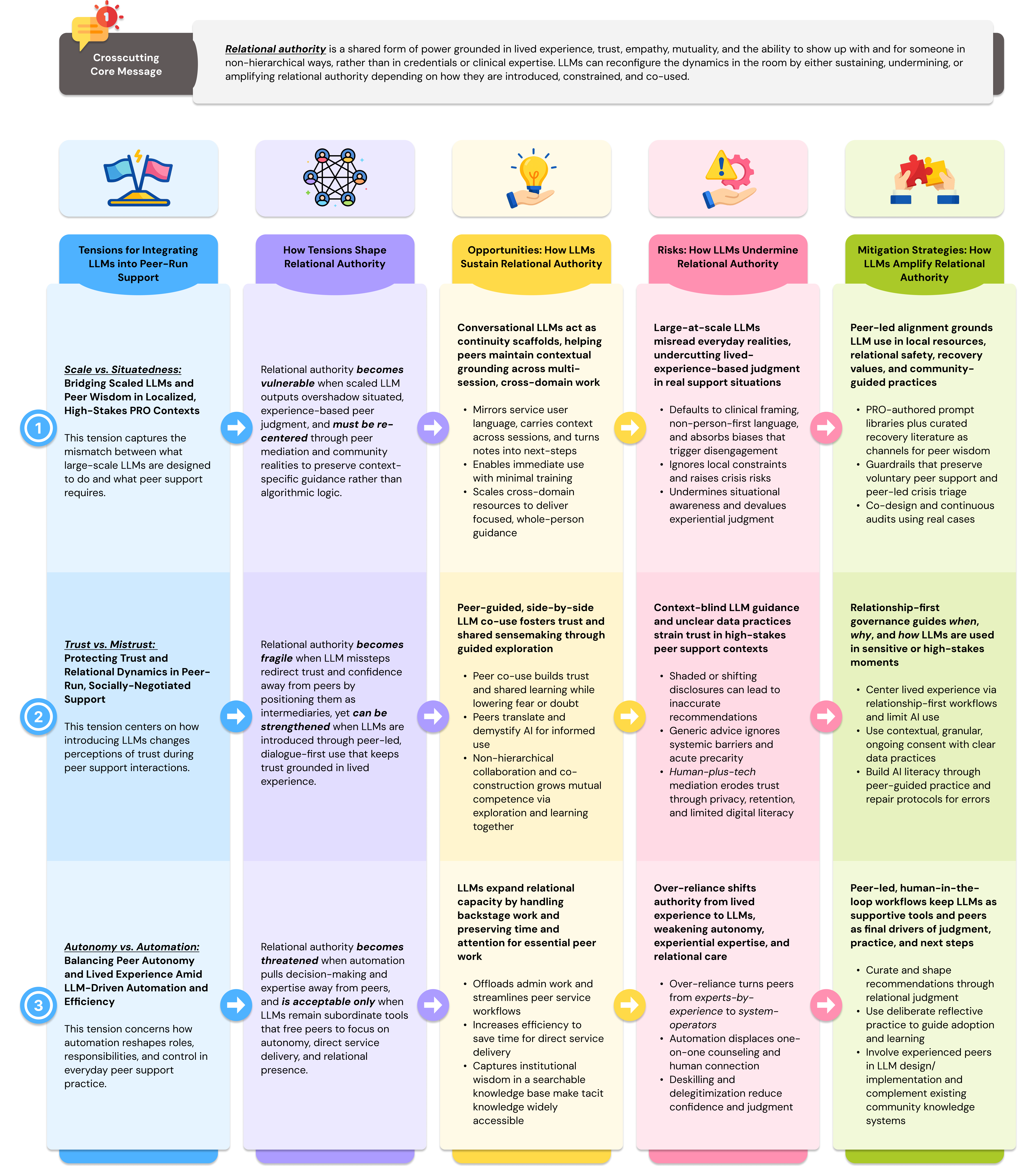

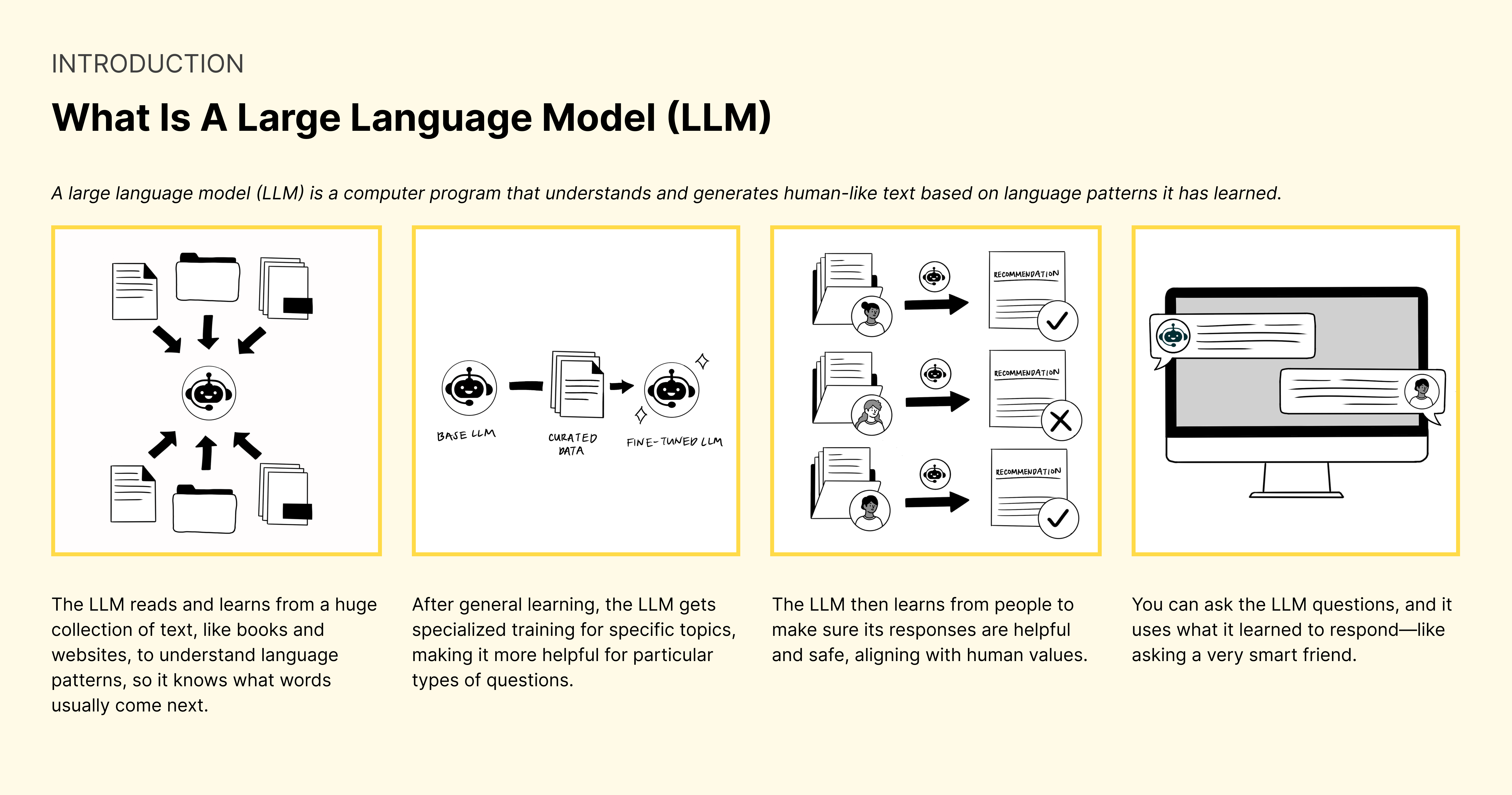

同伴互助组织(PROs)提供基于生活经验的关键性、以康复为基础的行为健康支持。随着大型语言模型(LLMs)进入该领域,其规模、对话能力和不透明性为情境性、信任和自主性带来了新的挑战。我们与美国东北部的一个全州PRO——新泽西州协作支持项目(CSPNJ)合作,使用漫画分镜这一协同设计方法,与16名同伴专家和10名服务使用者进行了研讨会,探讨了将基于LLM的推荐系统整合到同伴支持中的看法。研究结果表明,根据LLM的引入、约束和共同使用方式,它们可以通过维持、破坏或放大同伴支持的关系权威来重构室内动态。我们确定了三个方面的机遇、风险和缓解策略:桥接规模和地域性,保护信任和关系动态,以及在提高效率的同时保持同伴自主性。我们提出了以生活经验为中心的的设计启示,将信任重新定义为共同构建,并将LLM定位为高风险、社区主导的护理中的关系合作者,而不是临床工具。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLMs)在同伴互助社区心理健康服务中的应用所带来的机遇、风险以及相应的缓解策略。现有方法缺乏对LLM引入后,对同伴支持关系、信任和自主性的影响的深入理解,尤其是在高风险的社区主导护理环境中。

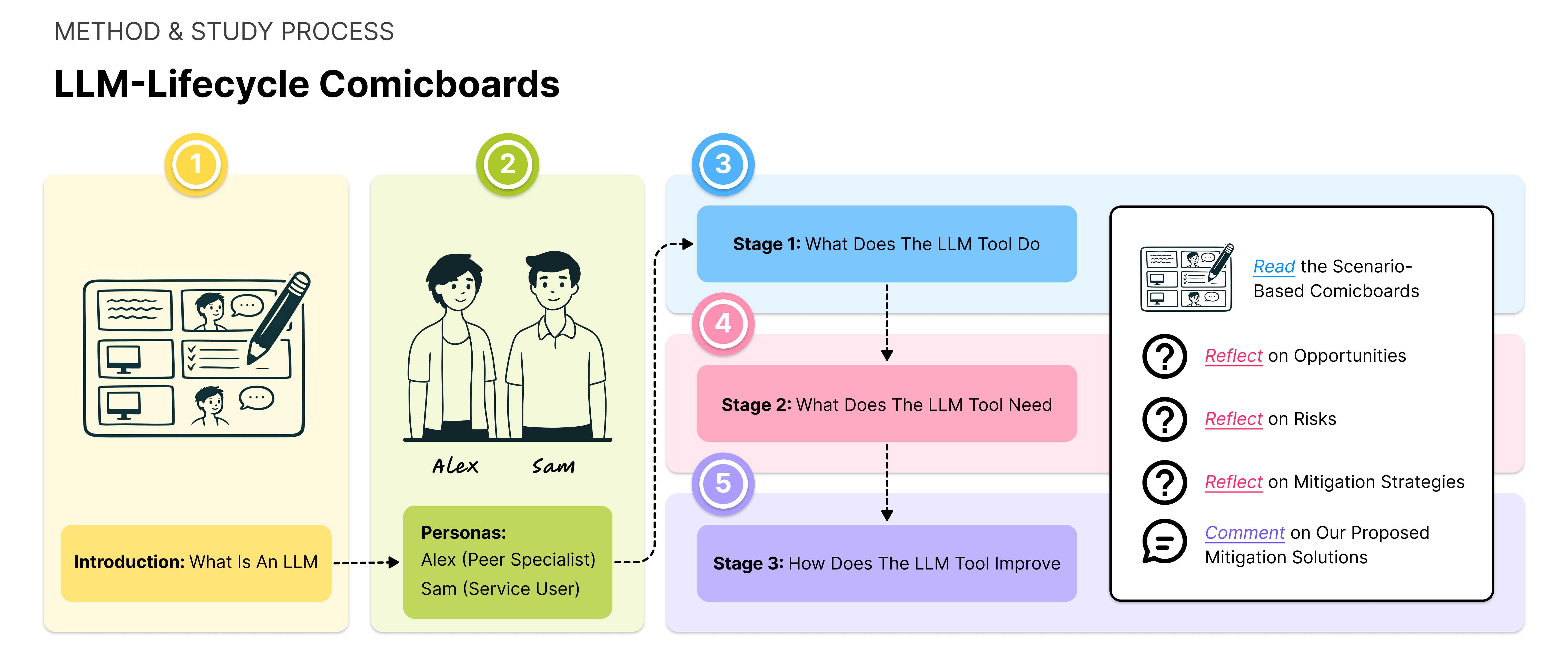

核心思路:论文的核心思路是通过与同伴专家和服务使用者进行协同设计,利用漫画分镜等方法,深入了解他们对LLM在同伴支持中应用的看法。通过识别机遇、风险和缓解策略,旨在为LLM在该领域的负责任应用提供设计指导,确保以生活经验为中心,并维护同伴支持的核心价值。

技术框架:该研究采用定性研究方法,主要包括以下几个阶段: 1. 合作建立:与新泽西州协作支持项目(CSPNJ)建立合作关系。 2. 研讨会设计:设计基于漫画分镜的协同设计研讨会。 3. 数据收集:与16名同伴专家和10名服务使用者进行研讨会,收集他们对LLM应用的看法。 4. 数据分析:对收集到的数据进行分析,识别机遇、风险和缓解策略。 5. 设计启示:基于分析结果,提出以生活经验为中心的设计启示。

关键创新:该研究的关键创新在于: 1. 以人为本的设计方法:采用协同设计方法,将同伴专家和服务使用者的生活经验纳入LLM的设计和应用过程中。 2. 关系视角:将LLM视为关系合作者,而非单纯的临床工具,强调其对同伴支持关系的影响。 3. 信任的重新定义:将信任重新定义为共同构建,强调在LLM应用过程中,需要建立和维护同伴专家、服务使用者和LLM之间的信任关系。

关键设计:研究的关键设计在于研讨会的设计,通过漫画分镜等方式,鼓励参与者表达他们对LLM应用的看法和担忧。此外,研究还关注LLM的引入方式、约束条件和共同使用方式,以及这些因素如何影响同伴支持的关系权威。

🖼️ 关键图片

📊 实验亮点

研究通过与16名同伴专家和10名服务使用者进行研讨会,揭示了LLM在同伴支持中的机遇、风险和缓解策略。研究发现,LLM可以通过多种方式重构室内动态,影响同伴支持的关系权威。研究强调了以生活经验为中心的设计的重要性,并提出了将信任重新定义为共同构建的观点。

🎯 应用场景

该研究成果可应用于各类同伴互助社区心理健康服务机构,指导其负责任地引入和使用大型语言模型。通过以生活经验为中心的设计,可以提升服务质量,维护同伴支持的核心价值,并促进更有效、更人性化的心理健康服务。未来,该研究可扩展到其他社区支持服务领域。

📄 摘要(原文)

Peer-run organizations (PROs) provide critical, recovery-based behavioral health support rooted in lived experience. As large language models (LLMs) enter this domain, their scale, conversationality, and opacity introduce new challenges for situatedness, trust, and autonomy. Partnering with Collaborative Support Programs of New Jersey (CSPNJ), a statewide PRO in the Northeastern United States, we used comicboarding, a co-design method, to conduct workshops with 16 peer specialists and 10 service users exploring perceptions of integrating an LLM-based recommendation system into peer support. Findings show that depending on how LLMs are introduced, constrained, and co-used, they can reconfigure in-room dynamics by sustaining, undermining, or amplifying the relational authority that grounds peer support. We identify opportunities, risks, and mitigation strategies across three tensions: bridging scale and locality, protecting trust and relational dynamics, and preserving peer autonomy amid efficiency gains. We contribute design implications that center lived-experience-in-the-loop, reframe trust as co-constructed, and position LLMs not as clinical tools but as relational collaborators in high-stakes, community-led care.