ToolSelf: Unifying Task Execution and Self-Reconfiguration via Tool-Driven Intrinsic Adaptation

作者: Jingqi Zhou, Sheng Wang, DeZhao Deng, Junwen Lu, Junwei Su, Qintong Li, Jiahui Gao, Hao Wu, Jiyue Jiang, Lingpeng Kong, Chuan Wu

分类: cs.AI

发布日期: 2026-02-08 (更新: 2026-02-22)

💡 一句话要点

ToolSelf:通过工具驱动的内在适应统一任务执行和自我重配置

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 Agentic系统 自我重配置 工具驱动 强化学习

📋 核心要点

- 现有Agentic系统受限于静态配置,无法适应任务动态变化,导致泛化能力不足。

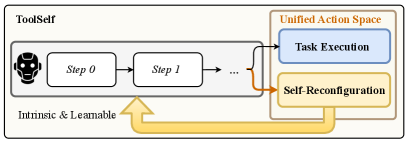

- ToolSelf将配置更新抽象为可调用工具,统一任务执行和自我调整,实现内在参数的动态调整。

- 配置感知两阶段训练(CAT)结合拒绝采样微调和强化学习,提升Agent的自适应能力,实验证明有效。

📝 摘要(中文)

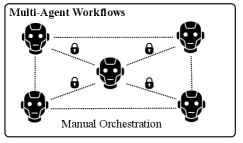

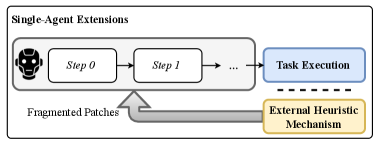

基于大型语言模型(LLMs)的Agentic系统在解决复杂、长时程任务方面展现了卓越的潜力。然而,它们的效力受到静态配置的根本限制,这些配置在执行前是固定的,无法适应不断演变的任务动态。现有的方法依赖于手动编排或基于启发式的修补,通常面临泛化能力差和碎片化优化的问题。为了超越这些限制,我们提出了ToolSelf,一种新颖的范式,能够实现工具驱动的运行时自我重配置。通过将配置更新抽象为可调用的工具,ToolSelf将任务执行和自我调整统一到一个单一的动作空间中,实现了从外部规则到内在参数的阶段转变。因此,Agent可以根据任务进展自主更新其子目标和上下文,并相应地调整其策略和工具箱,从被动执行者转变为任务和自我的双重管理者。我们进一步设计了配置感知两阶段训练(CAT),结合拒绝采样微调和轨迹级强化学习,以内化这种元能力。在各种基准上的大量实验表明,ToolSelf可以与专门的工作流程相媲美,同时推广到新的任务,实现了24.1%的平均性能提升,并为真正自适应的Agent指明了方向。

🔬 方法详解

问题定义:现有基于LLM的Agent在执行复杂任务时,其行为配置是静态的,无法根据任务的实时进展进行调整。这种静态性导致Agent在面对变化的任务环境时,泛化能力受限,难以达到最优性能。现有的解决方案通常依赖人工干预或启发式规则,缺乏通用性和可扩展性。

核心思路:ToolSelf的核心思想是将Agent的自我配置能力赋予其自身,使其能够像使用其他工具一样,动态地调整自身的行为策略和目标。通过将配置更新抽象成一个可调用的“工具”,Agent可以将自我调整融入到正常的任务执行流程中,从而实现内在的、实时的适应性。这种设计使得Agent能够根据任务的进展和环境的变化,自主地更新其子目标、上下文信息和工具箱。

技术框架:ToolSelf的整体框架包含一个LLM Agent,该Agent拥有一个工具箱,其中包含用于执行任务的常规工具以及一个特殊的“配置更新工具”。Agent在执行任务的过程中,会根据当前的状态和目标,选择合适的工具来执行。当Agent需要调整自身配置时,它会调用“配置更新工具”,该工具会根据当前的任务状态和Agent的内部状态,生成新的配置参数。这些新的配置参数会被应用到Agent的内部状态中,从而实现Agent的自我调整。

关键创新:ToolSelf最重要的创新点在于将Agent的自我配置能力内化到Agent自身,使其能够像使用其他工具一样,动态地调整自身的行为策略和目标。这种内化的自我配置能力使得Agent能够更好地适应变化的任务环境,提高其泛化能力和鲁棒性。与现有方法相比,ToolSelf不需要人工干预或启发式规则,而是通过学习的方式,自动地发现最优的配置策略。

关键设计:ToolSelf的关键设计在于配置感知两阶段训练(CAT)。第一阶段,使用拒绝采样微调LLM,使其能够生成有效的配置更新指令。第二阶段,使用轨迹级强化学习,训练Agent学习在不同的任务状态下,选择合适的配置更新策略。损失函数的设计旨在鼓励Agent选择能够最大化任务完成率的配置更新策略。具体的参数设置和网络结构细节在论文中有详细描述,包括LLM的选择、强化学习算法的选择以及奖励函数的设计。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ToolSelf在多个基准测试中取得了显著的性能提升,平均性能提升达到24.1%。ToolSelf不仅能够与专门设计的工作流程相媲美,而且能够很好地泛化到新的任务中。这些结果证明了ToolSelf的有效性和通用性,表明其在构建自适应Agent方面具有巨大的潜力。

🎯 应用场景

ToolSelf具有广泛的应用前景,例如在机器人控制、自动化流程管理、智能客服等领域。它可以使Agent能够更好地适应变化的环境和任务需求,提高其自主性和智能化水平。未来,ToolSelf有望被应用于更复杂的任务场景,例如多Agent协作、人机协作等,从而实现更高效、更智能的自动化系统。

📄 摘要(原文)

Agentic systems powered by Large Language Models (LLMs) have demonstrated remarkable potential in tackling complex, long-horizon tasks. However, their efficacy is fundamentally constrained by static configurations governing agent behaviors, which are fixed prior to execution and fail to adapt to evolving task dynamics. Existing approaches, relying on manual orchestration or heuristic-based patches, often struggle with poor generalization and fragmented optimization. To transcend these limitations, we propose ToolSelf, a novel paradigm enabling tool-driven runtime self-reconfiguration. By abstracting configuration updates as a callable tool, ToolSelf unifies task execution and self-adjustment into a single action space, achieving a phase transition from external rules to intrinsic parameters. Agents can thereby autonomously update their sub-goals and context based on task progression, and correspondingly adapt their strategy and toolbox, transforming from passive executors into dual managers of both task and self. We further devise Configuration-Aware Two-stage Training (CAT), combining rejection sampling fine-tuning with trajectory-level reinforcement learning to internalize this meta-capability. Extensive experiments across diverse benchmarks demonstrate that ToolSelf rivals specialized workflows while generalizing to novel tasks, achieving a 24.1% average performance gain and illuminating a path toward truly self-adaptive agents.