Efficient Table Retrieval and Understanding with Multimodal Large Language Models

作者: Zhuoyan Xu, Haoyang Fang, Boran Han, Bonan Min, Bernie Wang, Cuixiong Hu, Shuai Zhang

分类: cs.AI, cs.LG

发布日期: 2026-02-07

备注: Published at EACL 2026 Findings

💡 一句话要点

提出TabRAG框架,解决多模态大语言模型在海量表格图像中检索与理解的难题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 表格检索 表格理解 多模态大语言模型 检索增强生成 视觉-文本模型

📋 核心要点

- 现有MLLM表格理解方法通常假设相关表格已存在,忽略了从海量表格中检索相关信息这一实际需求。

- TabRAG框架通过视觉-文本基础模型检索表格,再利用MLLM重排序和推理,实现海量表格图像的检索与理解。

- 实验表明,TabRAG在检索召回率和答案准确率上显著优于现有方法,为实际应用提供了有效方案。

📝 摘要(中文)

本文提出TabRAG框架,旨在解决多模态大语言模型(MLLM)在海量表格图像集合中进行检索和理解的问题。现实场景中,表格数据常以图像形式存在,例如财务报告、手写记录和文档扫描,这对机器理解提出了结构和视觉上的双重挑战。虽然MLLM在表格理解方面取得了进展,但通常假设相关表格是现成的。TabRAG框架首先利用联合训练的视觉-文本基础模型检索候选表格,然后利用MLLM对这些候选表格进行细粒度的重排序,最后利用MLLM对选定的表格进行推理以生成答案。在包含88,161个训练样本和9,819个测试样本的新构建数据集上,该数据集涵盖8个基准测试和48,504个独特表格,实验结果表明,TabRAG框架在检索召回率和答案准确率方面显著优于现有方法,分别提高了7.0%和6.1%,为实际表格理解任务提供了一种可行的解决方案。

🔬 方法详解

问题定义:论文旨在解决从大规模表格图像集合中检索并理解相关表格,以回答用户查询的问题。现有方法通常假设相关表格已经存在,忽略了实际应用中需要先从海量数据中检索相关表格的步骤。这限制了MLLM在实际场景中的应用,例如处理包含大量财务报表扫描件的文档。

核心思路:论文的核心思路是利用检索增强生成(RAG)的思想,将表格检索和表格理解两个阶段结合起来。首先,使用视觉-文本基础模型快速检索出与查询相关的候选表格;然后,利用MLLM对候选表格进行重排序,选择最相关的表格;最后,利用MLLM对选定的表格进行推理,生成最终答案。这种方法能够有效地利用MLLM的推理能力,同时解决了从海量数据中检索相关表格的问题。

技术框架:TabRAG框架包含三个主要阶段:1) 表格检索:使用联合训练的视觉-文本基础模型(例如CLIP)对表格图像和用户查询进行编码,然后计算相似度,检索出Top-K个候选表格。2) 表格重排序:使用MLLM对检索到的候选表格进行细粒度的重排序,选择与查询最相关的表格。MLLM可以利用表格的视觉信息和文本信息进行更准确的判断。3) 答案生成:使用MLLM对选定的表格进行推理,生成最终答案。MLLM可以利用表格的结构信息和内容信息进行推理,例如进行数值计算、逻辑推理等。

关键创新:TabRAG的关键创新在于将表格检索和表格理解两个阶段结合起来,形成一个完整的端到端框架。与现有方法相比,TabRAG能够处理更实际的场景,即从海量表格图像中检索并理解相关表格。此外,TabRAG利用MLLM进行表格重排序,能够更准确地选择与查询相关的表格,从而提高答案的准确率。

关键设计:在表格检索阶段,可以使用预训练的CLIP模型,并针对表格图像进行微调。在表格重排序阶段,可以使用基于Transformer的MLLM,例如BLIP-2或LLaVA。损失函数可以使用交叉熵损失或对比学习损失。在答案生成阶段,可以使用MLLM进行zero-shot或few-shot学习。具体的参数设置需要根据具体的数据集和任务进行调整。

🖼️ 关键图片

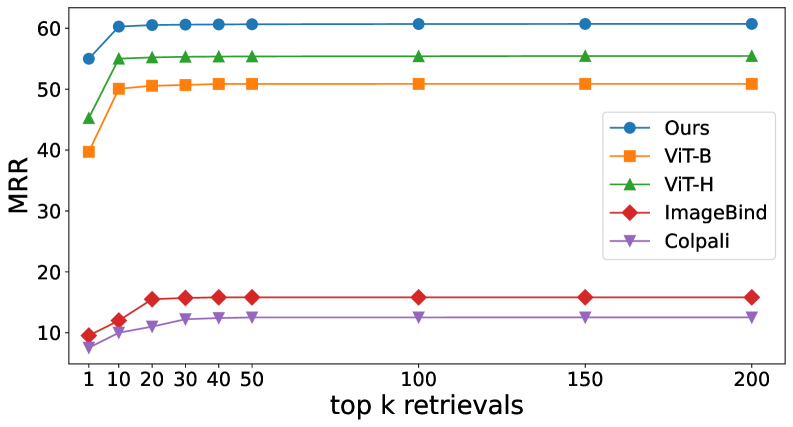

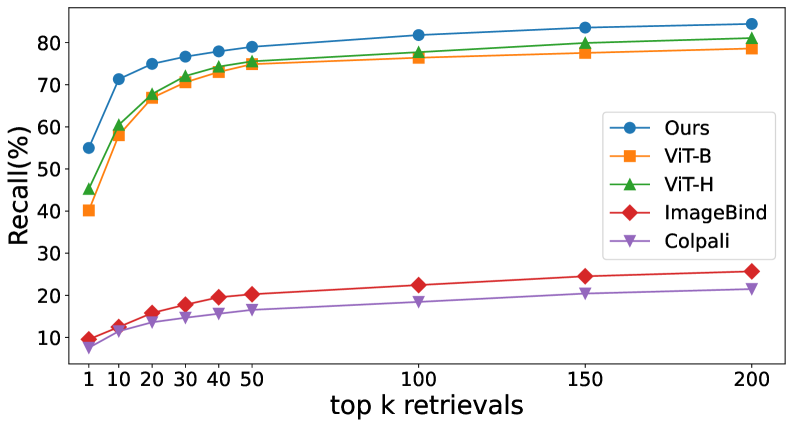

📊 实验亮点

TabRAG框架在包含48,504个独特表格的大规模数据集上进行了评估,实验结果表明,该框架在检索召回率上比现有方法提高了7.0%,在答案准确率上提高了6.1%。这些结果表明,TabRAG框架能够有效地解决海量表格图像的检索与理解问题,具有很强的实用价值。

🎯 应用场景

TabRAG框架可应用于金融、医疗、法律等领域,例如自动分析财务报表、识别病历中的表格数据、提取法律文档中的关键信息。该研究有助于提升文档处理效率,降低人工成本,并为决策提供更准确的数据支持。未来,该技术有望与知识图谱等技术结合,实现更深层次的表格理解和推理。

📄 摘要(原文)

Tabular data is frequently captured in image form across a wide range of real-world scenarios such as financial reports, handwritten records, and document scans. These visual representations pose unique challenges for machine understanding, as they combine both structural and visual complexities. While recent advances in Multimodal Large Language Models (MLLMs) show promising results in table understanding, they typically assume the relevant table is readily available. However, a more practical scenario involves identifying and reasoning over relevant tables from large-scale collections to answer user queries. To address this gap, we propose TabRAG, a framework that enables MLLMs to answer queries over large collections of table images. Our approach first retrieves candidate tables using jointly trained visual-text foundation models, then leverages MLLMs to perform fine-grained reranking of these candidates, and finally employs MLLMs to reason over the selected tables for answer generation. Through extensive experiments on a newly constructed dataset comprising 88,161 training and 9,819 testing samples across 8 benchmarks with 48,504 unique tables, we demonstrate that our framework significantly outperforms existing methods by 7.0% in retrieval recall and 6.1% in answer accuracy, offering a practical solution for real-world table understanding tasks.