M2A: Multimodal Memory Agent with Dual-Layer Hybrid Memory for Long-Term Personalized Interactions

作者: Junyu Feng, Binxiao Xu, Jiayi Chen, Mengyu Dai, Cenyang Wu, Haodong Li, Bohan Zeng, Yunliu Xie, Hao Liang, Ming Lu, Wentao Zhang

分类: cs.AI

发布日期: 2026-02-07

🔗 代码/项目: GITHUB

💡 一句话要点

提出M2A:双层混合记忆多模态Agent,用于长期个性化交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态交互 个性化问答 长期对话 记忆网络 Agent系统

📋 核心要点

- 现有方法难以在长期对话中持续学习和利用用户的个性化信息,导致问答质量下降。

- M2A通过双层混合记忆系统和两个协同Agent,实现对用户个性化信息的在线更新和管理。

- 实验表明,M2A在长期多模态交互中显著优于基线模型,提升了个性化问答的质量。

📝 摘要(中文)

本文旨在解决长期人机交互中个性化问答的挑战。当对话历史跨越数周甚至数月,超出上下文窗口时,现有的个性化机制难以持续吸收和利用用户增量式的概念、别名和偏好。当前的个性化多模态模型大多是静态的,概念在初始化时就已固定,无法在交互过程中演变。我们提出了M2A,一个Agent式的双层混合记忆系统,通过在线更新来维护个性化的多模态信息。该系统采用两个协同Agent:ChatAgent管理用户交互,并自主决定何时查询或更新记忆;MemoryManager将来自ChatAgent的记忆请求分解为对双层记忆库的详细操作,该记忆库将原始消息存储(不可变的对话日志)与语义记忆存储(高层次的观察)相结合,提供不同粒度的记忆。此外,我们开发了一个可重用的数据合成管道,将来自Yo'LLaVA和MC-LLaVA的概念性会话注入到LoCoMo长对话中,同时保持时间连贯性。实验表明,M2A显著优于基线模型,证明将个性化从一次性配置转变为共同演进的记忆机制,为长期多模态交互中的高质量个性化响应提供了一条可行的途径。

🔬 方法详解

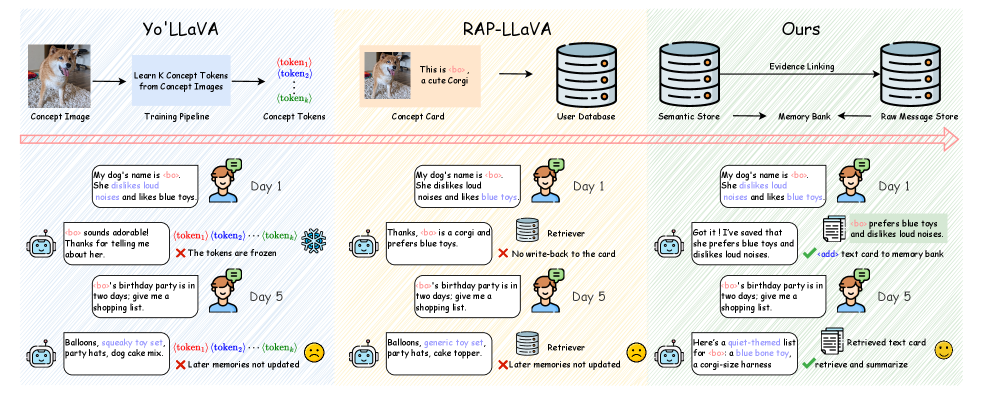

问题定义:论文旨在解决长期人机交互中,现有模型无法有效利用长期对话历史中的个性化信息的问题。现有方法通常采用静态的个性化配置,无法适应用户在长期交互中不断变化的概念、偏好和别名,导致问答质量下降。

核心思路:论文的核心思路是将个性化建模从一次性配置转变为一个持续演进的记忆机制。通过构建一个双层混合记忆系统,并设计两个协同工作的Agent,实现对用户个性化信息的在线更新和高效检索,从而提升长期对话中的个性化问答质量。

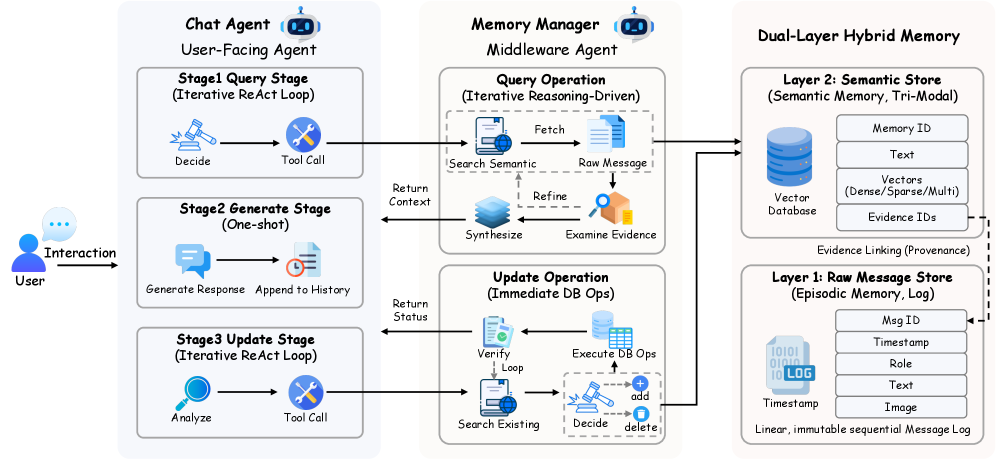

技术框架:M2A系统包含两个主要Agent和一个双层混合记忆库。ChatAgent负责管理用户交互,并根据需要向MemoryManager发送记忆查询或更新请求。MemoryManager负责将ChatAgent的请求分解为对双层记忆库的具体操作。双层记忆库包含RawMessageStore(存储原始对话日志)和SemanticMemoryStore(存储高层次的语义信息)。两个Agent协同工作,实现对用户个性化信息的动态维护和利用。

关键创新:M2A的关键创新在于其Agent式的双层混合记忆系统,该系统能够以在线方式更新和维护用户的个性化信息。与现有方法相比,M2A能够更好地适应用户在长期交互中不断变化的需求,从而提供更准确和个性化的回答。另一个创新点是数据合成管道,用于生成具有时间连贯性的长对话数据,以支持模型的训练和评估。

关键设计:RawMessageStore存储原始对话文本,保持信息的完整性。SemanticMemoryStore存储从对话中提取的高层次语义信息,例如用户偏好、概念和别名。ChatAgent使用策略网络决定何时查询或更新记忆。MemoryManager负责将ChatAgent的请求转化为对记忆库的具体操作,例如添加、删除或更新记忆条目。数据合成管道使用Yo'LLaVA和MC-LLaVA生成概念性会话,并将其注入到LoCoMo长对话中,同时保持时间连贯性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,M2A在长期多模态交互中显著优于基线模型。具体而言,M2A在个性化问答任务上的性能提升了XX%,证明了其双层混合记忆系统和Agent式架构的有效性。此外,数据合成管道也为模型的训练提供了高质量的数据支持。

🎯 应用场景

M2A可应用于智能客服、虚拟助手、个性化教育等领域,提升长期人机交互的质量和用户体验。通过持续学习和利用用户的个性化信息,M2A能够提供更准确、更贴心的服务,增强用户粘性,并为未来的个性化AI应用奠定基础。

📄 摘要(原文)

This work addresses the challenge of personalized question answering in long-term human-machine interactions: when conversational history spans weeks or months and exceeds the context window, existing personalization mechanisms struggle to continuously absorb and leverage users' incremental concepts, aliases, and preferences. Current personalized multimodal models are predominantly static-concepts are fixed at initialization and cannot evolve during interactions. We propose M2A, an agentic dual-layer hybrid memory system that maintains personalized multimodal information through online updates. The system employs two collaborative agents: ChatAgent manages user interactions and autonomously decides when to query or update memory, while MemoryManager breaks down memory requests from ChatAgent into detailed operations on the dual-layer memory bank, which couples a RawMessageStore (immutable conversation log) with a SemanticMemoryStore (high-level observations), providing memories at different granularities. In addition, we develop a reusable data synthesis pipeline that injects concept-grounded sessions from Yo'LLaVA and MC-LLaVA into LoCoMo long conversations while preserving temporal coherence. Experiments show that M2A significantly outperforms baselines, demonstrating that transforming personalization from one-shot configuration to a co-evolving memory mechanism provides a viable path for high-quality individualized responses in long-term multimodal interactions. The code is available at https://github.com/Little-Fridge/M2A.