RAPiD: Real-time Deterministic Trajectory Planning via Diffusion Behavior Priors for Safe and Efficient Autonomous Driving

作者: Ruturaj Reddy, Hrishav Bakul Barua, Junn Yong Loo, Thanh Thi Nguyen, Ganesh Krishnasamy

分类: cs.AI, cs.LG, cs.RO

发布日期: 2026-02-07

🔗 代码/项目: GITHUB

💡 一句话要点

RAPiD:基于扩散行为先验的实时确定性轨迹规划,保障自动驾驶安全高效

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 轨迹规划 扩散模型 策略蒸馏 实时性 安全性 行为先验 模仿学习

📋 核心要点

- 扩散模型轨迹规划依赖随机采样,难以满足自动驾驶实时性要求。

- RAPiD通过策略蒸馏,将预训练扩散模型转化为确定性策略,消除采样过程。

- RAPiD在nuPlan和interPlan测试中表现出色,速度提升8倍,泛化能力领先。

📝 摘要(中文)

基于扩散的轨迹规划器在建模人类驾驶行为的多模态特性方面表现出强大的能力,但它们对迭代随机采样的依赖对实时、安全关键的部署提出了严峻的挑战。本文提出了RAPiD,一个确定性的策略提取框架,它将预训练的基于扩散的规划器提炼成一个高效的策略,同时消除了扩散采样。通过使用分数正则化的策略优化,我们利用预训练的扩散规划器的分数函数作为行为先验来正则化策略学习。为了提高安全性和乘客舒适度,该策略使用一个模仿预测驾驶员控制器的critic进行优化,从而提供超越传统模仿学习的密集、以安全为中心的监督。评估表明,RAPiD在闭环nuPlan场景中实现了具有竞争力的性能,并且比扩散基线快8倍,同时在interPlan基准测试中实现了学习型规划器中最先进的泛化能力。该工作的官方网站是:https://github.com/ruturajreddy/RAPiD。

🔬 方法详解

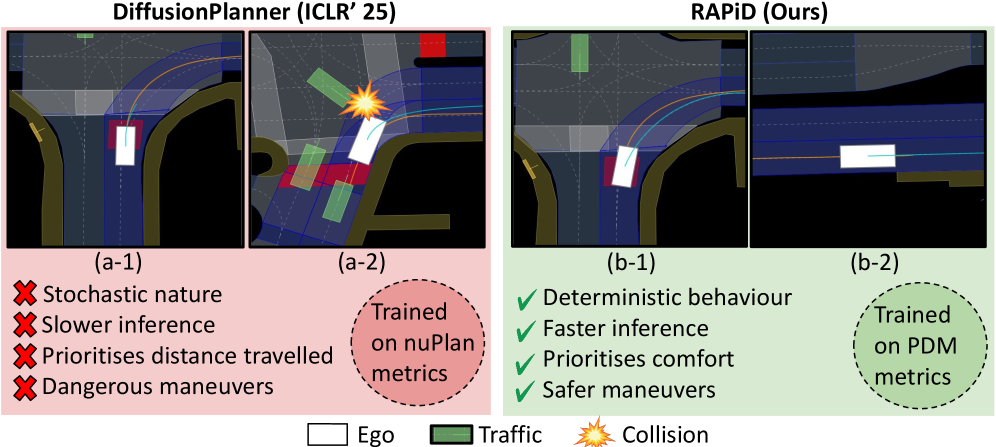

问题定义:现有基于扩散模型的轨迹规划方法虽然能有效模拟人类驾驶行为的多模态特性,但其依赖于迭代的随机采样过程,导致计算成本高昂,难以满足自动驾驶系统对实时性的严格要求,阻碍了其在安全关键场景中的实际部署。

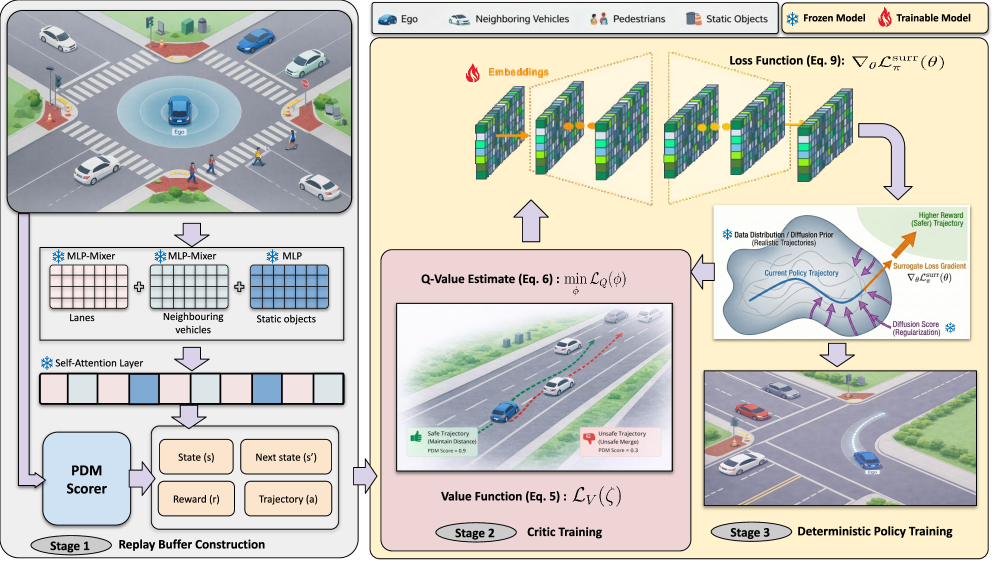

核心思路:RAPiD的核心思路是将预训练的扩散模型“提炼”成一个确定性的策略网络。通过学习一个策略,直接预测轨迹,避免了耗时的迭代采样过程。同时,利用扩散模型提供的行为先验知识来指导策略学习,从而保证生成轨迹的合理性和安全性。

技术框架:RAPiD框架主要包含两个阶段:预训练扩散模型和策略蒸馏。首先,使用大量驾驶数据训练一个基于扩散模型的轨迹规划器。然后,利用该扩散模型的分数函数作为行为先验,通过分数正则化的策略优化方法,训练一个确定性的策略网络。此外,还引入了一个模仿预测驾驶员控制器的critic网络,为策略学习提供更密集、更关注安全的监督信号。

关键创新:RAPiD的关键创新在于提出了一种基于分数正则化的策略优化方法,将扩散模型的分数函数作为行为先验来指导策略学习。这种方法有效地利用了扩散模型学习到的驾驶行为知识,同时避免了直接采样,从而实现了实时性和安全性的平衡。此外,使用模仿学习训练的critic网络,提供了更丰富的安全监督信号,进一步提升了轨迹的安全性。

关键设计:RAPiD使用Transformer网络作为策略网络和critic网络的基础架构。策略网络的输入包括当前车辆状态、目标点以及周围环境信息,输出为预测的轨迹。损失函数包括模仿学习损失、分数正则化损失以及critic网络的输出。分数正则化损失用于约束策略网络的输出与扩散模型的分数函数一致,从而保证生成轨迹的合理性。Critic网络通过模仿预测驾驶员控制器的行为进行训练,用于评估轨迹的安全性。

🖼️ 关键图片

📊 实验亮点

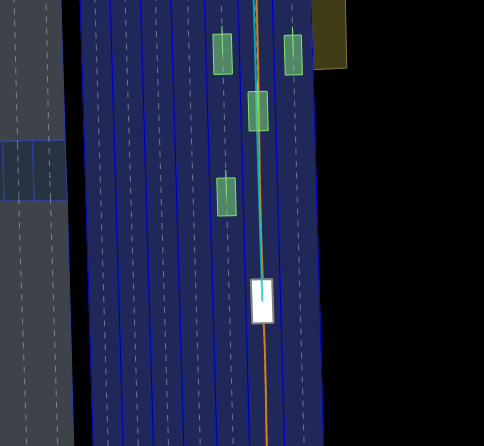

RAPiD在nuPlan闭环场景中实现了与扩散模型相当的性能,但速度提升了8倍。在interPlan基准测试中,RAPiD在学习型规划器中取得了最先进的泛化性能,表明其具有很强的场景适应能力。这些结果表明,RAPiD是一种高效、安全且具有良好泛化能力的轨迹规划方法。

🎯 应用场景

RAPiD适用于各种自动驾驶应用场景,包括城市道路、高速公路和越野环境。其高效的实时性能使其能够满足自动驾驶系统对轨迹规划的严格要求,提高自动驾驶车辆的安全性、舒适性和效率。该方法还可扩展到其他机器人领域,例如无人机和移动机器人。

📄 摘要(原文)

Diffusion-based trajectory planners have demonstrated strong capability for modeling the multimodal nature of human driving behavior, but their reliance on iterative stochastic sampling poses critical challenges for real-time, safety-critical deployment. In this work, we present RAPiD, a deterministic policy extraction framework that distills a pretrained diffusion-based planner into an efficient policy while eliminating diffusion sampling. Using score-regularized policy optimization, we leverage the score function of a pre-trained diffusion planner as a behavior prior to regularize policy learning. To promote safety and passenger comfort, the policy is optimized using a critic trained to imitate a predictive driver controller, providing dense, safety-focused supervision beyond conventional imitation learning. Evaluations demonstrate that RAPiD achieves competitive performance on closed-loop nuPlan scenarios with an 8x speedup over diffusion baselines, while achieving state-of-the-art generalization among learning-based planners on the interPlan benchmark. The official website of this work is: https://github.com/ruturajreddy/RAPiD.