Semantic Search At LinkedIn

作者: Fedor Borisyuk, Sriram Vasudevan, Muchen Wu, Guoyao Li, Benjamin Le, Shaobo Zhang, Qianqi Kay Shen, Yuchin Juan, Kayhan Behdin, Liming Dong, Kaixu Yang, Shusen Jing, Ravi Pothamsetty, Rajat Arora, Sophie Yanying Sheng, Vitaly Abdrashitov, Yang Zhao, Lin Su, Xiaoqing Wang, Chujie Zheng, Sarang Metkar, Rupesh Gupta, Igor Lapchuk, David N. Racca, Madhumitha Mohan, Yanbo Li, Haojun Li, Saloni Gandhi, Xueying Lu, Chetan Bhole, Ali Hooshmand, Xin Yang, Raghavan Muthuregunathan, Jiajun Zhang, Mathew Teoh, Adam Coler, Abhinav Gupta, Xiaojing Ma, Sundara Raman Ramachandran, Morteza Ramezani, Yubo Wang, Lijuan Zhang, Richard Li, Jian Sheng, Chanh Nguyen, Yen-Chi Chen, Chuanrui Zhu, Claire Zhang, Jiahao Xu, Deepti Kulkarni, Qing Lan, Arvind Subramaniam, Ata Fatahibaarzi, Steven Shimizu, Yanning Chen, Zhipeng Wang, Ran He, Zhengze Zhou, Qingquan Song, Yun Dai, Caleb Johnson, Ping Liu, Shaghayegh Gharghabi, Gokulraj Mohanasundaram, Juan Bottaro, Santhosh Sachindran, Qi Guo, Yunxiang Ren, Chengming Jiang, Di Mo, Luke Simon, Jianqiang Shen, Jingwei Wu, Wenjing Zhang

分类: cs.IR, cs.AI, cs.LG

发布日期: 2026-02-07

💡 一句话要点

LinkedIn提出基于LLM的语义搜索框架,显著提升AI职位和人才搜索效率。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义搜索 大型语言模型 模型蒸馏 信息检索 职位搜索 人才搜索 推理优化 用户参与度

📋 核心要点

- 传统关键词搜索在理解用户意图方面存在局限,难以满足复杂语义搜索需求。

- 该框架利用LLM理解语义,结合嵌入检索和小模型蒸馏,优化相关性和用户参与度。

- 实验表明,该框架在保证质量的同时,显著提升了搜索效率,并改善了用户体验。

📝 摘要(中文)

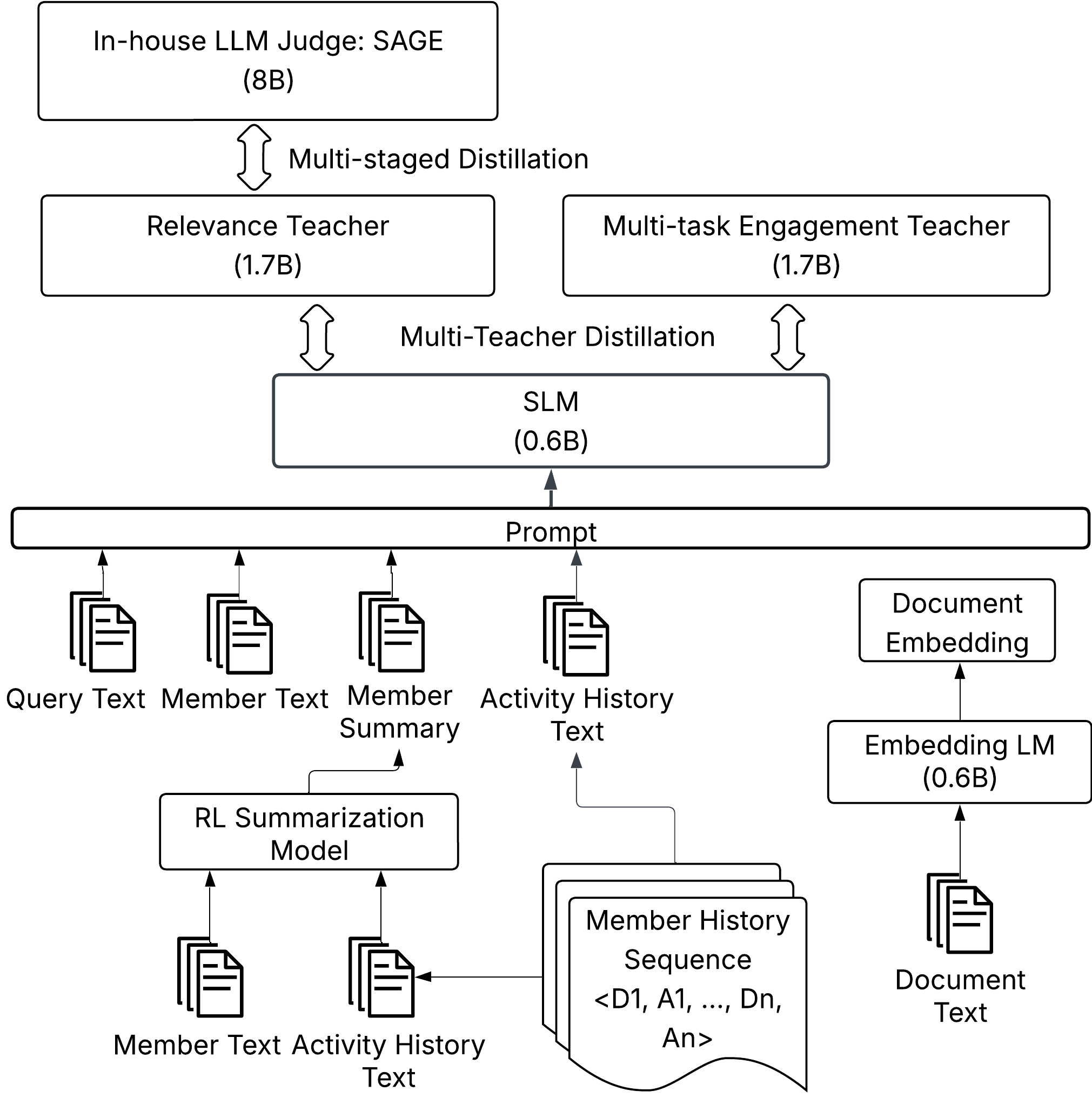

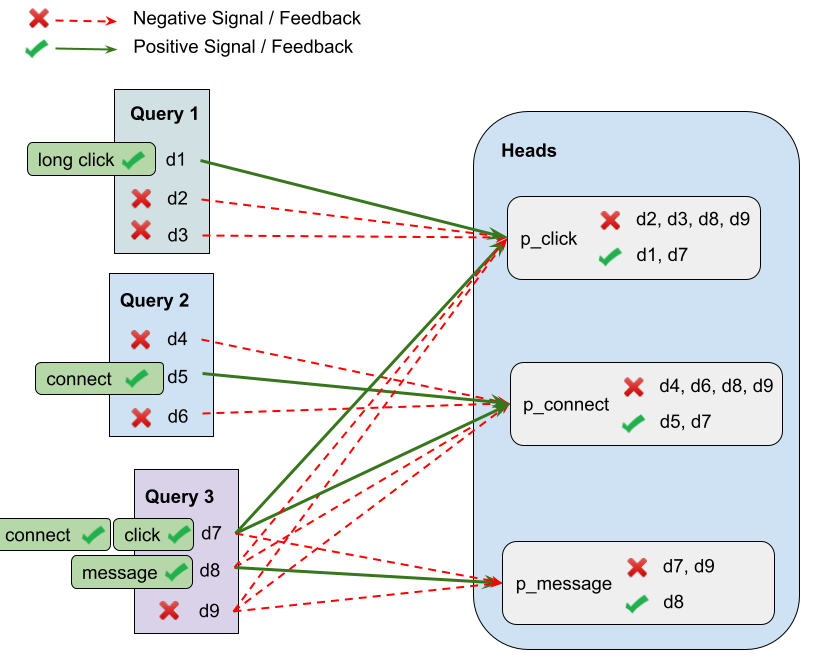

本文介绍了LinkedIn用于AI职位搜索和AI人才搜索的基于大型语言模型(LLM)的语义搜索框架。该框架结合了LLM相关性判断器、基于嵌入的检索以及通过多教师蒸馏训练的紧凑型小语言模型,以联合优化相关性和用户参与度。一种面向预填充的推理架构,与模型剪枝、上下文压缩和文本嵌入混合交互协同设计,在固定延迟约束下将排名吞吐量提高了75倍以上,同时保持了接近教师水平的NDCG。这使得该系统成为首批生产级基于LLM的排名系统之一,其效率可与传统方法相媲美,并在质量和用户参与度方面实现了显著提升。

🔬 方法详解

问题定义:LinkedIn需要解决的是如何利用大型语言模型(LLM)的语义理解能力,提升职位搜索和人才搜索的相关性和用户体验。传统基于关键词的搜索方法无法准确捕捉用户意图,导致搜索结果不尽如人意。此外,直接使用大型LLM进行搜索排序,计算成本过高,难以在生产环境中应用。

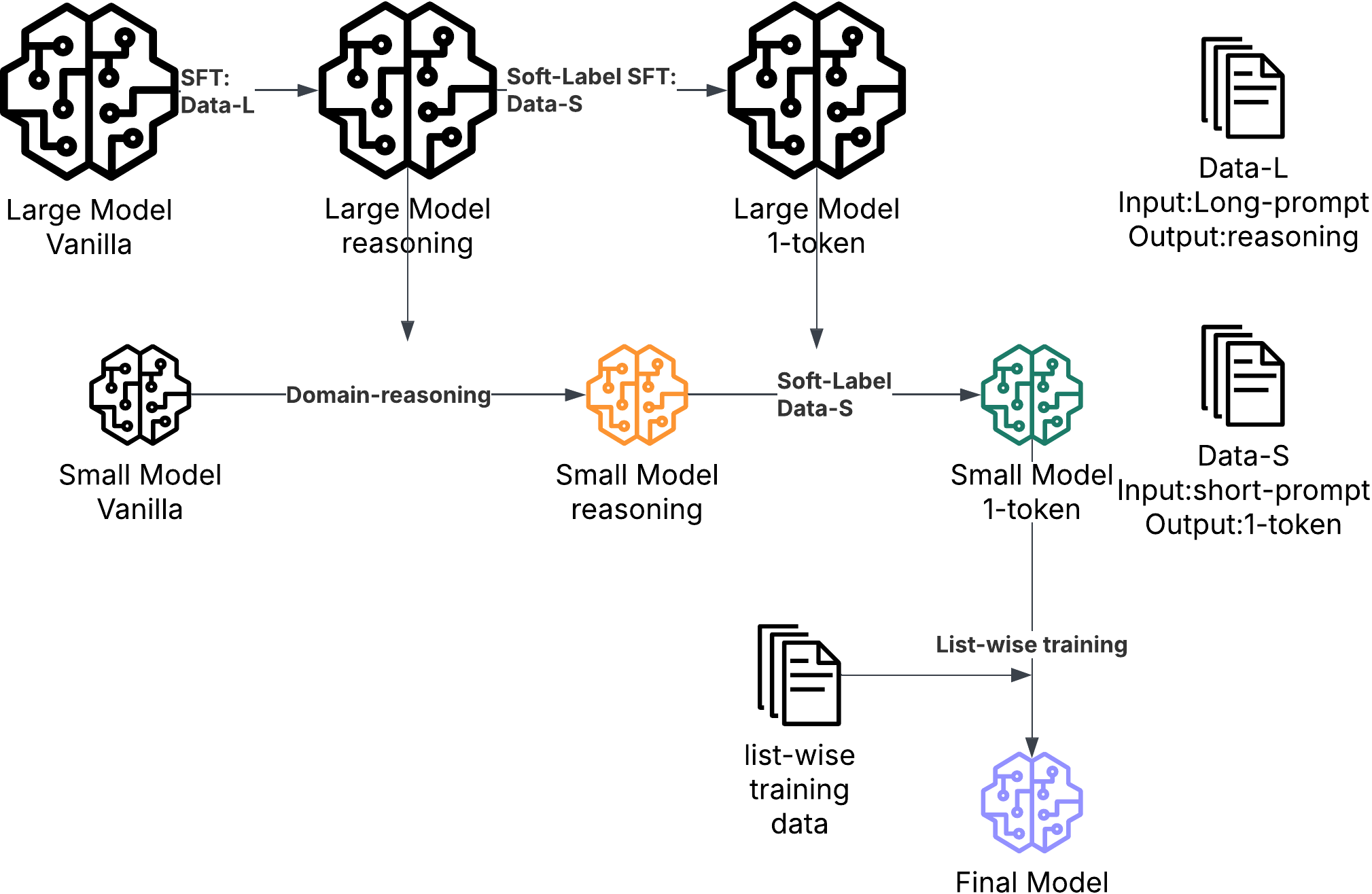

核心思路:该论文的核心思路是结合LLM的语义理解能力、嵌入检索的效率以及小模型的推理速度,构建一个高效且准确的语义搜索框架。通过多教师蒸馏,将大型LLM的知识迁移到小型模型,使其在保证性能的同时,降低计算成本。同时,采用预填充推理架构、模型剪枝和上下文压缩等技术,进一步提升推理效率。

技术框架:该语义搜索框架包含以下几个主要模块:1) LLM相关性判断器:用于评估搜索结果与用户查询的相关性。2) 嵌入式检索:利用预先计算好的职位和人才嵌入向量,快速检索候选结果。3) 小型语言模型(SLM):通过多教师蒸馏训练,用于对候选结果进行排序。4) 预填充推理架构:优化推理过程,提升吞吐量。5) 上下文压缩:减少输入序列长度,降低计算复杂度。6) 文本嵌入混合交互:融合文本信息和嵌入信息,提升排序效果。

关键创新:该论文的关键创新在于:1) 提出了一种基于多教师蒸馏的小型语言模型训练方法,能够在保证性能的同时,显著降低计算成本。2) 设计了一种面向预填充的推理架构,结合模型剪枝和上下文压缩等技术,大幅提升了推理效率。3) 将LLM应用于生产环境中的搜索排序,并实现了与传统方法相当的效率,具有重要的实际意义。

关键设计:在模型训练方面,采用了多教师蒸馏策略,利用多个大型LLM作为教师模型,指导小型模型的训练。在推理方面,采用了预填充推理架构,通过预先计算部分计算结果,减少了在线计算量。此外,还采用了模型剪枝和上下文压缩等技术,进一步提升推理效率。损失函数的设计也至关重要,需要综合考虑相关性、用户参与度等多个因素。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该框架在固定延迟约束下,排名吞吐量提高了75倍以上,同时保持了接近教师水平的NDCG。与传统方法相比,该框架在质量和用户参与度方面实现了显著提升,证明了其在生产环境中的可行性和有效性。

🎯 应用场景

该研究成果可广泛应用于各种需要语义搜索的场景,例如招聘平台、电商网站、知识库等。通过提升搜索结果的相关性和用户体验,可以有效提高用户满意度和平台转化率。未来,该技术还可以扩展到其他领域,例如智能客服、信息推荐等。

📄 摘要(原文)

Semantic search with large language models (LLMs) enables retrieval by meaning rather than keyword overlap, but scaling it requires major inference efficiency advances. We present LinkedIn's LLM-based semantic search framework for AI Job Search and AI People Search, combining an LLM relevance judge, embedding-based retrieval, and a compact Small Language Model trained via multi-teacher distillation to jointly optimize relevance and engagement. A prefill-oriented inference architecture co-designed with model pruning, context compression, and text-embedding hybrid interactions boosts ranking throughput by over 75x under a fixed latency constraint while preserving near-teacher-level NDCG, enabling one of the first production LLM-based ranking systems with efficiency comparable to traditional approaches and delivering significant gains in quality and user engagement.