SAS-Net: Scene-Appearance Separation Network for Robust Spatiotemporal Registration in Bidirectional Photoacoustic Microscopy

作者: Jiahao Qin

分类: eess.IV, cs.AI, cs.CV

发布日期: 2026-02-06

备注: 21 pages, 6 figures, 3 tables

🔗 代码/项目: GITHUB

💡 一句话要点

提出SAS-Net,解决双向光声显微镜中时空配准的域偏移和几何失真问题。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 光声显微镜 图像配准 域偏移 几何畸变 场景分离 深度学习 活体成像

📋 核心要点

- 双向扫描光声显微镜存在严重的时空错位问题,传统方法依赖亮度恒定性假设,在双向扫描下失效。

- 提出场景-外观分离网络(SAS-Net),将域不变的场景内容与域特定的外观特征分离,实现跨域重建和几何保持。

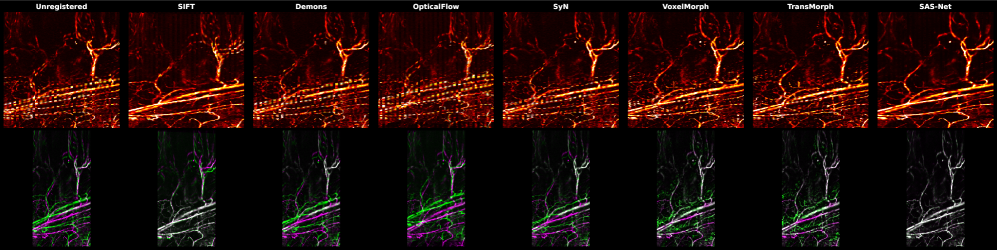

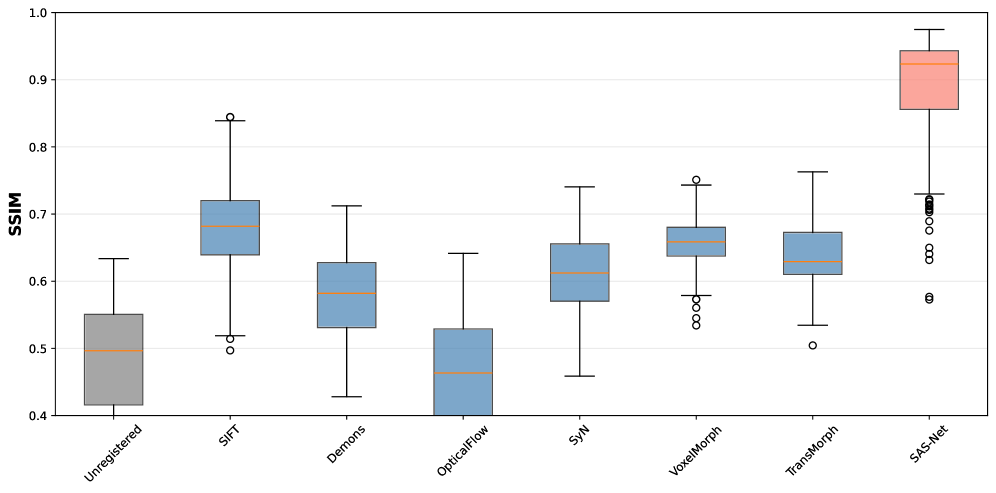

- 实验结果表明,该方法在活体小鼠脑血管成像中显著优于传统方法,NCC达到0.961,SSIM达到0.894。

📝 摘要(中文)

本文提出了一种场景-外观分离网络(SAS-Net),用于解决双向扫描光声显微镜(OR-PAM)中由扫描方向相关的域偏移和几何畸变引起的时空错位问题。传统配准方法依赖于亮度恒定性假设,这在双向扫描下不成立,导致配准不可靠。该框架将域不变的场景内容与域特定的外观特征分离,从而实现几何保持的跨域重建。场景一致性损失促进了潜在空间中的几何对应关系,将域偏移校正与空间配准联系在一个统一的框架中。在活体小鼠脑血管成像中,该方法实现了0.961的归一化互相关(NCC)和0.894的结构相似性指数(SSIM),显著优于传统方法。消融研究表明,域对齐损失至关重要,移除后NCC降低82%(从0.961降至0.175),而场景一致性和循环一致性损失为实现最佳性能提供了互补的正则化。该方法实现了每帧11.2毫秒的推理时间(86 fps),大大超过了典型的OR-PAM采集速率,并支持实时处理。结果表明,该框架能够实现稳健的高速双向OR-PAM,从而实现可靠的定量和纵向功能成像。代码将在https://github.com/D-ST-Sword/SAS-Net 公开。

🔬 方法详解

问题定义:双向光声显微镜由于双向扫描引入了扫描方向相关的域偏移和几何畸变,导致图像之间存在严重的时空错位。传统的图像配准方法通常依赖于亮度恒定性假设,即假设同一场景在不同图像中的亮度保持不变。然而,在双向扫描光声显微镜中,由于扫描方向的不同,图像的亮度分布会发生显著变化,使得亮度恒定性假设不再成立,导致传统配准方法失效。

核心思路:本文的核心思路是将图像中的场景内容和外观特征进行分离。场景内容是指图像中与扫描方向无关的、描述图像结构的本质信息,例如血管的形状和位置。外观特征是指图像中与扫描方向相关的、描述图像亮度和纹理的表观信息。通过将场景内容和外观特征分离,可以消除扫描方向带来的影响,从而实现更准确的图像配准。具体来说,该方法学习一个域不变的场景表示,使得来自不同扫描方向的图像在场景表示空间中具有相似的结构。

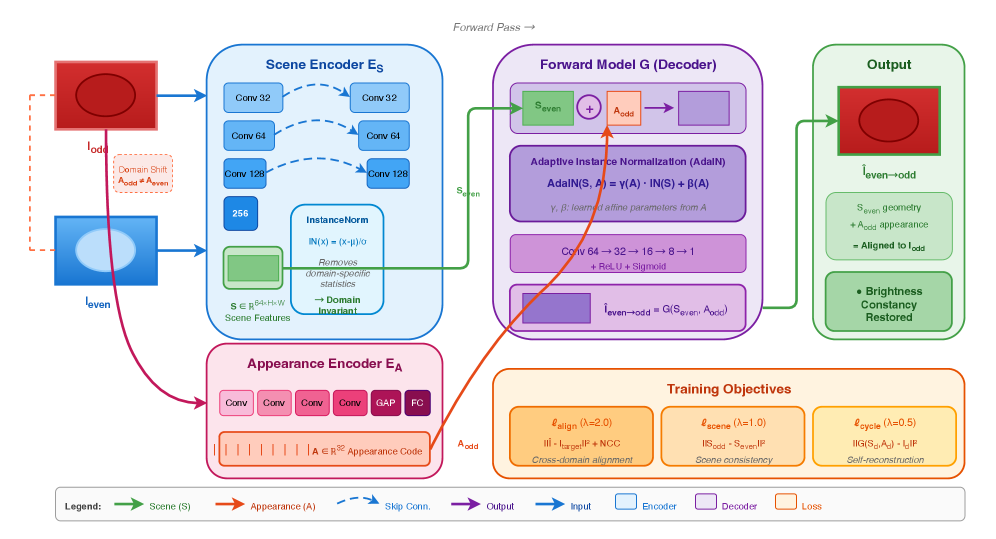

技术框架:SAS-Net的整体架构是一个编码器-解码器结构。编码器将输入图像分解为场景内容和外观特征两部分。解码器则根据场景内容和目标域的外观特征重建图像。该网络包含两个分支:一个分支用于提取场景内容,另一个分支用于提取外观特征。为了保证场景内容具有域不变性,该网络采用了对抗训练的方法,使得场景内容无法被区分来自哪个扫描方向。为了保证重建图像的质量,该网络采用了循环一致性损失,即先将图像从源域重建到目标域,然后再从目标域重建回源域,并要求重建后的图像与原始图像尽可能相似。

关键创新:该方法最重要的技术创新点在于将场景内容和外观特征进行分离,并学习一个域不变的场景表示。与传统的图像配准方法相比,该方法不需要依赖亮度恒定性假设,因此可以更好地处理双向扫描光声显微镜中的域偏移问题。此外,该方法还采用了对抗训练和循环一致性损失,进一步提高了图像配准的准确性和鲁棒性。

关键设计:在网络结构方面,编码器和解码器都采用了卷积神经网络。为了提取更丰富的特征,该网络采用了多层卷积和池化操作。在损失函数方面,该网络采用了域对齐损失、场景一致性损失和循环一致性损失。域对齐损失用于保证场景内容具有域不变性。场景一致性损失用于促进潜在空间中的几何对应关系。循环一致性损失用于保证重建图像的质量。在训练过程中,该网络采用了Adam优化器,学习率为0.0001。

🖼️ 关键图片

📊 实验亮点

该方法在活体小鼠脑血管成像中取得了显著的性能提升,归一化互相关(NCC)达到0.961,结构相似性指数(SSIM)达到0.894,显著优于传统方法。消融研究表明,域对齐损失至关重要,移除后NCC降低82%(从0.961降至0.175)。此外,该方法实现了每帧11.2毫秒的推理时间(86 fps),满足实时处理的需求。

🎯 应用场景

该研究成果可应用于高速双向光声显微镜,实现对活体组织,特别是脑部血管的实时、高精度成像。这对于神经科学研究、药物研发以及疾病诊断具有重要意义,能够提供更可靠的定量和纵向功能成像数据,从而深入了解大脑功能和疾病机制。

📄 摘要(原文)

High-speed optical-resolution photoacoustic microscopy (OR-PAM) with bidirectional scanning enables rapid functional brain imaging but introduces severe spatiotemporal misalignment from coupled scan-direction-dependent domain shift and geometric distortion. Conventional registration methods rely on brightness constancy, an assumption violated under bidirectional scanning, leading to unreliable alignment. A unified scene-appearance separation framework is proposed to jointly address domain shift and spatial misalignment. The proposed architecture separates domain-invariant scene content from domain-specific appearance characteristics, enabling cross-domain reconstruction with geometric preservation. A scene consistency loss promotes geometric correspondence in the latent space, linking domain shift correction with spatial registration within a single framework. For in vivo mouse brain vasculature imaging, the proposed method achieves normalized cross-correlation (NCC) of 0.961 and structural similarity index (SSIM) of 0.894, substantially outperforming conventional methods. Ablation studies demonstrate that domain alignment loss is critical, with its removal causing 82% NCC reduction (0.961 to 0.175), while scene consistency and cycle consistency losses provide complementary regularization for optimal performance. The method achieves 11.2 ms inference time per frame (86 fps), substantially exceeding typical OR-PAM acquisition rates and enabling real-time processing. These results suggest that the proposed framework enables robust high-speed bidirectional OR-PAM for reliable quantitative and longitudinal functional imaging. The code will be publicly available at https://github.com/D-ST-Sword/SAS-Net