PreFlect: From Retrospective to Prospective Reflection in Large Language Model Agents

作者: Hanyu Wang, Yuanpu Cao, Lu Lin, Jinghui Chen

分类: cs.AI

发布日期: 2026-02-06

🔗 代码/项目: GITHUB

💡 一句话要点

PreFlect:大型语言模型Agent中从回顾性反思到前瞻性反思的转变

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型Agent 前瞻性反思 自我反思 动态重规划 规划错误 Agent规划 智能Agent

📋 核心要点

- 现有Agent依赖回顾性反思,即在失败后才纠正,效率较低且可能错失最佳行动时机。

- PreFlect提出前瞻性反思,在执行前预测并优化Agent计划,从而避免潜在错误。

- 实验表明,PreFlect在复杂任务中显著提升Agent性能,超越了现有反思方法和复杂架构。

📝 摘要(中文)

先进的大型语言模型Agent通常采用自我反思来提高性能,Agent迭代地分析过去的行动以纠正错误。然而,现有的反思方法本质上是回顾性的:Agent行动,观察到失败,然后才尝试恢复。在这项工作中,我们引入了PreFlect,一种前瞻性反思机制,它通过在执行前批评和改进Agent计划,将范式从事后纠正转变为执行前预测。为了支持有根据的前瞻性反思,我们从历史Agent轨迹中提取规划错误,捕捉在过去执行中观察到的重复出现的成功和失败模式。此外,我们用动态重规划机制来补充前瞻性反思,该机制在原始计划遇到意外偏差时提供执行时计划更新。在不同基准上的评估表明,PreFlect显著提高了复杂现实世界任务中Agent的整体效用,优于强大的基于反思的基线和几种更复杂的Agent架构。

🔬 方法详解

问题定义:现有的大型语言模型Agent主要采用回顾性反思机制,即在执行动作并观察到失败后才进行反思和纠正。这种方法的痛点在于,它是一种事后补救,无法在行动前避免错误,导致效率低下,并且可能错失最佳行动机会。此外,回顾性反思依赖于对过去经验的分析,难以泛化到新的、未知的场景。

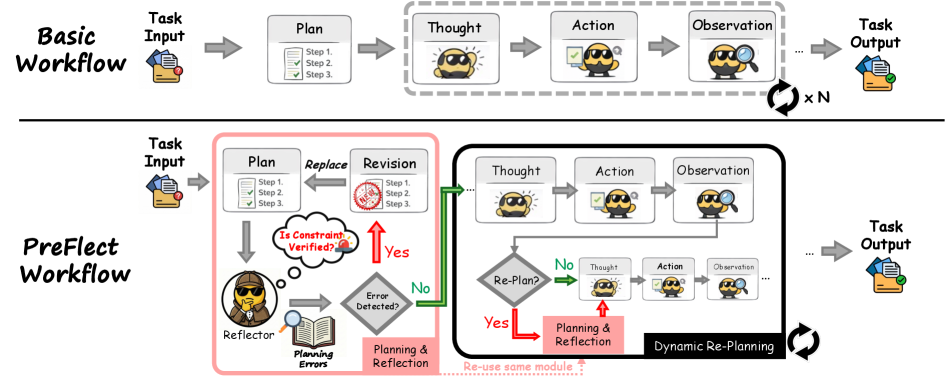

核心思路:PreFlect的核心思路是将反思机制从回顾性转变为前瞻性。具体来说,PreFlect在Agent执行计划之前,对其进行评估和改进,从而在行动前预测并避免潜在的错误。这种前瞻性反思能够提高Agent的效率和准确性,使其更好地适应复杂和动态的环境。

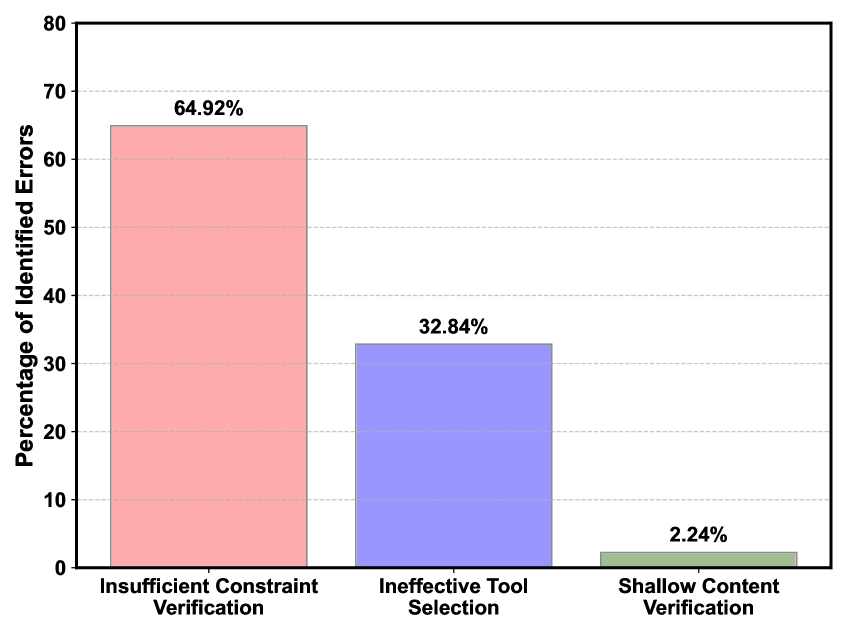

技术框架:PreFlect包含两个主要模块:前瞻性反思模块和动态重规划模块。前瞻性反思模块首先从历史Agent轨迹中提取规划错误,构建一个错误模式库。然后,在Agent生成新的计划后,该模块会利用错误模式库对计划进行评估,并提出改进建议。动态重规划模块则在Agent执行计划的过程中,监控环境变化。如果环境发生意外变化,导致原始计划不再适用,该模块会触发重规划,生成新的计划。

关键创新:PreFlect最重要的技术创新点在于其前瞻性反思机制。与现有的回顾性反思方法不同,PreFlect能够在Agent执行计划之前,预测并避免潜在的错误。这种前瞻性反思能够显著提高Agent的效率和准确性。此外,PreFlect还引入了动态重规划机制,使其能够更好地适应动态环境。

关键设计:PreFlect的关键设计包括:1) 错误模式库的构建,需要有效提取和表示历史Agent轨迹中的规划错误;2) 前瞻性反思模块的评估和改进策略,需要准确预测计划的潜在问题,并提出可行的改进建议;3) 动态重规划模块的触发条件和重规划策略,需要在环境变化时及时触发重规划,并生成新的、适应环境的计划。具体的参数设置、损失函数、网络结构等技术细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,PreFlect在多个基准测试中显著优于现有的反思方法和更复杂的Agent架构。具体的性能数据和提升幅度在论文中给出,证明了PreFlect的有效性和优越性。PreFlect能够显著提高Agent在复杂现实世界任务中的整体效用。

🎯 应用场景

PreFlect具有广泛的应用前景,可应用于机器人导航、自动驾驶、智能客服、游戏AI等领域。通过在行动前预测和避免错误,PreFlect能够提高Agent在复杂环境中的效率和可靠性,使其更好地完成各种任务。未来,PreFlect有望成为构建更智能、更可靠的Agent系统的关键技术。

📄 摘要(原文)

Advanced large language model agents typically adopt self-reflection for improving performance, where agents iteratively analyze past actions to correct errors. However, existing reflective approaches are inherently retrospective: agents act, observe failure, and only then attempt to recover. In this work, we introduce PreFlect, a prospective reflection mechanism that shifts the paradigm from post hoc correction to pre-execution foresight by criticizing and refining agent plans before execution. To support grounded prospective reflection, we distill planning errors from historical agent trajectories, capturing recurring success and failure patterns observed across past executions. Furthermore, we complement prospective reflection with a dynamic re-planning mechanism that provides execution-time plan update in case the original plan encounters unexpected deviation. Evaluations on different benchmarks demonstrate that PreFlect significantly improves overall agent utility on complex real-world tasks, outperforming strong reflection-based baselines and several more complex agent architectures. Code will be updated at https://github.com/wwwhy725/PreFlect.