Reasoning-Augmented Representations for Multimodal Retrieval

作者: Jianrui Zhang, Anirudh Sundara Rajan, Brandon Han, Soochahn Lee, Sukanta Ganguly, Yong Jae Lee

分类: cs.IR, cs.AI, cs.CV, cs.LG

发布日期: 2026-02-06

🔗 代码/项目: GITHUB

💡 一句话要点

提出推理增强表示框架,提升通用多模态检索中隐式推理能力

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态检索 推理增强 视觉-语言模型 语义表示 数据增强

📋 核心要点

- 现有通用多模态检索模型在处理需要隐式推理的复杂查询时表现不足,容易产生虚假匹配。

- 该论文提出推理增强表示框架,通过外部化推理过程,显式化图像和查询中的隐式语义信息。

- 实验表明,该方法在M-BEIR数据集上取得了显著提升,尤其在知识密集型和组合修改查询中。

📝 摘要(中文)

通用多模态检索(UMR)旨在实现跨文本和视觉的任意到任意搜索。然而,当查询需要潜在推理(例如,解决未明确的引用或匹配组合约束)时,现有的嵌入模型仍然表现脆弱。我们认为这种脆弱性通常是由数据引起的:当图像携带“沉默”的证据,而查询留下关键的语义隐式时,单个嵌入过程必须同时进行推理和压缩,从而导致虚假特征匹配。我们提出了一个以数据为中心的框架,通过在检索之前外部化推理来解耦这些角色。使用强大的视觉-语言模型,我们通过密集地描述语料库条目中的视觉证据、解决查询中模糊的多模态引用,以及将冗长的指令重写为简洁的检索约束,使隐式语义显式化。仅推理时增强是不够的;检索器必须在这些语义密集的表示上进行训练,以避免分布偏移并充分利用添加的信号。在M-BEIR上,我们的推理增强训练方法相对于强大的基线产生了持续的收益,消融实验表明,语料库增强主要有利于知识密集型查询,而查询增强对于组合修改请求至关重要。我们公开发布了我们的代码。

🔬 方法详解

问题定义:通用多模态检索(UMR)旨在实现跨文本和视觉的任意到任意搜索。现有方法,特别是基于嵌入的模型,在处理需要复杂推理的查询时表现不佳。例如,图像中包含未明确说明的信息,或者查询中存在模糊的引用或组合约束,都会导致模型难以准确匹配,产生虚假特征匹配。现有方法缺乏对隐式信息的有效建模和利用,导致检索性能下降。

核心思路:该论文的核心思路是将推理过程从嵌入过程中解耦出来,通过预先进行推理来显式化隐式语义信息。具体来说,利用视觉-语言模型对图像和查询进行增强,使其包含更丰富的语义信息,从而减轻检索器在嵌入过程中同时进行推理和压缩的负担。这种解耦的设计可以避免分布偏移,并使检索器能够更好地利用增强后的语义信息。

技术框架:该框架包含两个主要阶段:推理增强阶段和检索阶段。在推理增强阶段,首先使用视觉-语言模型对语料库中的图像进行密集描述,生成包含丰富语义信息的文本描述。然后,对查询进行增强,解决其中的模糊引用,并将冗长的指令重写为简洁的检索约束。在检索阶段,使用增强后的语料库和查询训练检索器,使其能够更好地利用显式化的语义信息进行检索。

关键创新:该论文的关键创新在于提出了一个以数据为中心的推理增强框架,通过外部化推理过程来显式化隐式语义信息。与以往的研究不同,该方法不仅在推理时进行增强,还在训练时利用增强后的数据,从而避免了分布偏移,并使检索器能够充分利用添加的信号。此外,该方法还针对不同类型的查询(知识密集型和组合修改)采用了不同的增强策略,进一步提升了检索性能。

关键设计:在推理增强阶段,使用了强大的视觉-语言模型(具体模型未明确说明,但强调了其能力)。对图像进行密集描述时,采用了多种策略来确保描述的准确性和完整性。在查询增强方面,采用了引用消解和指令重写等技术,将复杂的查询转化为简洁的检索约束。在训练检索器时,使用了增强后的语料库和查询,并采用了合适的损失函数来优化检索器的性能。具体的参数设置和网络结构未详细说明。

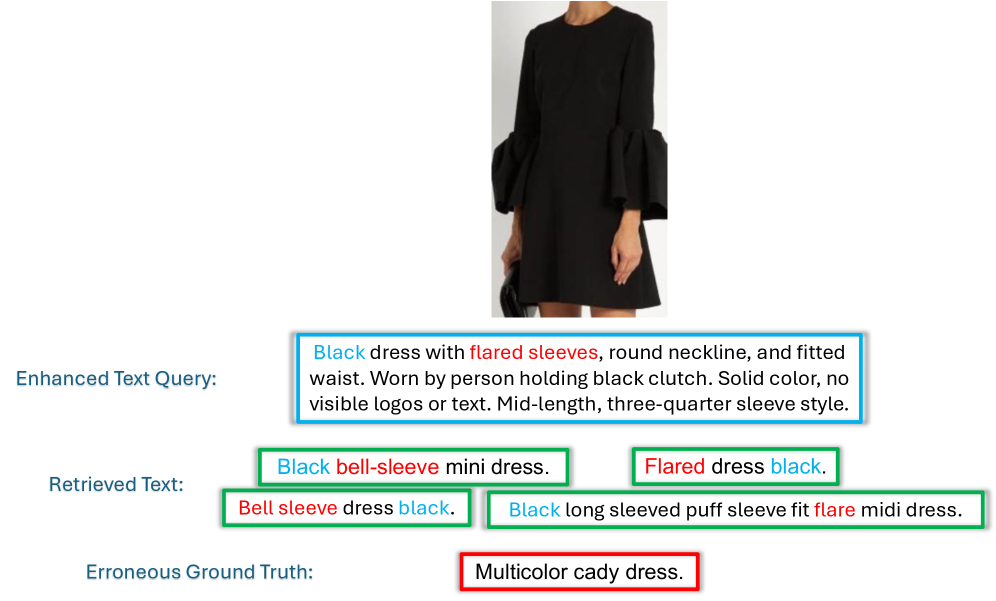

🖼️ 关键图片

📊 实验亮点

在M-BEIR数据集上的实验结果表明,该方法相对于强大的基线模型取得了显著的性能提升。消融实验表明,语料库增强主要有利于知识密集型查询,而查询增强对于组合修改请求至关重要。具体性能数据和提升幅度未在摘要中明确给出,但强调了该方法的一致性和有效性。

🎯 应用场景

该研究成果可应用于智能搜索引擎、多模态信息检索、图像理解、自然语言处理等领域。例如,可以用于构建更智能的图像搜索引擎,能够理解用户复杂的查询意图,并返回更相关的图像结果。此外,还可以应用于机器人导航、智能客服等领域,提升系统的理解和推理能力。

📄 摘要(原文)

Universal Multimodal Retrieval (UMR) seeks any-to-any search across text and vision, yet modern embedding models remain brittle when queries require latent reasoning (e.g., resolving underspecified references or matching compositional constraints). We argue this brittleness is often data-induced: when images carry "silent" evidence and queries leave key semantics implicit, a single embedding pass must both reason and compress, encouraging spurious feature matching. We propose a data-centric framework that decouples these roles by externalizing reasoning before retrieval. Using a strong Vision--Language Model, we make implicit semantics explicit by densely captioning visual evidence in corpus entries, resolving ambiguous multimodal references in queries, and rewriting verbose instructions into concise retrieval constraints. Inference-time enhancement alone is insufficient; the retriever must be trained on these semantically dense representations to avoid distribution shift and fully exploit the added signal. Across M-BEIR, our reasoning-augmented training method yields consistent gains over strong baselines, with ablations showing that corpus enhancement chiefly benefits knowledge-intensive queries while query enhancement is critical for compositional modification requests. We publicly release our code at https://github.com/AugmentedRetrieval/ReasoningAugmentedRetrieval.