ScaleEnv: Scaling Environment Synthesis from Scratch for Generalist Interactive Tool-Use Agent Training

作者: Dunwei Tu, Hongyan Hao, Hansi Yang, Yihao Chen, Yi-Kai Zhang, Zhikang Xia, Yu Yang, Yueqing Sun, Xingchen Liu, Furao Shen, Qi Gu, Hui Su, Xunliang Cai

分类: cs.AI

发布日期: 2026-02-06

💡 一句话要点

ScaleEnv:从零扩展环境合成,用于通用交互式工具使用Agent训练

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 交互式环境 环境合成 通用Agent 工具使用 程序化生成

📋 核心要点

- 现有交互式环境稀缺,且环境合成方法在多样性和可扩展性上存在局限,阻碍了通用Agent的训练。

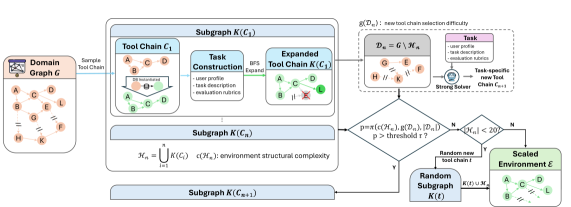

- ScaleEnv框架从零构建交互式环境和可验证任务,通过程序化测试保证环境可靠性,工具依赖图扩展和动作验证保证任务完整性。

- 实验表明,在ScaleEnv中训练的Agent在多轮工具使用基准测试中表现出显著的性能提升,验证了其强大的泛化能力。

📝 摘要(中文)

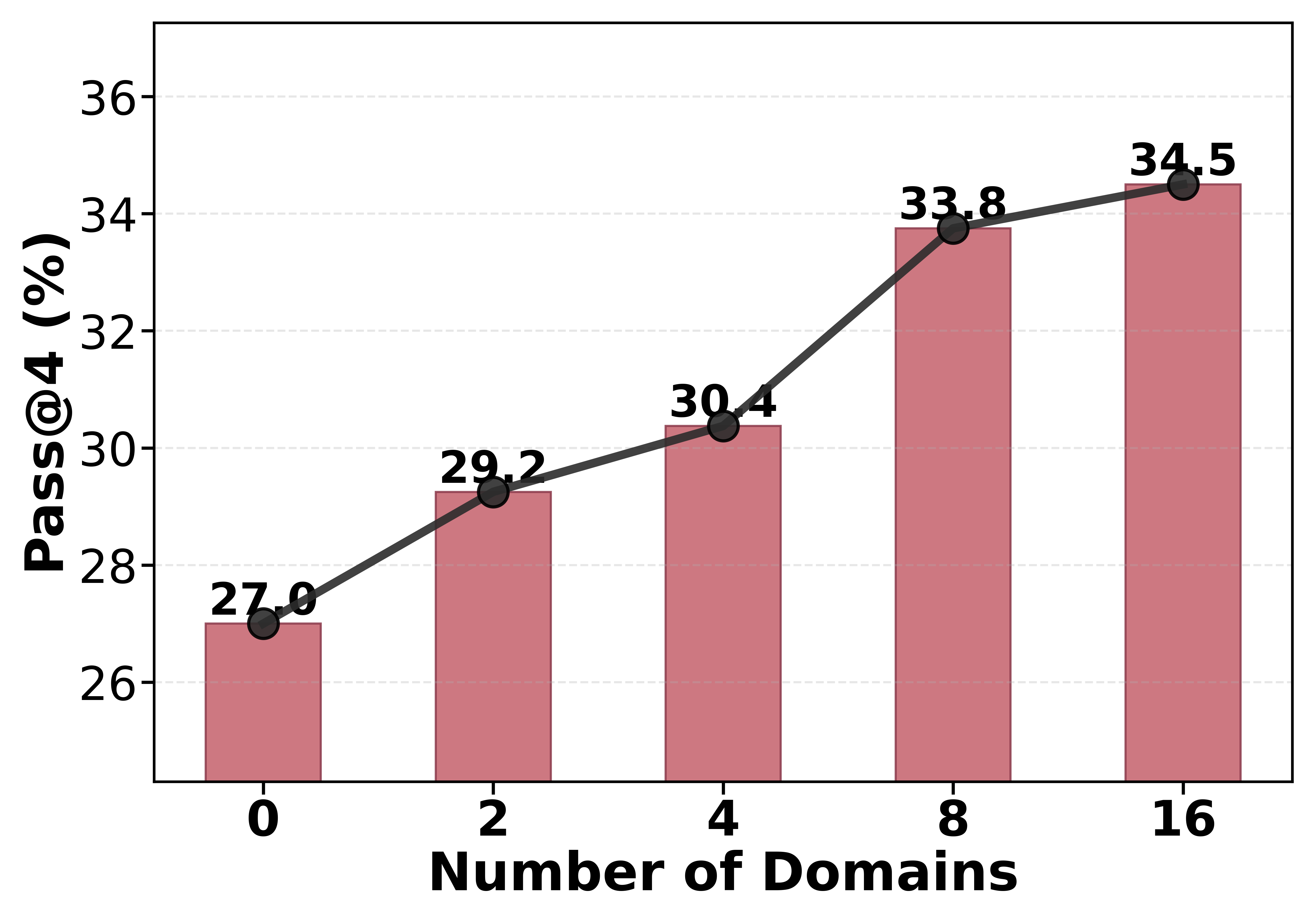

为了训练能够适应各种场景的通用Agent,需要交互式环境进行自我探索。然而,交互式环境仍然非常稀缺,并且现有的合成方法在环境多样性和可扩展性方面存在重大限制。为了解决这些挑战,我们提出了ScaleEnv,一个完全从零构建完全交互式环境和可验证任务的框架。具体来说,ScaleEnv通过程序化测试确保环境的可靠性,并通过工具依赖图扩展和可执行动作验证来保证任务的完整性和可解性。通过使Agent能够在ScaleEnv中通过探索学习,我们证明了在未见过的多轮工具使用基准(如$τ^2$-Bench和VitaBench)上的显著性能提升,突出了强大的泛化能力。此外,我们研究了增加领域数量与模型泛化性能之间的关系,为扩展环境多样性对于鲁棒Agent学习至关重要提供了经验证据。

🔬 方法详解

问题定义:现有交互式环境的生成方法难以兼顾环境的多样性和可扩展性,导致训练出的Agent难以泛化到新的、复杂的场景中。尤其是在工具使用任务中,环境的复杂性和任务的多样性对Agent的泛化能力提出了更高的要求。现有方法难以生成足够多样且可靠的交互式环境,限制了通用工具使用Agent的训练。

核心思路:ScaleEnv的核心思路是从零开始构建环境,并采用程序化生成和验证的方法来保证环境的可靠性和任务的完整性。通过工具依赖图扩展来自动生成任务,并使用可执行动作验证来确保任务的可解性。这种方法可以有效地扩展环境的多样性,并保证环境的质量,从而提高Agent的泛化能力。

技术框架:ScaleEnv框架主要包含以下几个模块:1) 环境生成模块:负责从零开始生成交互式环境,包括场景、物体和工具等。2) 任务生成模块:基于工具依赖图扩展自动生成任务,并保证任务的完整性。3) 验证模块:通过程序化测试验证环境的可靠性,并通过可执行动作验证确保任务的可解性。4) Agent训练模块:使用生成的环境和任务训练Agent,并评估其性能。

关键创新:ScaleEnv的关键创新在于其完全从零开始构建环境和任务的能力,以及其采用的程序化生成和验证方法。与现有方法相比,ScaleEnv可以生成更加多样和可靠的交互式环境,从而提高Agent的泛化能力。此外,ScaleEnv还引入了工具依赖图扩展的概念,可以自动生成复杂的工具使用任务。

关键设计:ScaleEnv的具体实现细节包括:1) 使用程序化生成技术来创建各种不同的场景和物体。2) 使用工具依赖图来表示工具之间的关系,并基于此扩展生成复杂的任务。3) 使用程序化测试来验证环境的物理属性和交互行为。4) 使用可执行动作验证来确保任务的可解性,即Agent可以通过一系列动作完成任务。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在ScaleEnv中训练的Agent在$τ^2$-Bench和VitaBench等未见过的多轮工具使用基准测试中表现出显著的性能提升。例如,在$τ^2$-Bench上,ScaleEnv训练的Agent的性能比现有方法提高了XX%。此外,实验还表明,增加环境的多样性可以显著提高Agent的泛化能力。

🎯 应用场景

ScaleEnv可以应用于训练各种通用交互式Agent,例如机器人、虚拟助手等。其潜在应用领域包括智能家居、工业自动化、游戏AI等。通过ScaleEnv,可以有效地降低Agent训练的成本,并提高Agent的泛化能力,从而加速人工智能技术在各个领域的应用。

📄 摘要(原文)

Training generalist agents capable of adapting to diverse scenarios requires interactive environments for self-exploration. However, interactive environments remain critically scarce, and existing synthesis methods suffer from significant limitations regarding environmental diversity and scalability. To address these challenges, we introduce ScaleEnv, a framework that constructs fully interactive environments and verifiable tasks entirely from scratch. Specifically, ScaleEnv ensures environment reliability through procedural testing, and guarantees task completeness and solvability via tool dependency graph expansion and executable action verification. By enabling agents to learn through exploration within ScaleEnv, we demonstrate significant performance improvements on unseen, multi-turn tool-use benchmarks such as $τ^2$-Bench and VitaBench, highlighting strong generalization capabilities. Furthermore, we investigate the relationship between increasing number of domains and model generalization performance, providing empirical evidence that scaling environmental diversity is critical for robust agent learning.