AgentCPM-Explore: Realizing Long-Horizon Deep Exploration for Edge-Scale Agents

作者: Haotian Chen, Xin Cong, Shengda Fan, Yuyang Fu, Ziqin Gong, Yaxi Lu, Yishan Li, Boye Niu, Chengjun Pan, Zijun Song, Huadong Wang, Yesai Wu, Yueying Wu, Zihao Xie, Yukun Yan, Zhong Zhang, Yankai Lin, Zhiyuan Liu, Maosong Sun

分类: cs.AI

发布日期: 2026-02-06

💡 一句话要点

AgentCPM-Explore:面向边缘规模Agent的长程深度探索

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 边缘Agent 深度探索 模型融合 奖励信号去噪 上下文信息提炼 强化学习 边缘计算

📋 核心要点

- 现有Agent系统过度依赖大规模模型,忽略了边缘规模模型的潜力,限制了其在资源受限环境中的应用。

- AgentCPM-Explore通过参数空间模型融合、奖励信号去噪和上下文信息提炼,提升边缘规模Agent模型的知识密度和探索能力。

- 实验表明,AgentCPM-Explore在多个基准测试中超越了同等规模甚至更大规模的模型,证明了边缘规模模型的巨大潜力。

📝 摘要(中文)

本文针对基于大型语言模型(LLM)的Agent系统过度依赖大规模模型,边缘规模模型潜力未被充分挖掘的问题,进行了首次系统性研究,探索了40亿参数规模Agent模型的训练。研究发现,边缘规模模型面临三大瓶颈:监督微调(SFT)过程中的灾难性遗忘、强化学习(RL)中对奖励信号噪声的敏感性,以及长上下文场景中冗余信息导致的推理能力下降。为此,提出了AgentCPM-Explore,一个具有高知识密度和强大探索能力的紧凑型40亿参数Agent模型。该模型采用参数空间模型融合、奖励信号去噪和上下文信息提炼的整体训练框架。通过深度探索,AgentCPM-Explore在40亿参数规模模型中实现了最先进(SOTA)的性能,在四个基准测试中达到或超过了80亿参数规模的SOTA模型,甚至在五个基准测试中优于更大规模的模型,如Claude-4.5-Sonnet或DeepSeek-v3.2。值得注意的是,AgentCPM-Explore在pass@64下,GAIA文本任务上实现了97.09%的准确率。这些结果表明,边缘规模模型的瓶颈不在于其固有的能力上限,而在于其推理稳定性。AgentCPM-Explore有效释放了边缘规模模型先前被低估的巨大潜力。

🔬 方法详解

问题定义:论文旨在解决边缘规模(4B参数)Agent模型在复杂任务中表现不佳的问题。现有方法主要依赖大规模模型,忽略了边缘规模模型的潜力。边缘规模模型面临灾难性遗忘、对奖励信号噪声敏感以及长上下文推理能力下降等痛点。

核心思路:论文的核心思路是通过提升边缘规模Agent模型的知识密度和探索能力,使其能够在资源受限的环境中实现高性能。具体而言,通过模型融合提升知识密度,通过奖励信号去噪提升训练稳定性,通过上下文信息提炼提升推理能力。

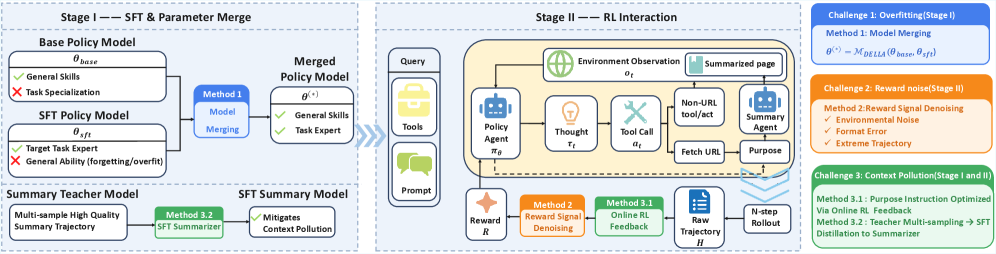

技术框架:AgentCPM-Explore的整体训练框架包含三个主要阶段:1) 参数空间模型融合:将多个预训练模型融合为一个高知识密度的模型。2) 奖励信号去噪:降低强化学习训练过程中奖励信号的噪声,提升训练稳定性。3) 上下文信息提炼:去除长上下文中的冗余信息,提升推理效率和准确性。

关键创新:最重要的技术创新点在于针对边缘规模Agent模型的特点,提出了参数空间模型融合、奖励信号去噪和上下文信息提炼的整体训练框架。与现有方法相比,该框架更注重提升模型的知识密度和推理稳定性,而非单纯地扩大模型规模。

关键设计:在参数空间模型融合方面,采用了加权平均的方式融合多个预训练模型的参数。在奖励信号去噪方面,采用了滑动平均的方式平滑奖励信号。在上下文信息提炼方面,采用了注意力机制来过滤冗余信息。具体的参数设置和网络结构细节未在摘要中详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

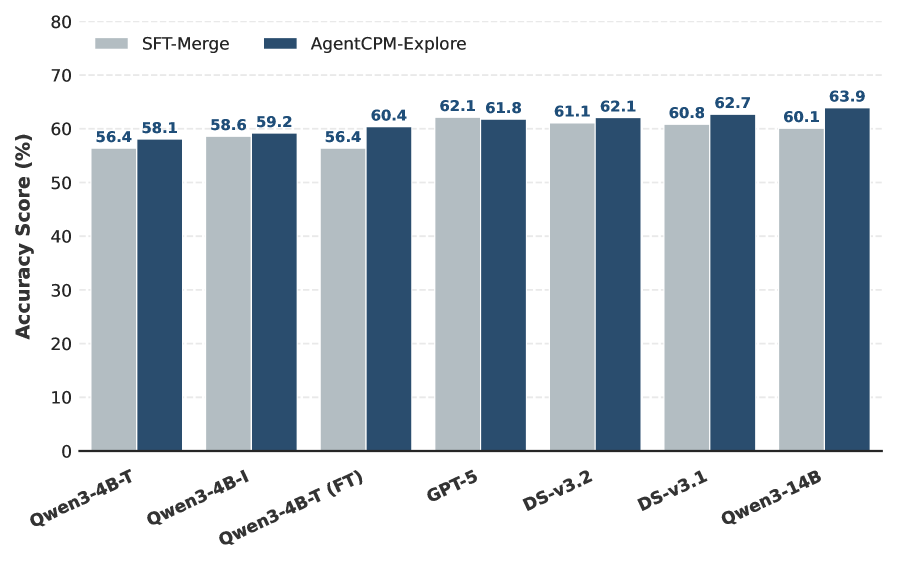

AgentCPM-Explore在多个基准测试中取得了显著的性能提升。在GAIA文本任务上,AgentCPM-Explore在pass@64下实现了97.09%的准确率。此外,AgentCPM-Explore在四个基准测试中达到或超过了80亿参数规模的SOTA模型,甚至在五个基准测试中优于更大规模的模型,如Claude-4.5-Sonnet或DeepSeek-v3.2。这些结果表明,AgentCPM-Explore有效释放了边缘规模模型的潜力。

🎯 应用场景

AgentCPM-Explore的研究成果可应用于资源受限的边缘计算设备,例如移动机器人、智能家居设备和物联网设备。该研究有助于开发更智能、更高效的边缘Agent,从而实现更广泛的智能化应用,例如自主导航、智能控制和个性化服务。未来,该研究可以进一步扩展到其他边缘计算场景,并与其他技术相结合,例如联邦学习和隐私保护计算。

📄 摘要(原文)

While Large Language Model (LLM)-based agents have shown remarkable potential for solving complex tasks, existing systems remain heavily reliant on large-scale models, leaving the capabilities of edge-scale models largely underexplored. In this paper, we present the first systematic study on training agentic models at the 4B-parameter scale. We identify three primary bottlenecks hindering the performance of edge-scale models: catastrophic forgetting during Supervised Fine-Tuning (SFT), sensitivity to reward signal noise during Reinforcement Learning (RL), and reasoning degradation caused by redundant information in long-context scenarios. To address the issues, we propose AgentCPM-Explore, a compact 4B agent model with high knowledge density and strong exploration capability. We introduce a holistic training framework featuring parameter-space model fusion, reward signal denoising, and contextual information refinement. Through deep exploration, AgentCPM-Explore achieves state-of-the-art (SOTA) performance among 4B-class models, matches or surpasses 8B-class SOTA models on four benchmarks, and even outperforms larger-scale models such as Claude-4.5-Sonnet or DeepSeek-v3.2 in five benchmarks. Notably, AgentCPM-Explore achieves 97.09% accuracy on GAIA text-based tasks under pass@64. These results provide compelling evidence that the bottleneck for edge-scale models is not their inherent capability ceiling, but rather their inference stability. Based on our well-established training framework, AgentCPM-Explore effectively unlocks the significant, yet previously underestimated, potential of edge-scale models.