Prism: Spectral Parameter Sharing for Multi-Agent Reinforcement Learning

作者: Kyungbeom Kim, Seungwon Oh, Kyung-Joong Kim

分类: cs.MA, cs.AI, cs.LG

发布日期: 2026-02-06

💡 一句话要点

Prism:基于谱参数共享的多智能体强化学习框架,提升资源效率

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 参数共享 奇异值分解 谱域学习 智能体多样性

📋 核心要点

- 传统多智能体强化学习的参数共享方法易导致同质行为,缺乏智能体间的差异性。

- Prism框架通过奇异值分解在谱域进行参数共享,智能体共享奇异向量方向,学习不同的谱掩码。

- 实验表明,Prism在同质和异质环境中均表现出色,且资源效率优于现有方法。

📝 摘要(中文)

参数共享是多智能体强化学习(MARL)中提高可扩展性的关键策略,但传统的完全共享架构通常会崩溃为同质行为。最近的方法通过聚类、剪枝或掩码来引入多样性,但通常会牺牲资源效率。我们提出了Prism,一个参数共享框架,通过奇异值分解(SVD)在谱域中表示共享网络,从而诱导智能体间的多样性。所有智能体共享奇异向量的方向,同时学习奇异值上的不同谱掩码。这种机制鼓励了智能体间的多样性,并保持了可扩展性。在同质(LBF, SMACv2)和异质(MaMuJoCo)基准上的大量实验表明,Prism在具有卓越资源效率的同时,实现了具有竞争力的性能。

🔬 方法详解

问题定义:多智能体强化学习中,参数共享是提高可扩展性的常用方法。然而,完全参数共享会导致所有智能体学习到相同的策略,从而产生同质行为,限制了智能体的多样性和整体性能。现有方法如聚类、剪枝等虽然能引入多样性,但通常会增加计算成本,降低资源效率。

核心思路:Prism的核心思路是在谱域中进行参数共享,利用奇异值分解(SVD)将共享网络分解为奇异向量和奇异值。所有智能体共享奇异向量的方向,而每个智能体学习一个独立的谱掩码作用于奇异值。通过这种方式,智能体可以共享底层知识,同时保持个体差异性。

技术框架:Prism框架包含以下主要步骤:1. 使用SVD对共享网络进行分解,得到奇异向量和奇异值。2. 所有智能体共享奇异向量。3. 每个智能体学习一个独立的谱掩码,用于调整奇异值的大小。4. 将奇异向量和调整后的奇异值重构回网络参数。5. 使用强化学习算法训练智能体的策略。

关键创新:Prism的关键创新在于在谱域中进行参数共享,通过共享奇异向量和学习独立的谱掩码,实现了智能体间的知识共享和个体差异性的平衡。与传统的完全参数共享相比,Prism能够鼓励智能体学习不同的策略,从而提高整体性能。与现有的引入多样性的方法相比,Prism具有更高的资源效率。

关键设计:谱掩码的设计是Prism的关键。每个智能体学习一个与奇异值维度相同的掩码向量,该向量中的元素取值范围为[0, 1]。掩码向量与奇异值逐元素相乘,从而调整每个奇异值的大小。掩码向量可以通过神经网络学习得到,其输入可以是智能体的状态或动作。损失函数包括强化学习损失和正则化损失,用于鼓励掩码的稀疏性。

🖼️ 关键图片

📊 实验亮点

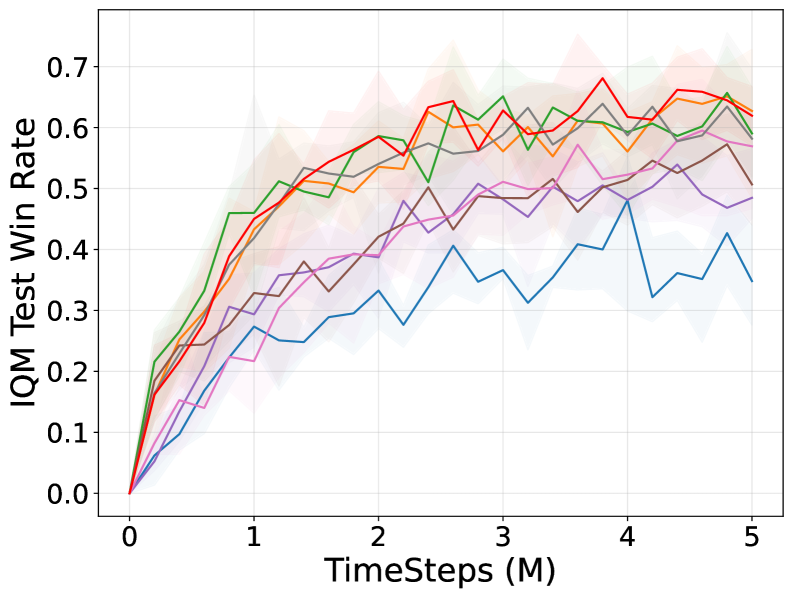

在LBF、SMACv2和MaMuJoCo等基准测试中,Prism取得了与现有方法相当甚至更优的性能。尤其是在资源效率方面,Prism显著优于其他方法,例如在MaMuJoCo的某些任务上,Prism使用更少的参数和计算资源,达到了与最先进方法相近的性能。

🎯 应用场景

Prism框架可应用于各种多智能体协作和竞争场景,例如机器人协同控制、交通流量优化、资源分配、游戏AI等。通过高效的参数共享和个体差异性学习,Prism能够提升多智能体系统的性能和可扩展性,降低部署成本,并为复杂环境下的智能体协作提供更有效的解决方案。

📄 摘要(原文)

Parameter sharing is a key strategy in multi-agent reinforcement learning (MARL) for improving scalability, yet conventional fully shared architectures often collapse into homogeneous behaviors. Recent methods introduce diversity through clustering, pruning, or masking, but typically compromise resource efficiency. We propose Prism, a parameter sharing framework that induces inter-agent diversity by representing shared networks in the spectral domain via singular value decomposition (SVD). All agents share the singular vector directions while learning distinct spectral masks on singular values. This mechanism encourages inter-agent diversity and preserves scalability. Extensive experiments on both homogeneous (LBF, SMACv2) and heterogeneous (MaMuJoCo) benchmarks show that Prism achieves competitive performance with superior resource efficiency.