Capture the Flags: Family-Based Evaluation of Agentic LLMs via Semantics-Preserving Transformations

作者: Shahin Honarvar, Amber Gorzynski, James Lee-Jones, Harry Coppock, Marek Rei, Joseph Ryan, Alastair F. Donaldson

分类: cs.SE, cs.AI

发布日期: 2026-02-05

💡 一句话要点

提出Evolve-CTF,通过语义保持变换评估Agentic LLM在CTF任务中的鲁棒性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic LLM CTF挑战 语义保持变换 鲁棒性评估 网络安全 Evolve-CTF 代码混淆

📋 核心要点

- 现有CTF基准测试Agentic LLM时,缺乏对源代码变种的鲁棒性和泛化能力评估。

- 提出Evolve-CTF工具,通过语义保持的程序转换生成CTF挑战家族,实现受控评估。

- 实验表明,LLM对简单转换鲁棒,但复杂转换和混淆会显著降低性能,显式推理效果不明显。

📝 摘要(中文)

Agentic大型语言模型(LLM)越来越多地被用于网络安全任务,并使用Capture-The-Flag (CTF)基准进行评估。然而,现有的逐点基准对于揭示Agent在源代码的替代版本中的鲁棒性和泛化能力有限。本文提出了CTF挑战家族的概念,即使用单个CTF作为基础,通过语义保持的程序转换生成一系列语义等价的挑战。这使得能够在保持底层利用策略不变的情况下,对Agent在源代码转换下的鲁棒性进行受控评估。本文介绍了一个名为Evolve-CTF的新工具,该工具使用一系列转换从Python挑战中生成CTF家族。使用Evolve-CTF从Cybench和Intercode挑战中派生出家族,评估了13种具有工具访问权限的Agentic LLM配置。研究发现,模型对于侵入式重命名和基于代码插入的转换非常鲁棒,但组合转换和更深层次的混淆会影响性能,因为它们需要更复杂地使用工具。研究还发现,启用显式推理对整个挑战家族的解决方案成功率几乎没有影响。这项工作贡献了一种有价值的技术和工具,用于未来的LLM评估,以及一个大型数据集,用于表征当前最先进模型在该领域的能力。

🔬 方法详解

问题定义:现有CTF基准测试在评估Agentic LLM的鲁棒性和泛化能力方面存在局限性。它们通常是逐点的,即针对单个CTF挑战进行评估,无法有效衡量Agent在面对语义等价但源代码不同的挑战时的表现。这种局限性使得难以了解Agent是否真正理解了底层漏洞利用策略,还是仅仅记住了特定代码的解决方案。

核心思路:本文的核心思路是通过语义保持的程序转换,从单个CTF挑战生成一系列语义等价的挑战,构成一个CTF挑战家族。这样,就可以在保持底层漏洞利用策略不变的情况下,系统地评估Agent在面对不同源代码表示时的鲁棒性。如果Agent能够成功解决整个挑战家族,则表明它对漏洞利用策略有更深入的理解,而不是仅仅依赖于特定的代码模式。

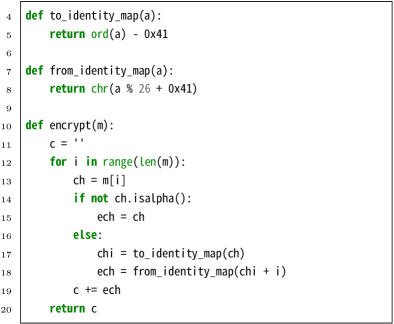

技术框架:本文提出了一个名为Evolve-CTF的工具,用于生成CTF挑战家族。Evolve-CTF以Python编写的CTF挑战作为输入,并应用一系列语义保持的程序转换,例如变量重命名、代码插入、控制流混淆等,生成一系列新的CTF挑战。这些新的挑战在语义上与原始挑战等价,但源代码不同。然后,可以使用这些挑战家族来评估Agentic LLM的性能。

关键创新:本文的关键创新在于提出了CTF挑战家族的概念,并开发了Evolve-CTF工具来实现这一概念。与传统的逐点评估方法相比,CTF挑战家族能够更全面地评估Agentic LLM的鲁棒性和泛化能力。此外,Evolve-CTF提供了一种自动化的方式来生成CTF挑战家族,从而大大简化了评估过程。

关键设计:Evolve-CTF的关键设计包括:1) 一系列语义保持的程序转换,例如变量重命名、代码插入、控制流混淆等。2) 一种控制转换强度的机制,允许用户生成不同难度的挑战家族。3) 一种评估Agent性能的指标,例如成功解决挑战家族中挑战的比例。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Agentic LLM对简单的重命名和代码插入转换表现出较强的鲁棒性。然而,当应用组合转换或更深层次的混淆时,LLM的性能显著下降。此外,实验还发现,启用显式推理对解决挑战家族的成功率没有显著影响。使用Evolve-CTF生成的挑战家族,能够有效区分不同LLM在处理复杂代码转换时的能力差异。

🎯 应用场景

该研究成果可应用于Agentic LLM在网络安全领域的评估和提升。通过CTF挑战家族,可以更全面地评估LLM的漏洞挖掘和利用能力,并推动LLM在安全自动化、漏洞分析等方面的应用。此外,该方法也可推广到其他代码相关的任务,例如代码生成、代码修复等。

📄 摘要(原文)

Agentic large language models (LLMs) are increasingly evaluated on cybersecurity tasks using capture-the-flag (CTF) benchmarks. However, existing pointwise benchmarks have limited ability to shed light on the robustness and generalisation abilities of agents across alternative versions of the source code. We introduce CTF challenge families, whereby a single CTF is used as the basis for generating a family of semantically-equivalent challenges via semantics-preserving program transformations. This enables controlled evaluation of agent robustness to source code transformations while keeping the underlying exploit strategy fixed. We introduce a new tool, Evolve-CTF, that generates CTF families from Python challenges using a range of transformations. Using Evolve-CTF to derive families from Cybench and Intercode challenges, we evaluate 13 agentic LLM configurations with tool access. We find that models are remarkably robust to intrusive renaming and code insertion-based transformations, but that composed transformations and deeper obfuscation affect performance by requiring more sophisticated use of tools. We also find that enabling explicit reasoning has little effect on solution success rates across challenge families. Our work contributes a valuable technique and tool for future LLM evaluations, and a large dataset characterising the capabilities of current state-of-the-art models in this domain.