A Unified Multimodal Framework for Dataset Construction and Model-Based Diagnosis of Ameloblastoma

作者: Ajo Babu George, Anna Mariam John, Athul Anoop, Balu Bhasuran

分类: cs.AI, cs.CL

发布日期: 2026-02-05

💡 一句话要点

提出统一多模态框架,用于成釉细胞瘤数据集构建与模型诊断。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 成釉细胞瘤 多模态学习 深度学习 自然语言处理 医学图像分析

📋 核心要点

- 颌面病理学中基于AI的诊断需要高质量的多模态数据集,但现有资源在成釉细胞瘤覆盖方面有限,且缺乏直接模型训练所需的格式一致性。

- 论文提出了一种统一的多模态框架,整合了放射影像、组织病理学图像、临床图像和结构化数据,并利用NLP技术提取临床特征。

- 实验结果表明,该模型在成釉细胞瘤变异分类和异常组织检测方面取得了显著提升,为患者特异性决策支持提供了有力工具。

📝 摘要(中文)

本文提出了一种新的多模态框架,用于构建高质量的成釉细胞瘤数据集并进行基于模型的诊断。该数据集整合了带标注的放射影像、组织病理学图像、口内临床图像以及从病例报告中提取的结构化数据。利用自然语言处理技术从文本报告中提取临床相关特征,并对图像数据进行领域特定的预处理和增强。基于此数据集,开发了一个多模态深度学习模型,用于成釉细胞瘤变异分类、复发风险评估和支持手术规划。该模型在部署时可接受临床输入,如主诉、年龄和性别,以增强个性化推理。定量评估表明,变异分类准确率从46.2%提高到65.9%,异常组织检测F1分数从43.0%提高到90.3%。与MultiCaRe等资源相比,该工作通过提供稳健的数据集和适应性强的多模态AI框架,推进了患者特异性决策支持。

🔬 方法详解

问题定义:论文旨在解决颌面病理学中成釉细胞瘤AI辅助诊断数据集匮乏且格式不统一的问题。现有数据集覆盖范围有限,难以直接用于模型训练,阻碍了AI技术在该领域的应用。因此,需要构建一个高质量、结构化的多模态数据集,并开发相应的诊断模型。

核心思路:论文的核心思路是构建一个统一的多模态框架,整合多种数据来源(放射影像、组织病理学图像、临床图像和病例报告),并利用自然语言处理和图像处理技术提取和处理相关特征。通过多模态数据的融合,可以更全面地了解成釉细胞瘤的特征,从而提高诊断的准确性和可靠性。同时,该框架还考虑了临床输入,以实现个性化的推理。

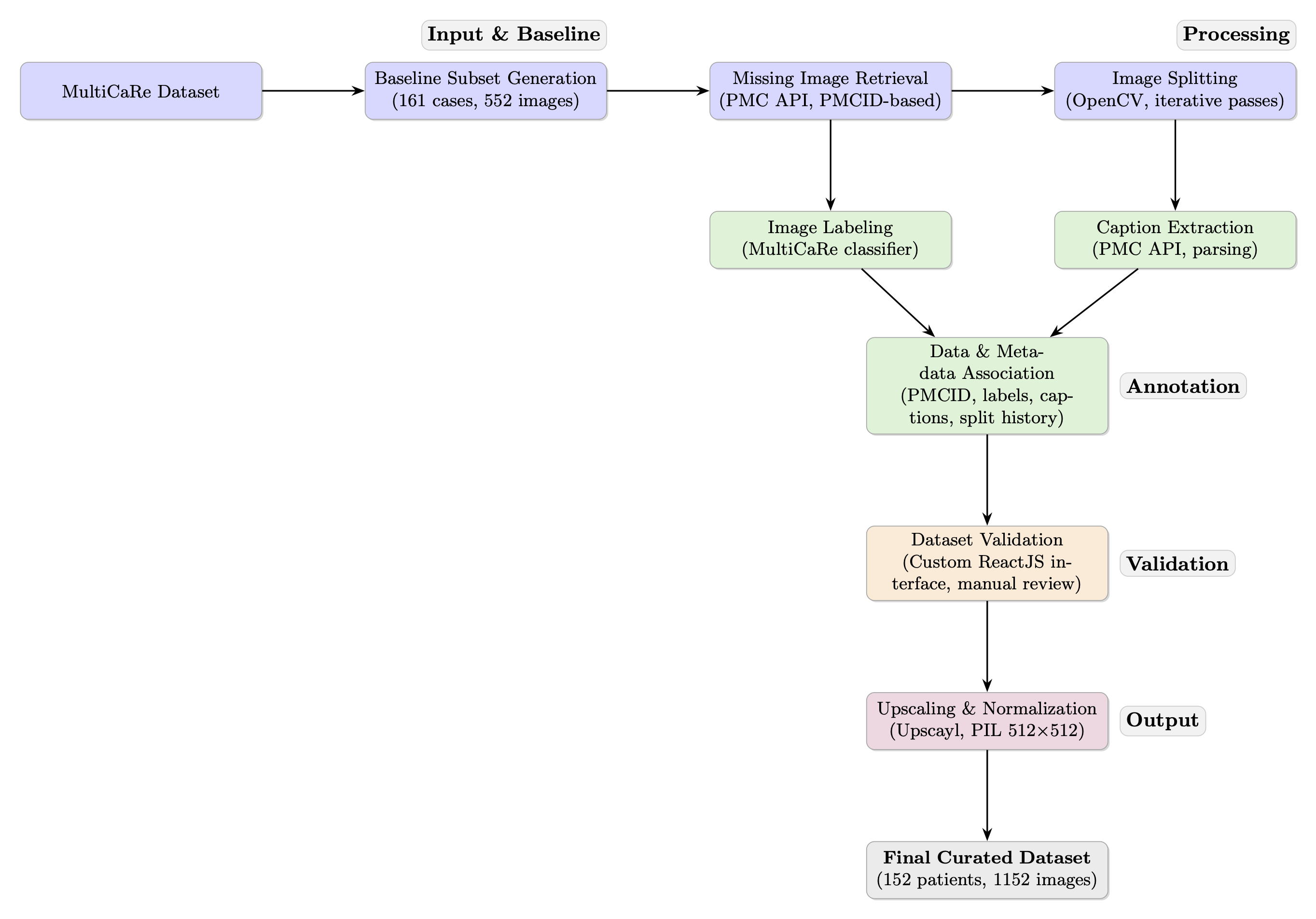

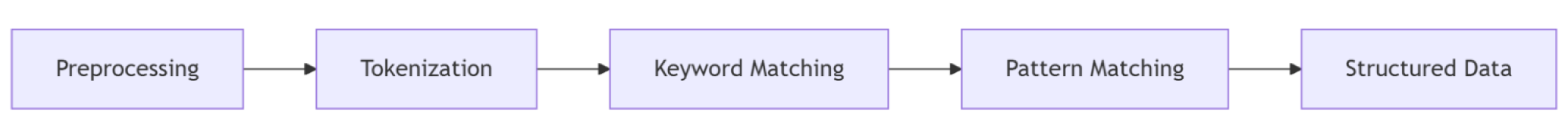

技术框架:该框架主要包含以下几个模块:1) 数据收集与整合:收集放射影像、组织病理学图像、临床图像和病例报告等多种数据;2) 特征提取:利用自然语言处理技术从病例报告中提取临床特征,并对图像数据进行预处理和增强;3) 多模态数据融合:将提取的特征进行融合,形成统一的多模态表示;4) 模型训练:基于融合后的数据,训练深度学习模型,用于成釉细胞瘤变异分类、复发风险评估和手术规划;5) 模型部署:将训练好的模型部署到临床环境中,并接受临床输入,以实现个性化的诊断。

关键创新:该论文的关键创新在于构建了一个统一的多模态框架,能够有效地整合多种数据来源,并利用自然语言处理和图像处理技术提取和处理相关特征。与现有方法相比,该框架能够更全面地了解成釉细胞瘤的特征,从而提高诊断的准确性和可靠性。此外,该框架还考虑了临床输入,以实现个性化的推理,这在现有方法中是很少见的。

关键设计:论文中关于模型和训练的具体细节未详细描述,因此这部分信息未知。但可以推测,模型可能采用了某种形式的深度学习架构,例如卷积神经网络(CNN)用于图像特征提取,循环神经网络(RNN)或Transformer用于处理文本特征,并通过某种融合机制将这些特征整合在一起。损失函数的设计可能包括分类损失(用于变异分类)和回归损失(用于复发风险评估)。具体的参数设置和网络结构需要参考论文的补充材料或后续研究。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该模型在成釉细胞瘤变异分类和异常组织检测方面取得了显著提升。变异分类准确率从46.2%提高到65.9%,提升了约19.7%;异常组织检测F1分数从43.0%提高到90.3%,提升了约47.3%。这些数据表明,该模型具有较高的诊断准确性和可靠性,能够为临床医生提供有价值的辅助诊断信息。

🎯 应用场景

该研究成果可应用于颌面病理学领域,为临床医生提供成釉细胞瘤的辅助诊断和治疗方案建议。通过整合多模态数据和AI技术,可以提高诊断的准确性和效率,减少误诊和漏诊,并为患者提供个性化的治疗方案。未来,该框架可以扩展到其他颌面部疾病的诊断和治疗,具有广阔的应用前景。

📄 摘要(原文)

Artificial intelligence (AI)-enabled diagnostics in maxillofacial pathology require structured, high-quality multimodal datasets. However, existing resources provide limited ameloblastoma coverage and lack the format consistency needed for direct model training. We present a newly curated multimodal dataset specifically focused on ameloblastoma, integrating annotated radiological, histopathological, and intraoral clinical images with structured data derived from case reports. Natural language processing techniques were employed to extract clinically relevant features from textual reports, while image data underwent domain specific preprocessing and augmentation. Using this dataset, a multimodal deep learning model was developed to classify ameloblastoma variants, assess behavioral patterns such as recurrence risk, and support surgical planning. The model is designed to accept clinical inputs such as presenting complaint, age, and gender during deployment to enhance personalized inference. Quantitative evaluation demonstrated substantial improvements; variant classification accuracy increased from 46.2 percent to 65.9 percent, and abnormal tissue detection F1-score improved from 43.0 percent to 90.3 percent. Benchmarked against resources like MultiCaRe, this work advances patient-specific decision support by providing both a robust dataset and an adaptable multimodal AI framework.