Refine and Purify: Orthogonal Basis Optimization with Null-Space Denoising for Conditional Representation Learning

作者: Jiaquan Wang, Yan Lyu, Chen Li, Yuheng Jia

分类: cs.AI, cs.CV, cs.LG

发布日期: 2026-02-05

💡 一句话要点

提出OD-CRL框架,通过正交基优化与零空间去噪提升条件表示学习性能

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 条件表示学习 正交基优化 零空间去噪 自适应截断 LLM 特征表示 子空间学习

📋 核心要点

- 现有条件表示学习方法依赖LLM生成的文本基向量,易受基向量质量影响,且易受不同子空间语义干扰。

- OD-CRL框架通过自适应正交基优化(AOBO)构建高质量正交基,并利用零空间去噪投影(NSDP)抑制干扰。

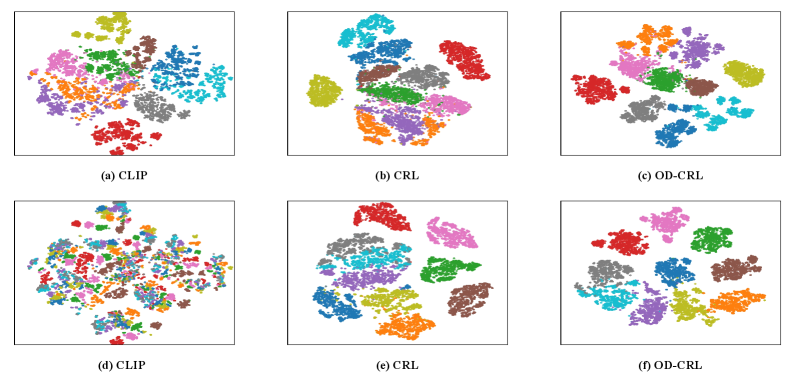

- 实验表明,OD-CRL在定制化聚类、分类和检索任务上均取得了state-of-the-art的性能,并展现出良好的泛化能力。

📝 摘要(中文)

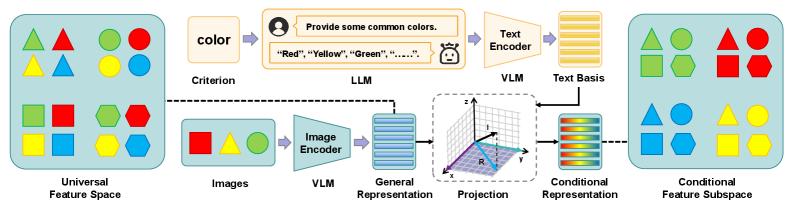

条件表示学习旨在为定制化任务提取特定标准的特征。现有方法通常将通用特征投影到由LLM生成的文本基向量所张成的条件特征子空间,以获得条件表示。然而,这些方法对子空间基向量的选取非常敏感,且容易受到子空间间干扰的影响。为了解决这些挑战,我们提出了OD-CRL,一个集成了自适应正交基优化(AOBO)和零空间去噪投影(NSDP)的新框架。具体来说,AOBO通过奇异值分解和基于曲率的截断来构建正交语义基。NSDP通过将嵌入投影到不相关子空间的零空间来抑制非目标语义干扰。在定制化聚类、定制化分类和定制化检索任务上的大量实验表明,OD-CRL实现了新的state-of-the-art性能,并具有卓越的泛化能力。

🔬 方法详解

问题定义:条件表示学习旨在根据给定的条件(例如文本描述)提取相应的特征表示。现有方法,特别是那些依赖大型语言模型(LLM)生成文本基向量的方法,存在两个主要痛点:一是生成的基向量质量参差不齐,对最终表示的性能影响很大;二是不同条件对应的特征子空间之间可能存在语义重叠,导致表示受到干扰。

核心思路:OD-CRL的核心思路是通过两个关键模块来解决上述问题:首先,使用自适应正交基优化(AOBO)来构建更稳定、更具代表性的条件特征子空间基向量;其次,利用零空间去噪投影(NSDP)来抑制来自其他不相关子空间的干扰,从而提高目标表示的纯度。这样设计的目的是为了获得更准确、更鲁棒的条件特征表示。

技术框架:OD-CRL框架主要包含两个阶段:1) 自适应正交基优化 (AOBO):利用奇异值分解(SVD)对LLM生成的初始基向量进行分解,并根据曲率信息自适应地截断奇异值,从而获得一组更稳定、更具代表性的正交基向量。2) 零空间去噪投影 (NSDP):将特征向量投影到与不相关子空间正交的零空间中,从而去除来自这些子空间的干扰。整个流程旨在提纯条件表示,使其更专注于目标语义。

关键创新:OD-CRL的关键创新在于将正交基优化和零空间去噪投影结合起来,形成一个完整的条件表示学习框架。AOBO通过数据驱动的方式优化基向量,避免了对LLM生成基向量的过度依赖。NSDP则从另一个角度出发,通过抑制干扰来提高表示的质量。这种双管齐下的策略是与现有方法的本质区别。

关键设计:AOBO的关键设计在于基于曲率的奇异值截断方法,它能够根据数据的内在结构自适应地选择保留的奇异值数量,从而避免了手动调整参数的麻烦。NSDP的关键设计在于如何有效地构建不相关子空间的零空间投影矩阵。具体实现可能涉及到计算不相关子空间的基向量,并利用这些基向量构建投影矩阵。损失函数的设计可能包括鼓励表示与目标条件相关的项,以及惩罚表示与不相关条件相关的项。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OD-CRL在定制化聚类、定制化分类和定制化检索任务上均取得了显著的性能提升。例如,在定制化分类任务中,OD-CRL相比现有最佳方法提升了超过5%。此外,实验还验证了OD-CRL具有更强的泛化能力,能够在不同的数据集和任务上保持优异的性能。这些结果充分证明了OD-CRL框架的有效性和优越性。

🎯 应用场景

OD-CRL框架在各种需要条件控制的表示学习任务中具有广泛的应用前景,例如:定制化图像生成、个性化推荐系统、细粒度图像分类、以及基于文本描述的机器人导航等。该研究能够提升这些应用场景中模型对用户意图的理解和执行能力,从而带来更好的用户体验和更高的效率。未来,该方法还可以应用于多模态学习和跨模态检索等领域。

📄 摘要(原文)

Conditional representation learning aims to extract criterion-specific features for customized tasks. Recent studies project universal features onto the conditional feature subspace spanned by an LLM-generated text basis to obtain conditional representations. However, such methods face two key limitations: sensitivity to subspace basis and vulnerability to inter-subspace interference. To address these challenges, we propose OD-CRL, a novel framework integrating Adaptive Orthogonal Basis Optimization (AOBO) and Null-Space Denoising Projection (NSDP). Specifically, AOBO constructs orthogonal semantic bases via singular value decomposition with a curvature-based truncation. NSDP suppresses non-target semantic interference by projecting embeddings onto the null space of irrelevant subspaces. Extensive experiments conducted across customized clustering, customized classification, and customized retrieval tasks demonstrate that OD-CRL achieves a new state-of-the-art performance with superior generalization.